斅嬥嬋偘栘(^^乁丂憤瀢嶌傝側偺偩偀丅

斅嬥嬋偘栘(^^乁丂憤瀢嶌傝側偺偩偀丅仭俀寧俉擔丂亙僗僺撏偔亜仭

僗僺乕僔乕僘偑偲偆偲偆撏偔丅

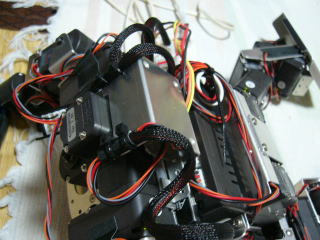

僙儞僒乕儃乕僪偲僆僾僔儑儞偺僕儍僀儘偑傑偩撏偐側偄丅偦傟偼帠慜楢棈偳偍傝側偺偱傑偀丅丅偱傕丄偄偮撏偔傫偩傠偆丅偁偲偼儔僀僽儔儕乕傕俴倕倐倕倢俀仌俁偵側偭偰傞偟丄僒乕價僗偺僶僢僥儕乕廩揹婍傕擖偭偰偨偟丄栤戣側偝偦偆丅晹昳偑懙偭偰傞偐偳偆偐僠僃僢僋偟傛偆偐偲巚偭偨偗偳偨偄傊傫偦偆側偺偱儎儊丅僒乕儃偲偐偼擖偭偰傞偺偱傑偀戝忎晇偩傠偆丅偦傟偵僒億乕僩偟偰偔傟偦偆偩偟丅

崱擔偼偐偹偰偐傜偺梊掕捠傝丄斅嬥愜傝嬋偘婡偺惢嶌偵庢傝妡偐傞丅嵽椏偺愗傝弌偟働僈僉傪偟偰丄丄僟儔僟儔傗偭偰傞偐傜側偐側偐恑傑側偄丅偦傟偵丄岺嶌偼媣偟傇傝偩偟丒丒丒丅寢嬊丄愗傝弌偟嶌嬈偩偗偱廔傢偭偰偟傑偭偨丅寠偁偗偼屻擔偩側丅偦傟偵偟偰傕奜嶌嬈偼姦偄偂乣丅姦偡偓丅

儅僯儏傾儖傪堦捠傝撉傫偱傒偨丅僜僼僩僂僃傾奐敪幰岦偗偭傐偔丄慻傒棫偰愢柧彂偼側偐側偐嵶偐偄丅偁乣丄偱傕戝曄偦偆偩側偀丅僼儗乕儉愝寁偡傞慜偵慻傒棫偰偰傒傛偆偐側偲偐巚偭偰偨偗偳儎儊偐側丅壓敿恎偼丅丅俠俹倀儐僯僢僩偲偐丄僒乕儃偺摦嶌偲偐妋擣偟側偒傖偲巚偄偮偮崱擔偼傗傔丅

奐敪娐嫬偼Cygwin偱僋儘僗僐儞僷僀儖偭偰峫偊偰偨偗偳僟儊偩偭偰曉帠偑丅偍偐偟偄側偀gcc偱偱偒偦偆偩偭偰巚偆偺偵丅

仭俀寧俋擔丂亙僋儘僗偭偰怺偄亜仭

僲乕僩偵僨儏傾儖僽乕僩偱NetBSD擖傟傞偺傕偄偄偗偳丄偆乕傫丅丅丅俫俢俢偵梋桾偁傟偽擖傟偰偍偄偰傕偄偄偗偳丄娐嫬嵞峔抸偼偄傗偩側丅僨僗僋僩僢僾偵擖傟傞傛偆偵峫偊傛丅僱僀僥傿僽偺NetBSD桳偭偨曽偑傛偝偦偆偩偟丅偄傠偄傠丅傜傟偨偗偳丄攦傢側偒傖側傜側偄偟丄僀儅僀僠庯枴偠傖側偄偐傜忔傝婥偑側偄丅偦偺屻丄僜僼僩扴摉偐傜僋儘僗僐儞僷僀儖娐嫬偺忦審偑撏偄偨丅偄偗傞偐傕丄偟偽傜偔偼Cygwin偱偺僋儘僗僐儞僷僀儖娐嫬峔抸偵偙偩傢偭偰傒傛偆丅

偙偙傜傊傫偑嶲峫偵側傝偦偆丅

http://www.sixnine.net/cygwin/translation/devel/cygwin-to-newlib-cross-howto.html

http://www.asahi-net.or.jp/~wg5k-ickw/html/online/gcc-2.95.2/gcc_toc.html

偝偭偔傝偲gcc偺價儖僪傪偟偰傒偨偗偳偆傑偔偄偐側偄丅偆傑偔偄偐側偄偲側傞偲側偐側偐愭偵恑傑側偄傫偩傛偹丅configure偲偐偡偛偔椙偔偱偒偰傞傫偩偗偳丄巇慻傒偑岻柇夁偓偰傛偔抦傜側偄偲捛愓偱偒側偄丅働乕僗偲偟偰偼昁梫側僿僢僟乕僼傽僀儖偑尒傟側偄偭偰僷僞乕儞偑懡偄偐側丅偦偺曈傝傪僄儔乕儊僢僙乕僕偲僜乕僗尒側偑傜捛愓丅偱傕崱擔偼僟儊側傑傑偁偒傜傔傞丅

仭俀寧侾侽擔丂亙崱擔偼忔傜偹乕亜仭

嶐擔偺懕偒偱僋儘僗僐儞僷僀儖娐嫬峔抸偲丄柧擔偺寠偁偗偺偨傔偺働僈僉傪偟傛偆偲巚偭偰偑傫偽偭偰働僈僉傑偱丅傗偭傁傝摦嶌妋擣偟側偒傖側偀偲巚偭偰CPU儐僯僢僩偵揹尮傪擖傟偰傒傞丅偪傖傫偲摦偄偨丅UNIX偑摦偄偰傞偺偼傗偭傁傃偭偔傝偱偡側丅偙傫側偪偭偙偄偺偵丅丅

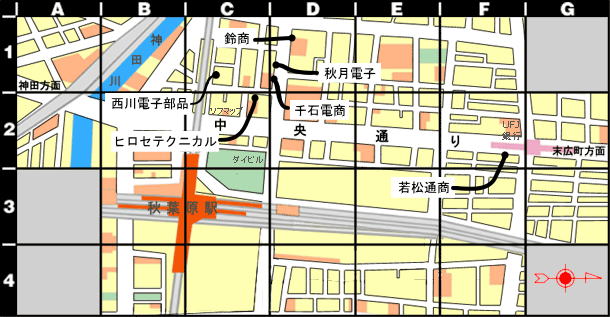

僲乕僩俹俠偵COM億乕僩偑側偄偺偱偙偺擔偺偨傔偵攦偭偰偍偄偨USB-COM傾僟僾僞乕傪僀儞僗僩乕儖丅偙傟偭偰偁傫傑傝攧偭偰側偐偭偨丅抣抜傕偁傫傑傝埨偔側偄丅乮俁俆侽侽墌偔傜偄乯攦偄偵峴偭偨偲偒丄儘儃僢僩墹崙側傜攧偭偰傞偩傠偆偭偰巚偭偨偗偳攧偭偰側偐偭偨偲巚偭偨傜師偵峴偭偨帪偼攧偭偰偨丅尒偮偗傜傟側偐偭偨偺偹丅抣抜曄傢傜側偐偭偨偐傜偄偄偗偳丅偮側偄偱傒偰巚偭偨偗偳丄柍慄LAN愝掕偟偪傖偊偽偙偺傾僟僾僞乕偭偰梫傜側偔側傞偺偐側丠僨僗僋僩僢僾偱愝掕偡傟偽傛偐偭偨傫偐側偀乣丅傑丄偄偄偐丅

儔儉僟偺懌偺媡塣摦寁嶼傪峫偊偰偍偙偆偲巚偭偰弌挘偺堏摦帪娫側傫偐偵峫偊偰傒偰傞丅儔儉僟偼儘乕儖幉傪懢傕傕偵帩偭偰偔傞偮傕傝偩偗偳丄寁嶼揑偵偼偳偆側傫偐側乕丅怓乆偲峫偊偨偗偳丄儘乕儖偼儘乕儖偲偄偆寢榑丅栤戣側偝偦偆丅儘乕儖傪帩偭偨娭愡偺応崌丄媡塣摦寁嶼偼堦堄偵寛傑傜側偄傫偩偗偳丄儘乕儖妏偩偗梌偊傟偽寛傑傞傛偆偩偹丅偁偲偼戝懱傾僀儃偺媡塣摦妛寁嶼偺宱尡偱側傫偲偐側傝偦偆丅悢幃傑偱偵偼棊偲偟偰側偄偗偳偦傟偼傑偨擼傒偦偺僋儘僢僋傪彊乆偵忋偘偰偐傜丅丅

偍晽楥偵擖傝側偑傜丄UNIX偱偺儘儃僢僩惂屼僾儘僌儔儉傪峫偊傞丅傾僀儃偺傾儁儕僆僗偼姰慡側僀儀儞僩僪儕僽儞宆偱丄怓乆偲娙扨偩偭偨偗偳丄乮棟夝偡傞傑偱偼側傫偩偐偨偗偳乯RTLinux尒偨偄側傫偠傖側偄偐傜偳偆傗傞傫偐側偀乣偭偰姶偠偺偙偲丅挷傋傞偲丄僀儞僞乕僶儖偭偰僔僌僫儖偑偁傞傫偹丅幚峴偟偰丄娭愡惂屼偲偐夋憸張棟偲偐偺僕儑僽偵僼僅乕僋偟偰丄儊僀儞偼僀儞僞乕僶儖僔僌僫儖偆偗偰偦傟偧傟偺僕儑僽偵巜帵傪憲傞偭偰姶偠偐側丅

仭俀寧侾侾擔丂亙僣乕儖嶌傝偼偮傜偄傛亜仭

梊掕捠傝偵斅嬥愜傝嬋偘婡偺嶌惉偲僋儘僗僐儞僷僀儔偺價儖僪丅

斅嬥愜傝嬋偘婡偼偁偲偼僽儗乕僪傪嶌傞偩偗丅偙傟偑戝曄側傫偩偗偳偹丅偁丄偁偲丄栘傪偪傚偭偲嶍傜側偒傖丅儀乕僗偺栘嵽偼俢俬倄揦偱抂愗傟傪埨偔攦偭偰偒偨丅側傫偐抦傜側偄偗偳瀢丅寠偲偐奐偗傞偲偄偄偵偍偄偑偡傞丅

僋儘僗僐儞僷僀儔偼擄峲拞丅側傫偲偐丄gcc偩偗偼僐儞僷僀儖偱偒偨偗偳丄newlib偑偱偒傫丅枅搙側偑傜價儖僪偼偮傜偄丅傢偐傜傫傕傫丅僪僉儏儊儞僩偼塸岅偩偟丅僋儘僗娐嫬偭偰傒傫側嬯怱偟偰傞傒偨偄偱丄僱僢僩偱扵偡偲怓乆偲弌偰偔傞丅偁傑傝徻偟偔側偄偗偳偙傫側偺傪傒偮偗偨丅

乽偁傜晄巚媍丄Windows(Cygwin)偱僐儅儞僪傪懪偭偨傜丄NetBSD/PowerPC偺僶僀僫儕傪揻偔傛偆偵側偭偨傛丅乿

偍偍丄傗偭傁偱偒傞傫偠傖傫丅偑傫偽傠乕偭偲丅傑丄偱傕丄傕偆偪傚偭偲傗偭偰偩傔側傜僼傽儞偺壒偑偆傞偝偄僨僗僋僩僢僾儅僔儞偵NetBSD傪僀儞僗僩乕儖偡傞偮傕傝丅偦偭偪偱僋儘僗娐嫬偱偒偨傜儔僀僽儔儕偲偐偼僐僺偭偰偔傟偽偄偄偩偗偩偐傜妝偩偟丅幾摴慡慠僆僢働乕偩偟丅

binutils偲gcc偺戞堦抜奒偼偙傫側晽偵偟偰僐儞僷僀儖偱偒偨丅newlib傕揥奐偟偰偍偐側偄偲偩傔丅偁偲丄儔僀僽儔儕嶌傞偲偙傠偱丂-lc丂偑尒偮偐傜側偄偭偰尵傢傟傞偐傜libgcc.mk偐傜徚偟偨丅偄偄偺偐偳偆偐偼傑偩傢偐傜傫丅

binutils:

$ /usr/src/binutils-2.15/configure --with-included-gettext --target=$target --host=$host --build=$build --prefix=$prefix -v

$ make > make.log 2>&1

gcc:(c僐儞僷僀儔偩偗乯

$ /usr/src/gcc-3.4.1-1/configure --enable-languages=c,c++ --with-included-gettext --target=$target --host=$host --build=$build --with-newlib --with-headers=/usr/src/newlib-1.10.0/newlib/libc/include/ --prefix=$prefix -v

$ make LANGUAGES=c all-gcc > make2.log 2>&1

嵶偐偄庤弴偼偙偙傪嶲徠偵丅

http://www.sixnine.net/cygwin/translation/devel/cygwin-to-newlib-cross-howto.html

偟偐偟丄僣乕儖嶌傝偼僣儔僀丅側傫偐庡巪偑曄傢偭偰偒偦偆偵側傞丅

仭俀寧侾俀擔丂亙懕偮傜偄亜仭

弌偐偗偰偨偺偱擔拞偼壗傕偣偢丅僋儘僗娐嫬偑偱偒傞傑偱傎偐偺帠偡傞婥偵側傜側偄丅偱傕丄偪傚偭偲傔傫偳偔偝偔側偭偰偒偨丅堦墳丄NetBSD偺僼傽僀儖孮傪僟僂儞儘乕僪偟偲偙偆偐側丅newlib偺價儖僪丅偳偆傕偍偐偟偄偺偱configure偐傜嵞搙僠僃僢僋丅傫丠傕偟偐偟偰丄僞乕僎僢僩偭偰乽powerpc-elf-netbsd乿偠傖側偔偰乽powerpc-unknown-netbsdelf乿偑惓夝丠arch-maker-os偩傕傫側丅*-elf-*偭偰乕偺偼偍偐偟偄側丠偲偼巚偭偰偨傫偩丅崱擔偼傕偆抶偄偐傜柧擔弶傔偭偐傜傗傝捈偟偰傒傞丅

仭俀寧侾俁擔丂亙懕懕偮傜偄亜仭

擔拞偼斅嬥愜傝嬋偘婡偺僽儗乕僪傪嶌偭偨傝嬋偘壛岺偵偮偄偰尋媶偟偨傝偡傞傋偒側偺偵丄僋儘僗娐嫬偑婥偵側偭偰偟傑偆丅岺嶌偼奜偱傗傞偐傜姦偦偆偩偭偰偺傕偁傞偗偳丅powerpc-unknown-netbsdelf偱傗偭偰傒偨偗偳丄傗偭傁傝newlib偼幐攕偡傞丅傗偭傁傝僀儞僋儖乕僪僼傽僀儖偵栤戣偑偁傝偦偆偩丅

偙傫側儁乕僕傪尒偮偗偨丅

http://netbsd.tale.net/ja/Documentation/cross/#terminology

偙傟偵傛傞偲BeBox偼powerpc-netbsd偱elf丅BeBox梡偺僶僀僫儕乕偐傜儔僀僽儔儕乕帩偭偰偙傟側偄偐側丅偦偺曈偳偆側傫偩傠丠枩嶔恠偒偨傜傗偭偰傒傞偐丅偙偺儁乕僕偵傛傞偲丄傗偭傁傝僀儞僋儖乕僪僼傽僀儖偑栤戣傜偟偄丅newlib偺價儖僪偱傗偭偰傞偺傪尒傞偲丄binutils偱僐僺乕偟偨sys-include傪嶲徠偟偰偄傞傜偟偄丅偙偙偭偰newlib偐傜僐僺乕偟偨傫偩偐傜傑偢偄傛偹丅傗偭傁傝偙偙偵NetBSD偺僜乕僗偵擖偭偰傞include僼傽僀儖傪擖傟傞偭偰偺偑惓夝偺傛偆偵巚偊傞丅乮嶐擔偼偙傟傪傗偭偰偰偒傝偑側偄偐傜傗傔偨丅乯偦傠偦傠僨僗僋僩僢僾偵NetBSD擖傟傞弨旛傪巒傔傛偆偐側偀丅丅丅丅

偑傫偽偭偰斅嬥愜傝嬋偘婡偼姰惉偝偣偰丄僩儔僀丅偆傑偔嬋偑傞偗偳俋侽搙偱巭傔傞偺偼擄偟偄側丅偙傟丄怑恖媄偩丅偱傕丄僽儗乕僪偼恀偪傘偆偱廫暘偲偄偆偙偲偑敾偭偨丅僽儗乕僪傕偆傑偔嶍傟偨偟丄側傫偐偄偄姶偠丅巆傞偼僋儘僗娐嫬丅偳偆偵傕偆傑偔峴偐側偄偺偱傗偭傁傝NetBSD傪僀儞僗僩乕儖偡傞偙偲偵丅僨僗僋僩僢僾俹俠偺僶僢僋傾僢僾梡HDD偵侾俧俛偔傜偄僗儁乕僗傪嶌偭偰丄偦偙偵擖傟傞偙偲偵丅寢嬊丄俠俢僀儊乕僕偐傜僽乕僞僽儖俠俢傪嶌偭偰僀儞僗僩乕儖偟偨傫偩偗偳丄FreeBSD偵斾傋偰僀儞僗僩乕儔乕偑晄恊愗夁偓偭丅僶僢僋傾僢僾僨乕僞傪俀夞傕僐僺乕偟側偍偟偰丄偝傜偵偦傟偼柍懯偩偭偨丅僀儞僗僩乕儖偑廔傢偭偨偐傜傕偆堦夞僶僢僋傾僢僾偟側偒傖丅崱擔丄怮傟傞偐側偀丅FreeBSD偼僀儞僗僩乕儔偩偗偠傖側偔偦偺屻傕晄恊愗丅偭偰偐丄FreeBSD傗Linux偑恊愗側傫偩傠偆側丅UNIX偭偰杮棃偙傫側傕傫偐丠堘偆側偀丅偙傟偠傖偙偺帪戙惗偒偰偄偗側偄偭偰婥偑偡傞偗偳丄僼儕乕俷俽偩偐傜惗偒偰偄偗傞傫偐側丅傑丄偄偄傗丅偙偭偐傜愭偼偳偆偡傞傫偐側乕偭偰巚偭偰僱僢僩専嶕偟偨傜傗偭偲尒偮偐偭偨丅乽NetBSD偼偝傑偞傑側僾儔僢僩僼僅乕儉偱棙梡偱偒傞傛偆偵岺晇偝傟偰偍傝丄 FreeBSD偺ports偵憡摉偡傞 pkgsrc傪棙梡偡傟偽旕忢偵梡堄偵僋儘僗僐儞僷僀儔偑僀儞僗僩乕儖偱偒傞丅乿偦偆偱偡丅

http://www.tokuda.net/NetBSD/OBS/index-1.5V.html

偑傫偽偭偰pkgsrc.tgz傪揥奐偟偨偗偳丄powerpc-netbsd偼柍偐偭偨丅偟偐偨側偄偺偱愄偺僶乕僕儑儞偺僷僢働乕僕傪尒偮偗偰偒偰僀儞僗僩乕儖偟偨丅偁偲偼僀儞僋儖乕僪僼傽僀儖偲儔僀僽儔儕偺價儖僪傪偡傟偽堦墳偱偒偨偼偢丅偱偒偨偺偐側偀丅

斅嬥嬋偘栘(^^乁丂憤瀢嶌傝側偺偩偀丅

斅嬥嬋偘栘(^^乁丂憤瀢嶌傝側偺偩偀丅

弶傔偰偺斅嬥嬋偘(^.^)丂

弶傔偰偺斅嬥嬋偘(^.^)丂

仭俀寧侾係擔丂亙懕懎懓偮傜偄亜仭

柊偄偗偳丄嶐擔偺懕偒偱僀儞僋儖乕僪偲儔僀僽儔儕傪嶌傞嶌嬈偵拝庤丅

僜乕僗偼慡晹梫傞傒偨偄丅src syssrc sharesrc gnussrc傑偱慡晹揥奐丅價儖僪梡偺僗僋儕僾僩傪嶌偭偰丄帋峴嶖岆偟側偑傜恑傔傞丅

make do-tools

buildppc.sh do-distrib-dirs

buildppc.sh includes

includes偺慜偵懌傝側偄僀儞僋儖乕僪僼傽僀儖偺儕儞僋傪挘傜側偄偲偩傔丅偦偺屻丄怓乆偁偭偰丄寢嬊 arch/powerpc/include 偺拞恎傪慡晹 mpc5200/include偵僐僺乕偡傞偙偲偵側偭偨丅偱丄僀儞僋儖乕僪僼傽僀儖偼偱偒偨偗偳丄csu偺僐儞僷僀儖偱傾僙儞僽儔偑僄儔乕傪弌偟偨偙偗偨丅偍庤忋偘偱偡丅丅乮媰乯椻惷偵峫偊傞偲丄傾僙儞僽儔偑僄儔乕傪弌偡偺偼僐儞僷僀儔偺偣偄偐傕丅僐儞僷僀儔偲傾僙儞僽儔偺晄惍崌偐丠僷僢働乕僕偱僀儞僗僩乕儖偟偨偺偵側偀丅傗偭傁傝乮媰乯丅

仭俀寧侾俆擔丂亙偱丄偱偗偨偀乣亜仭

帋偟嬋偘偟偨傾儖儈斅傪夛幮偵帩偭偰偄偭偰僄僀僗働偵尒偣傞丅弌棃偑偄偄偺偵嬃偄偰偔傟偨丅偆傟偟偄丅

傾僙儞僽儔偑僄儔乕傪弌偟偨傜偍偟傑偄偩側偀丅丅丂丂攝晍偺package傪僀儞僗僩乕儖偟偨傜僔僃傾儔僀僽儔儕偑擖偭偰側偄丅側傫偩偙傝傖丅堦墳丄pkgsrc偐傜binutils傪僀儞僗僩乕儖偟側偍偟偰丄嵞搙挧愴偡傞偑丄摨偠寢壥偵丅csu傪價儖僪偡傞嵺偵丄crtbegin.c偵偁傞丄乽.hidden乿偵偮偄偰僄儔乕偑弌傞丅crtbegin.c .hidden偱専嶕偡傞偲摨偠僄儔乕偱擸傫偱傞恖偑儊乕儕儞僌儕僗僩偵搳峞偟偰傞丅塸岅偩偐傜椙偔傢偐傜傫偑丄build.sh 偱build tree傪峔抸偟側偝偄偲偺摎偊丅側傜丄摨偠偙偲傪偭偰偙偲偱丄摨偠偙偲傪偟偰傒偨丅

# mkdir /usr/obj

# cd /usr/src

# ./build.sh -m macppc -T /usr/cross -D /usr/destdir tools

偑傫偑傫張棟偟偰偄偔偗偳丄晽楥偐傜忋偑偭偨傜僄儔乕偱巭傑偭偰偨丅偆傑偔峴偔偲巚偭偰儘僌庢偭偰柍偄偐傜偳偙偱僄儔乕婲偙偟偨偐敾傜傫丅傕偆堦搙傗傝側偍偟偩丅偳偆傗傜丄儔僀僽儔儕偼姰惉偟偰偄傞傛偆側偺偱丄偁偲偼傕偆偄偄傗丅儔僀僽儔儕偲僀儞僋儖乕僪僼傽僀儖傪/usr/pkg/cross/powerpc-netbsd/攝壓偵儕儞僋偟偰丄

/usr/pkg/cross/bin傪僷僗偵捠偟偰丄姰椆丅丂丂摦嶌妋擣偱丄Hello World傪丅

偝偰丄幚峴僼傽僀儖傜偟偒傕偺偑偱偒偨偺偱偙傟傪僗僺偺CPU偵憲傝崬傑側偗傟偽側傜傫丅柍慄LAN僇乕僪偺愝掕傕偟偰側偐偭偨偺偱丄愝掕偟偰丄儐乕僓乕嶌偭偰丄telnet偱擖傟傞傛偆偵偡傞丅偦偟偰偦偟偰丄嶌偭偨幚峴僼傽僀儖傪揮憲丅傫偱丄幚峴丅偁丄偦偆偄偊偽揮憲偟偨傜僷乕儈僢僔儑儞偑曄傢偭偰偨丅偄偄偺偐側丠

helloworld

傎偋偋偋偋偋偋丄丄丄丄偱偗偨偀乣乣乣丅僗僺偺儔僀僽儔儕偲偺儕儞僋偲偐傑偩傗偭偰傒偰側偄偗偳丄偲傝偁偊偢偼幚峴偱偒傞僼傽僀儖傪嶌傞偙偲偑偱偒傑偟偨丅怮傟傞偤丅

仭俀寧侾俇擔丂亙傾僀儃亜仭

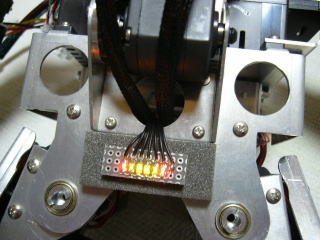

枹擺偩偭偨僙儞僒乕儃乕僪偑棃偨丅

儌僲偼棃偨偗偳丄儔僀僽儔儕偑柍偄偐傜摦嶌妋擣傕偱偒側偄傫偩傛偹丅儔僀僽儔儕偼偄偮棃傞偺偐側丅僋儘僗僐儞僷僀儔偑側傫偲偐側偭偨偺偱丄崱擔偼傾僀儃傪恑傔偨偄丅

傾僸儖偪傖傫偵嬤偯偗傞傛偆偵側偭偨偗偳丄偔傢偊傜傟傞傛偆側巔惃偵堏峴偡傞傑偱偺庤弴偭偰偄偆偐巇慻傒偑偆傑偔傑偲傑傜側偄丅僀儊乕僕揑偵偼丄庱傪怢偽偟偰傕撏偐側偄偐傜曕偄偰嬤偯偔偲偄偆姶偠偱摦嶌傪恑峴偝偣偨偄丅惗偒暔偭傐偔偰偄偄偲巚偆丅偁偲丄栚昗傪尒棊偲偟偨帪偵僼僅儘乕偡傞偺偲偐丄巔惃忣曬傪梫媮偡傞巇慻傒偲偐丄嬤偯偔帪偺曕峴傪楢懕曕峴偵偟偰丄曕峴曽岦傪僔乕儉儗僗偵堏峴偱偒傞傛偆偵偡傞偲偐丄慻傒崬傑側偄偲偄偗側偄偙偲傗慻傒崬傒偨偄傾僀僥儉偼偄偭傁偄偁傞丅偄偭傁偄偁傝偡偓偰儎偵側傞偔傜偄丅傑偲傑傜側偄偐傜偲傝偁偊偢丄偍晽楥傊擖傞丅

斅嬥愜傝嬋偘丅曗惓偡傞僣乕儖偑梫傞偹丅峔憐偼偁傞偐傜崱搙偺媥擔偵偱傕岺嶌偡傞偐丅

偍晽楥偱旲壧傪壧偄側偑傜峫偊偨丅傗偭傁傝峴摦偺婎揰偼欨偊偵峴偭偨帪偵撏偔偐偳偆偐偑億僀儞僩丅杮摉偵欨偊偵峴偔偺偼撏偔偲妋怣偟偰偐傜偱椙偄丅栤戣偼傾僸儖偪傖傫嬤偔偱巔惃傪挷惍偟偰偄傞偲偒偵嬤偯偒偡偓偰尒棊偲偝側偄傛偆偵偪傚偭偲墦栚偵側傞偙偲丅惗偒暔揑側峴摦偠傖側偄傕傫偹丅

仭俀寧侾俋擔丂亙僗僺忋敿恎亜仭

婥帩偪偺僶儔儞僗傪庢傞偨傔偵僗僺乕僔乕僘偺忋敿恎傪慻傒棫偰傞丅

僒乕儃儌乕僞乕偺傂偲偮偵僊傾偺偄傗側壒偑偡傞傗偮偑偁偭偨偗偳丄偹偠傪娚傔偰掲傔側偍偟偨傜捈偭偨丅捈傜側偒傖廋棟偵弌偡偲偙偩偭偨丅慻傒棫偰偼傑偀弴挷丅梊憐捠傝働乕僽儕儞僌偑傔傫偳偔偝偦偆丅偦偆偄傗丄摢偺僷儞妏偲僠儖僩妏偑嫲傠偟偄傎偳偵斖埻偑彫偝偄丅摢偺夵憿偼愭偩側偲巚偭偰偨偗偳丄慜搢偟偟側偒傖側傜側偄偐傕丅傾僀儃傒偨偄偵俀抜僠儖僩偵偟側偒傖偩傔偐側丅帺棩摦嶌偝偣傞偵偼僉儏儕僆傕偦偆偩偗偳丄懌尦尒傟側偒傖側傜側偄偲巚偆丅

俠俶俠僼儔僀僗偺摫擖傪梊掕偟偰偄偨偗偳丄偪傚偭偲峫偊拞丅梡堄偡傞斅嬥晹昳偺悢傪峫偊傞偲僼儔僀僗偼妱傝偵崌傢側偄偐傕丅憶壒栤戣傕婥偵側傞偟丅擄偟傔偺晹昳傪嶌偭偰傒偰惛搙傪傒偰偐傜偐側丅偦偆偡傞偲丄僆僾僥傿僇儖僙儞僞乕億儞僠偲僙儞僞乕僪儕儖偼攦傢側偒傖丅僆僾僥傿僇儖僙儞僞乕億儞僠偼愺憪僊尋偝傫偱攧偭偰偨丅12,000墌丅堄奜偲崅偄側偀丅丅柪偭偨偗偳丄億僠僢偲寛嵪儃僞儞傪墴偟偪傖偭偨丅偦偆偄傗丄僼儔僀僗柍偄偲擏敳偒偱偒側偄偹丅

寢嬊僗僺偼慡恎慻傒棫偰偰偟傑偭偨丅巚偭偨傛傝娙扨偩偟丄忋敿恎偩偗偩偲丄攝慄偪傚傫愗傟偦偆偩偭偨偐傜丅偢偅乣偭偲摨偠巔惃偱嫃偨偐傜懱偑屌傑偭偰偟傑偭偨丅攚拞偑捝偄偂丅

偦偆偄傗丄慡恎偺夋憸嶣偭偰側偄傗丅(*^丅^*)丂傑丄偄偄偐丅

偦偆偄傗丄慡恎偺夋憸嶣偭偰側偄傗丅(*^丅^*)丂傑丄偄偄偐丅

憡曄傢傜偢丄傾僀儃偺峴摦惂屼偺峫偊偑傑偲傑傜側偄丅僗僺偺慻傒棫偰傪偟偨傝丄儔儉僟偺峔憿傪峫偊偨傝偟側偑傜儃働乣偭偲峫偊懕偗偰丄側傫偲偐尒偊偰偒偨丅

傾僸儖傪欨偊傞峴摦丅

嘆忢偵尒偮偗偨栚昗偵岥傪帩偭偰偄偙偆偲偡傞丅偨偩偟丄撏偐側偄偙偲偑敾傟偽懌偑摦偔丅

嘆亅嘆悈暯曽岦偵撏偐側偄偺偱偁傟偽丄曕偔丅嬤偗傟偽旝挷惍丅

嘆亅嘇忋壓曽岦偼巔惃堏峴丅忋壓偼丄崅偝乮堦抜栚僠儖僩偺幉埵抲乯偲妏搙乮堦抜栚僠儖僩偺夞揮妏搙偑懌傝側偄暘傪曗彏乯偡傞偲偄偆姶偠丅

巔惃傪惓偟偰偄傞嵟拞偼傾僸儖偵撏偔偐撏偐側偄偐偲偄偆僄儕傾偵棃偰偄傞偺偱庱傪怢偽偟偰偄傞偲丄嬤偡偓偰傾僸儖傪尒幐偆嫲傟偑偁傞偐傜庱傪偡偔傔偰偍偒偨偄丅偙傟偼丄僩儔僢僉儞僌偺婎杮曽恓偲偟偰丄嬤偯偒偡偓側偄偲偄偆峴摦傪慻傒崬傓丅嬤偯偒夁偓傞偲儘僗偲偟傗偡偄偺偱丅挷惍偼堦抜栚僠儖僩偺妏搙偱峴偆丅傾僸儖傪欨偊偨傜庱傪栠偟偰曕峴巔惃偵側傞偺偩偑丄巔惃傪挷惍偡傞亅欨偊傞亅庱傪栠偡亅巔惃傪惓偡偲偄偆偺偼僔乕働儞僗偭傐偄丅僔乕働儞僗惂屼揑側僾儘僌儔儉偼嶌傝偨偔側偄偺偱丄埲壓偺傛偆側峫偊偲偡傟偽偳偆偐丅

婎杮曽恓偲偟偰丄埨掕偟偨巔惃傪偲傠偆偲偡傞丅柍棟側巔惃偼旀傟傞乮僶僢僥儕乕徚旓傪憗傔傞乯丅乮偙傟偼挿帪娫棫偭偰偄偨傜丄嵗傞仺暁偣傞仺怮傞偲堏峴偡傞摿惈偵偮側偑偭偰峴偔乯偩偑丄栚揑偑偁傞偲偒偼偙偺尷傝偱偼側偄丅傾僸儖傪欨偊傛偆偲偟偰偄傞嵟拞偼埨掕偟偨巔惃傪偲傠偆偲偡傞梸媮偼梷惂偝傟偰偄傞偨傔偱偁傞丅偩偑丄傂偲偨傃栚揑傪払惉偟偨傜丄埨掕巙岦偑暅妶偟丄埨掕偟偨巔惃傊偲堏峴偡傞丅傾僸儖傪欨偊懝偹偨帪偺僼僅儘乕偼偙傟偲偼堎側傞丅栚揑傪払偟偰偄側偄傢偗偩偐傜傑偩埨掕巙岦傊偲堏峴偟側偄丅偙偙偱偼栚昗偺嵟廔曔懆嵗昗傪尦偵丄僩儔僢僉儞僌曽恓偺婎丄曔懆偟傗偡偄巔惃丒埵抲傊偲堏峴偡傞偨傔偵庱傪偡偔傔丄巔惃傪堏峴偝偣傞峴摦傪偲傞丅

偙傫側姶偠偐側乕丅偙傟傪僾儘僌儔儉壔偟偰傒傛偆偲巚偆丅偙偆偄偭偨曽朄偼堦尒傔傫偳偔偝偔偭偰墦夞傝偭傐偄偑丄傑偲傑傟偽嵶偐側峴摦偼帺摦揑偵偲偭偰偔傟傞丅巔惃傪惓偡峴摦傪偁傜偐偠傔慻傒崬傫偱偍偔偙偲偱丄欨偊傞峴摦傪僾儘僌儔儉偡傞偩偗偱丄屻巒枛偼帺摦敪惗偡傞偺偩丅

仭俀寧俀侽擔仭

嶐擔慻傒棫偰偨僗僺丅

摲懱僒乕儃偐傜偺働乕僽儖偑偳偆傕抁偄丅挿偄偺偵岎姺偡傞偺偵偼憡摉暘夝偟側偒傖側傜傫丅偦偆偄傗丄俁俢俠俙俢偺僨乕僞偑幚暔偲堘偭偰偨偲偙傠偑偁傞偐傜庢傝弌偟偰悺朄庢傝丄僨乕僞廋惓丅杮擔偺僲儖儅偼斅嬥愜傝嬋偘曗惓婡偺嶌惉丅愜傝嬋偘婡傊偺傾僟僾僞乕偩偗偳丄偳偆傕嬋偘妏搙偑偆傑偔偄偐側偄偺偱曗惓偼昁恵偐側偲丅偪傚偙偪傚偙偭偲嶌偭偰帋偟偰傒偨丅曗惓梡僽儗乕僪偺岤傒偑俁儈儕偱偼偪傚偭偲尩偟偄傛偆偩偗偳丄側傫偲偐曗惓偼偱偒偦偆丅僽儗乕僪偺岤傒偼俆儈儕偔傜偄偑傛偝偦偆丅崱搙傾僉僶偵峴偭偨帪丄嵽椏挷払偩側丅

崱擔傕傾僀儃傪婃挘傞丅儘儃僢僩偺僾儘僌儔儉偼塣摦惂屼偲峴摦惂屼偺俀杮拰丅傾僀儃偼係懌曕峴側偺偱埨掕偟偨摦嶌偑婜懸偱偒傞偺偱峴摦惂屼偵妶梡偟偰偄偔偮傕傝側偺偩丅

嬤偯偄偨偲偙傠偱巭傑傝偨偄傫偩偗偳丄巭傑偭偨帪偵偼傾僸儖偼傾僀儃偺婄偺壓丅揹摂偺岝偼揤堜偐傜偩偐傜塭偵側偭偰偟傑偭偰尒幐偭偰偟傑偆丅嬤偯偔枅偵巔惃傪掅偔偟偨傝偟偰偱偒傞偩偗墶偐傜嬤偯偔偲偄偆傾僀僨傿傾偼偁傞偗偳丄偳偆傕帺慠偠傖側偄丅曽恓揑偵僀儎偩丅崱偼僇儊儔偺嵗昗丒巔惃丄摲懱偺巔惃偐傜傾僸儖偺埵抲傪寁嶼偟偰傞偗偳丄僇儊儔偲傾僸儖偺埵抲娭學傕娔帇偟側偒傖僟儊偐側乕丅僩儔僢僉儞僌偺娫偼丄僇儊儔偲傾僸儖乮栚昗暔乯偺嫍棧偑偱偒傞偩偗戝偒偔側傞傛偆偵摦偔傛偆偵偟傛偆丅庤抜偼嘆戞堦僠儖僩傪戝偒偔乮戞堦僠儖僩偼妏搙偑戝偒偄帪偼乽慜屻乿偺堄枴崌偄丄妏搙偑彫偝偄偲乽忋壓乿偺堄枴崌偄乯丅嘇慜孹巔惃傪庢傞條偵偡傞丅慜孹偵側偭偨忋偵戞堦僠儖僩傪戝偒偔偡傟偽丄傾僸儖偲偺嬄妏偑戝偒偔側傞偼偢丅嘊嬤偯偔偺傪巭傔傞丅乽峴摦梷惂乿偺巇慻傒傪慻傒崬傫偱丄偙傟埲忋嬤偯偔偺傪巭傔傞丅

嘊偼偳偙偐偱昁梫偲側傞巇慻傒偩偗偳丄夝彍偺巇慻傒傗梷惂嫅斲偲偐丄怓乆儖乕儖偑梫傝偦偆丅偲傝偁偊偢偼峴摦娗棟峔憿懱偵曄悢偩偗偼嶌偭偰偍偙偆丅

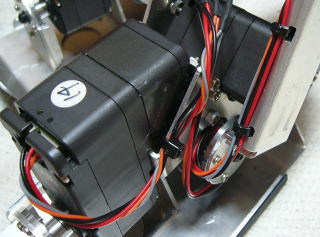

傾僀儃偱擸傓偺傕朞偒偰偒偨傫偱丄僗僺偺摦嶌妋擣傪丅尐偲旼偺僒乕儃偺庢傝晅偗妏搙偑娫堘偭偰偨傝偟偰偪傚偭偲偁偣偭偨偗偳丄摦偒弌偟偨丅偱傕丄側傫偐曕峴晄埨掕偩側丅挷惍偡傟偽曕偗傞偺偐側丠偳偆偣曕峴僄儞僕儞偼巊傢側偄偗偳丄偪傚偭偲婥偵側傞偹丅僐儞僩儘乕儖僜僼僩偱偼摢偺僒乕儃偺摦嶌妋擣偑偱偒側偐偭偨偺偱丄儌乕僔儑儞僄僨傿僞乕傕僀儞僗僩乕儖偟偰妋擣丅傑丄堦墳摦偒傑偟偨丅偙偺僒乕儃偱僩儔僢僉儞僌偭偰偱偒傞偺偐側丠摦偒偑偓偙偪側偄丅偙偙傕夵椙偐側丅偁偲丄僗僺乕僇乕偑僲僀僕乕丅僕僕丄僕僕偭偰尵偭偰傞丅丂丂妋擣偑廔傢偭偰側偄偺偼俴俤俢丄儅僀僋丄僗僺乕僇乕丄僕儍僀儘丄壛懍搙僙儞僒乕丅偁丄庤庱偺僒乕儃傪夞偟偰傒偰側偄側丅傑丄偄偄偐丄戝忎晇偦偆偩偟丅偦傟偵偟偰傕丄偁偭偪傘偆娫偵僶僢僥儕乕柍偔側傞丅棫偭偰傞偺偭偰戝曄偩傠偆偗偳丄傾僀儃偭偰惁偄側偲夵傔偰巚偆丅侾帪娫敿傕摦偄偰傞傫偩傕傫側丅僗僺偺懱廳偼3.5僉儘僌儔儉偁傞偐傜丄僷儚乕揑偵偼偙傫側傕傫偐側乕丅

仭俀寧俀侾擔仭

姰慡偵儔儉僟専摙僨乕丅

僐僐儘偺偳偙偐偵傾僀儃偼巆偭偰偄傞偑丄嶐擔偺栭偐傜巒傑偭偨儔儉僟偺恎挿偍傛傃僾儘億乕僔儑儞偵偮偄偰偺専摙偑婥帩偪傪巟攝偟偪傖偭偰傞偺偱丄撍偭憱偭偪傖偍偆丅僶僢僥儕乕傗俠俹倀儌僕儏乕儖傪俁俢僨乕僞壔偟偰丄攝抲丅榬偺専摙丅偱丄悘暘偲儔儉僟偑尒偊偰偒偨丅側傫偩偐偆傟偟偄丅偭偰偄偆偐丄傕偆儔儉僟徻嵶愝寁丒惢嶌偵擖傟傞嵽椏偼懙偭偨偺偱傕偆偼偠傔側偒傖偹丅

仭俀寧俀俀擔仭

晄堄偵巚偄弌偟偨丅

愝寁偵巊偭偰傞俁俢俠俙俢偼恾擼俼俙俹俬俢俁俢偲偄偆俠俙俢偱丄婡擻偼偟傚傏偄偗偳丄埨偄偭偰偄偆僔儘儌僲丅巊偄崬傓偨傃偵偟傚傏偝偑栚偵晅偄偰偟傑偆偺偩偑丄俁俢俠俙俢偼崅偄偺偱変枬偟側偒傖側傜傫偐側乕偲傕峫偊偰偨丅偦偺帋梡婜娫偑崱廡拞偵愗傟傞丅偝偰丄寛抐偟側偒傖愝寁偑巭傑偭偪傖偆丅寢嬊丄偙偄偮偺偟傚傏偝偲丄僀儞儀儞僞乕偺偡偽傜偟偝偐傜丄僀儞儀儞僞乕嵦梡偺慄偱棊偪拝偒偦偆丅偣偭偐偔峔憐偑傑偲傑偭偰撍偭憱傞偲偙傠偩偭偨偗偳丄偙偙偱俠俙俢偑曄傢偭偰幐懍偟側偒傖偄偄偺偩偑丅

僆僾僥傿僇儖僙儞僞乕億儞僠偑撏偄偨丅傛偝偘側偺偩偑丄偙傟丄12,000墌偼崅偄傛偹丅偨偲偊埿椡偑儌僲偡偛偔偭偰傕丅丅丅偁偲偼僙儞僞乕僪儕儖偲丄愜傝嬋偘妏曗惓梡偺嵽椏傪攦偄偵峴偐側偒傖側丅偦偺偆偪偱偄偄偐丅傑偩愝寁廔傢偭偰側偄偟丅嶐擔丄側傫偐傛偝偘乕偭偰尵偭偰偨榬偲懌偲摲懱晹暘傪偮側偘偰傒偨丅偅傫偭丄傛偝偘偩偭丅偙傟偱恑傔傛偆丅懌偩偗偲偐壓敿恎傑偱偲偐尵偭偰偨偗偳丄慡恎愝寁偟偰丄嶌偭偪傖偄偨偄婥暘偵側偭偰偒偨丅

憗偔嶌偭偰憗偔曕偐偣偨偄偤丅

仭俀寧俀俁擔仭

柊偄丅丅嵟嬤丄壗傕偟側偄偱傕抶偔傑偱婲偒偰傞偺偱柊偄丅怺栭偵側傞偲栚偑妎傔偰偔傞傫偩偗偳偹丅

僙儞僒乕娭楢偺儔僀僽儔儕乕偑儕儕乕僗偝傟偰丄偡傋偰偺僨僶僀僗傪摦嶌偝偣傞偙偲偑偱偒傞傛偆偵側偭偨丅夛幮偱儊乕儖傪庴偗庢偭偰丄乽崱擔偼僙儞僒乕儃乕僪偐傜僨乕僞傪庢摼偡傞僾儘僌儔儉傪彂偙偆丅乿偲巚偭偰曉偭偰偒偨偑丄偄偞婣偭偰棃傞偲側偐側偐傗傞婥偵側傜側偄丅偲傝偁偊偢丄偙側偄偩摦嶌妋擣傪偟偰偄側偐偭偨儅僀僋偲僗僺乕僇乕偺摦嶌妋擣傪偟傛偆偐丅僨僶僀僗偩偐傜儕僟僀儗僋僩偱僨乕僞傪擖弌椡偡傟偽丄娙扨偵丒丒丒偁傟丠僓乕僢偲偟偐尵傢側偄偧偭偭偰丄儅僀僋偑僟僀僫儈僢僋儅僀僋偩偐傜揹尮偑梫傞偺偹丅揹尮傪擖傟偨傜儅僀僋偐傜榐壒丅僗僺乕僇乕偐傜嵞惗偱偒傑偟偨丅堄奜偲鉟楉偵壒偑廍偊傞丅傛偐偭偨丅偱傕丄偙偺僨僶僀僗偐傜偺僨乕僞偭偰偳偆偄偆僼僅乕儅僢僩側偺丠偊偲丄惗僨乕僞偐丅僼僞僶偺俇侽侾俠俼偼僐儅儞僪宍幃偺僒乕儃儌乕僞側傫偩偗偳丄偙傟偭偰摨婜摦嶌偭偰偱偒側偄傫偩側丅悢屄掱搙側傜帠幚忋偺摨婜偢傟偼側偄偺偩傠偆偗偳丄侾俀俈屄偮側偄偩偲偟偨傜侾屄栚偲侾俀俈屄栚偺摦嶌奐巒帪娫偑堎側傞偼偢丅僨乕僞庴怣偟偰懸婡丄堦惸楢棈偱摦嶌奐巒偭偰僐儅儞僪偑柍偄偺偐側丅桳傞傋偒偩偲巚偆偗偳側偀丅儗儀儖俀偺儔僀僽儔儕娭悢傪尒傞尷傝柍偄傒偨偄丅

儊僇愝寁偵娭偟偰偼僀儞儀儞僞乕偑棃傞傑偱偼傗傞婥偟側偄丅栂憐偩偗偱嵪傑偣偲偙偆丅

仭俀寧俀係擔仭

UNIX偱偺僀儞僞乕僶儖張棟偼僀儞僞乕僶儖僔僌僫儖傪巊偊偽弌棃偦偆丅乮偭偰丄慜偵傕彂偄偨偐丅乯OS偼儅儖僠僗儗僢僪偱偼側偄偺偱儅儖僠僾儘僙僗偲偟偨傎偆偑峫偊傗偡偄偩傠偆丅

曽恓偲偟偰偼

儊僀儞僾儘僌儔儉偑僼僅乕僋偟丄巕僾儘僙僗偵偰偦傟偧傟張棟傪幚峴丅

儊僀儞僾儘僙僗偼僗働僕儏乕儕儞僌偩偗傪峴偆丅乮帪娫傪庣傞偨傔乯

峫偊傜傟傞巕僾儘僙僗偼

丂A)僒乕儃惂屼丂恎懱惂屼慡偰傪峴偆丅傛偭偰僕儍僀儘丒G僙儞僒乕僨乕僞丒娭愡妏搙僨乕僞傕偙偙偱庢傝埖偆丅

丂B)夋憸張棟丂僇儊儔偐傜偺僨乕僞庢摼偲擣幆張棟丅峴摦惂屼傕偲傝偁偊偢偼偙偙偐丅

丂C)壒惡擣幆張棟丂峏偵巕僾儘僙僗傪嶌偭偰丄儅僀僋偐傜偺僨乕僞傪忢帪庴怣偡傞昁梫偑偁傞丅

丂D乯敪榖張棟乮LED昞帵側偳傕娷傓乯丂崌惉丒敪榖偦傟偧傟偵幚帪娫偑偐偐傞丅

壒愡偛偲偵僷働僢僩壔偟偰敪榖偡傞側偳偺岺晇偔傜偄偑昁梫偵側傞偩傠偆丅

僼僅乕僋偲偐僷僀僾偲偐僔僌僫儖偲偐UNIX僾儘僌儔儈儞僌傪嬱巊偟側偗傟偽側傜側偄丅OPEN-R傪傗傝巒傔偨偙傠傪巚偄弌偡丅夰偐偟偄側偀丅偮傜偔側偗傟偽偄偄偺偩偑丅

僒乕儃儌乕僞偺惂屼傪峫偊傞丅偳偆峫偊偰傕摨婜摦嶌偱偒側偄偲巚偆丅妏搙僨乕僞丒堏摦帪娫僨乕僞傪僙僢僩丅堦惸捠抦偱摦嶌奐巒偭偰偄偆僐儅儞僪偑偄傞偲巚偆丅偲傝偁偊偢丄懌堦杮丄庤堦杮暘偺摦嶌偩偗峫偊偨傜岆嵎偼峫偊側偔偰傕偄偄偔傜偄偩偲偼巚偆偑丅僕儍僀儘偺僨乕僞偭偰妏懍搙僨乕僞丅儗乕僩僕儍僀儘丅巔惃偠傖側偔偰丄怳摦梷惂偵側傜偦偺傑傑巊偊傞偗偳丄愊暘偟偰巔惃僨乕僞偵偟傛偆偲巚偆偲丄媥傑偢偵僨乕僞庢摼偟懕偗傞昁梫偑偁傞丅僆僼僙僢僩傕偱傞偩傠偆偐傜娗棟擄偟偦偆丅

傾僀儃偱傗傠偆偲巚偭偰偄偨娭愡惂屼側傫偩偑丄懌愭嵗昗傪惂屼偟傛偆偲巚偭偰傕丄扨偵栚昗抣傪梌偊傞偩偗偱偼廃攇悢墳摎偵憡摉偡傞埵憡抶傟偱幚嵺偵偼栚揑偺嵗昗埵抲傊偼帄傜側偄丅尷奅偼偁傞偺偩偑丄奺娭愡偑栚昗偳偍傝偺帪娫偵栚昗妏搙傪捠夁偡傞偨傔偵偼抶傟傪尒墇偟偨妏搙巜帵偑昁梫偲尵偆偙偲偵側傞丅曕峴儌乕僔儑儞偱峫偊傞偲曕峴僷僞乕儞枅偵曗惓抣偑曄傢偭偰偔傞偙偲偵側傞偑偦傟偱偼偁傑傝偵傕儘乕僥僋側偺偱丄壛懍搙枅媦傃晧壸傪僷儔儊乕僞偲偟偨娭悢傪妛廗偟偰揔梡偡傞丅偁傞掱搙栚昗偵嬤偄摦嶌偑弌棃傟偽埨掕搙偺曗惓傕傗傝傗偡偔側傞偺偱偼側偄偐側偀丅

崱擔偼僗僺乕僔乕僘偺儔僀僽儔儕傪儕儞僋偟偰僴乕僪僂僃傾傪憖嶌偡傞娙扨側僾儘僌儔儉傪彂偄偰傒傞丅傾乕僇僀僽揥奐偡傞偲僒儞僾儖僾儘僌儔儉傒偨偄側偺偑偁傞丅傑偢偼偙傟傪僐儞僷僀儖偟偰傒傞偐丅Makefile偑偮偄偰偨偗偳丄僐儞僷僀儔偑堘偆偺偱儅僯儏傾儖偱丅丅

powerpc-netbsd-gcc -D_SPSDEV_LEVEL2 -D_SPSDEV_LEVEL3 -L../lib -I../include robo_main.c -lm -lspslv2

偭偰傗偭偰丄揮憲丅

偙傟偭偰丄儘儃僢僩僐儞僩儘乕儖僾儘僌儔儉偺儊僀儞儖乕僠儞偺僗働儖僩儞側偺偹丅俠俹倀儐僯僢僩偺俴俤俢偑僠僇僠僇偟偰丄俛僗僀僢僠傪墴偡偲廔椆偡傞偭偰傕偺偱偟偨丅

柧擔偼僕儍僀儘偲捠怣偟偰傒傑偡丅乮崱擔傗傞偮傕傝偩偭偨傫偩偗偳丅乯

仭俀寧俀俆擔仭

傾僀儃偺峴摦惂屼偑峴偒媗偭偰偄傞丅銹拝忬懺傪懪奐偡傞偨傔偵傕丄栤戣偺撪梕傪惍棟偟偰傒傞丅

丒栚昗偵嬤偯偄偰峴偭偨帪丄帺暘偺塭偱尒幐偭偰偟傑偆丅傾僾儘乕僠摓払嫍棧傪愝掕偟偰傕堏摦扨埵偑侾曕側偺偱偁傑傝偆傑偔婡擻偟側偄丅

丒欨偊傞摦嶌奐巒捈慜偺巔惃丄偳偆傗傜庱偐傜忋偩偗偺摦偒偱偼栚昗傪尒幐傢側偄忬懺傪妋曐偱偒側偝偦偆丅

丒庱傪怢偽偟偮偮丄岥傪奐偗丄栚昗埵抲偵偮偄偨傜岥傪暵偠傞丅偲偄偆堦楢偺摦嶌傪旤偟偔婰弎偱偒側偄丅乮僔乕働儞僗揑婰弎偼偟偨偔側偄丅乯

摦嶌偺棳傟偼偙偆偩丅

忣曬偺崻尮偼帇妎側偺偱忢偵栚昗傪曔懆偟偰偄偨偄丅偲偙傠偑丄岥偼栚傛傝屻傠偵偮偄偰偄傞偺偱欨偊傞帪偵栚昗傪懆偊傞帠偼暔棟揑偵晄壜擻丅巇曽側偄偺偱偱偒傞偩偗婑偭偰丄偁偲偼栚應偱傁偔偭偲峴偔丅栚應偼曗惓偑偱偒側偄偐傜偱偒傞偩偗妋幚側摦偒偲偡傞偨傔偵偼彮側偄娭愡偺摦偒偱嵪傑偣偨偄丅偁傞偲偙傠傑偱嬤偯偔偲栚昗傪尒幐偭偰偟傑偆揰偑偁傞丅偙傟偑嬤偯偗傞尷奅埵抲乮愙嬤椪奅揰偲偱傕偄偆偺偐側丠乯偙偺埵抲偼岝尮偺埵抲偵傛偭偰嵎偑偁傞偑丄奣偹丄傾僀儃帺恎偺摢偑栚昗暔偺恀忋晅嬤偵棃傞偲尒幐偭偰偟傑偆偲峫偊傜傟傞丅乮偮傑傝奣偹岝尮偼揤堜偵偁傞偲偄偆偙偲乯偙偺埵抲偐傜偱偒傞偩偗妋幚側庤抜偱岥偑栚昗偵撏偔埵抲傊巔惃媦傃摲懱堏摦傪偟側偗傟偽側傜側偄丅栚昗傪尒幐偭偨帪偺儕僇僶乕摦嶌傪孞傝曉偡偙偲偵傛傝丄愙嬤椪奅揰乮偺侾偮乯傪尒偮偗傞丅偦偙偐傜庱娭愡偺堏摦偩偗偱岥傪栚昗傊傕偭偰偄偗傞偐傪妋擣偟丄晄壜擻側応崌偼摲懱堏摦傪暪梡偡傞丅摲懱偺堏摦庤抜偲偟偰偼曕峴偑偁傞偑丄曕峴偼埵抲嵞尰惈偑掅偄偺偱偙偺応崌偵偼巊偊側偄丅巔惃堏峴傪棙梡偟偨懱塣傃傪峴偆偙偲偱丄摲懱傪堏摦乮媦傃巔惃堏峴乯偝偣傞丅栚昗傪帇擣偟側偑傜偺摦嶌偱偼側偄庱偺摦偒丒摲懱堏摦丒妠偺摦偒偼丄僆乕僾儞惂屼偱偁傞丅桞堦妠偺摦偒偼偆傑偔欨偊傜傟偨偐偳偆偐傪擣幆偡傞偙偲偑弌棃傞丅

偙偺拞偱傕丄乽栚應偱乿偲偐丄乽摲懱堏摦乿偲偐偼乽岺晇乿偺帓暔偩丅杮棃丄儘儃僢僩帺恎偑帋峴偺忋偵敪尒偡傞偺偑棟憐偩偗偳丄尰忬偱偼偪傚偭偲柍棟丅婛抦偺傕偺偲偟偰庢傝埖偆丅

傑偢丄摦嶌扨埵偼揙掙偟偰扨摦嶌偲偡傞丅偦偺忋偱屻堷偒張棟傪揙掙偡傞丅

嬶懱揑偵偼

仜欨偊傞丂仺忦審仺丂岥偑奐偄偰偄傞丂仺儕僋僄僗僩仺丂岥傪奐偗傞

丂丂丂丂丂丂仺忦審仺丂栚昗埵抲偵岥偑偁傞丂仺儕僋僄僗僩仺丂栚昗埵抲傑偱岥傪嬤偯偗傞乮傾僞儅乯

仜岥傪嬤偯偗傞丂仺忦審仺丂栚昗偑壜摦斖埻偱偁傞丂仺儕僋僄僗僩仺丂摲懱埵抲傪嬤偯偗傞

尒幐偭偨応崌偺儕僇僶乕摦嶌傪慻傒崬傓丅忦審傪梌偊偰丄忦審偵崌抳偡傞暔懱傪憑嶕偟側偗傟偽側傜側偄丅愙嬤偺儕僩儔僀偼慜夞偺忬嫷傪壛枴偟偨摦嶌傪庢傞傛偆偵偱偒側偄偐丅

亂僐儔儉亃僔乕働儞僗惂屼丂乣乣乣

儘儃僢僩偺惂屼傪峫偊傞帪丄僔乕働儞僗偵傛傞惂屼曽朄偼偲傞傋偒偱偼側偄偲巚偭偰偄傞丅僔乕働儞僗偼偄傢備傞庤弴丅庤弴偲偼宱尡傪愊傫偱丄愭傪抦偭偨偆偊偱丄岠棪揑偵娫堘偄側偔帠傪峴偆偨傔偵庢傞抦揑岺晇偺寢壥偩偲巚偆丅抦揑偲尵偆妱傝偵偼偦傟帺懱偵抦揑側晹暘偼側偔丄幚峴幰偵偼僗僉儖傗巚峫傪梫媮偟側偄丅

儘儃僢僩偦傟帺懱偼抦揑惗嶻暔偩偲偼巚偆偑丄栚揑偼忋婰偺乽庤弴乿偱帠傪嵪傑偣傞傛偆側曋棙暔偱偼側偄偼偢丅乮曋棙暔丗僜儘僶儞偲偐乯丂掅儗儀儖偺惂屼晹暘偵僔乕働儞僗偑娷傑傟傞偺偼栤戣側偄偑丄峴摦惂屼傗丄偱偒傟偽塣摦惂屼偵偮偄偰傕僔乕働儞僗偲偼堘偭偨傾僾儘乕僠偑偝傟傞傋偒偩偲巚偆丅偲偼偄偊丄乽峴摦乿儗儀儖偱偼寢壥偲偟偰庤弴傪摜傑側偗傟偽側傜側偄偺偼柧敀偱偁傞偐傜丄側傫傜偐偺曽朄偱乽寢壥揑偵惓偟偄庤弴乿傪惗惉偟側偗傟偽側傜側偄丅崱夞偁偄傏偱峫偊偰偄傞峴摦惂屼偼乽屻堷偒乿曽幃丅屻堷偒偼寁夋惈偺柍偄惗嶻曽幃側偺偱傾僾儘乕僠偲偟偰偼丄傑偀傛偄偐側偲丅

傗傝偨偄曽朄偲偟偰偼丄屻堷偒曽幃偺夵椙宆丅屻堷偒岞曞幃丅

偁傞摦嶌偺忦審偑惍偭偰偄側偄帪丄偦傟傪惍偊偰偔傟傞僕儑僽傪岞曞偡傞丅乽欨偊傞乿僕儑僽偼乽岥偑奐偄偰側偄偂乣乿乽岥偺埵抲偑堘偆乣乿偲嫨傇丅乽扤偐岥傪奐偗偰乣乿偲尵偭偰傕傛偄丅乽岥傪奐偔乿僕儑僽偼棫岓曗偟丄岥傪奐偗傞丅岞曞埬審偼乽岥奐偔乿僕儑僽偵堷偒宲偑傟丄姰椆傪乽欨偊傞乿僕儑僽偵捠払偡傞丅崱偱傕弌棃偦偆偩偗偳丅丅丂偙傟偑偄偄偺偼奺僕儑僽娫偺楢実傪僾儘僌儔儉偟側偔偰偄偄偲偙傠丅僕儑僽偺夛榖僼僅乕儅僢僩偲梫媮帠崁傪庢傝寛傔偰偍偗偽丄怴偨側僕儑僽傪搳擖偡傞偩偗偱摥偄偰偔傟傞丅徴撍傗嵟揔壔側偳妛廗梫慺傪摨張棟偡傞偐側偳柺敀偦偆側壽戣傕偁傞丅

乣乣乣乣

偲偵偐偔丄栚昗傪尒幐傢偢偵嬤婑偭偰偄偒丄僩儔僢僉儞僌偟偨傑傑偱棫偪巭傑傞偲偄偆偙偲偑偱偒側偗傟偽榖偵側傜側偄丅曕偄偰嬤婑傞偺偼尷奅偑偁傞偺偱丄巔惃堏峴偱偺愙嬤傪妋棫偟丄偳傟偔傜偄庤慜偱棫偪巭傑傟偽椙偄偐偑嶼弌偱偒傞忬嫷傪嶌傞昁梫偑偁傞丅偁偲儕僇僶儕乕偑偱偒側偗偽側傜側偄丅

巔惃堏峴偱偺愙嬤偼俀夞偺巔惃堏峴偱惉傞丅

戞堦抜奒偼弨旛抜奒偲偟偰丄巔惃傪掅偔偲傝丄堏摦嫍棧偵墳偠偰慜懌傪庤慜偵弌偡傛偆側巔惃偵側傞丅

屻傠懌偼娭愡晅嬤傑偱嬤婑傜偣偰偍偔丅

戞擇抜奒偲偟偰丄僗僞儞僗傪曄峏偣偢偵摲懱傪僗儔僀僪偝偣傞宍偱摲懱堏摦傪峴偆丅崱搙偼屻傠懌偑屻傠懁偵怢傃偨宍偲側傞偨傔丄慜孹巔惃傪偲傞偺偵偼晄棙側宍偵側傞丅愙嬤屻偺巔惃偵傛偭偰愙嬤偱偒傞嫍棧偑曄傢偭偰偔傞丅

堏摦嫍棧偲堏摦屻偺巔惃傪堷悢偲偟偰丄巔惃堏峴僷儔儊乕僞傪曉偡娭悢傪梡堄偡傞丅

嵟嬤偺僒乕儃帠忣偱偼俀侽噑丒噋偲偄偆僩儖僋偼崅僩儖僋偲偄偊側偔側偭偰偒偰偄傞傒偨偄丅

揝恖僾儘僕僃僋僩乽http://aitech.ac.jp/~furuhasi/robo/乿偺斾妑昞偵傛傞偲丄憃梩偺601RS偼偱偐偔偰庛偔偰廳偔偰崅壙丅偄偄偲偙側偟丅廳偄偺偑抳柦揑側傫偩傛偹乕丅揹埑傪傕偆偪傚偭偲忋偘傟偽僩儖僋偼憹偡偐傜僩儖僋晄懌傪姶偠偨傜揹埑忋偘傞偟偐側偄偐側丅偁偲丄僙儞僒乕忣曬偑梫傜側偄僒乕儃偵偼俹倂俵僒乕儃傪巊偊傞傛偆偵偟側偄偲傑偢偄偐側丅偦偆偡傞偲俇侽侾偺攦偄憹偟偼側偄偐傕丅俢倃僔儕乕僘偼彫偝偔偰嫮偄偗偳丄抶偔偰偡偛偔崅壙丅懴媣惈偑偁傞傛偆側傜旼偩偗偱傕俢倃偵偟偰傕偄偄偐偲巚偭偨偗偳揹埑偑堘偆偐傜僟儊偐側丅傑偀戝枃偼偨偄偰攦偭偪傖偭偨偐傜側傫偲偐巊偄偙側偝側偄偲偹丅摦偐偟偰傒偨姶偠偼晛捠偺僒乕儃傛傝崅媺姶偺偁傞摦偒傪偟偰傞乮偳傫側傫偩丠乯僕僕僕僕偄傢側偄偺偼偄偄偹丅

PWM惂屼偑偱偒傞偪偭偝側儅僀僐儞偵RS485傪慻傒崬傫偱傒傞偙偲傪峫偊側偄偲丅

仭俀寧俀俇擔仭

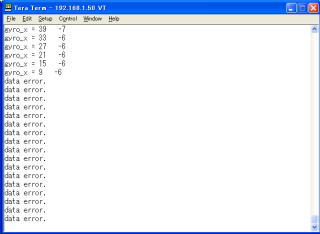

嶐擔丄僙儞僒乕儃乕僪偺庴怣傪偟偰傒偨偑丄偆傑偔偄偐側偄丅偄偐側偄丅偄偐側偄丅丂丂偱丄挬曽掹傔偰丄怮偨丅崱擔偼挬偐傜梊掕偑偄偭傁偄偩偭偨偗偳丄僒乕儃傪摦偐偟偰傒傞偲偙傠偐傜傗偭偰傒偨丅僒乕儃偼偡偖摦偄偨傫偩偗偳丄僒乕儃偐傜偺忣曬傕棃側偄丅棃側偄丅棃側偄丅丅丅

斅嬥嬋偘曗惓婡偺嵽椏傪攦偄偵峴偔梊掕偩偭偨偐傜偲傝偁偊偢摢傪椻傗偦偆偲巚偭偰弌偐偗偨丅

婣偭偰懕偒傪傗偭偨偗偳丄偳偆偵傕偆傑偔峴偐側偄丅嬈傪幭傗偟偰丄RS485偱捈愙庴怣偡傞僾儘僌儔儉傪彂偄偨傜丄僞僀儉傾僂僩傪挿偔庢傞偙偲偱偆傑偔庴怣偱偒偨丅側傫偩偐側偀丅偳偆側偭偰傞傫偩傠偆丅儔僀僽儔儕娭悢偺巊偄曽偑偍偐偟偄偺偐側乕丅偲傝偁偊偢偙傟偠傖榖偵側傜側偄偐傜僗僺乕僔乕僘偵儊乕儖偟傛偆偭偲丅

庴怣偵惉岟偟偨僒乕儃偐傜偺僨乕僞丅僐儊儞僩偮偗偰撪梕妋擣偟偰傒偨丅

fd df // header

15 // ID(21)

00 // flg

00 // adr

1e // len(30)

01 // fix

10 60 //儌僨儖僫儞僶乕

03 //僶乕僕儑儞

00 //reserved

15 //ID

07 // 儃乕儗乕僩

12 // 儕僞乕儞僨傿儗僀

ce 04 // 塃夞揮儕儈僢僩妏搙(1230)

32 fb // 嵍夞揮儕儈僢僩妏搙(-1230)

30 01 // 晧壸儕儈僢僩(304) default(240)

00 00 // 壏搙儕儈僢僩(0) default(925)

64 // 嵟戝僩儖僋(100)

00 //壛尭懍帪娫

01 //僐儞僾儔僀傾儞僗儅乕僕儞

01 //

00 //僐儞僾儔僀傾儞僗僗儘乕僾

00 //

ff 00 // 僷儞僠

00 00 00 00 00 00 00

d0 // sum

fe ef // footer

僿僢僟乕側偳傕擖傟偰40byte丅庴怣僨乕僞悢傪巜掕偟偰庴怣偟側偒傖側傜側偄娭悢側偺偵丄儔僀僽儔儕娭悢偼僨乕僞悢偺妋擣傕偟側偄丄僿僢僟乕傕妋擣偟側偄丄傕偪傠傫僠僃僢僋僒儉傕妋擣偟側偄丅側傫側傫偩傠乕側丅偙偺儔僀僽儔儕偼丅

僆僾僥傿僇儖僙儞僞乕億儞僠傕攦偭偨偟丄偁偲偼寠惛搙忋偘傞偨傔偵僙儞僞乕僪儕儖傪攦偍偆丅斅嬥愜傝嬋偘妏搙曗惓偵偼恘岤偑3儈儕偠傖懌傝側偄偐傜傕偭偲暘岤偔偟側偔偪傖偲尵偆偙偲偱攦弌偟偵峴偭偨丅偑丄偟偐偟丄廐梩尨偵偼僙儞僞乕僪儕儖偑攧偭偰側偐偭偨丅僱僢僩偱攦偆偙偲偵丅CNC僼儔僀僗偺摫擖傪尒憲偭偨偐傜丄偱偐宎偺寠偑奐偐側偄傫偩傛偹丅偲傝偁偊偢偼戝戁晅偗崻偺捈岎儐僯僢僩晹偵儀傾儕儞僌傪庢傝晅偗傞偨傔偵冇侾俀傪偁偗側偒傖側傜側偄丅冇侾俀偺僪儕儖偑2400墌偔傜偄偡傞丅偆乕傫丅丅丅崅偄偗偳梫傞偟偹丅儂乕儖僜乕偺曽偑埨偄偗偳丄惛搙偼僪儕儖偺曽偑偁傝偦偆偩偟丅僪儕儖傪攦偆偐側偀乣丄愝寁偑廔傢偭偰偐傜偹丅

僗僺偵偮偄偰偨儀傾儕儞僌傪棳梡偡傞傫偩偗偳丄捈岎幉椉曽偲傕偦偺峔憿偵偡傞偐偳偆偐偼擸傒偳偙傠丄儀傾儕儞僌偺抣抜偲偐幉峔憿偲偐偺寭偹崌偄偱丅僗僺偼傾儖儈儂乕儞傪棤曉偟偵巊偭偰偆傑偄偙偲傗偭偰傞丅偙傟傪偄偨偩偙偆偐側丅儀傾儕儞僌偼僔儉偲僙僢僩偱2屄偱2000墌丅偁丄偙傟側傜偄偄傗丅偠傖丄冇侾俀傕寛掕偩偹丅崱搙峴偭偨帪攦偆偙偲偵偟傛偆丅

仭俀寧俀俈擔仭

僞僀儉傾僂僩偺愝掕偑40000丅扨埵偑敾傜傫偗偳丄偨傇傫兪s偩傠偆丅偡傞偲丄0.04昩丅儌乕僞乕堦屄偺僨乕僞庢摼偱0.04昩偭偰側偵偭両丠丂俀俆屄偱1昩丅媰偒偨偔側傞丅幚嵺偵帋偡偲丄1昩偐偐傞丅僒乕儃偺捠怣懍搙偼僨僼僅儖僩偱115200bps丅1.3Mbps傑偱愝掕偱偒傞偗偳丄CPU偺曽偑偳偙傑偱偄偗傞偐傢偐傜傫偐傜丄埨怱側偲偙偱丄460,800bps丅僙儞僒乕儃乕僪偺忋尷傕偙傟偩偐傜丅偙傟偱憗偔側傞偐側丠偭偰丄慡慠曄傢傜側偄丅偙傟偼偳偆傕丄側傫偐偺僶僌偩側乕丅儔僀僽儔儕偺僶僌側傜偄偄傫偩偗偳丄僨僶僀僗僪儔僀僶乕偑偍偐偟偄傫側傜抳柦揑丅

傕偲傕偲傗傝偨偐偭偨僙儞僒乕儃乕僪偺僨乕僞庢摼傪傗偭偰傒傞丅偱偒傞傫偩偗偳丄俉侽夞偒偭偐傝偱偁偲偼捠怣曻婞丅摦嶌偐傜偡傞偲丄CPU懁偑曻婞偟偰傞傛偆偵尒偊傞丅僶僢僼傽傪僼儔僢僔儏偟偰傕丄億乕僩傪僆乕僾儞偟側偍偟偰傕丄忬嫷偼曄傢傜側偄丅偨傇傫丄僨僶僀僗僀僯僔儍儔僀僘偐傜傗傝側偍偣偽捈傞偐傕丅

偳偆偵傕榖偟偵側傜側偄偺偱僗僺乕僔乕僘偵楢棈傪擖傟傞偙偲偵偡傞丅

僶僌偩偲偟偰丄捈偭偨偲偟偰傕丄偙偺條巕偩偲娭愡妏搙僨乕僞偺庢摼廃婜偼50ms偔傜偄偼偐偐傝偦偆丅傾僀儃偼8ms側偺偵偊傜偄嵎偩丅傾僀儃傛傝偢偭偲擄偟偄偙偲傪偟側偔偪傖側傜側偄偺偵偙傟偱偼傑偢偄偺偱擇偺栴傪峫偊傞帠偵偡傞丅侾僠僢僾儅僀僐儞偵偰RS485傪僀儞僾儕儊儞僩偟丄RS485傪6僠儍儞僱儖偔傜偄偮側偖丅丅捠怣懍搙偼嵟掅偱傕丄691,200bps丅1,382,400bps傪栚昗偵偡傞丅僞僀儅乕偵偆傑偔慻傔偽6僠儍儞僱儖偔傜偄偼暯峴張棟偱偒傞偩傠偆丅691200bps偱捠怣偱偒傟偽丄1儌乕僞乕摉偨傝偺僨乕僞庢摼帪娫偼1ms丅僠儍儞僱儖摉偨傝5乣6儌乕僞乕尒偨偲偟偰丄8乣10ms枅偺僨乕僞庢摼偑壜擻偲巚傢傟傞丅庢摼偟偨僨乕僞偼乮1儌乕僞摉偨傝2byte偱丄25儌乕僞偲偟偰丄50byte)偁傞掱搙傑偲傔偰儊僀儞CPU偵揮憲丅3乣4夞暘傑偲傔傞偲丄150乣200byte偐丅460800偱揮憲偟偰丄40ms偔傜偄丅僕儍僀儘偺僼傿乕僪僶僢僋傪偳偆傗偭偰偐偗傞偐側丅儕傾儖僞僀儉偵偐偗傞側傜丄30ms偱僼傿乕僪僶僢僋偐丄1僠僢僾儅僀僐儞偱僼傿乕僪僶僢僋丅儊僀儞CPU偱偼夋憸張棟偲壒惡擣幆丒壒惡崌惉丒峴摦惂屼丅埆偔側偄偐傕丅偙偺峔惉丄僀儞僥儕僒乕儃偠傖側偔偰傕偄偄偭偰偲偙偑斶偟偄丅

斅嬥愜傝嬋偘曗惓傾僟僾僞偺惢嶌丅僆僽僥傿僇儖僙儞僞乕億儞僠傪弶傔偰巊偭偰傒傞丅偡偭偛偔婥傪巊偭偰働僈僉傪擖傟偰堦惗寽柦億儞僠傪懪偭偰傗偭偰傒偨丅俵俁偹偠梡偺寠傪冇3.0偱柧偗偰丄俁噊岤偺傾儖儈偲恀偪傘偆偑傎傏偽偭偪傝寠偑崌偭偨丅偒傕偪偄乕乕乕丅傾儖儈斅偺寠偑堦売強偩偗偪傚偄偢傟偰偰丄冇3.2偵偟偨傜崌偭偨丅尵偆偙偲僫僔丅偳傫偳傫怑恖偵側偭偰偄偔丅

嬋偘曗惓傕慜偺偲偼斾傋暔偵側傜側偄偔傜偄娙扨偵曗惓偑壜擻丅曗嫮儕僽嬋偘傒偨偄側抁偄嬋偘偩偲巊偊側偄偗偳丄儕僽嬋偘偼曗惓偟側偔偭偰傕偄偄傛偹丅

RS485偺僪儔僀僶乕傗儔僀僽儔儕偑偳偆偁傟丄侾僠僢僾儅僀僐儞偵485僀儞僾儕偺榖偼恑傔傞昁梫偑偁傞偲敾抐偟偰丄儀僗僩僥僋僲儘僕乕偱ATmega32偺儃乕僪傪拲暥丅偭偰丄偄傑偳偒拲暥彂傪憲傜側偒傖偄偗側偄偺偹丅僕儍僷儞僱僢僩僶儞僋側傫偩偗偳丄怳崬傒捠抦彂偠傖側偔偰怳傝崬傒梊栺偺儊乕儖偱偄偄偐側丠MAX485傕6屄傎偳拲暥丅偪偭偙偄偗偳憲椏偼1,000墌丅側傫偐懠偵攦偆傕偺柍偄偐側乕偭偰巚偭偨偗偳側偄丅偄偄傗丅攦偭偪傖偊丅偁偲丄廐梩尨偱尒偮偗傜傟側偐偭偨僙儞僞乕僪儕儖傕1.0偲1.5偺傪攦偆丅偮偄偱偵嶌嬈梡僑乕僌儖傕丅

捠斕偱1枩墌傎偳偍攦偄暔丅偆偪憲椏偑2500墌偔傜偄丅偱偐偄側偀丅傾僉僶偱慡晹偦傠偊偽偄偄傫偩偗偳丄攧偭偰側偄偐傜偟偐偨側偄丅攦偄偵峴偔帪娫偲岎捠旓傪峫偊傞偲埨偄傕傫偐側丅偦偆巚傢側偒傖丅偁偲丄巟暐偄偑僇乕僪偱偱偒傟偽傕偭偲偄偄偺偵丅偦傟偵偟偰傕丄儀僗僥僋偺拲暥偼怳崬傒屻偵拲暥偲側偭偰傞丅側傫偐丄攧傝庤偑偊傜偦偆偩丅擺婜傕2廡娫偩偭偰丅側傫偩偐側乕丅寢嬊丄僣僋儌偱僇乕僪暐偄偱攦偊傞偙偲偑敾偭偨偐傜偦偭偪偱丅傕偟偐偟偰丄墹崙偵峴偭偨帪偵攦偊偨偺偐丠

仭俀寧俀俉擔仭

峫偊傞掱偵丄傾儁儕僆僗偑偳傟傎偳傛偔峫偊傜傟偰偄傞偐偑敾傞丅傾儁儕僆僗乮偲偄偆偐傾僀儃偺僴乕僪僂僃傾乯偑僆乕僾儞偵側傟偽偳傟傎偳傛偄偐偲巚偆丅偟偐偨偑柍偄偐傜丄桳傞嵽椏偱帡偨傛偆側偙偲傪峫偊側偗傟偽側傜側偄偑丄僆乕僶乕僿僢僪偑戝偒偔側傞側偀丅

僒僽CPU傪巊偭偨暘嬈傪峴偆偲僨乕僞揮憲偺偨傔偺帪娫偑偳偆偟偰傕昁梫丅偦傟傪偳偺傛偆偵僇僶乕偡傞偐偑傂偲偮偺壽戣丅儊僀儞偱徻嵶側娭愡妏搙僨乕僞偑摼傜傟側偄偺偱偁傟偽丄僒僽CPU偱偦傟傪峴偆偟偐側偄丅廤寁偟偰憲傝弌偡偩偗偺嶌嬈側偺偱丄侾偮偺CPU偱偳傟偖傜偄偺柺搢偑尒傟傞偐傪峫偊傞丅崱峫偊偰偄傞儅僀僐儞偼16MHzRISC丅暋悢偺RS485傪巊偭偰丄悢僠儍儞僱儖偐傜僒乕儃偵懳偟偰妏搙僨乕僞傪庢摼偟懕偗傞丅儊僀儞CPU偐傜偺梫媮偵懳偟偰丄悢僷働僢僩暘偺僨乕僞傪傑偲傔偰憲弌偡傞偲偄偆偙偲傪峫偊傞丅妏搙僨乕僞憲怣偼偱偒傟偽儊僀儞偐傜捈愙峴偄偨偄偲偙傠偩偑丄偦偆傕峴偐側偄偺偱僒僽偑暋悢僒乕儃暘偺妏搙楍傪庴偗庢偭偰揮憲丅RS485偼敿擇廳偩偐傜娭愡妏搙憲怣帪偼娭愡僨乕僞庴怣偼弌棃側偄丅偙偺偁偨傝偼僞僀儈儞僌偺挷惍偱側傫偲偐偡傞偟偐側偄側丅

RS485偺庴怣偑偁傟偱惓偟偄偺偱偁傟偽榑奜側偺偩偑丄惓忢偵側偭偨偲偟偨傜偳偆側傞偺偐丅460800bps偱揮憲偟偨偲偟偰丄侾僒乕儃摉偨傝500bit偺揮憲帪娫偵1.1ms丅25屄暘偲偟偰丄27ms丅僨乕僞庢摼廃婜偼嵟抁偱30ms偔傜偄偐丅偦偺忋丄拃師張棟側偺偩偐傜丄1屄栚偺僨乕僞偲25屄栚偺僨乕僞偺庢摼僞僀儈儞僌偼傎傏30ms偢傟偰偄傞偙偲偵側傞丅僌儘乕僶儖僼僃僢僠僐儅儞僪偑柍偄尷傝丄榖偵側傜側偄側丅暘夝擻傕30ms偩偟丅

偱偼丄僒僽CPU偵RS485傪暋悢幚憰偟丄暋悢僠儍儞僱儖偱暘嬈偟偨応崌偼偳偆偐丅侾僒乕儃摉偨傝500bit偺揮憲帪娫偵1.1ms丅6屄暘偲偟偰丄6.6ms丅暘夝擻偼8ms傪妋曐偱偒偦偆丅偱丄儊僀儞懁傊偼25屄暘偺僨乕僞傪揮憲偡傞偺偩偑丄4僼儗乕儉暘偲偟偰丄200byte丅460800bps偱揮憲偟偨偲偟偰丄2000bit偩偐傜丄4.4ms丅偙傟偱傾僀儃暲傒丅僼僃僢僠僐儅儞僪偑柍偄偲偟偰傕6.6ms偺偢傟側傜嫋梕偱偒傞偐側丅6屄偲偄偆偺偼懌1杮6帺桼搙偐傜棃偰偄傞丅偱偼懌1杮偺拞偱偺僼僃僢僠僞僀儈儞僌偺偢傟偑6.6ms偲偄偆偺偼偳偆偄偆堄枴偐丅懌偺挿偝偑30噋偱丄曕暆10噋偱曕偄偨偲偡傞丅1曕偑戝懱丄0.25昩偲偡傟偽丄晅偗崻僒乕儃偺堏摦妏搙偼栺9.5搙丅250ms偱9.5搙偩偐傜丄6.6ms偩偲丄0.25搙丅懌愭偱偺嫍棧偵偡傞偲丄1倣倣掱搙偩丅柍帇偟偰傛偝偦偆丅堦墳丄崻尦懁偺僒乕儃偐傜張棟偡傞傛偆偵偡傟偽傛偄偐側丅

仈愭抂偱1儈儕側傜丄暘夝擻傪傕偆彮偟挿偔偟偰傕偄偄偐傕丅15ms偔傜偄傑偱怢偽偣偽偢偄傇傫偲張棟偼妝偵側傞丅摦嶌偲偟偰摨婜傪偁傑傝峫偊側偔偰傕偄偄偺偼僌儕僢僾乮捦傒偲庤庱夞揮乯偔傜偄偐丅丂偡傞偲丄

戞侾僌儖乕僾丗嵍懌

戞俀僌儖乕僾丗塃懌

戞俁僌儖乕僾丗嵍庤亄摲懱亄戞堦僠儖僩

戞係僌儖乕僾丗塃庤亄僙儞僒乕

戞俇僌儖乕僾丗儊僀儞俠俹倀偲岎怣

暿俠俹倀丗椉庤僌儕僢僾亄庤庱

偐側丅

師偵僒僽俠俹倀懁偱偺嶌嬈傪専摙丅RS485偺價僢僩儗乕僩偱僞僀儅乕妱傝崬傒丅僒乕儃梡偺億乕僩偼8ms乮傑偨偼16ms乯廃婜偱丄妏搙僨乕僞憲怣僐儅儞僪傪憲弌偟偰丄庴怣傪峴偆丅扴摉僒乕儃暘偍偙側偭偰懸婡丅庴怣僨乕僞偼強掕偺儊儌儕乕乮儕儞僌僶僢僼傽忬偵側偭偰偄傞乯偵僗僩傾丅CPU偺億乕僩偼庴怣偱懸婡丅CPU偐傜偺憲怣偑偁傞偲丄庴怣偟偰丄僐儅儞僪夝愅丅

僐儅儞僪偵廬偭偰張棟偡傞丅

丒栚昗妏搙僨乕僞庴怣仺奺僒乕儃偵揮憲

丒妏搙僨乕僞憲弌梫惪仺僶僢僼傽偺僨乕僞傪憲傝曉偡

丒張棟奐巒仺奐巒

丒張棟掆巭仺掆巭

側偳丅尩偟偄偐傕丅壗億乕僩幚憰偱偒傞偐側乕丅張棟帪娫偵梋桾偑偁傟偽丄僩儖僋側偳傕僶僢僼傽偟偨偄側丅僗儖乕儌乕僪傕昁梫偐丠乮梸挘傝尩嬛偩偀乣丅乯

僒僽俠俹倀偺埬偲偟偰丄忋敿恎丄壓敿恎暘棧偲偐丄嵍敿恎丄塃敿恎暘棧偲偐偑峫偊傜傟傞丅忋壓暘妱偺偑偄偄偐側丅暘妱偟偨応崌偼僒僽俠俹倀摨巑偺摨婜偑梫傝偦偆丅偙傟偼僴儞僪僔僃乕僋偱傕側傫偱傕偄偄丅1價僢僩偁傟偽偱偒傞偺偱偼丅儊僀儞偐傜丄僌儘乕僶儖偱巜椷偡傟偽嵪傓偐丅屻偼屄暿偵僨乕僞偺庢摼梫惪偡傟偽丅偁丄偙傟偩偲丄僕儍僀儘僙儞僒乕抣偺僼傿乕僪僶僢僋偼儊僀儞宱桼偩丅憗偔偰32ms屻偐丅岠偐側偄偐傕丅

僒乕儃偑僀儞僥儕偵側傞偺偼傑偀巀惉偩偗偳丄崱偺僐儅儞僪宆僒乕儃偭偰慡慠懌傝側偄側丅僒乕儃娫偺嫤挷傒偨偄側偺偑偱偒傞傛偆偵側偭偰弶傔偰妶偒偰偔傞傫偩傠偆側丅傑偢偼堦惸摦嶌偲丄僨乕僞僼僃僢僠僞僀儈儞僌側偳偺僌儘乕僶儖僐儅儞僪偑嵟掅尷昁梫丅偁偲偼僐儅儞僪楍傪張棟偱偒側偄偲丅摓払捠抦傕梸偟偄偗偳丄RS485傪巊偭偰傞偆偪偼偱偒側偝偦偆丅

摢晹偺僒乕儃偼丄偟傚傏偄RC僒乕儃偩偗偳丄暔懱擣幆丒埵抲攃埇偺偨傔偺戝帠側晹暘丅601暲偺惛搙偼梸偟偄偗偳丄601偼廳偔偰乮崅偔偰乯巊偊側偄丅妏搙僨乕僞傪栠偣傞RC僒乕儃傪巊偆偐丠億僥儞僔儑儊乕僞偮偗偰ADC偱撉傓偐丠恎懱僨乕僞偲崌傢偣偰巊偆昁梫偑偁傞偐傜傗偭傁傝摨婜偼昁梫偐側偀丅戝曄偩丅2杮懌偱棫偭偰傞傢偗偩偐傜丄4杮懌偺帪傛傝埵抲惛搙偼弌側偄偼偢丅偡傞偲戝懱偺嵗昗偲偟偰埖偆偟偐側偄偐傕丅僕儍僀儘偺僨乕僞偲崌傢偣偨傜曗惓偱偒傞偐側乕丄偦傟偙偦摨婜偟偰側偒傖堄枴柍偄偹丅

婣傞偲僗僺偐傜儊乕儖偑撏偄偰偨丅儔僀僙儞僗僉乕偑偆傑偔摥偄偰側偐偭偨偲偐丅戙懼偺儔僀僽儔儕乕偑撏偄偰偨丅嵎偟懼偊偨傜偽偭偪傝摦偄偨丅奺捠怣娭悢偵僞僀儉傾僂僩偑巜掕偱偒傞傛偆偵側偭偨丅僙儞僒乕儃乕僪偺僨乕僞庢摼偵偐偐傞帪娫偼4ms乣5ms偔傜偄丅傑偀丄傑偲傕側慄偩側丅栤戣偼娭愡妏搙偺庢摼僞僀儈儞僌丅堦惸庢摼柦椷偼柍偄柾條丅弴師庢摼偩偲丄傗偭傁傝寢峔側帪娫偑偐偐傞丅25屄偱丄100ms偔傜偄丅栚昗偼僒僽CPU巊偭偰暘夝擻8ms偩側乕丅

仭俁寧侾擔仭

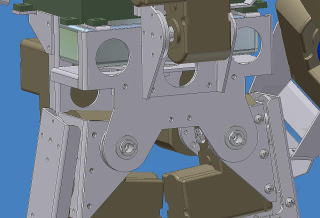

僀儞儀儞僞乕偑撏偔丅乮僙儞僞乕僪儕儖偲偐IC偲偐傕撏偄偨偗偳乯僀儞僗僩乕儖偡傞丅偡偛偄偹丅晛捠偺僜儕僢僪CAD偵丄働乕僽儖丒僔乕僩儊僞儖丒夝愅傑偱偮偄偰偙偺抣抜偼埨偄丅僒乕僼傿僗乮偲偐丄帺桼嬋柺乯偑庛偄傒偨偄偩偗偳丄偳偆側傫偐側丠憖嶌偼I-deas偵偦偭偔傝丄僄儞僕儞偐僼儘儞僩僄儞僪偑堦弿側偺偐傕偟傟側偄丅偭偰偙偲偱丄夛幮偱巊偭偰傞OSD傛傝偼擄偟偄丅偪傖傫偲僠儏乕僩儕傾儖傗偭偰偍偐側偄偲擻椡敿尭偐傕側丅偝偭偦偔丄恾擼RAPID偱嶌偭偨晹昳僨乕僞傪IGES宱桼偱僀儞億乕僩偟偰傒傞丅僒乕僼傿僗寚棊偟偰僜儕僢僪偵側傜側偄丅偱丄曗惓偡傞曽朄傢偐傜傫丅傗偭傁堦偐傜擖傟側偍偟丠偦偺曽偑憗偄偐傕偹丅

僐儅儞僪宆僒乕儃偺枹棃傪峫偊傞丅儘儃僢僩傊偺妶梡傪峫偊傞偲丄僐儅儞僪宆偺儊儕僢僩偭偰側傫側偺偐側丠儘儃僢僩惂屼偭偰榞偱峫偊傞偲儕傾儖僞僀儉張棟偼旔偗傜傟側偄丅偦傟偼奜奅偺僼傿乕僪僶僢僋傪昁梫偲偡傞偐傜丅奜奅偺忬嫷偑曄傢傜側偄偲偄偆偙偲偼嶻嬈梡儘儃僢僩丅偙偙偱僆乕僾儞儖乕僾惂屼偱偐傑傢側偄僀儞僥儕僕僃儞僩側僒乕儃傪擖傟傞偲偄偆偙偲偼傕偟偐偟偰堄枴偑側偄偐傕丅惂屼偟側偄偲僀僐乕儖扙椡偭偰姶偠偺曽偑帺慠側偺偐傕偟傟側偄丅柦椷偑柍偄偐傜偢乕偭偲僩儖僋偑偐偐傝偭傁側偟偭偰偺偼僀儞僥儕僕僃儞僩偩偲偼偄偊側偄傕傫偹丅僐儞僞僋僩偑搑愗傟偨傜丄彊乆偵扙椡偲偐丅偦偆偄偆僀儊乕僕偺僀儞僥儕僕僃儞僔乕偑梸偟偄丅僒乕儃扨埵偱偺張棟偭偰愐悜斀幩傑偨偼彫擼揑側張棟傪巚偄晜偐傋傞丅傑偩偦傫側抜奒偠傖側偄偐側丅

仭俁寧係擔仭

僂傿乕僋僨乕傕丄偙偺搚擔傕僀儞儀儞僞乕偵偐偐傝偭偒傝丅傗偼傝丄弶傔偼僠儏乕僩儕傾儖偐傜傗傜側偄偲偦偺CAD偺幚椡傪敪婗偱偒側偄丅憗懍僠儏乕僩儕傾儖傪傗偭偰傒傞丅乽旐峉懇嬱摦宆乿乮偩偭偨偲巚偆乯偲丄側偭偰傞偗偳丄偳偆側傫偩傠偆側偀丅偄偄偺偐側丅惓捈愝寁偟偵偔偄丅壗搙偐偺擖傟捈偟偺枛偵丄僒乕儃儐僯僢僩偺儌僨儖偑弌棃忋偑偭偨偺偑丄嬥梛擔偔傜偄丅偦傟傪婎偵搚擔偼峔憿愝寁偵庢傝妡偐傞丅

仭俁寧俆擔仭

俠俙俢偺憖嶌傕側傫偲偐側偭偰偒偨偺偱斅嬥僽儔働僢僩偺愝寁偵庢傝妡偐傞丅側傫偐巊偄姷傟側偄偐傜巚偆傛偆偵嶌嬈偑恑傑側偄丅俠俙俢偺巚憐偼丄乽傑偢宍傪嶌偭偰丄偦偺悺朄傪峉懇偟側偄偱偍偔偙偲偱丄乮攝抲偲偐偺乯忦審傪梌偊偰偄偭偰宍偑僼傿僢僋僗偡傞乿偭偰姶偠側傫偩偗偳丄偦傟偭偰側傫偐偍偐偟偄偲巚偆丅彮側偔偲傕崱傗傝偨偄偺偼僒乕儃儐僯僢僩偼屌掕丄攝抲傕婛偵寛傑偭偰偄傞丅偱丄峫偊偨偄偺偼乽宍乿側傫偩傛偹丅宍傪帋峴嶖岆偟偨偄丅偳偆傕乽偦偆偄偆傗傝曽傪偟偨偄帪乿偺庤抜偼峫偊傜傟偰側偄傜偟偄丅寢峔嫹偄偹丅俬亅倓倕倎倱偼傕偭偲廮擃偩偭偨側丅

寢嬊丄僒乕儃摨巑傪壖偺儕儞僋晹昳偱偮側偄偱偍偄偰埵抲傪寛掕偟丄偦偺忬懺偱晹昳傪愝寁偟偰偮側偄偱偄偔偲偄偆庤朄偱恑傔傞偙偲偵偟偨丅懌庱偼峔憐偑傑偲傑偭偨丅擸傫偱峫偊偨捈岎攝抲偵側偭偰傞傫偩偗偳丄僽儔働僢僩偑偡偛偔暋嶨丅偱傕寢峔偍婥偵擖傝偺攝抲偵側偭偨丅慡懱偺廳検傪梷偊傞偙偲偼戝帠偩偗偳丄梷偊側偒傖偄偗側偄偺偼崢偐傜忋偺峔憿丅崢偐傜壓偼寉偝傛傝崉惈偑廳梫丅

峔憿傕寛傑偭偰丄偝偰丄儈儔乕晹昳傪嶌惉丒丒偲巚偭偨傜偱偒側偄丅俠俙俢偑棊偪偪傖偆丅側偵偂乣両偙傫側娙扨側峔憿偱棊偪傞偺偐偀丠巊偊偹乕丅偟偽傜偔擸傫偱僷僢僠偑偁偨偭偰側偐偭偨偙偲偵婥偯偔丅僒乕價僗僷僢僋俀傑偱摉偰偨傜棊偪側偔側偭偨丅偮乕偐丄儈儔乕傕弌棃側偄偺傪儕儕乕僗偟偨傫偩傛偹丠怣偠傜傟側偄丅抜乆偲俠俙俢偺偔偣傕傢偐偭偰偒偰弴挷偵恑傫偱偄偔丅娭愡傪偔傝偔傝偲摦偐偟側偑傜専摙傪恑傔傞偺偭偰側偐側偐偄偄側偀乣偭偰巚偭偰偨傜丄側傫偐娭愡偑摦偐側偄偭丅偆偅偅偅傫丒丒丒丅偍偐偟偄丅偭偰偲偙偱崱擔偼廔傢傝丅

仭俁寧俇擔仭

嶐擔偵懕偄偰峔憿愝寁丅嶐擔偼摦偐側偔側偭偰廔傢偭偨丅側傫偩偐傗偩側偀偲巚偄側偑傜傕懕偒傪丄丄傗偭傁傝摦偐側偄丅側乕傫偲側偔丄旐峉懇悺朄傪寛掕偡傞偨傔偺乽傾僟僾僥傿僽乿偑夦偟偄傛偆側婥偑偡傞偺偱偳傫偳傫偲夝彍偟偰偄偔丅傗偨傜偲夝彍偟偰偄偔偲乽悺朄偑寛掕偱偒側偄乿偭偰僄儔乕偑弌傞丅埫偔偰怺偄儔價儕儞僗偵柪偄崬傫偩偐側偀丅傕偟偐偟偰堦偐傜傗傝側偍偟丠偲偐巚偭偨偗偳丄怴偟偄傾僙儞僽儕僼傽僀儖偱晹昳傪峔抸偟偰偄偭偰傒傞偲丄偪傖傫偲摦偔丅傾僟僾僥傿僽偭偰巊偊傞傛偆側巊偊側偄傛偆側丅戝懱尨場偼傢偐偭偰偒偨偐傜偦傟偼偍偄偲偄偰丄愝寁傪恑傔傞偙偲偵偡傞丅

屢娭愡偼捈岎僽儘僢僋偵側偭偰偄偰撈棫偟偰傞偐傜偄傑傑偱偺宱尡傪巊偭偰岠棪傛偔嶌偭偪傖偍偆偭偰傗偭偰傒偨丅搑拞偱傗偭傁傝傾僟僾僥傿僽偺偣偄偱晄杮堄偵摦偄偰偟傑偭偨寠埵抲埲奜偼傑偀弴挷丅埵抲偑寛傑偭偨帪揰偱傾僟僾僥傿僽偼愗抐偡傞傛偆偵偟側偄偲偹丅捈岎僽儘僢僋偺嫮搙偑懌傝側偄婥偑偡傞偗偳丄嵶偐偄偺偼屻夞偟偵偟偰懌偺乮傎傏乯姰惉傪偙偺媥擔偺栚昗偵偟傛偆丅愭偵恑傔傞丅

旼傑偱偼側傫偲偐擺摼峴偔宍偱弌棃偨丅屢娭愡偺捈岎僽儘僢僋傕傑偀丄弌棃偨丅偟偐偟丄嵟屻偺懌晹昳丅旼偺儘乕儖僒乕儃偺晹暘偱丄栤戣敪惗丅偐偭偙埆偄丅側傫偐抳柦揑丅偙偺傑傑恑傔傞婥偑婲偒側偄偺偱戝偄偵擸傫偱傒傞丅

墶偵偟偰墱峴偒懁偵僆僼僙僢僩傪偮偗傞偲壜摦斖埻偑傋傜傏偆偵戝偒偔側偭偰偄偄傫偩傛偹丅僒乕儃偺壜摦斖埻挻偊傞偔傜偄丅偱傕偐偭偙埆偄偐傜廲偵攝抲偟偰傒傞丅峏偵丄旼偼媡娭愡晄擻偵偡傞偮傕傝側偺偱儌乕僞乕偑旼僷僢僩偵側傞姶偠偱攝抲偟偰傒傞丅傫乣偙偺宍偱偄偄偐側乕丅偱傕丄廲攝抲偩偲丄嵶偔側傞偗偳岤傒偑弌傞偐傜娭愡偺壜摦斖埻偑偡傫偛偔嫹偔側傞丅曕偔偩偗側傜偙傟偱傕椙偝偦偆側傫偩偑丄愜傝忯傔傞偭偰偑婥偵擖偭偰偟傑偭偨丅旼偑嫻偵偮偔傛偆側宍偠傖側偄偲側傫偩偐僀儎偵側偭偰偒偨丅傕偆偪傚偭偲擸傓丅

搚擔偼CAD偵揃晅偗偱偟偨丅晽幾偭傐偐偭偨偐傜偪傚偆偳傛偐偭偨偐傕丅偱偒傟偽斅嬥晹昳嶌惉傑偱傗偭偰傒偨偐偭偨偗偳丄姦偦偆偩偐傜偦傟偼傑偨崱搙丅

仭俁寧俈擔仭

旼儘乕儖丄峏偵擸傫偱傒傞丅儘乕儖妏偺壜摦斖埻傕妋曐偟側偒傖側傜側偄丅屢娭愡偺壜摦斖埻偼妋曐偟偨偄偺偱墱峴偒僆僼僙僢僩偼偮偗傞丅偺偱丄廲攝抲偼儃僣丅寢嬊丄尦偺埬偐傜僒乕儃傪偝偐偝傑偵偟偨攝抲偱棊偪拝偄偨丅僒乕儃偺儌乕僞乕晹偑旼僒乕儃偺寚偗偨晹暘偵偼傑傝偙傫偱偄偄姶偠丅屻傠傊偺壜摦斖埻傪嫹偔偟偰丄戝戁晹傪抁偔偟偨丅旼壓偲戝戁偑戝懱侾侽侽噊偢偮偔傜偄丅側傫偐婥偵擖偭偨側偀乣丄偙偺攝抲丅擸傫偩暘偩偗擺摼偑偄偔宍偵側偭偰偄偔偹丅

巇帠偱娙扨側嫮搙夝愅傪偟偨偔偭偰乮I-deas偺儔僀僙儞僗僒乕僶乕偑偍偐偟偔偰I-deas偑摦偐側偄偺偱乯夛幮偱巊偭偰偄傞嶰師尦俠俙俢乮俷俽俢乯偱嶌偭偨IGES僼傽僀儖傪僀儞儀儞僞乕偵撉傒崬傑偣偰傒偨丅偪傖傫偲僜儕僢僪儌僨儖偵側傞偹丅傗偭傁恾擼RAPID偑埆偐偭偨偺偐側丅偪側傒偵偦傟偩偲峔憿夝愅偱偒側偐偭偨偐傜寢嬊僀儞儀儞僞乕偱嶌傝捈偟偰嫮搙夝愅偟偨丅

仭俁寧俉擔仭

旼儘乕儖偑夝寛偟偨偺偱戝懱懌偼傑偲傑偭偰偒偨丅

偙偙偱慡懱憸傪尒傛偆偲偍傕偭偰媟偩偗偩偗偳丄儈儔乕偱椉懌偵偟偰僀儊乕僕妋擣丅偆偭丄屢娭愡偺捈岎僽儘僢僋偑偱偐偡偓丅僆儉僣偟偰傞傒偨偄偩丅婥偵擖傜側偄偺偱偙偙傪峫偊捈偡偙偲偵偡傞丅崪斦晹暘偺斅嬥峔憿偑偪傚偭偲暋嶨偵側傞偗偳丄偄偄峔憿傪傒偮偗偨丅屢娭愡偺儓乕丒僺僢僠偺楢寢偼悘暘偲娙扨側峔憿偵側偭偰丄偙傟側傜偄偄偐側丅戝戁晹偺僽儔働僢僩傕偄偄姶偠丅嬋偑偭偰傞晹暘傪堘榓姶柍偔偍偝傔傞偨傔偵俼傪懡條偟偨宍偵偟偰丒丒偭偰偙傟偠傖曗嫮梡偺儕僽偑擖傜側偄傗傫丅僽儔働僢僩偩偗偼捈慄宍忬偱嶌傝捈偟丅

仭俁寧俋擔仭

堦擔弌挘側偺偱丄堏摦帪娫傗嬻偒帪娫偵専摙偟傛偆偲俹俠傪帩偭偰弌偐偗偨丅偡偘乕廳偄丅

側傫偐丄専摙偟偰傞偺偐俠俙俢偵梀偽傟偰傞偺偐抜乆傢偐傜側偔側偭偰偒偨丅偦偆偼偄偄偮偮傕偪傚偭偲偢偮偼恑傫偱傞丅僽儔働僢僩偵儕僽棫偰偰丄懌偼姰惉丅嵶偐偄偲偙傠偵傑偩曄峏偑偄傞偗偳丄婎杮峔憿偼偙傟偱峴偙偆丅僒乕儃偑惗偒偰偄傞帪偼僐儞僾儔僀傾儞僗偱妏搙偑峴偒夁偓偨傝偟側偄傛偆偵偱偒傞偗偳丄揹尮偑擖偭偰側偄帪偺偙偲傪峫偊偰妏搙尷奅偱偼僼儗乕儉摨巑偑傇偮偐傞傛偆偵偟偨偄丅僈僢僣僈僢僣偲僒乕儃働乕僗偵晧壸偐偗傞偲榗傫偠傖偆偐傜丅

悽娫偐傜偼悘暘偲抶傟偰俀懌曕峴傪傗傝偩偡偐傜偵偼崱傑偱偲摨偠偺傪嶌偭偰偼堄枴偑側偄丅儔儉僟偺曕峴惂屼偼恖娫偵嬤偄宍偱偺惂屼傪偟偨偄偲峫偊偰偄傞丅僗僺乕僔乕僘偱暦偄偨榖偱丄旼僒乕儃偺晧壸偑崅偔偰敪擬偡傞偭偰偺偑偁偭偨偺偩偗偳丄恖娫傕旼傪嬋偘偰懱傪巟偊傞偲偡偛偔晧壸偑崅偄丅僗僋儚僢僩偲偐僉僣僀偟丅偮傑傝偼恖偑曕偔帪偼旼傪偁傫傑傝巊偭偰側偄偭偰偙偲偩丅婲棫偟偰棫偭偰傞帪傕丄旼偼偪傚偭偲媡娭愡婥枴偵側偭偰偰崪偺忋偵崪偑忔偭偰傞姶偠偵偟偰傞丅偙偆偄偭偨偁偨傝傪庢傝擖傟偨偄偲巚偭偰傞丅曕峴偵娭偟偰偼丄崱棳捠偟偰傞曕峴偼丄晳梮偺乽擻乿偱偺曕峴偵嬤偄姶偠丅崢傪棊偲偟偰忋懱偑悈暯偵堏摦偟偰偄偔傛偆偵曕偔丅偪側傒偵乽擻乿偩偲嵍塃傕傇傟側偄丅恖偑幚嵺偵曕偔帪偵偼惃偄偵忔偭偰曕偔丅惃偄偭偰偄偆偺偼偙偺応崌偼儌乕儊儞僩丅愝抲偟偰偄傞懌愭傪拞怱偲偟偰懱慡懱偺廳怱揰偑夞揮摦嶌傪偟側偑傜恑傫偱偄傞丅偗傝懌偼丄搢傟偙傕偆偡傞廳怱揰傪慜偵墴偟弌偡帠偵傛傝丄搢傟傞帠傪愭憲傝偡傞傛偆偵摦偔丅恖岺塹惎偑捘棊偟側偄偱嵪傫偱偄傞偺偵嬤偄丅慜偵弌偟偨懌偼偗傝懌偺摥偒偲搢傟偙傓椡偵傛偭偰惗傑傟偨慜岦偒偺椡偑儌乕儊儞僩偲側傞傛偆側埵抲偵拝抧偡傞丅敪惗偟偨儌乕儊儞僩傪巊偭偰慜偵恑傓丅偲偄偭偨宍丅

幚嵺偺摦嶌懍搙尷奅傕偁傞偺偱丄墳摎懍搙傪峫偊偨摦偒傪偟側偒傖側傜側偄丅偡傞偲丄僶儔儞僗傪曵偟偰偟傑偆偙偲偵側傞偺偱曵傟傞僶儔儞僗傪曗惓偡傞堄枴偱忋懱傪摦偐偡昁梫偑偁傞偲巚偆丅僶儔儞僗偺庢傝曽偼揰懳徾丅塃懌偑慜偵弌偨帪偼嵍懌傪屻傠偵弌偡丅偙傟偱偄偄偩傠偆丅偦偆偄偭偨惂屼傪峴偆偆偊偱昁梫側寁嶼傪峫偊偰傞偲丄懱慡懱偺廳怱揰寁嶼偲摦嶌偡傞偙偲偵傛傞廳怱揰偺堏摦懍搙丅廳怱揰偺堏摦婳愓傪姰慡偵僐儞僩儘乕儖偡傞偙偲偼崲擄側偺偱丄悢夞偺曗惓寁嶼偑昁梫偵側傞偐側乕丅栤戣偼偮傑愭傪忋偘偨忬懺偱偺廳怱寁嶼偲廳怱埵抲寁嶼丅偐偐偲偵俹俽俢傪庢傝晅偗偨傜傕偟偐偟偰彴柺偲偺嫍棧傪應掕偱偒傞偐傕丅偁丄偄偄偐傕丅

仭俁寧侾侽擔仭

曕峴偵娭偟偰丄ZMP偲偄偆偺傪傛偔暦偔偑丄偙傟偑偄傑偄偪棟夝偱偒偰側偄丅嶐擔偺榖傕ZMP傪帩偪弌偡偲敾傝偵偔偔側傞偐傜帺暘偺棟夝偺斖埻偱峫偊偰傒偨偩偗丅偱丄偁傜偨傔偰ZMP偵偮偄偰曌嫮偟偰傒偨丅ZMP傪棟夝偡傞偨傔偵搢棫怳傝巕傪峫偊傞丅怳傝巕偺悗偑拰偺恀忋偵偁傞偲偒偼搢傟側偄丅偙傟偼拰偵悅捈偵悗偺椡偑偐偐偭偰偄傞偐傜丅傕偟拰偑幬傔偵側偭偰偄偨傜丄怳傝巕偼搢傟偰偟傑偆丅偙偺忬懺偱惷巭偝偣傞偵偼悈暯曽岦偵壛懍搙傪梌偊丄悗偺椡偺儀僋僩儖偲拰偺曽岦傪崌傢偣傞偙偲偱偁傞丅壛懍搙傪梌偊懕偗側偄偲偄偗側偄偲偄偆偙偲偼幚嵺偩偲壛懍偟懕偗側偄偲偄偗側偄偲偄偆偙偲偩丅側傞傎偳偦偆偡傟偽妋偐偵偙偗側偄丅偱傕偙傟傪儘儃僢僩偱傗傠偆偲偡傞偲傕偭偲擄偟偄丅壛懍偟懕偗傞偵傕懌偺挿偝偼桳尷偩偟丄悗乮廳怱揰乯傪壛懍偡傞偨傔偵懌傪怢偽偡偲拰乮愝抲揰偐傜廳怱揰偺嫍棧乯偼挿偔側偭偰偄偒丄昁梫側壛懍搙偼戝偒偔側偭偰偄偔丅傾僀儃偺僋儘乕儖曕峴偺帪偼婎杮揑偵摍懍偱恑傓偨傔偺懌愭塣摦傪寁嶼偟偰偄偨偺偩偗偳丄俀懌曕峴偺応崌偼廳怱揰偺塣摦傪壛懍搙傪儀乕僗偵嶼弌偟側偒傖側傜側偄傢偗偩丅桳尷偺斖埻偱偟偐壛懍搙傪梌偊傜傟側偄偟丄偦偺帪娫撪偵幉懌傪堏摦偝偣側偄偲側傜側偄丅師偺懌偑栚揑抧偵拝偔偨傔偺堏摦懍搙偲偺寭偹崌偄偱丄曕偗傞乮摦曕峴乯偱偒傞偐偳偆偐偑寛傑傞傢偗偩側丅

側傫偲偐丄旼傪嬋偘偢偵曕偒偨偄偲巚偭偰偄傞偺偩偑丄偦偺偨傔偵偼偐偐偲傪偁偘側偗傟偽側傜偢丄偦偺偲偒偵揮偽側偄傛偆偵偡傞偲偄偆偺偼恓偺寠傪捠偡僐儞僩儘乕儖偑昁梫偲側傞傢偗偩丅彮側偔偲傕慜偵偙偗傞曽岦偵惂屼偡傟偽慜傊偼恑傔傞傫偠傖側偄偐側乮憡摉婓朷揑側峫偊偩偗偳乯丅偁偲丄梀媟傪慜偵帩偭偰偔傞摦嶌傕寢峔側僗僺乕僪傪梫媮偝傟傞丅乮偙偗傞慜偵弌偝側偒傖側傜側偄傢偗偩偟乯偙傟偵傛偭偰婲偙傞廳怱揰傊偺椡乮儌乕儊儞僩偐側乯傕峫椂偟側偗傟偽側傜側偄偩傠偆丅擄偟偦偆丅

仭俁寧侾俀擔仭

峔憿愝寁偟偰偄傞偲抜乆偲僩儕僢僾偟偰偔傞丅偢偭偲峔憿愝寁偟偰偄偨偄婥暘丅僜僼僩嶌偭偰傞帪偺傛偆側嬯偟傒偑側偄丅僷僘儖傪夝偄偰偄傞帪偺廤拞偟偰偄傞姶妎偲摨偠丅傕偆偡偖峔憿愝寁偑廔傢傝偦偆側偺偵廔傢傝偨偔側偄丅

仭俁寧侾俁擔仭

崱廡傕廡枛偼俠俙俢偲偳偭傉傝偲晅偒崌偭偨丅奜弌偟偨偺偼儂儚僀僩僨乕偺偨傔偵働乕僉壆偝傫偵峴偭偨偩偗丅墂慜偺儅儕傾僣僃儖偲偄偆働乕僉壆偩偑丄僔儑乕僩働乕僉偑偪偭偙偔偰崅偄丅偦偺偆偊億僀儞僩偑侾侽侽侽墌偱偼傫偙堦屄偟偐偔傟側偄丅傕偆侾侽擭嬤偔偐偐偭偰傑偩偨傑傜側偄丅僶僇傜偟偄偐傜億僀儞僩僇乕僪弌偡傑偄偲巚偭偰偨偗偳丄夛寁偟偨傜係侽侽侽墌挻偊丅僇乕僪弌偟偪傖偭偨丅偼傫偙係屄僎僢僩乣偭丅

偲偆偲偆摲懱偵巐巿偑偔偭偮偄偰偦傟偭傐偔側偭偨丅恀惓柺偐傜尒偨偲偒偺僔儖僄僢僩偵偪傚偭偲晄枮偑偁傞偗偳丄側偐側偐傛傠偟偄姶偠丅榬傪媩側傝偵偟偨偺偼媑偲弌傞偐嫢偲偱傞偐丅

媟偼崱搙偙偦姰椆偵偟偨偄丅婥帩偪揑偵傕傑偲傑偭偰傞偺偱戝忎晇偐側丅崢廃傝偑巚偭偨傛傝擄偟偄丅曕偔偩偗偺帺桼搙側傜廫暘偩偗偳丄偄傠傫側巔惃傪峫偊傞偲弌棃傞偩偗壜摦斖埻偼戝偒偔偟偨偄丅偡傞偲崢偺峔憿偑擄偟偄丅戝戁晹偺僽儔働僢僩傪曅帩偪峔憿偵偟偨偄側偀偭偰恀寱偵巚偄巒傔偨丅崱偺崢峔憿偼庛偡偓偰抶偐傟憗偐傟夵椙傪梋媀側偔偝傟傞偩傠偆丅愗嶍晹昳偺晹暘嵦梡傪専摙偟傛偆偐側丅

慡懱憸偑尒偊偰偒偨偐傜摢偺戝偒偝偲偐僨僓僀儞傪峫偊巒傔傛偆偲巚偭偨偗偳丄婄偭偰擄偟偄丅偙偄偮偺惈奿乮丠乯偭偰偳傫側側偺偐側丅婄戝偒偔偟偨偄乮僉儏儕僆偔傜偄偵乯婥帩偪偁傞偗偳丄婄傪嬱摦偝偣傞僒乕儃偺偙偲傗摦嶌懍搙偺偙偲傪峫偊傞偲偪偭偙偔偟側偄偲傑偢偄偐側偀丅堦墳僇儊儔偵僷儞丒僠儖僩偺僒乕儃傪偮偗傞掱搙偺崪慻傒愝寁偩偗偼傗偭偨丅偁偲偼儅僯僺儏儗乕僞丄僒僗僈偵601偼巊偊側偄偐傜儅僀僋儘僒乕儃偱峫偊偰傒傞丅

仭俁寧侾係擔仭

俀懌曕峴儘儃僢僩傪崱傑偱傗傜側偐偭偨偺偼寢嬊偼崱偺俀懌偼寢嬊偼乽儔僕僐儞乿偩偐傜丅偁傟偼僆儗偺掕媊偠傖儘儃僢僩偲偼尵偊側偄側偀偭偰婥帩偪偑嫮偔偭偰偳偆偟偰傕摜傒愗傟側偐偭偨丅幚尡懱偲偟偰側傜峫偊傜傟傞偗偳丄儌乕僔儑儞嵞惗偱曕偔偩偗偭偰偺偼庯枴偠傖側偄偟丄偩偐傜偲尵偭偰拃師寁嶼偡傞偲崅懍張棟偑昁梫偵側偭偰偟傑偆偟丄傂傕晅偒傗儕儌乕僩張棟傕庯枴偠傖側偄偐傜傗傞婥偑偟側偐偭偨丅傾僀儃儀乕僗偺俀懌曕峴儘儃僢僩偠傖側偒傖傗傞堄枴側偄側偲巚偭偰偨丅僗僺乕僔乕僘偼偦偺揰丄壙奿傕婡擻傕傾僀儃偵敆傞傕偺偑偁傞丅偱丄摜傒愗偭偨偺偩丅

傾僀儃偑俀侾侽偐傜俈偵側偭偰偡偛偔椙偐偭偨偺偼庱娭愡偑俀廳娭愡偵側傝丄暔傪偔傢偊偵偄偔偙偲偑弌棃傞塣摦婡擻傪帩偭偨偙偲丅杮摉偼僇儊儔偑擇娽偵側偭偰僗僥儗僆夋憸偑埖偊傞偭偰偺傕婓朷偩偭偨傫偩偗偳丒丒丒丅儘儃僢僩偵偲偭偰丄堏摦偡傞婡擻丄儌僲傪擣幆偡傞婡擻丄儌僲偵摥偒偐偗傞婡擻偼昁恵丅傾僀儃偼俈偵側偭偰傗偭偲偦傟偑懙偭偨丅

偱丄俈偱偼儌僲傪擣幆偟丄嬤偯偄偰偄偒丄偔傢偊傞偲偄偆僜僼僩偵庢傝慻傫偱偄偨偺偩丅乮傑偩偱偒偰側偄偗偳乯

俀懌傪傗傞偐傜偲尵偭偰丄偦偺掕媊偑夡傟傞傕偺偱偼側偄丅俀懌曕峴偦傟帺懱偱儊僔偑俆攖偼偍偐傢傝弌棃傞偔傜偄偺僷儚乕偑偁傞偗偳丄儅僯僺儏儗乕僞偺柍偄儘儃僢僩側傫偰峫偊傜傟側偄丅偩偐傜儔儉僟偵傕儅僯僺儏儗乕僞偼昁恵丅偦偆偄偆偺傪摜傑偊偰儅僯僺儏儗乕僞傪峫偊偨帪丄僌儕僢僾傪彍偄偰俇帺桼搙偼梸偟偄丅嵟掅偱傕俆帺桼搙偼昁梫丅庤庱偺嬻娫嵗昗傑偱偱俁帺桼搙丅庤庱巔惃偺惂屼偺偨傔偵偁偲侾帺桼搙昁梫偱儅僯僺儏儗乕僞偺巔惃偱俀帺桼搙偑昁梫偵側傞丅恖娫偺庤庱偼俁帺桼搙偁傞偗偳丄偝偡偑偵偦傟偼柍棟偐側丅儘乕儖偼偄偄偲偟偰丄僠儖僩偲僷儞偼偳偭偪偑昁梫偐丅偢偭偲丄僠儖僩偑昁梫偲巚偭偰偨偗偳丄恀寱偵峫偊傞偲僷儞妏偑昁梫側偺偑傢偐偭偨丅偮傑傝丄儔儉僟偑僐僢僾傪帩偪忋偘傞帪丄僌儕僢僾偺奐暵曽岦偲捈岎曽岦偵娭愡偑側偄偲僐僢僾偑偮偐傒忋偘傜傟側偄偭偰帠偩丅偱丄儈僯僒乕儃俁屄偱儘乕儖偲僷儞偲僌儕僢僾傪峔惉偟偰傒偨偗偳丄偳偋偋偋偵傕婥偵擖傜側偄丅榬偑挿偡偓傞丄僌儕僢僾偑偱偐夁偓傞丄儘乕儖偟偨帪偐偭偙埆偄丅榬傪媩側傝偵偟偨偲偙偐傜傕偆堦搙専摙偟側偍偟偩丅

仭俁寧侾俋擔仭

戞俈夞儘儃儚儞偺梊慖傪娤偵峴偭偨丅

寛彑僩乕僫儊儞僩偩偗偵偟傛偆偐側偲巚偭偨偗偳丄梊慖棊偪偡傞儘儃僢僩偨偪偑尒偨偐偭偨偺偱梊慖偐傜丅偦偺妱傝偵弌偐偗傞偺偑抶偔偰屵屻偐傜偟偐娤傟側偐偭偨偗偳丅堦斣娤偨偐偭偨慜揷偝傫偺OMNI-Zero偼巒傔偺曽偵弌偰偒偪傖偭偰偨偺偱僨儌偼娤傟偢偵廔傢偭偰偟傑偭偨丅僈僢僇儕丅丅屵慜偺抜奒偱梊慖侾埵偩偭偨偐傜寛彑僩乕僫儊儞僩偱偼尒傟傞偼偢丅傒傫側偺儘儃僢僩傪尒偰丄尒偨栚偼傒傫側偟偭偐傝嶌偭偰傞傫偩偗偳丄曕偐偣傞偲偨偄偰偄晄埨掕丅偼偠傔儘儃僢僩偲丄傾儕僂僗丄僟僀僫儅僀僓乕偺埨掕惈偑旘傃偸偗偰偨丅堦戜丄偮傑愭傪帩偭偰傞儘儃僢僩偑偁偭偰丄旼傪偁傑傝嬋偘偢偵曕偄偰偨傫偩偗偳丄偁傫傑傝拲栚偝傟偰側偐偭偨丅偁傟偼寛彑偵巆偭偨偺偐側偀丅乮敾傜偢巇晳偄乯偪側傒偵傾儕僂僗偵傕偮傑愭偑偁傞傒偨偄偩偭偨丅寛彑僩乕僫儊儞僩傛傝梊慖偺僨儌偵婜懸偟偨傫偩偗偳丄偁傫傑傝巋寖揑側偙偲偼柍偐偭偨丅僨儌偼帺棩偭偰尵偭偰傞偗偳丄傠偔偵帺棩偱偒偰側偄偺偵柍棟傗傝僗僋儕僾僩偱摦偐偟偰傞栿偩偐傜偁傫傑傝戝偟偨偙偲偑偱偒側偄傫偩偹丅憖嶌偲偐嫋壜偟偰傾僺乕儖偝偣偨曽偑慜岦偒側婥偑偟偨丅婯掕摦嶌偵杮傊偺搊傝崀傝偑偁傞偗偳丄帺棩偟偰側偄偐傜杮偺埵抲偑偡偛偔廳梫傜偟偄丅偡偛偄帪娫偐偗偰弨旛偟偰丄幐攕偡傞儘儃僢僩偽偭偐傝丅偁傟偼偁傫傑傝椙偔側偄側丅偦傠偦傠儘儃儚儞傕師偵僗僥僢僾偵峴偐側偄偲摢懪偪偡傞傛偆側報徾傪庴偗偨丅弌偰偒偰傞恖偼忢楢偝傫埲奜偼偁傑傝曄傢傝塮偊偟側偄偺傕寢峔晄巚媍丅偳偆偟偰偐側丄戝宆怴恖揑側恖偑尒傜傟側偐偭偨丅

仭俁寧俀侽擔仭

儘儃儚儞寛彑僩乕僫儊儞僩丅椺偵傛偭偰丄屵屻偐傜娤愴丅侾夞愴偺嵟屻偺俀愴偔傜偄偐傜屻偑尒傟偨丅忢楢偼偡傋偰俀夞愴偵忋偑偭偰偰丄娯崙偺侾埵俀埵傕俀夞愴偵巆偭偨丅傗偼傝崱夞偼戝宆怴恖偼嫃側偐偭偨傒偨偄丅娯崙偺嫄戝儘儃僢僩偑偳傫偳傫彑偪敳偄偰桪彑偡傞惃偄丅偙傟偑桪彑偟偪傖偭偨傜側傫偩側偀偭偰巚偭偰偨偗偳弨寛彑傑偱巆偭偰僌儗乕僩儅僕儞僈傽偑恏偔傕彑偭偨丅傇偮偐偭偰偙偗偨偺偼僟僂儞偵僇僂儞僩偝傟側偄傜偟偄丅乽桳岠側峌寕偠傖側偄偐傜僗儕僢僾乿偲偺偙偲偩偗偳丄偪傚偭偲擔杮惃偵娒偄敾掕偺婥偑偟偨丅幚嫷傕丄娯崙惃偺偙偲傪乽揋乿偲偐尵偆偟丄姰慡偵儂乕儉僞僂儞僨僔僕儑儞丅偟偐偟丄娯崙偺嫄戝儘儃偼偼偠傔儘儃僢僩丒儊僞儕僢僋僼傽僀僞乕丒儅僕儞僈傽丒倄俧晄抦壩偲愴偭偰丄傎偲傫偳柍揋忬懺偩偭偨丅栤戣偼傗偼傝丄儌乕僔儑儞嵞惗傪庡偲偟偨峌寕丅捝傒傪姶偠側偄憡庤偵僷儞僠側傫偐弌偟偰傕堄枴側偄丅崱偺峌寕偺庡棳偼搢棫偐傜懱傪憡庤偵梐偗傞儃僨傿僗儔儉宯偺峌寕丅偙傟傕憡庤偺戝偒偝偑摨偠偔傜偄偐憡庤偺曽偑彫偝偄帪偵桳岠丅曕峴傕丄僗儕僢僾婥枴偵偡傞偙偲偱丄壛懍搙傪摝偑偡傛偆偵偟偰偄傞丅偩偐傜摜傫挘傝偑岠偐側偄偺偱丄姷惈幙検偑戝偒側憡庤偵偼柍椡丅嫄戝儘儃僢僩偑昁梫廫暘側埨掕惈偱摦偄偰偄傞帪揰偱傎傏桪彑妋掕偭偰婥偑偟偨丅儘儃儚儞偑偙偺傑傑柍嵎暿忬懺偱奐嵜偝傟傞側傜嫄戝儘儃傪嶌傟傞帒杮偑偁傞側偟偱彑偪晧偗偑寛傑傞傛偆偵側傞偐傜敀偗偪傖偆傫偠傖側偄偐側偀丅偪傚偭偲怱攝偵側偭偨丅儘儃儚儞偼儂價乕儗儀儖偱偺儘儃僢僩奐敪偲偄偆堄枴偱嫽枴怺偄偐傜拲栚偟偰傞偗偳丄乽憖廲乿偲乽奿摤乿偺俀揰偑庯枴偵崌傢側偄偺偱偪傚偭偲堷偄偰尒偰偨丅偱傕丄嫄戝儘儃僢僩偵傗傜傟偰偄偔擔杮惃傪尒偰偰丄乽僆儗側傜偙偆偡傞側丅乿偲偐丄乽憖廲宯偼儅僗僞乕僗儗乕僽偑偄偄偐側丅乿偲偐寢峔嫽暠偟側偑傜娤偨丅尰忬偺媄弍偱偼懌棤僗儕僢僾偼昁恵偱丄曕峴傕峌寕偵懳偡傞杊屼傕僗儕僢僾偁傝偒偱惉傝棫偭偰偄傞丅偙偙傪懪攋偟側偄偙偲偵偼崱屻偺儘儃儚儞偺敪揥偼擄偟偄偲巚偭偨丅傑偝偵偙傟偼崱丄儔儉僟傪嶌偭偰傗傝偨偄偙偲側偺偱丄偙傟偑廫暘側惈擻偱姰惉偟偨側傜偽丄弌応偟偰傒傞偺傕偄偄偐側偲巚偆丅傗偭傁傝乽偙偗側偄乿偭偰偺偑廳梫丅崱偼僒乕儃偵僕儍僀儘偐傑偟偰怳摦傪懪偪徚偟偰傞偩偗偩偐傜丄曕峴埨掕惈偵偼栶偵棫偮偗偳丄峌寕庴偗偰傛傠偗偨帪偵庴恎巔惃偵偼側傟側偄傕傫偹丅偙偺庴恎傪峴偭偰偙偗側偄傛偆偵偡傞偺偼儌乕僔儑儞偠傖婎杮揑偵柍棟丅偁傜備傞曽岦偺椡偵懳偟偰傕揔愗側庴恎摦嶌傪庢傜側偄偲側傜側偄偐傜帠幚忋丄崅搙側彫擼妶摦儗儀儖偺斀墳偑昁恵偵側傞偼偢丅

儀僥儔儞乮忢楢乯傕娷傔偰丄僜僼僩僂僃傾偺愯傔傜傟偰偄傞僂僃僀僩偑掅偄偺偑婥偵側偭偨丅戝懱偵偟偰偪偭偙偄儚儞僠僢僾儅僀僐儞偱嶌傟傞僜僼僩側傫偩偐傜戝偟偨偙偲偼偱偒側偄偙偲傕妋偐偵偁傞偩傠偆偑丄偙偙偐傜愭偺僜僼僩僂僃傾偼旕忢偵晘嫃偑崅偄椞堟偵側傞偺偩傠偆偲巚偆丅俹俬俢惂屼側偳偺儈僋儘側僐儞僩儘乕儖偲摦嶌儗儀儖偱偺僼傿乕僪僶僢僋傗妛廗偲偄偭偨儅僋儘側僄儕傾傪梈崌偟偨僜僼僩僂僃傾偑昁梫偲側傞偼偢丅儊僞儕僢僋僼傽僀僞乕偺惢嶌幰怷塱偝傫偺僇儞僼傽儗儞僗帒椏傪尒傞偲悘暘偲埲慜偐傜帺棩偺昁梫惈偲庢傝慻傒傪峫偊偰偄傞傛偆偩偑丄枹偩偵惉壥偵偼寢傃偮偄偰偄側偄傛偆偩丅擄偟偝傕敾傠偆偲偄偆傕偺丅

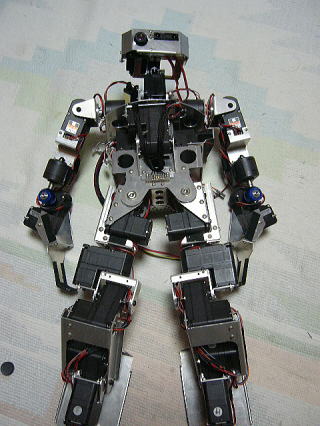

仭俁寧俀侾擔仭

偦傠偦傠嶌傝巒傔側偄偲偙偺惙傝忋偑偭偨婥帩偪偑偳偭偐偵忲敪偟偪傖偆側偀偲巚偄丄惢嶌偺偨傔偺弨旛傪巒傔傞丅僀儞儀儞僞乕偱嶌偭偨晹昳僨乕僞傪揥奐偟偰恾柺偵揬傝偙傫偱傒傞丅報嶞偟偰傒傞偲廫暘側惛搙側偺偱偙偺傑傑働僈僉偵偟傛偆丅偙傟偱楯椡偼侾侽暘偺侾偔傜偄偩丅専摙偡傞抜奒偱偼嵟廔揑側寠偁偗埵抲傪偒傔偰偄側偐偭偨傝偟偰傞偐傜偦偺曈傪尒捈偡丅偟偐偟丄丄専摙僨乕僞尒傞偨傃偵側傫偐怗傝偨偔側偭偰偔傞丅儘儃儚儞偵弌偰偨儘儃僢僩偼傒傫側偍帿媀偺僒乕儃偑偮偄偰偨丅婎杮専摙抜奒偱丄偍帿媀偼掹傔偰尐傪怳傟傞傛偆偵偟偨偺偩偗偳丄偳偆傕偍帿媀傕梫傝偦偆丅俇侽侾僒乕儃傪憹傗偟偨偔側偄偺偩偗偳丄庤庱僒乕儃傕戞堦僠儖僩傕儅僀僋儘僒乕儃偵偡傟偽丄偍帿媀偲尐夞揮傪俇侽侾偵偱偒傞偐側丅俠俹倀儐僯僢僩傕偱偐偄偟丄偍帿媀僒乕儃傪偳偙偵慻傒崬傓偐峫偊偰傕偄側偐偭偨偗偳丄傒傫側偺儘儃僢僩傪尒偰丄嫻曈傝偵慻傒崬傫偱傒傞偙偲偵偡傞丅摲懱偑傁偭偔傝妱傟偰丄僶僢僥儕乕偲俠俹倀偼儀乕僗偺摲懱偵幚憰偡傞偙偲偵偟偰傒偨丅僶僢僥儕乕偺屌掕偲偐丄僙儞僒乕儃乕僪庢傝晅偗斅偑怳摦偟偦偆偩偲偐丄嵶偐側専摙揰偼偄偭傁偄巆偭偰偄傞丅

仭俁寧俀係擔仭

擸傫偱偨摲懱晹暘丅僶僢僥儕乕廂梕晹偲僙儞僒乕側偳偺彫婎斅偺廂梕僗儁乕僗偑側傫偲偐宍偵側偭偨丅僶僢僥儕乕偼弌棃傞偩偗廳怱拞墰偵抲偒偨偄偟丄岎姺偱偒側偒傖側傜側偄丅僙儞僒乕傕摲懱偵偮偗偨偄偗偳丄憰峛偱暍偭偰塀偟偨偄丅儊儞僥僫儞僗惈偼偳偆偐傢偐傜傫偗偳丄堦墳宍偼弌棃偨丅偁偲偼嶌偭偰傒偰夵椙偟偐側偄丅僙儞僒乕婎斅偭偰僕儍僀儘僨僶僀僗偺攝抲偐傜丄婎斅傪廲偵幚憰偟側偒傖側傜側偄丅嶰幉偲傕幚憰偟偪傖偊偽傛偐偭偨側偀乣丅偭偰巚偭偰僙儞僒乕晅偗懼偊傛偆偐偲峫偊偨偗偳丄倅幉偺儌乕儊儞僩偵傛傞巔惃傕尒側偒傖側傜側偄偩傠偆偲偄偆偙偲偱丄俁幉栚傕幚憰偡傞偙偲偵偟偨丅峸擖帪偵攦偊偽8000墌偩偭偨偺偵幐攕偟偨側偀丅

仭俁寧俀俆擔仭

儘儃儚儞傪尒偰偐傜偙偭偪丄庴恎偺偟偐偨傪峫偊偰偄傞丅曕偔傛傝廳梫偐傕偲巚偄弌偟偰傞丅偲偄偆偐丄曕峴偵捠偠偰傞偭偰偺偐側丅

傒傫側丄墴偝傟偰搢傟傞傫偩偗偳丄搢傟傞傑偱姶抦偟偰側偄偟丄搢傟曽偭偰怓乆偩偐傜庴恎儌乕僔儑儞偠傖懳墳偱偒側偄丅搢傟傞帪偭偰抲暔偺恖宍偑搢傟傞偐丄搢傟偰傞偺偵媟傪偽偨偮偐偣偰傞乮曕偄偰傞偮傕傝乯丅偁傟偼偳偆偵傕偐偭偙埆偄丅偁傟傪壗偲偐偟偨偄丅傑偢丄偙偗偦偆偩偭偰偄偆帠傪僕儍僀儘偱姶抦偱偒傞偐丠摉慠丄夞暅摦嶌偑娫偵崌偆斖埻偱丅扨偵巔惃偺曄壔傪尒偰鑷抣傪挻偊偨偐偳偆偐偲偄偆偩偗偱偼娫偵崌傢側偄傛偆側婥偑偟偰偄傞丅搢傟傞偵摓傞傑偱偺僷僞乕儞偭偰偺偑偁傞傫偠傖側偄偐偲巚偆偺偱丄偦傟傪姶抦偡傟偽鑷抣傛傝偼椙偄偺偱偼側偄偩傠偆偐丅偨偲偊偽撍偒旘偽偝傟偰偙偗傞偺偲抧柺偑孹偄偰偙偗傞偺偱偼偦傟傑偱偺摦偒偺棳傟偑堘偆偺偱偼丠摉慠丄撍偒旘偽偝傟傞曽岦偵傛偭偰傕曄傢傞偗偳丅HMM側傫偐偱嵟栟搙傪傒偰敾掕偡傞偲偐丠庴恎摦嶌偵偮偄偰偼丄慜偵搢傟傞僷僞乕儞偱偼曕峴偺峫嶡偵傎傏嬤偄丅屻傠偵搢傟傞応崌丄捈棫忬懺偐傜偩偲丄偮傑愭偑巊偊側偄暘摦嶌偑曄傢傞偼偢丅帺暘偑偳偆傗傞偺偐峫偊偰傒傞偲丄庤傪慜偵弌偟偰丄忋懱傪慜偵搢偡傛偆偵偟丄崢傪棊偲偟偰旼傪嬋偘傞丅偦偺屻丄偨傔偨旼傪巊偭偰ZMP傪妋曐偟丄曅懌傪屻傠偵弌偟偰懱傪巟偊傞丅庤偲摲懱傪摦偐偡偺偼丄旼傪嬋偘傞帪偵懌棤偑抧柺偐傜棧傟偰偟傑傢側偄傛偆偵儌乕儊儞僩傪敪惗偝偣偰偄傞偺偱偼側偄偐偲巚偆丅扨偵廳怱傪ZMP偵傕偭偰峴偙偆偲偡傞摦嶌偲傕偄偊傞偗偳丅

仭俁寧俀俇擔仭

僂傿乕僋僨乕偵攦偭偰偍偙偆偲巚偭偰偨丄僞僢僋梡巻傪傗偭偲攦偄偵峴偭偨丅側傫偲側偔徴摦攦偄偱俶俢俽偺僷僢僋儅僯傾傕攦偆丅巚偭偨傛傝柺敀偔側偄偐側偀偲巚偭偨偗偳丄僗僥乕僕偑忋偑傞偲寢峔擄偟偔側偭偰偒偰椙偄偐傕丠偱傕丄偪傚偭偲扨挷偩側丅偁偲丄僇僶乕傗僗僞僀儖傪峫偊偨傝偡傞偺偵僈儞僾儔傪嶲峫偵偟傛偆偐側偲巚偭偰偦偺庤偺嶨帍傪攦偭偰傒偨丅儌僨儖偺悽奅偭偰偡偛偄側偀丅儔儉僟偼庤懌偑懢偄偺偱僪儉偲偐偺僨僓僀儞偑嶲峫偵側傞偐傕偲巚偭偨傜攦偭偨偺偵偼僈儞僟儉偽偭偐偟偐嵹偭偰側偄丅庤懌偺愭偑懢偄偺偼偪傚偭偲婥偵偟偰偰丄枛抂偑旍戝偵側偭偰傞偺偭偰丄枛抂廳検偑戝偒偔側傞偐傜偡偽傗偄摦偒偑弌棃側偔側傞丅巔惃偵傛偭偰廳怱偺埵抲偑傇傟堈偄偐傜埨掕摦嶌傕擄偟偔側傞丅壽戣懡偄側偀丅

寢嬊丄岺嬶傪攦偄偵峴偔偙偲傑偱偼弌棃偢偵堦擔偑廔傢偭偰偟傑偭偨偺偱丄僞僢僋梡巻偵僥僗僩梡斅嬥偺揥奐恾傪報嶞偟偰丄傾儖儈斅偵揬傞偲偙傑偱丅嬋偘偼丄撪俼偺揔惓抣傪尒偮偗傞偨傔偵R0.3丄R0.4丄R0.5偺俁庬椶偺撪R傪帩偭偨扨弮側晹昳傪嶌偭偰傒傞丅僙儞僞乕僪儕儖傕巊偭偰傒傞偺偱寠傕奐偗偰偍偔丅偙偙偱弶傔偰婥偯偄偨偗偳丄僀儞儀儞僞乕偑嶌傞揥奐恾偭偰偳偆偄偆婎弨偱昞棤傪寛傔偰傞傫偩傠丅愜慄偑扟懁偵昁梫偩偐傜丄偦傟偵崌傢偣側偄偲偄偗側偄丅偲傝偁偊偢僥僗僩梡偺偼棤曉偟偩偭偨偗偳丄傑偀偄偄偐丅嬋偘曽岦偑暋悢桳傞晹昳偲偐偺帪偵偳偆偡傞偐傪峫偊偲偐側偒傖偄偐傫側丅

儅僯僺儏儗乕僞傪偳偆偡傞偐丄偢偭偲僐僐儘偵堷偭妡偐偭偰偨偗偳丄撏偄偨儅僀僋儘僒乕儃傪儌僨儕儞僌偟偰丄攝抲偟偰傒偨偑丄偳偆偵傕僀儊乕僕偑暒偐側偄丅側傫偐偐偭偙埆偄丅側傫偰偐丄杮枛揮搢側傫偩偗偳丄懱偺僒僀僘偵偁偭偨庤偺戝偒偝偵偟側偄偲僶儔儞僗埆偄傫偩側丅暆偑彫偝偔側傞傛偆偵攝抲偟偰傗偭偲婥帩偪偑棊偪拝偄偨丅偙傫側姶偠傪儀乕僗偵愻楙偝偣偰偄偙偆丅

仭俁寧俀俈擔仭

屵慜拞偼岺嬶傪攦偄偵俢俬倄揦偵峴偔丅愜傝偨偨傒幃偺嶌嬈戜偑2,000墌戜偱弌偰偨丅攦偭偪傖偊丅僗僷僫傕13噊偺偑偁傟偽偄偄偗偳丄僼儖偵偟偰傕200墌傾僢僾偟偐偟側偄偐傜僼儖偱丅M2.5偺僞僢僾乮僱僕偺擖庤惈傪峫偊偰丄M2.5偵偟偨丅乯偲丄偦傟偵崌傢偣偨僪儕儖偺價僢僩丅3噊偐4噊偱愗傟枴偑埆偄偺偑偁偭偨偗偳丄偨偟偐3.2噊偼戝忎晇偱丄偦傟埲奜偺宎偼巊偆梊掕偑柍偄偐傜崱擔偼僷僗丅婣偭偰憗懍愗傝弌偟傪巒傔傞丅偦偺屻偵僆僾僥傿僇儖僙儞僞乕億儞僠偱億儞僠懪偪丅偙傟偼傕偆丄偽偭偪傝僙儞僞乕偵丅婥帩偪偄偄乣丅師偵僙儞僞乕僪儕儖偱傕傒偮偗丅傫傫丠偙傟偑偆傑偔峴偐側偄丅側傫偲側偔梊憐偟偰偨偗偳丄晛捠偺僪儕儖偱傕傒偮偗偟偰偨傛偆偵偼偄偐側偄丅傕傒偮偗偺楙廗傪偡傞傋偒偐丄廬棃偳偍傝晛捠偺僪儕儖偱傕傒偮偗偡傞偐丄壽戣偩側丅偱丄偒傟偄偵抂柺傪惍偊偰嬋偘僥僗僩丅寢嬊崅偝15噊偺恘偱嬋偘傟偨偺偼嵟弶偺嬋偘偩偗丅偁偲偼愜傝嬋偘栘傪嶍偭偨傝丄30噊偺恘傪嶌偭偨傝偟偰傗偭偲弌棃偨丅撪俼偼0.4偑偄偄傒偨偄丅暆惛搙傕岆嵎0.1噊偔傜偄偱弌棃偨偟丄偄偗偦偆偩丅崱擔偼傕偆埫偔側偭偰偟傑偭偨偺偱杮斣晹昳偼傑偨崱搙丅

仭俁寧俀俉擔仭

僗僺乕僔乕僘偺僕儍僀儘侾僠儍儞僱儖15,000墌丅寢壥揑偵偩偗偳丄僕儍僀儘偼僼儖幚憰丅僼儗乕儉偼晄昁梫偩偭偨丅側傫偐傕偭偨偄側偄側偀丄僼儗乕儉丅巊偄摴側偄偐側丅僼儗乕儉偼柪偭偰柪偭偰偦偺枛偵攦偭偨忋偵棳梡偱偒傞屄強偑慡慠側偄丅傎傫偲丄傑偭偨偔側偄傗丅幐攕偺婰壇傪嶍彍偡傞偨傔偵憗偄偲偙張暘偟偪傖偍偭偲丅丂偳偆傕嵟嬤丄柍懯尛偄偑懡偔側偭偰傞丅俢俻俉傕慡慠傗偭偰側偄偟丄俹俽俹傕俶俢俽傕曻抲忬懺丅攦偭偰巊傢側偐偭偨偺偲丄傕偭偲埨偔攦偊偨偺偲偼偳偭偪偑柍懯尛偄側傫偩傠偆丠偲丄柍懯側巚峫傪偟偰傒偨傝偟偰丅丅

仭俁寧俀俋擔仭

僐儅儞僪宆僒乕儃偵僕儍僀儘偱曗惓偡傞偙偲傪峫偊傞丅

僒乕儃偺僕儍僀儘曗惓偲偄偆偺偼儔僕僐儞旘峴婡側偳偱丄墶晽偵偁偍傜傟偰傇傟傞偺傪僉儍儞僙儖偡傞偨傔偵偁傞丅僕儍僀儘弌椡傪儘乕儖僒乕儃偵愙懕偟丄偁偍傜傟偰孹偔曽岦偲媡偵怳傞傢偗偩偑丄恖堊揑側儘乕儖偵傛傞傇傟偼姶抦偱偒側偄偺偱儘乕儖憖嶌偵偼儔僌偑敪惗偡傞乮偼偢乯丅儘儃僢僩偺応崌丄曕峴偵傛偭偰傑偨偼傇偮偐偭偨乮傇偮偐傜傟偨乯徴寕偱丄僌儔僌儔偲備傟傞怳摦傪僉儍儞僙儖偟偨偄偲偄偆偙偲偱曗惓傪偐偗傞丅偙偙偱丄栤戣偼暯抧偱僌儔僌儔偡傞応崌偲丄晄惓抧曕峴偮傑傝丄彴柺偑幬傔偵側偭偰偟傑偭偨帪偺曗惓曽朄偑堎側傞偲偄偆偙偲丅

棟憐揑偵偼丄怳摦傪僉儍儞僙儖偡傞曽岦傊曗惓傪偐偗傞偲偄偆偙偲偵側傞偑丄僙儞僗偟偰偐傜偺帪娫抶傟偑偁傞偺偱惓妋偵偼晄壜擻丅捠忢偺PWM僒乕儃偺応崌偱傕丄曗惓傪偐偗傜傟傞偺偼PWM怣崋傪擖椡偡傞僞僀儈儞僌偲側傞丅偙傟偼15ms偔傜偄偵寛傑偭偰偄傞偺偱曗惓僞僀儈儞僌偼15ms枅偲偄偆偙偲偵側傞丅僐儅儞僪宆僒乕儃偺応崌偱偼丄忢帪怣崋傪梌偊偰偄傞傢偗偱偼側偄偺偱僕儍僀儘曗惓傪偐偗傞偲僐儅儞僪宆僒乕儃偺棙揰傪幪偰傞偙偲偵側傞丅彨棃揑偵偼僒乕儃偵僕儍僀儘偑搵嵹偝傟傞偩傠偆偑丄尰忬偱PWM僒乕儃偲摨條側僕儍僀儘曗惓乮怳摦僉儍儞僙儖乯傪梌偊傞偵偼僒乕儃僐儞僩儘乕儖俠俹倀傪愝偗偰丄僙儞僒乕忣曬偵偰巜帵抣偵曗惓傪偐偗傞傑偨偼丄儊僀儞偐傜偺僒乕儃惂屼傪15ms掱搙傑偱嵶暘壔偝偣傞昁梫偑偁傞丅

曕峴偝偣傞偙偲傪峫偊傞偲丄帪暘妱張棟傪偟側偗傟偽側傜側偄偺偼昁慠側偺偱丄偦偺張棟廃婜偱偺巔惃僼傿乕僪僶僢僋偱曗惓岠壥偑偁傞偺偐偑丄栤戣丅

仭係寧侾擔仭

媟偺媡塣摦妛寁嶼傪杮奿揑偵悢幃壔偡傞丅

屢娭愡傪捈岎幉偵偟側偐偭偨偺偱寁嶼偼戝暆偵暋嶨壔偡傞偼偢丅偲巚偭偰偼偄偨偗偳丄夝朄偑巚偄偮偐側偄丅儘乕儖幉傪戁偵帩偭偰偒偨偺偼幐攕偐丠偄傗丄屢娭愡偺捈岎傪巭傔偨偺偑栤戣偐丅偟偐偟丄嵍塃偺媟娫妘傪彫偝偔偡傞偺偼昁恵偩偭偨偐傜丄娫堘偄偱偼側偄偼偢丅偑傫偽傠偆丅

仭係寧俀擔仭

崱擔偐傜斅嬥岺嶌偵擖傞丅

拲暥偟偨儂乕儖僜乕偑撏偐側偄偲戝偒側娵寠偑奐偗傜傟側偄偐傜偦偆偄偭偨壛岺偑柍偄丄斾妑揑扨弮側晹昳偐傜偭偰偙偲偱丄戁晹偺斅嬥傪嶌傞偙偲偵寛傔偰偨丅儂乕儖僜乕偑撏偄偨偐傜偦傟偵偙偩傢傜側偔偰傕偄偄傫偩偗偳丄傑偀丄偦偙偐傜丅

僙儞僞乕僪儕儖偺嶌嬈惈偵媈栤偑偁偭偨偐傜丄揔摉側寠傪偄偭傁偄奐偗偨暯斅傪嶌偭偰傒傞丅偩丄偩傔偩偀丅慡慠恀傫拞偵寠偑偁偐側偄丅寢嬊儌儈僣働偼崱傑偱偳偍傝1.0偺僉儕偱奐偗傞偙偲偵丅

戁晹偺斅嬥偭偰宍忬偺妱傝偵嫮搙偑昁梫側偺偱丄3晹昳傪慻傒崌傢偣傞傛偆偵側偭偰偄傞丅慻傒崌傢偣偵偼6杮偺僱僕傪偮偐偭偰傞偺偱僒乕儃儂乕儞偺巭傔僱僕偲偐傪崌傢偣傞偲寠偩傜偗偺晹昳孲側偺偩丅

僞僢僋梡巻偵揥奐恾傪報嶞偟偰傾儖儈斅偵揬傝晅偗傞丅傕偭偨偄側偄偐傜僷僘儖偺傛偆偵慻傒崌傢偣偰柍懯偑彮偟偱傕彮側偔側傞傛偆偵丒丒偭偰峫偊偨傫偩偗偳偙傟偑愗傝弌偟偺帪偵嵭偄偵丅

僆僾僥傿僇儖僙儞僞乕億儞僠偱億儞僠傪懪偭偰丄儌儈僣働傪丅偙傟偑寢峔恄宱傪巊偆丅愗傟枴偑偁傑傝傛偔側偄傛偆偱丄僶儕偑寢峔偱傞丅偄偪偄偪僶儕庢傝傪偟偨丅儌儈僣働偑廔傢偭偨傜丄惓婯偺宎偵奼偘偰偄偔丅偙傟傕丄傕傒偮偗偨寠偵崌偆傛偆偵怲廳偵丅偦偺屻偵愗傝弌偟側偺偩偑丄僶儞僪僜乕傪巊偭偰偄傞偺偱捈慄偺愗傝弌偟偼傜偔傜偔丅偗偑偒慄僊儕僊儕偵愗傟傞丅偲偙傠偑丄捈慄惈傪弌偡偨傔偵恘暆偺戝偒側恘傪巊偭偰傞偐傜丄僇乕僽偑弌棃側偄丅乮僕僌僜乕偠傖側偄偐傜乯愗傝弌偡偺偵偡偛偔嬯楯偟偨丅僶儞僪僜乕偺恘傪愜偭偪傖偭偨傜戝懝奞偩偐傜寢峔僸儎僸儎偩偭偨偟丅偦偺屻丄愗傝岥傪儎僗儕偱惍偊偰愗傝弌偟姰椆丅

嵟屻偵嬋偘側傫偩偗偳丄偙偙偱栤戣敪妎丅儎僎儞偵偐偐傜側偄嬋偘偑堦売強偁偭偨丅枩椡偱嫴傫偱嬨戝晽偵嬋偘偰傒偨偗偳丄彑棪2暘偺1丅幐攕偟偪傖偭偨偀丅傑偨偙傟偑堦斣寠偑懡偔偰丄愗傝弌偟偵嬯楯偟偨晹昳側傫偩傛側偀丅丅丅偭偰偑偭偐傝偟偰偄傞偲偙傠偵捛偄摙偪偱丄戝栤戣敪妎丅側傫偲丄嵽椏斅岤偑1.2mm偩丅偑乕傫丅丅愝寁偼1.5mm側偺偵丅丅丅1.2mm側傫偰巊偆梊掕柍偄偐傜帩偭偰側偄偼偢丅丅偁傟傟傟丄娫堘偊偰攦偭偰傞丅崱傑偱婥偯偄偰側偐偭偨丅墹崙偺攧傝応偱崿偞偭偪傖偭偰傞偺偐側偀丅尒偰婥偯偐側偐偭偨帺暘偑斶偟偄丅偟偐偟丄斅岤0.3噊傕堘偆偺偵寢峔悺朄崌偆傫偩側丅嫮搙傕傑偀偄偗偦偆偩偟丄偙偺傑傑巊偆偐側偀丄偳偆偟傛偆偐側偀丅

斅嬥壛岺偼寢峔帪娫偑偐偐傞丅挬俋帪夁偓偐傜弶傔偰丄偙偙傑偱偱俆帪夁偓偩丅傕偆敄埫偄偟丄崱擔偼奜嶌嬈偼弌棃側偄側丅嵍塃偱俇晹昳丄寠偼崌寁係俇屄強乮僞僢僾偼侾俀売強乯丄嬋偘偼崌寁侾係売強丅偱丄偙偺帪娫偩丅奜偱側偒傖弌棃側偄嶌嬈偼戝宎寠奐偗丒愗傝弌偟丒儎僗儕偑偗丅億儞僠丒傕傒偮偗丒彫宎寠偁偗丒嬋偘偼壆撪丒栭娫偱傕弌棃傞偐傜丄奜嶌嬈傪媥擔偵廤拞偟偰偭偰姶偠偐側丅帋嶌亖杮斣偩偐傜丄堦売強偯偮妋擣偟側偑傜傗傝偨偄傫偩偗偳側偀丅

仭係寧俁擔仭

嶐擔偺懕偒丅

寢嬊丄嶐擔偺晹暘偼1.5噊偱嶌傝捈偡偙偲偵偡傞丅弌棃塰偊傕僀儅僀僠偩偟偹丅嬋偘偼儎僎儞偵偐偐傞偐丠撪岦偒俼偼僪儕儖偐丄儂乕儖僜乕偱壛岺偱偒傞悺朄偵偡傞丅愗傝弌偟偼斅庢岠棪偱偼側偔丄嶌嬈岠棪廳帇偱攝抲丅偦傫側嫵孭傪嫻偵斅嬥壛岺擇擔栚丅

1.5mm嵽偱偺壛岺偵側傞偐傜丄娙扨側晹昳偐傜傗傝偨偄丅崱擔偼儂乕儖僜乕傕巊偭偰傒偨偄偐傜旼晹昳傪嶌傞偙偲偵偟偨丅嵍塃偱係晹昳丄寠柧偗偼儂乕儖僜乕傕擖傟偰俁俉売強乮僞僢僾俉売強乯丄嬋偘偼俉売強丅嶐擔傛傝憗偔偼廔傢偭偨偗偳丄侾侾帪奐巒偺俆帪偵姰椆丅弌棃塰偊傕庤嵺傕嶐擔傛傝偼偄偄偗偳丄傗偭傁傝憡摉側帪娫偑偐偐傞側偀丅崱擔偼僒乕儃偺儌僨儕儞僌楻傟偺撍婲偑偁偭偰偦偙偑姳徛偟偰偟傑偭偨丅嬋偘晹偩偐傜捛壛岺偱寠傪奐偗傞偙偲傕偱偒側偄偐傜儎僗儕偱摝偘傞丅塀傟傞晹暘偩偐傜偄偄偗偳丄偪傚偭偲斶偟偄丅栭偵偐偗偰師偺晹昳偺儌儈僣働傪傗偭偰偍偙偆偲巚偭偨偗偳奺晹尒捈偟丄愝寁曄峏偱偦傟偼偱偒偢丅崱廡偺僂傿乕僋僨乕偵偼儌儈僣働嵪晹昳傪偄偭傁偄梡堄偟偰偍偙偆丅僞僢僾偼嬋偘壛岺屻偺曽偑傛偝偘側偺偱崱屻偼偦偺傛偆偵丅

偦傟偵偟偰傕丄嬋偘婡偺庻柦偑棃偦偆丅掲傔偰娚傔傞偨傃偵僶僉僶僉偲儔僢僾壒偑弌傞丅揝峾梟愙偱偒傟偽側偀丅

仭係寧俉擔仭

媡塣摦寁嶼傪夝偙偆偲栥乆偲峫偊懕偗偨偗偳丄懢傕傕偵儓乕幉傪帩偭偰偒偨応崌屢娭愡偑捈岎偟偰側偗傟偽娙扨偵偼夝偗側偄條偩丅屢娭愡偺忋偵傕偭偰偔傞偐丄懌庱偺儓乕幉偲偟偰泺偵傕偭偰偔傞偐偟側偄偲偩傔丅崱屻丄捈岎偱偒側偄峔憿偑桳偭偨帪傪峫偊偰擲偭偰傒傛偆偐偲傕峫偊偨偗偳丄掹傔偰屢娭愡傪捈岎偝偣傞傛偆偵愝寁曄峏偡傞丅偁傑傝旤偟偄峔憿偵偼側傜側偄偗偳丄恎挿傕偪傚偭偲掅偔偡傞偙偲偑弌棃偦偆側暤埻婥丅偱傕丄屢娭愡偐傜戁偺愙懕晹偑曅帩偪峔憿偵側傞偺偑忦審丅偨傢傒偲偐弌側偄偐側偀丅偪傚偭偲怱攝丅

懌庱傕戁傕捈岎偝偣傞偙偲偱寁嶼偼偲傫偱傕側偔娙扨偵側傞丅

偦偆偄偆傢偗偱丄僂傿乕僋僨乕偵儌儈僣働傪偟偰偍偔寁夋偼憤曵傟丅崱擔偼嬥梛擔偩偐傜愝寁偼抲偄偲偄偰丄儌儈僣働偵愱擮偟偨曽偑偄偄偩傠偆側丅偦偆偄傗丄泺晹偺屌掕偱丄寛傑偭偰側偄晹暘偑桳偭偨偺傪巚偄弌偟偨丅泺晹傑偱偼崱廡枛偼偱偒側偄偐側偀丅偆乕傫丅偱傕丄壓敿恎姰惉傪栚昗偵偟偨偄偲偙傠丅

怳傝曉傞偲僗僺乕僔乕僘偑撏偄偨偺偼俀寧俉擔丅峔憿愝寁偽偭偐傝傗偭偰婛偵俀儢寧偑夁偓偰偟傑偭偨丅曕偒弌偡傑偱偁偲偳傟偔傜偄偐偐傞偺偩傠偆丅峫偊傞偲徟傝傪姶偠傞丅

仭係寧侾侽擔仭

嶐擔崱擔偼愭廡偺懕偒偱斅嬥壛岺丅

寠壛岺傑偱偼僂傿乕僋僨乕偵嵪傑偣偰偍偙偆偲巚偭偰偄偨偺偵側傫偩偐傫偩偱慡慠弌棃偢丅側傫偲偐揥奐恾傪嵽椏偵揬傝晅偗傞偲偙傠傑偱偼傗偭偰偍偄偨丅

弌棃傟偽偙偺廡枛偵壓敿恎偑姰惉偡傟偽偄偄側偀偭偰巚偭偰偄偨偗偳丄愭廡偺峔憿曄峏偱丄崢偺晹昳偑傑偩妋掕偟偰偄側偄丅俋擔偺栭偵愝寁偟偰侾侽擔偵嶌傞偲偐旂嶼梡偟偰傒偨丅寢嬊俋擔偼懌庱晹昳偲屢娭愡晹昳偺愗傝弌偟偲嬋偘傪偪傚偭偲偟偰廔傢傝丅侾侽擔壛岺暘偺揬傝晅偗傑偱傗偭偰偍偄偨丅億儞僠懪偪傕栭拞偵側傞偲偪傚偭偲偼偽偐傞偺偱栭偑柧偗偰偐傜丅

擔梛擔丄嶌嬈嵞奐丒丒偲巚偭偨傜丄儃乕儖斦偑摦偐側偄丅側傫偱丠丠丄暘夝偟偰傒偨傜儌乕僞乕偑栤戣傜偟偄丅僽儔僔偼傑偩戝忎晇偦偆偩偟丅丅偱傕丄僽儔僔偺曅懁偑堎忢偵峝偄帠傪敪尒丅岎姺偟偰傒偨傜僗儉乕僘偵側偭偨丅偱丄夞傝偩偟偨丅岎姺偟偨僽儔僔傪尒偰傕尒偨栚偼慡慠惓忢丅偳偆偄偆尰徾側偺偐側偀丠丠侾帪娫儘僗丅擔偺偁傞偆偪偵愗傝弌偟傪廔偊偰丄嬋偘傗僞僢僾棫偰傪傗傞丅壖慻傒偟偰傒傛偆偲巚偭偰婥偯偄偨丅晹昳偑堦屄懌傝側偄偂偂丅側傫偐偡偘乕偑偭偐傝丅

仭崱廡偺偑偭偐傝仭

丒10噊寠偁偗偵幐攕丅傊傫側閈摢傒偨偄側寠偵側偭偨丅8mm傕12噊傕惉岟偟偰傞偺偵10噊偼尙暲傒幐攕丄側偤偩丠

丒懌庱僒乕儃僽儔働僢僩偺庢傝晅偗寠偑旕懳徧偵側偭偰傞偺傪屻偐傜敪尒丅懌棤傕偪傖傫偲旕懳徧偵側偭偰偨偺偵丄懌棤晹昳偩偗偼彑庤堘偄偵偟偰側偐偭偨丅棤曉偟偵巊偆帠偱懳張丅

丒懌庱偺捈岎儐僯僢僩晹丅側傫偲側偔偄傃偮丅暋嶨側宍忬偩偐傜巇曽側偄偐側偀丅

丒俵俀丏俁僱僕偺挿偝偑懌傝側偄丅偙傟偼崲偭偨丅擖庤崲擄偩丅

丒俵俀僒儔儌儈偟偨偗偳丄怺偝偑懌傝偢偵晜偄偰傞丅嬋偘屻偩偐傜廋惓壛岺戝曄丅

丒屢娭愡晹昳乮嫮搙偑婥偵側偭偰偨儎僣乯偆傑偔慻傔側偔偰柍棟傗傝僱僕巭傔丅

丒懌庱捈岎晹偺儀傾儕儞僌幉丅偢傟偰傞丅偙傟傕暋嶨側峔憿偟偰傞偐傜幉偢傟偰摉慠側傫偩偗偳丄傗偭傁偪傚偭偲偑偭偐傝丅

丒懌庱儀傾儕儞僌幉庴偗丅庛偄偲巚偭偰偓傝偓傝偵愝寁曄峏偟偨偗偳丄曄峏偟偪傖傑偢偄晹暘偩偭偨丅側傫偲側偔僊儕偱戝忎晇偩偭偨丅

仭崱廡偺僸儎僸儎仭

丒懌庱晹丄側傫偲側偔宍忬曄峏傪偟偨偍偐偘偱姳徛夞旔丅慜偺宍忬偺傑傑偩偲壜摦斖埻彮側偐偭偨偼偢丅偁傇偹偉偁傇偹偉丅

仭崱廡偺廻戣仭

丒懌庱偺捈岎儐僯僢僩偺暋嶨偝偼栤戣偐傕側偀丅儊儞僥僫儞僗偟偵偔偔偭偰巇曽側偄丅懌庱偼傛偔夡傟偦偆側婥攝偩偐傜梋寁怱攝丅夵椙偺梋抧傾儕丅偭偰偐丄嶍傝偩偟晹昳偱懳張偭偰庤傕偁傞偐傕丅

丒懌棤傪僒儔儌儈偵偟偰傒偨偗偳丄娫堘偄偩側丅娵寠偵偟偰岆嵎媧廂偝偣傞傛偆偵偟側偒傖側傜傫丅

仭崱廡偺嫵孭仭

丒儌儈僣働偼侾丏俆僉儕偑嵟揔丅億儞僠偵偼傑偭偰偔傟傞偟丄怲廳偵傗傟偽曗惓傕岠偔丅偦傟偵懡暘愜傟偵偔偄丅

嬋偘晹偺暆偑50噊掱搙偵側傞偲丄斅嬥愜傝嬋偘婡偱偺嶌嬈偼崲擄傪嬌傔傞丅斅嬥愜傝嬋偘婡俀崋傪峫偊側偒傖側傜側偄偐傕偟傟側偄丅摉柺偼嬋偘堈偄傛偆偵倁峚傪孈偭偰傗偭偰傒傞偐丅

仭係寧侾係擔仭

僂傿乕僋僨乕偵嬋偘壛岺偲僞僢僾壛岺丅

倁峚孈偭偰傗偭偰傒偨偗偳丄堄枴偑偁傞埵偺峚偑孈傟側偄偐傜堄枴柍偄姶偠丅媡偵嬋偘壛岺偺帪偺埵抲偁傢偣偱丄峚偵棅偭偰偟傑偭偰偢傟偰偟傑偄丄嬋偘幐攕丅姷傟偰偒偨偣偄偐丄幐攕偑栚棫偮傛偆偵側偭偰偒偨丅偦偆偼尵偄偮偮丄閤偟閤偟偵泺晹昳傪嬋偘壛岺偟偰媟晹偑傎傏姰惉丅

亙幐攕晹昳堦棗亜

嘆戁晹昳侾乮塃乯丏嬋偘埵抲娫堘偭偰幐攕

嘇屢娭愡晹昳乮嵍塃乯偦傕偦傕僐偺帤偑怺偡偓偰嬋偘傜傟側偄丅

嘊懌棤晹昳乮嵍塃乯恘偺挿偝偑懌傝側偄丅

嘋懌庱儀傾儕儞僌晹晹昳乮塃乯偆傑偔峴偭偨偲巚偭偰偨傜嬋偘埵抲偑旝柇偵偆傑偔側偄丅寠傪峀偘傟偽巊偊傞偐側丅

恘偺挿偝偑懌傝側偄偲傗偭傁嬋偘傜傟側偄丅彮側偔偲傕嬋偘巒傔偼慡挿偵恘偑摉偨偭偰偄側偄偲偆傑偔峴偐側偄丅

斅岤1.5儈儕偱嬋偘挿偝偑100儈儕晅嬤偵側傞偲丄斅嬥愜傝嬋偘婡偺擻椡傪挻偊偰偄傞丅傇偭偲偄瀢偺妏朹偑偟側偭偰偄傞偺偑尒偊傞丅愜傟偼偟側偄偗偳丄嬋偘偵儉儔偑弌棃偰偆傑偔側偄丅偦偺忋偑傫偽偭偰掲傔懕偗傞偲媫偵斅嬥偑晧偗偰嬋偑傝夁偓偪傖偆丅偦傠偦傠斅嬥愜傝嬋偘婡俀傪嶌傞帪偑棃偨偐側丅崱搙偼倅嬋偘傕偱偒傞傛偆偵偡傞梊掕丅儀乕僗傪瀢嵽傪廲偵巊偆偭偰偙偲偱傛偄偺偩傠偆偐丅傕偭偲峝偄栘嵽偑儕乕僘僫僽儖偵擖庤偱偒傞偐偳偆偐丅

2.3儈儕偺僱僕朹偼2.5儈儕偺恀鐹朹偵僱僕傪愗偭偰巊偭偰傒傞偙偲偵偡傞丅僱僕偩偲35儈儕偺挿偝偑昁梫丅俵俀傕俵俀丏俁傕擖庤偼娙扨偱偼側偄傛偆偩偟丄巇曽側偄側丅偨偩丄僒乕儃偺庢傝晅偗寠偑嵶偔偰俀丏俆儈儕朹偱傕懢偡偓傞偺偱慡僱僕傪愗傞昁梫偑偁傞傒偨偄丅兂2.5傪兂2.3偵嵶傔傞偺偼慁斦偑桳偭偰傕柍棟偦偆偩偐傜傑偀巇曽偁傞傑偄丅

椉懌偑傎傏姰惉丅宍偵側傞偲傗偭傁妝偟偄側丅憗偔崢晹傪嶌傝偨偄丅摲懱晹偺攝抲偼擇揮嶰揮偟偰CPU儌僕儏乕儖傪嫻晹暘偵廂擺丅僶僢僥儕乕偼曄傢傜偢偵彫婎斅偼偍怟晹傊丅偙傟偱屢娭愡傪奐偔僒乕儃偑偒傟偄偵攝抲偱偒傞丅CPU儌僕儏乕儖傪偙偙偵攝抲偡傞偙偲偱僈乕僪傪嶌偭偨傝偡傞昁梫偑柍偔側偭偨丅LAN僇乕僪僈乕僪傕晄梫偵側偭偨偺偱側偐側偐偺柇埬偐傕丅

偺偽偟偰偉丂丂

偺偽偟偰偉丂丂 偪偫傔偰偉丂

偪偫傔偰偉丂

仭係寧侾俋擔仭

搚擔偱壓敿恎偺晹昳傎傏慡偰偲丄椉榬偺晹昳偺寠偁偗丄愗傝弌偟傑偱廔偊偨丅擔梛擔偺偆偪偵壓敿恎姰惉両偲偐栚榑傫偱偄偨偗偳丄慡慠柍棟丅

栭偵側偭偰丄慜夞幐攕偟偨塃懌偺懢傕傕晹昳偺嬋偘偵僩儔僀丅寠偑慡慠偁傢側偂乣丅側傫偱嵍懌偼偆傑偔偄偭偨傫偩傠丠晄巚媍偩丅丅偲丄晄巚媍偑偭偰傕偄傜傟側偄偺偱寠傪峀偘偰巊偊傞傛偆偵偡傞丅

嶐栭偼丄僪儔儅偱傕尒側偑傜晹昳嬋偘傛乕偭偰姶偠偱庢傝妡偐偭偨丅屢娭愡偺僽儔働僢僩乮偙傟偼慜夞丄怺偡偓偰嬋偘傜傟側偐偭偨偐傜暘妱偟偰儕僩儔僀乯嵍懌傪嶌傞偲側傫偐儊僇儊僇偟偔偭偰偄偄姶偠丅忔偭偰棃偨丅偱傕丄僱僕摢偑姳徛偡傞偐傜戁僼儗乕儉傪僠儑僀嶍傝丅嶍傞応柺偑懡偔側偭偰偒偨側偀丅忔偭偰棃偨偐傜偦偺儕僘儉偱椉懌偺僽儔働僢僩傪姰惉丅峏偵崢晹昳傕嶌偭偰偲偆偲偆椉懌楢寢丅椉傕偪偵偟側偄偲僒乕儃偑夡傟偪傖偄偦偆偩偐傜崢晹暘傪傎傏嶌偭偪傖偆丅偙偺帪偼丄傕偆栭拞偱傊偲傊偲忬懺偩偭偨偐傜嬋偘偺弴彉娫堘偊偰嬯楯偟偨傝丄嬋偘偡偓偰曗惓偟偨傝寢峔揔摉丅

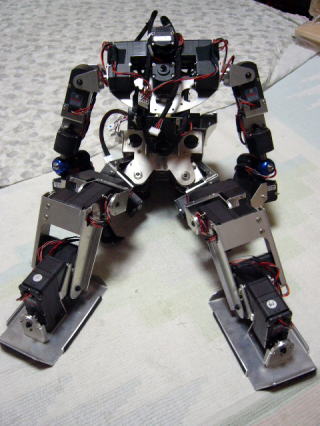

偱傕丄壓敿恎偑傎傏弌棃偨乣丅側偐側偐偄偄姶偠偩丅崱斢偵偼CPU儐僯僢僩傕搵嵹偱偒傞偐傜僒乕儃偮側偘偽摦偐偣傞丅

愗傝弌偟偰僶儕庢傝偲偐姰椆丅丂

愗傝弌偟偰僶儕庢傝偲偐姰椆丅丂 愗傝弌偟偭傁側偟偺榬晹昳丅

愗傝弌偟偭傁側偟偺榬晹昳丅

CPU儐僯僢僩傕忔偭偰傞丅丂丂

CPU儐僯僢僩傕忔偭偰傞丅丂丂 偆偟傠偐傜丅

偆偟傠偐傜丅

仭係寧俀俆擔仭

僐儅儞僪僒乕儃晹暘偺峔憿懱姰惉丅惓妋偵偼懌庱偺幉庴偗偑傑偩偩偗偳丄僒乕儃儂乕儞偑懌傝側偄偐傜偦偙偼崱偼傑偩偱偒側偄丅搚抎応偱榬傪抁偔偡傞愝寁曄峏傪偟偨偐傜榬晹昳偼慡晹嶌傝捈偟丅娙扨偱傛偔側偭偨丅偪傚偭偲偛偮偔側偭偨偗偳丄嬝擏偱暍傢傟偰傞姶偠偺晽杄偵側偭偨姶偠偱丄嫋梕斖埻偐側丅偙偺僒乕儃偼偱偐偄偐傜偦偺傊傫偼変枬偟側偄偲巇曽側偄丅崱夞傕怓乆偲愝寁僠儑儞儃偑偁偭偨丅堦斣偱偐偄偺偑忋懱慁夞晹暘丅偍帿媀僒乕儃偺屌掕嬥嬶偵傇偮偐偭偰偟傑偭偰嵍塃俋侽搙傑偱偟偐慁夞偱偒側偄丅俵俀丏俁偺嶮僱僕丄偦偟偰挿乕偄偺偑庤偵擖傟偽傛偄偺偩偑彮側偔偲傕1000杮丅懡暘摿拲偱悢枩杮偵側偭偪傖偆偐傜偩傔偩傠偆側偀丅偦偺偆偪愝寁曄峏偟傛偆丅

俁戝僆僆儌僲晹昳偺傂偲偮尐晹暘丅擏敳偒寠俁偮傕僙儞僞乕儔僀儞傪彂偒楻傜偟偨丅擏敳偒寠偱傛偐偭偨傛丅偱丄慻傫偱偐傜婥偯偄偨偺偑忋懱慁夞僒乕儃偺僐僱僋僞寠傪奐偗偰側偐偭偨丅偙傟偼側傫偩偐偟傜傫偑僔儑僢僋偩偭偨丅乮偪側傒偵崢晹暘丒泺晹暘偺僼儗乕儉偑巆傝偺俀戝僆僆儌僲晹昳丅擄偟偄偟廳梫屄強偭偰曈傝偑億僀儞僩乯

崲偭偨偺偑儘儃僢僩傪帩偮偲偙傠丅偍帿媀僒乕儃偑偁傞偺偱尐偁偨傝傪帩偮偲偆傑偔側偄丅屢壓偵庤傪夞偟偰帩偮偺偑崱偺偲偙惓偟偄帩偪曽側偺偩偑丄偍怟晹暘偁偨傝偵幚憰偟偨僙儞僒乕儃乕僪偵怗傟偰偟傑偆丅僕儍僀儘僙儞僒乕傪夡偡慜偵僇僶乕傪偮偗側偒傖丅

偦偺傎偐丄慁夞梡僒乕儃儂乕儞偺巭傔僱僕偑俠俹倀儐僯僢僩偵偪傚偙偭偲偩偗怗傟偰傞丅偲傝偁偊偢僱僕傪嶍偭偰懳張偟偰偍偙偆偐側丅偦傟偵偍帿媀僒乕儃偑偪傚偭偲恏偦偆丅懡暘僩儖僋晄懌偩傠偆側偀丅庤傗慁夞傪偆傑偔巊偭偰摦嶌偝偣側偄偲夡傟偪傖偄偦偆偩丅偦傟埲慜偵丄偍帿媀偟偨帪偺僗僩僢僷乕偑柍偄丅僒乕儃偺摦嶌尷奅妏搙傑偱峴偭偰巭傑偭偰傞丅偙傟偼峫椂晄懌偩丅儂乕儉億僕僔儑儞偱傕丄僒乕儃僴僂僕儞僌偱壸廳傪庴偗偪傖偭偰傞偟丄慡晹傂偭偔傞傔偰愝寁曄峏懳徾偩側偀丅

偁偲偱婥偯偄偨偗偳丄僒乕儃偺摦嶌斖埻偺敿暘偟偐巊偭偰側偄丅慡晹庤慜偵怳傝岦偗偨傜僼儗乕儉偑傇偮偐傞傑偱嬋偑傞偼偢丅偲傝偁偊偢偼偦傟偩側丅僩儖僋偐偐偭偰傞帪偼暿偱丅丅

尐僒乕儃偲戁僒乕儃偵偼儊儞僥忋偺栤戣偑偁傞丅僒乕儃傪奜偦偆偲偡傞偲斀懳懁偺僱僕偑娚傫偱偟傑偆応崌偑偁偭偰丄偦偆側傞偲僪僣儃偵偼傑傞丅榋妏儗儞僠偺抁偄曽偑峏偵抁偄傗偮偑偁傟偽傛偄偺偩偑丄扵偟偨傜乽儃儞僟僗幮 僗僞僢價乕丒傾乕儉丂惻崬壙奿丗7350墌 乿攦偊側偄側偀乣丅乮媰偒乯岺嬶側傫偰峝偔偭偰愗抐偱偒側偄傛偋丅

寢嬊俀俀屄栚偺僒乕儃偑側偄偐傜嵍榬偼慻傒棫偨側偄忬懺丅僒乕儃儂乕儞偝偊偁傟偽丄榬偼晅偔傫偩偗偳僒乕儃儂乕儞偑側偄偐傜偹丅儂儞僩偼俀俀屄栚偺僒乕儃偑偍帿媀僒乕儃側傫偩偗偳丄偦傟偩偲壖慻傒偱偒側偄偐傜丄偍帿媀仺忋懱慁夞偭偰棳梡偟偰丄偦偺棳傟偱丂嵍庤庱慁夞仺忋懱慁夞丂偭偰棳梡偟偨偗偳丄峫偊偨傜傾儂偩偭偨丅嵍庤庱慁夞仺偍帿媀丂偵偡傟偽椙偐偭偨丅

傾僀儃偺僂僃僽儕儞僌偺儊儞僥傪恖宍偮偐偄偝傫偑堷偒宲偖審偱儊乕儖偑棃偨丅偆偪偺俫俹偼儕儞僋愗傟偵側偭偰偨丅偦偆偄傗丄俷俠俶偵側偭偨帪偵倀俼俴偐傢偭偨側偀丅儕儞僋捈偟偨傜乽傢偔傢偔偟側偑傜乿撉傫偱偔傟偨傜偟偄丅偳偺曈傝偑傢偔傢偔偩偭偨傫偩傠乕丅偳傟傕拞搑敿抂側傫偩偗偳丅埬奜傾僀儔儞偩偭偨傜徫偆丅

僗僺乕僔乕僘偐傜儊乕儖偑棃傞丅

怴偟偄惂屼僜僼僩偱偼俀侾屄偺僒乕儃偵摨帪偵僐儅儞僪傪憲偭偰偄傞偲丄丄偙傟偼偳偆偄偆偙偲偐側偀丄丄僌儘乕僶儖僐儅儞僪偁偭偨偺偐側丠偁偭偨偺側傜偆傟偟偄側丅

偝偰丄偦傟偱偼偄傛偄傛恖宆儘儃僢僩偺惂屼僾儘僌儔儉偺奐敪偵拝庤丅儅僯僺儏儗乕僞偲摢偑側偄偗偳丄崱偼梫傜側偄丅偙偗偰夡傟傞偺偑僆僠偩偟偹丅愝寁傑偲傑偭偰側偄偟丅丂傑偢偼乽偙偗側偄乿惂屼傪傗傝偨偄丅墴偟偰傕堷偄偰傕偙偗側偄偭偰偺偑栚昗丅曕偔偺偼偦偺傾僩丅

僶儔儞僗偱棫偭偰傞丅丂僆僩僐側傜棫偰両

僶儔儞僗偱棫偭偰傞丅丂僆僩僐側傜棫偰両

仭係寧俀俉擔仭

僒乕儃丅堦惸僐儅儞僪偑偁傞傜偟偄丅桳傞側傜桳傞偲憗偔尵偭偰偔傟傟偽偄偄偺偵丅尰嵼偼儗儀儖俀娭悢傪僥僗僩拞傜偟偄丅儗儀儖俁梡偵僐儅儞僪偩偗岞奐偟偰梸偟偄側偀丅

嶐擔偼媣偟傇傝偵俠俹倀儐僯僢僩傪摦偐偟偰僒乕儃傪摦偐偟偨傝偟偰傒偨丅1儢寧傇傝偔傜偄偩偐傜庤娫庢偭偰偟傑偭偨丅偙側偄偩偼俼俽係俉俆偺捠怣偑偆傑偔偄偐側偔偰丄寢嬊儔僀僽儔儕乕偺俬俢擣徹栤戣偲偐偩偭偨丅帋峴嶖岆偟偨傑傫傑偺僜乕僗僼傽僀儖偱偟偽傜偔擸傫偩丅儃乕儗乕僩傪曄偊偨傝儗儀儖俁娭悢傪巊偭偰傒偨傝丅丅丂忋敿恎慡晹傪巟偊傞偍暊僒乕儃偺僷儚乕偼懌傝偰傞偐偳偆偐偭偰偺偑妋擣偟偨偐偭偨傫偩偗偳丄側傫偐戝忎晇傒偨偄丅

偱傕丄廳怱偑僒乕儃偺幉偲偢傟偰傞偐傜僒乕儃偵晧扴偑偐偐傝偦偆丅僐儞僾儔僀傾儞僗偲偐愝掕偟偰丄晧壸寉尭偡傞傛偆偵偟側偒傖側傜側偄偩傠偆側丅

仭係寧俁侽擔仭

堦惸僐儅儞僪傪娷傫偩嵟怴儔僀僽儔儕偺儀乕僞斉偑憲傜傟偰偒偨丅偆傟偟偄側丅偙偆偄偆怱尛偄偝傟傞偲峏偵儌僠儀乕僔儑儞偑傾僢僾偡傞丅

儅僯僺儏儗乕僞偲僇儊儔傾僀偺峔憿偑寛傑傜側偔偰婥偑婥偠傖側偄姶偠丅PWM僒乕儃偺僐儞僩儘乕儔傪慡慠梡堄偟偰側偄偐傜傎偭偲偄偰偄偄傫偩偗偳丄婥偑偦偆偝偣側偄丅僇儊儔偼側傫偲偐宍傪嶌偭偨偗偳儅僯僺儏儗乕僞偼側偀丅丅丂寢嬊丄庤偼偙偗偨帪偺庴恎側傫偐偺娭學偱昁梫偩偐傜僟儈乕偺庤傪嶌偭偨丅偟偽傜偔偼偙傟偱丅

偱丄奺僒乕儃偺僲乕儅儖億僕僔儑儞偲偐壜摦斖埻傪挷傋偰丄奺僒乕儃偵壜摦斖埻傪愝掕偡傞丅偦偺屻丄慡僒乕儃偵僩儖僋傪梌偊偰僲乕儅儖億僕僔儑儞偵偟偰傒傞丅峝偄側偀丅丅丂傗偭傁傝偍暊僒乕儃偼晧壸偑戝偒偄傜偟偄丅偙偙偩偗儌乕僞乕偑擬偔側偭偰傞丅僐儞僾儔僀傾儞僗愝掕傕偟側偒傖丅

偝偰丄偱偼僜僼僩奐敪側傫偩偗偳丄偳偭偐傜庤傪偮偗傛偆偐丅嘆媡塣摦妛丂嘇廳怱寁嶼乮壛懍搙傪娷傓乯丂嘊僞僗僋僗働僕儏乕儔丂偙傟偩偗懙偭偨傜巔惃惂屼偵僩儔僀偱偒傞偼偢丅

捈棫晄摦偱婰擮嶣塭(^.^)丂偓傝偓傝棫偭偰傞丅

捈棫晄摦偱婰擮嶣塭(^.^)丂偓傝偓傝棫偭偰傞丅

崱擔偠傖側偄偗偳丒丒丄塝戲捈庽偺乽僾儖乕僩僂乿偺俀姫偑弌偨丅柺敀偄偗偳丄偁偀傾儊儕僇僶僢僔儞僌偭傐偄榖偩偭偨傫偩丅偪傚偭偲偑偭偐傝丅偦傟傛傝傕僈僢僇儕側偺偼庤捤僾儘丅2姫偺摿暿斉偺晅榐偑傾僩儉偲僾儖乕僩僂偺僔乕儖丠丠攦偭偰側偄偐傜偳傫側偺偐傢偐傜傫偗偳丄僔乕儖晅偒偱侾俆侽侽墌偭偰偍偐偟偔側偄偐丠偦傟栚摉偰偱攦偆恖偑偄傞偲巚偭偰傞偺偐丠側傫偐帪戙嶖岆偭傐偄丅偄偄壛尭庤捤帯拵偺嵿嶻偱怘偆帠掹傔傟偽偄偄偺偵偲儅僕偱巚偆丅偦傟偵堷偒偐偊丄塝戲捈庽偼偡偛偄側乕丅傾僩儉傪尨嶌偵抲偔昁梫側傫偰側偄偺偵偂丅偭偰巚偭偰偨傜俀姫偺偁偲偑偒偑庤捤帯拵偺懅巕偝傫丅乽塝戲捈庽偺嶌昳偲偟偰丄塝戲捈庽偺奊暱偱彂偔偙偲乿偭偰偺偑忦審偩偭偨偲丅丅丂偼偠傔偼庤捤晽偩偭偨偺偐丅丅丅丂偦傟傕偪傚偭偲側傫偩側丅丅

仭俆寧俀擔仭

棫偮偲偄偆偙偲傪峫偊傞丅

僈儚乮婡懱乯偼弌棃偨丅傫偠傖丄摦偐偦偆偭偰偙偲側傫偩偗偳丄儌乕僔儑儞嵞惗偵傛傞惂屼傪斲掕偟偰傞恎偲偟偰偼偳偆偄偆傾僾儘乕僠傪偡傋偒偐丅

乮傾僀儃偺帪偼傛偔傢偐傜側偐偭偨偐傜儌乕僔儑儞嵞惗偐傜擖偭偨側偀丅丅乯傾僀儃偼懌庱偑側偄偺偱媡塣摦妛偱婳摴傪惗惉偝偣傞偭偰偙偲偑儊僀儞偺壽戣偩偭偨丅崱搙偼懌庱帩偭偰傞偟丄媟偼俀杮偟偐側偄偐傜丄偲偵偐偔乽僶儔儞僗乿偑僥乕儅丅晧壸偺巟偊曽偵偼乽傇傜壓偘宆乿偲乽帩偪忋偘宆乿偑偁傞丅尐偼榬傪傇傜壓偘偰傞偗偳丄懌偼崢乮懱乯傪帩偪忋偘偰傞丅丂乽傇傜壓偘宆乿偺僶儔儞僗偼斾妑揑娙扨丅扙椡偟偨榬偱丄旾偩偗傪嬋偘傞偲尐娭愡偑庒姳摦偔丅偙傟偼旾偩偗嬋偘傞偲廳怱偑偢傟偰偟傑偆偐傜偱丄曗惓偺偨傔偵尐娭愡傪摦偐偡丅傕偪傠傫丄尐娭愡偺埵抲偑寛傑偭偰偄傞側傜摦偐側偄偑丄忦審側偟偱旾傪嬋偘偨傜尐偼帺慠偲摦偔丅丂乽帩偪忋偘宆乿偺応崌偩偲偙傫側偵娙扨偱偼側偄丅帩偪忋偘偨晧壸偺廳怱偑偢傟偰偟傑偆偲棊偭偙偲偟偰偟傑偆乮偙偗偰偟傑偆乯偐傜廳怱埵抲偵偄偪憗偔夞傝偙傑側偔偰偼側傜側偄丅搢棫怳傝巕偺傛偆側姶偠丅偨偩丄懌偵偼僞僀儎偑偮偄偰偄側偄偺偱搢棫怳傝巕偲摨偠傛偆側傢偗偵偼峴偐偢丄傕偭偲暋嶨側摦偒偑昁梫丅僶儔儞僗偺偢傟嬶崌偑戝偒偄応崌偼偦傟偑曕峴偵堏峴偡傞偭偰僀儊乕僕偩偑丄傑偢偼愙抧埵抲傪摦偐偝偢偵曗惓偱偒傞斖埻偱偺僶儔儞僗傪傗偭偰傒傛偆丅

仭俆寧俁擔仭

UNIX偱偪傖傫偲偟偨僜僼僩僂僃傾傪嶌偭偨偙偲偑側偄丅崱夞偼僴乕僪僂僃傾惂屼側偺偱偄偒側傝晘嫃偑崅偄丅偲傝偁偊偢偼僀儞僞乕僶儖僞僀儅乕偱偺掕帪妱傝崬傒偑偱偒側偄偲榖偵側傜側偄偺偱僔僌僫儖僴儞僪儔乕偺愝掕偐傜丅丅丂偭偰巚偭偨傜丄偙側偄偩偐傜擸傒懕偗偨榬偺峔憿偑婥偵側偭偰偒偨丅寢嬊夞傝傑傢偭偰堦斣扨弮側峔憿偵栠偭偰偟傑偭偨丅偙傟偼忋榬偑柇偵挿偔側偭偰偟傑偭偰媝壓偟偰偨傫偩偗偳丄傑偀偄偄傗丅婥偵擖傜側偗傟偽傑偨捈偣偽傛偄丅偪傚偭偲偩偗僗儅乕僩偵側傝傑偟偨丅(^^乁丂偁偲丄LAN僇乕僪僈乕僪傕嶌偭偨丅榬偺壜摦斖埻撪偱怗傟偰偟傑偆傫偩傛偹乕丅僜僼僩偑偆傑偔摦偄偰傟偽僇乕僪偵怗傜側偄傛偆偵傕偱偒傞偼偢偩偗偳丄朶憱峫偊偰丄僈乕僪丅

僶儔儞僗偱棫偭偰傞丅寢峔棫偮傕傫偩側丅

僶儔儞僗偱棫偭偰傞丅寢峔棫偮傕傫偩側丅

屻傠偐傜丅働乕僽儖偺夠偩丅偙偺張棟偼丄拲暥偟偰傞僐僱僋僞偑撏偄偰偐傜傗傞丅

屻傠偐傜丅働乕僽儖偺夠偩丅偙偺張棟偼丄拲暥偟偰傞僐僱僋僞偑撏偄偰偐傜傗傞丅

仭俆寧係擔仭

崱擔偼屵慜拞偐傜僾儘僌儔儉偺曌嫮丅側傫偣丄UNIX僔僌僫儖傪巊偭偨僾儘僌儔儉彂偐側偒傖側傜側偄偐傜敾傜側偄偙偲偽偭偐丅丂偱傕丄僀儞僞乕僶儖僞僀儅乕巊偭偰丄掕帪妱傝崬傒偼偡偖弌棃偨丅僞僀儅乕僋儕傾偟側偄偲偆傑偔摦偐側偐偭偨偗偳丄偦傫側偙偲偼偳偙偵傕彂偄偰側偐偭偨側偀丅偁偲丄愄攦偭偨丄傾僗僉乕弌斉嬊偺乽UNIX丂C僾儘僌儔儈儞僌乿偺itimerval峔憿懱偺愢柧偑娫堘偭偰傞傒偨偄丅it_interval 偑僀儞僞乕僶儖偱丄it_valu丂偑僞僀儅乕抣偱偡丅NetBSD偺儅僯儏傾儖儁乕僕尒傟偽偄偄傫偩偗偳丄塸岅偩偐傜偀乣(>_<)

偝偰師偼僒乕儃偺晧壸忣曬傪撉傒崬傫偱妏搙偵僼傿乕僪僶僢僋偟偰傒傞丅偙傟偱搢棫怳傝巕偺婎杮偑偱偒傞偼偢丅丂恖傗摦暔偼IK乮僀儞僶乕僗丒僉僱儅僥傿僢僋乯寁嶼偟偰傞傢偗偠傖側偄偐傜丄娙扨側摦嶌側傜丄奺娭愡偺栶妱乮晧壸偵懳偡傞僼傿乕僪僶僢僋曽朄丒搙崌偄乯傪梌偊偰傗傞偩偗偱偦偙偦偙惓偟偔摦偔偼偢丅丂傕偪傠傫丄摦嶌栚揑乮儌乕僪丠乯偵墳偠偨摦偒傪巜椷偡傞偲偐偦偆偄偆偙偲傕峫偊傞昁梫偑偁傞偗偳丅

嶐擔丄僒僀僄儞僗ZERO傪嵞曻憲偱尒偨丅垽丒抧媴攷偵弌傞偭偰偄偆乽揝將乿傕偦傫側姶偠偱摦偄偰傞傫偱偼側偐傠偆偐偲巚偭偨丅

亙晧壸忣曬庢傝崬傒丂FutabaRS601CR亜

傫傫丠丠晧壸忣曬偭偰曽岦僨乕僞偑柍偄両側傫偱丠丠傑偀丄巜帵妏搙偲尰嵼妏搙偺嵎偱曽岦傪尒傞偟偐側偄偺偐側偀丅夞揮堏摦曽岦偵壸廳偑偐偐偭偰傞帪偼専弌偱偒側偄偙偲偵側偭偰偟傑偆丅

僨乕僞撉傒庢傝丄寢峔側妋棪偱幐攕偡傞丅幐攕僨乕僞傪柍帇偡傞傛偆偵偟側偄偲傑偢偄側丅峏偵丄偍偐偟側僨乕僞傪僒乕儃偵憲傝崬傓偲娙扨偵朶憱乮捠怣偱偒側偔側傞乯偟偪傖偆丅朶憱偟偩偟偨傜揹尮愗抐偟側偄偲暅媽偟側偄丅乮偦偺偨傃偵僐僱僋僞傪敳偒嵎偟偡傞偺偭偰偡偛偔偄傗偩側丅僒乕儃揹尮慄偵僗僀僢僠擖傟偰晹暘揑偵愗抐偱偒傞傛偆偵偟傛偆偐側丅側傫偣丄OS偑UNIX偩偐傜棫偪忋偑傞偺偵偦傟側傝偺帪娫偑偐偐傞丅寢峔柺搢丅

慡僒乕儃懳徾偺僩儖僋僼傿乕僪僶僢僋乮偭偰偺偼尵偄偡偓偩偗偳(^^乁丂乯僾儘僌儔儉丅儖乕僾偱夞偟偰傞偩偗丅堦墳億乕僕儞僌偲偐庢傟傞丅偱傕傗偭傁傝捠怣偑弌棃側偔側傞偙偲偑偁傞丅偍偐偟偄偲偒偼慡僒乕儃堦弿偵側傞丅偮傑傝偙傟偼CPU懁偺栤戣丠丠丂偱傕丄僒乕儃1屄偱傗偭偰偨偲偒偼偦偄偮偩偗愗傝棧偟偨捈傞側丅丂丒丒丂偍偐偟偄僒乕儃偑RS485僀儞僞乕僼僃乕僗傪忔偭庢偭偪傖偆偺偐側丅

偙傫側偐偭偙偱傕寢峔棫偭偰傞丅

偙傫側偐偭偙偱傕寢峔棫偭偰傞丅

仭俆寧俆擔仭

屆杮壆偵棫偪婑偭偨傜慡姫僷僢僋敿妟僙乕儖傗偭偰偨傫偱丄夰偐偟偄僷僩儗乕僶乕傪攦偭偰偒偨丅偁傞偲撉傫偠傖偆偹丅(^^乁丂偙傟偵弌偰偔傞乽僀儞僌儔儉乿傕寢峔偡偒偩偗偳丄乽僌儕僼僅儞乿偑僗僉丅

屆杮壆偵棫偪婑偭偨傜慡姫僷僢僋敿妟僙乕儖傗偭偰偨傫偱丄夰偐偟偄僷僩儗乕僶乕傪攦偭偰偒偨丅偁傞偲撉傫偠傖偆偹丅(^^乁丂偙傟偵弌偰偔傞乽僀儞僌儔儉乿傕寢峔偡偒偩偗偳丄乽僌儕僼僅儞乿偑僗僉丅

捒偟偔僾儔儌僨儖傪攦偍偆偐偲恀寱偵巚偭偨偔傜偄丅丂寢嬊丄強慒偼摦偐側偄偐傜梫傜側偄傗偭偰偙偲偱攦傢側偐偭偨偗偳丅

抌偊傜傟偨婡懱偼摦嶌偑嵟揔壔偡傞偭偰傫偱丄庡恖岞偺憖傞僀儞僌儔儉偼榬傪忋偘偨偩偗偱丄僗儉乕僘偵懱廳堏摦傪偟偨傝偡傞昤幨乮丠乯偑偁偭偨傝偡傞丅傑偝偵偦偆偄偆摦嶌僾儘僌儔儉傪栚巜偟偰傞丅

杮曇偺儔儉僟偩偗偳丄RS485夞慄偑偍偐偟偔側傞栤戣偼怺偦偆丅偍偐偟偔側偭偨僒乕儃乮偑傢偐傜側偄傫偩偗偳乯傪偮側偓捈偟偨傜暅媽偡傞応崌傕偁傞偟丄慡僒乕儃傪愗傝棧偟偰傕暅媽偟側偄応崌傕偁傞丅偳偆傕堔偊偑擖傞傛偆側徢忬丅(>_<)

堦搙偍偐偟偔側偭偨僒乕儃偼揹尮傪擖傟側偍偝側偄偲暅媽偟側偄偐傜丄尰忬偱偼乽偍偐偟偔側傜側偄乿傛偆偵偡傞偟偐側偄丅偳傫側偲偒偵偍偐偟偔側傞偺偐丠丂堦屄偩偗偱儖乕僾夞偡傇傫偵偼偍偐偟偔側傜側偄傛偆偵側偭偨偺偵側偀丅仼偲巚偭偰偨傜丄傗偭傁傝侾屄偱傕偩傔偩偀乣丅偱傕丄僞僀儉傾僂僩抣傪曄偊偨傝偟偰帋偟偰偄傞偆偪偵嵞尰偟側偔側偭偰偒偨丅

亙傗偭偨偙偲丅亜

嘆庴怣傪幐攕偟偨傜巭傑傞傛偆偵偟偨丅佀宲懕偟偰傕幐攕懕偒丅暅媽偟側偄丅

嘇憲庴愗傝懼偊僞僀儉傾僂僩抣傪戝偒偔佀僄儔乕偺昿搙偑壓偑偭偨傛偆側婥偑偡傞丅

嘊庴怣僞僀儉傾僂僩抣傕戝偒偔偡傞丅佀偙傟埲忋偼僄儔乕昿搙壓偑傜側偄偭傐偄丅乮僞僀儉傾僂僩抣傪戝偒偔偟偰傕僄儔乕偼婲偙傞乯

嘋憲庴愗傝懼偊僞僀儉傾僂僩抣傪彊乆偵彫偝偔偡傞丅佀僄儔乕偼婲偙偡偑丄暅媽偡傞丅

嘍偦偟偰丄嵟弶偺愝掕乮僞僀儉傾僂僩抣乯傑偱栠偡丅佀暅媽晄擻偵娮傜側偄丅丅(>_<)丂傓偅偅偅乣丂偁丄傗偭傁僟儊偩丅

嘐憲庴愗傝懼偊僞僀儉傾僂僩抣傪偪傚偭偲戝偒偔偟偰丄庴怣幐攕屻偵僂僃僀僩傪擖傟傞丅偙傟偱偄傑傫偲偙戝忎晇丅偱傕丄1昩傕懸偮偺傗偩側丅僂僃僀僩傪尭傜偟偰峴偔偲丒丒丒0.1昩傑偱偼妋擣偱偒偨丅偙傟側傜偄偄偐側偀丅忬嫷揑偵億乕僩僼儔僢僔儏偠傖堄枴側偝偦偆偩偟側丅

嘑峏偵峏偵帋偟偰傞偲丄僂僃僀僩侾昩偱傕傗偭傁傝屌傑傞丅丂(-_-;)

嘒儖乕僾偺嵟屻偵僂僃僀僩傪擖傟偰傒偨傜丄僄儔乕偺昿搙偑傔偪傖偔偪傖憹偊偨偗偳丄僄儔乕屻偺僂僃僀僩傪擖傟側偔偰傕屌傑傜側偔側偭偨丅

側傫偩偐側偀乣丂(-_-;)

庴怣偲憲怣偺愗傝懼偊偑栤戣側偺偐側丠丂偙傟側傜暋悢僒乕儃偺帪偱傕屌傑傞偙偲偺愢柧偼偱偒傞丅僔價傾側偺偼敾傞偗偳丄屌傑偭偪傖偆偺偼偪傚偭偲嫋偣側偄側偀丅僜僼僩偱儕僽乕僩偱偒側偒傖儘儃僢僩晹昳偠傖側偄傛偋丅僒乕儃偺僼傽乕儉僶僌偭偰偙偲偱忋偘偲偙偆丅

仭俆寧俇擔仭

榖戣偺摍恎戝儃僩儉僘傪尒偵悈摴嫶傊丅婰擮偺儃儖僩傪峸擖偟偰偒偨丅儃僩儉僘偡偘乕偗偳丄幚偼偦偺懠偺揥帵暔偺曽偵僞儅僔僀姶偠傑偟偨丅媫偑偝傟偨偺偐丄旀傟偨偺偐嶌昳乮丠乯偺嵶傗偐偝偑懌傝側偄姶偠丠丂偄傠傫側堄枴偱偄偄傕傫尒偣偰傕傜偄傑偟偨丅

崗報尒偊側偄偹丅(^^乁丂傑乕偄乕偐丅

崗報尒偊側偄偹丅(^^乁丂傑乕偄乕偐丅

偦偺懌偱傗偭傁傝廐梩尨傊丅崱擔偼儔儉僟偺攝慄梡嵽椏偲斅嬥愜傝嬋偘婡嘦偵巊偆儃儖僩傪攦偄偵丅朰傟傞偲偙傠偩偭偨偗偳丄偙側偄偩姧峴偝傟偨乽僸儏乕儅僲僀僪儘儃僢僩乿傕攦偭偰婣傠偆丅嬤偔偺杮壆偵偼抲偄偰側偄傫偩傕傫丅傑偩撉傫偱側偄偗偳乮偭偰偐丄撉傫偱偳偆側傞偭偰杮偠傖側偄偗偳偹乯儘儃僢僩惂屼偺偨傔偺嫵壢彂揑埵抲偯偗偵偼側傞偐側丅偙傟偩偗儊僯儏乕傪暲傋偨傜堦偮堦偮偺崁栚偼敄偔側傞傕傫偹丅奣榑埲忋偺栶偵棫偮偐偳偆偐偼晄柧丅夋憸張棟偺愱栧彂偼偨偔偝傫攦偭偨偗偳丄儊僯儏乕偑懡偄杮偼幐攕偑懡偄丅帺暘偑抦傝偨偄帠暱傕偨偄偰偄嵹偭偰傞偗偳丄栶偵棫偨側偄偺丅丂偦偆側傜側偒傖偄偄偗偳側偀丅

僒乕儃偑朶憱偡傞審偼枹偩夞摎側偟丅乮僒乕儃偺僼傽乕儉僶僌偩偲偟偰丄乯僼傽乕儉傾僢僾偲偐偱偒傞偺偐側丠偙偺僒乕儃丅丂怱攝偩側丅

僒乕儃偑朶憱偡傞審偼枹偩夞摎側偟丅乮僒乕儃偺僼傽乕儉僶僌偩偲偟偰丄乯僼傽乕儉傾僢僾偲偐偱偒傞偺偐側丠偙偺僒乕儃丅丂怱攝偩側丅

仭俆寧俉擔仭

僶儕僗僥傿僢僋曕峴丄恖宍偮偐偄偝傫偵嫵偊偰傕傜偆丅梫偡傞偵惃偄傪巊偭偰椡傪巊傢偢偵曕偔帠偺傛偆偩丅偦傟偦傟丅嫵偊偰傕傜偭偨榑暥奣梫偵偼嵟揔揰偺扵嶕偑崲擄偲彂偄偰偁傞丅偦傝傖偦偆偩傢側丅偱偒傟偽傕偆傗偭偰傞偭偰丅

俀懌曕峴儘儃僢僩偺惂屼偺戞堦偲偟偰乽偙偗側偄乿丄奜椡傗廳怱偺曄壔偵懳墳偟偰偙傜偊傞偭偰惂屼傪傗偭偰傒傛偆偲巚偭偨偺偩偗偳丄懌庱僒乕儃偺晧壸撉傒庢傝偐傜偦傟傪埵抲惂屼偵僼傿乕僪僶僢僋偲偐傗偭偰傒偨偗偳丄偳偆傕偟偭偔傝偙側偄丅傗偼傝僼傿乕僪僶僢僋僒僀僋儖偑挿夁偓傞傛偹丅偙傜偊傞偺偼惂屼揑偵偼擄偟偦偆偩偲敾抐偟偰丄偙偗偦偆側帪偵懌傪弌偡偨傔偺惂屼傪峫偊傞偙偲偵曽岦揮姺偡傞偙偲偵丅憗懍偩偗偳丄棃傞傋偒僶儕僗僥傿僢僋曕峴偺梊旛幚尡偲偟偰丄偗傝懌偱偺弶懍晅梌偱丄廳怱堏摦嵟彫偱偺懱廳堏摦偭偰偺傪傗偭偰傒傞偙偲偵丅懌庱偵偦傟偩偗偺僗僺乕僪偲僷儚乕偑偁傞偺偐側丠

偦傟偮偄偱偵丄暋悢僒乕儃惂屼僐儅儞僪偺僥僗僩傕傗偭偰傒傛偆丅丂偱丄傗偭偰傒偨傫偩偗偳丄丄丄儊乕儖偱偼僨乕僞偼忋埵丄壓埵偺弴偱廂傔傠偲偁傞偗偳丄偳偆傕娫堘偄偠傖側偄丠壓埵丄忋埵偺弴偩傛偹丅儊儌儕乕儅僢僾傕偦偆側偭偰傞偐傜偍偐偟偄側偲巚偭偨傫偩丅僐儅儞僪愢柧偺儊乕儖偱偼巜帵妏搙僨乕僞傪巜掕偟偰傞丅堏摦帪娫偺儊儌儕乕偵僨乕僞彂偒崬傓偲丄彂偒崬傫偩帪揰偱摦嶌傪巒傔傞傫偩傛偹丅巚偭偨偲偍傝丅帪娫丄妏搙偺弴偱擖傟傟偽傑偀偄偄偐丅偭偰彂偄偰偰婥偯偄偨偗偳丄巜帵妏搙偲堏摦帪娫偺儊儌儕乕偼椬偁傢偣偩偐傜丄堦搙偵巜掕偱偒傞偺偐傕丅屻傎偳傗偭偰傒傛偆丅

僉儏僀僉儏僀摦偐偟偰偨傜働乕僽儖偺旐暍偑傗傇傟偰偒偨丅(>_<)丂偪傖傫偲攝慄偟側偒傖側偀丅

傗偭傁偦偆偩偹丅傑偲傔偰揮憲偱偒傞丅偙傟側傜巊偊傞偹丅亜暋悢僒乕儃惂屼

仭俆寧俋擔仭

媣乆偵夛幮丅夛幮偵揮憲偟偰偄傞帺戭儊乕儖傪尒傞偲僗僺乕僔乕僘偐傜僒乕儃朶憱偺審偱儊乕儖偑丅丂偁傟偉乣婥偯偐側偐偭偨側丅婣偭偰尒偰傕偆偪偺儊乕儖儃僢僋僗偵偼柍偄丅峀崘儊乕儖偲堦弿偵幪偰偪傑偭偨偐丠丂寢嬊僒乕儃偺栤戣偼僼僞僶偵忋偑偭偨傛偆偱丄偟偽傜偔偼夞摎懸偪丅

僶儕僗僥傿僢僋曕峴傪峫偊傞丅

惃偄傪巊偭偰摦偔偭偰偙偲偼梀媟偼怳傝巕丠偩偲偡傞偲堏摦懍搙偼懌偺挿偝偱寛傑傞偺偐側丅偪偭偙偄儘儃僢僩偩偲僠儍僇僠儍僇曕偐側偄偲僟儊偩丅僒乕儃偑偮偄偰偙傟傞偺偐丠僒乕儃儌乕僞乕偵傕僊傾偑擖偭偰傞偐傜庴摦摦嶌偼柍棟丅僩儖僋傪偪傚偭偲偩偗梌偊偰曗彏偟偰傗傟偽偄偄偺偐側丅偱傕慄宍摦嶌偠傖曗彏偵側傜側偄偐傕丅偦傟偵偣偭偐偔梌偊偨弶懍偵懳偟偰僽儗乕僉偵側傞丠

嵍塃偺懱廳堏摦偵娭偟偰偼巟揰傪忔傝墇偊側偄搢棫怳傝巕丅偙傟側傜弶懍師戞偱墲暅懍搙偑挷惍偱偒傞丅傕偭偲傕懌偺挿偝偲廳怱偺偢傟偼塭嬁偡傞偐傜擄偟偄偭偰偙偲偵偮偄偰偼堦弿偩偗偳丅

懌庱偑惃偄偵墳偠偰嬋偑偭偰偔傟側偄偲傑偢偄傢偗偩偐傜丄僒乕儃偺僐儞僾儔僀傾儞僗僗儘乕僾愝掕傪帋偟偰傒偨丅偍偭丄偙傟偼柺敀偄(^.^)丂懌庱僒乕儃偵愝掕偟偰傒傞偲丄僒僗儁儞僔儑儞偑擖偭偨傒偨偄偵傆偵傖傆偵傖偡傞丅僗儘乕僾偑捈慄偟偐側偄偺偑巆擮丅巜帵妏晅嬤偼僩儖僋偑庛偡偓傞姶偠丅仼僷儞僠偺愝掕偡傟偽傑偟偵側傞偺偐傕丅丂偙傟丄懌庱偵巊偭偨傜丄巜帵妏搙偱巭傑傜側偔側傞傢偗偩偐傜丄僒乕儃偼偟傫偳偄偺偐側丠

仭俆寧侾侽擔仭

嵍塃懱廳堏摦偺専摙傪峴偆偨傔偵娙扨側儌乕僔儑儞嵞惗僾儘僌儔儉傪嶌傞偙偲偵丅

傾僀儃偺応崌偼丄嵟戝16僼儗乕儉暘偺僨乕僞傪1僷働僢僩偵傑偲傔傞偙偲偑偱偒偰丄僷働僢僩張棟帪娫枅偵娭悢偑屇偽傟偨丅偟偐偟丄偐側傜偢8ms枅偺僼儗乕儉僨乕僞傪梡堄偡傞昁梫偑偁偭偨丅僼僞僶偺僒乕儃偺応崌丄巜帵妏搙傊偺摓払帪娫傪巜掕偱偒傞偐傜偐側傜偢偟傕嵟彫僼儗乕儉枅偺僨乕僞傪梡堄偡傞昁梫偼側偄偺偩偗傟偳丄娭悢屇傃弌偟傪偦傟偵摨婜偝偣傞偭偰偺偑擄偟偄偺偱娭悢屇傃弌偟偼掕帪偵偟偰僀儞僞乕僶儖僞僀儅乕偱屇傃弌偡丅昁梫偵墳偠偰僒乕儃偵僐儅儞僪傪憲傞偭偰姶偠偐側丅僒乕儃偵栤偄崌傢偣傟偽栚昗傊偺摓払傪僠僃僢僋偱偒傞偗偳丄張棟帪娫偑傕偭偨偄側偄偐傜偦傟偼傗傜側偄丅丂偦傟傛傝丄専摙梡側傫偩偐傜丄奺僼儗乕儉偱偺妏搙僨乕僞偲偐晧壸僨乕僞偲偐傪庢摼偱偒傞傛偆偵偡傞傋偒偩側丅偙偺僒乕儃丄忣曬庢摼偺帪偺僷働僢僩挿偑挿偔偭偰僨乕僞庢摼偵帪娫偑偐偐傞偺偑偪傚偭偲栤戣丅偦偺偁偨傝傕夵慞偟偰梸偟偄側丅

儌乕僔儑儞嵞惗傛傝扨堦摦嶌傪僷儔儊乕僞偱愝掕偱偒傞傛偆偵偡傋偒偐側丅嵟揔揰偺扵嶕傕傗偭偰傒偨偄偟丅丒丒丒傗偭傁傝俬俲娭悢嶌偭偨曽偑偄傠偄傠曋棙偐側丅偝偭偝偲嶌偭偪傑偍偆丅

偗傝弌偟偑揔愗偐偳偆偐傪敾掕偟側偗傟偽側傜側偄丅偙偺忣曬偼僕儍僀儘傪巊偊側偄偐側乕偭偰峫偊偰偨丅杮摉偼壛懍搙忣曬偑堦斣側傫偩偗偳丄壛懍搙僙儞僒乕偺僨乕僞偭偰僲僀僕乕偩偭偨妎偊偑丅傾僀儃偺曕峴専摙偱傕帡偨傛偆側偙偲傗偭偨側偀丅偦偆偄傗偆傑偔峴偐側偐偭偨側丄偁偺帪偼丅丅(~_~)

塝戲捈庽偺乽PLUTO乿偑戞俋夞庤捤廋暥壔徿傪庴徿偟偨丅埲慜偵塝戲捈庽偑側傫偐傪庴徿偟偨帪偵峅寭寷巎偑丄偙偺恖偼憗偔怰嵏堳偵偟側偄偲徿傪慡晹庢偭偪傖偆偭偰偙偲傪昡偵彂偄偰偨(^_^;)丅丂偦傟偼忕択偵偟偰傕丄徿傪庢傞傛偆側嶌昳傪偳傫偳傫憂憿偡傞恖偵偼偳傫偳傫嶌昳傪嶌偭偰傕傜偭偰偳傫偳傫徿傪偁偘傟偽傛偄丅怰嵏堳偼偦偆偄偆偺傪嶌傟側偔側偭偨恖偑傗傟偽偄偄傕傫偹丅偮傑傝怰嵏堳偺埶棅偭偰丄憂憿幰偵懳偡傞嵟屻捠払偐丅

僼僞僶偺僒乕儃丄儊乕僇乕偱忈奞嵞尰偟偨傜偟偄丅儓僇僢僞(^_^;)丂偝偀丄偝偭偝偲懳嶔偟偲偔傟偉乣丅

仭俆寧侾侾擔仭

媡塣摦妛偺寁嶼傔傫偳偔偝偄側乕丅崅峑悢妛偲偼偄偊丄悢妛嬯庤偩丅偦偆偄傗丄偙側偄偩攦偭偨乽僸儏乕儅僲僀僪儘儃僢僩乿偵媡塣摦妛寁嶼偺夝愅揑夝朄偺椺偑弌偰偨側丅丂傆傓丄傆傓丒丒丒丄atan2(丂)偭偰側傫偩傠巊偭偨偙偲側偄傫偱偡偗偳(-_-;)丂丂娭愡峔惉偑偪傚偲堘偆偺偱嶲峫偵偟偐側傝傑偣傫偱偟偨丅乮敾偭偰偨偗偳乯

儔儉僟乮幚暔乯傪偄偠偔傝側偑傜傗偭偰偨傜丄壜摦斖埻傪奼偘偨偔側偭偰偒偨丅彨棃偵搉偭偰晄梫偐傕偟傟側偄偗偳丄傊傫側宍偵側傞偗偳丄偙傟偱壜摦斖埻偑悘暘偲峀偑傞丅崱搙偺媥傒偵傗傞婥偵側偭偨傜嶌傠偆丅

塭偵側偭偪傖偭偨丅丂

塭偵側偭偪傖偭偨丅丂 傊傫偰偙側宍偩側偀乣丅(>_<)

傊傫偰偙側宍偩側偀乣丅(>_<)

仭俆寧侾係擔仭

媡塣摦寁嶼幃偑傗偭偲偱偒偨丅戝戁偵傂偹傝幉帩偭偰偒偨偐傜偪傚偭偲傔傫偳偔偝偐偭偨丅傾僀儃偲堘偭偰懌庱傕偁傞偟偹丅纟傪忋偘偨帪偺寁嶼偼傑偨崱搙丅堦墳偙偺寁嶼幃偱摦偐偣傞傛偆偵偟偰傒傛偆丅偱傕専嶼偟偰側偄偐傜儅僘僀偐側乣丅

崢晹僼儗乕儉傪嶌傝捈偡偺偵晹暘揑偵暘夝偟偨傫偩偗偳丄寢峔僱僕娚傫偱傞偹丅掲傔朰傟偐傕偟傟側偄偗偳丅儘僢僋僞僀僩偟偨偔側偄偗偳嵟廔揑偵偼備傞傒巭傔偟側偄偲傑偢偄傛側偀丅

崢晹僼儗乕儉嶌傝捈偟丅壜摦斖埻偑偦偙偦偙峀偑偭偨丅

崢晹僼儗乕儉嶌傝捈偟丅壜摦斖埻偑偦偙偦偙峀偑偭偨丅

仭俆寧侾俆擔仭

媡塣摦寁嶼幃偱儔儉僟傪摦偐偟偰傒偨丅傑乕偪傚偭偲娫堘偄傕偁偭偨偗偳丄僞儞僕僃儞僩巊偆帪偼堎忢抣偺張棟偲偐偑傔傫偳偔偝偄偹丅偁丄atan2(

)傪巊偭偰傒偨傫偩偗偳丄僄僋僙儖偺偲libm偺atan2( )偱丄堷悢偑堘偆偙偲傪抦傜偢偵擸傫偱偟傑偭偨丅戝戁偺娭愡峔憿偑偪傚偭偲摿庩側傫偱丄妏搙偑儕僯傾偵摦偄偨傜曗娫偟側偄偲偆傑偔側偄偲偒傕偁傞偐傕丅偦偺曈傕峫椂偟偰惂屼廃婜傪寛傔側偒傖丅

傑偭偨偔傕偭偰扨弮側僾儘僌儔儉偩偗偳丄僗僋儚僢僩傪偝偣偰傒偨丅WMV偱傾僢僾偟偨偐偭偨偗偳丄曄姺偑偆傑偔偄偐側偐偭偨偐傜MOV偱丅

墶岦偒偩偟丄MOV偩偟丄孅怢偟偰傞偩偗偺摦夋偩偗偳丄俆MB傕偁傞偟丄僋儕僢僋偟偰屻夨偟側偄傛偆偵偍婅偄偟傑偡丅<m(__)m>

墶岦偒偩偟丄MOV偩偟丄孅怢偟偰傞偩偗偺摦夋偩偗偳丄俆MB傕偁傞偟丄僋儕僢僋偟偰屻夨偟側偄傛偆偵偍婅偄偟傑偡丅<m(__)m>

MOV偐傜MP4偵偟偰傒偨丅偙傟偱WMP偩偗偱尒傟傞傫偠傖側偄偐側丠俈俆侽KB偵傑偱偪偭偙偔側偭偨偟丅偨偩偟墶岦偒偺傑傑丅

仭俆寧侾俇擔仭

偙側偄偩怴暦傪撉傫偱偨傜丄揤奜巉楴偝傫乮搚堜棙拤偝傫乯偑乽峫偊傞擼 峫偊傞僐儞僺儏乕僞乕乿偺彂昡傪彂偄偰偨丅偁偁丄偁偪偙偪偱徯夘偝傟偰偨杮偩乣丅丂恖娫偺峴摦丒巚峫偼梊應傛傝惉傝棫偭偰偄傞丅丂偁傞掱搙慜採偩偲巚偭偰偨傫偩偗偳丄悽娫揑偵偼偦偆偱傕側偐偭偨偺偐側乕丅偳偆傝偱乽恖岺抦擻妛乿偭偰暘栰偑僷僘儖偺夝朄偲偐偱傕偨傕偨偟偰傞傢偗偩側偲偐巚偭偰偨丅柺敀偦偆偩偐傜攦偭偰撉傓偙偲偵丅丂偦偺彂昡偵丄巹傕僷乕儉僷僀儘僢僩乮偺傛偆側傕偺乯傪嶌偭偨偑丄憗偡偓偰幐攕偩偭偨偭偰彂偄偰偨偗偳丄僜僯乕丄偦傫側偺弌偟偨偭偗丠

偙側偄偩怴暦傪撉傫偱偨傜丄揤奜巉楴偝傫乮搚堜棙拤偝傫乯偑乽峫偊傞擼 峫偊傞僐儞僺儏乕僞乕乿偺彂昡傪彂偄偰偨丅偁偁丄偁偪偙偪偱徯夘偝傟偰偨杮偩乣丅丂恖娫偺峴摦丒巚峫偼梊應傛傝惉傝棫偭偰偄傞丅丂偁傞掱搙慜採偩偲巚偭偰偨傫偩偗偳丄悽娫揑偵偼偦偆偱傕側偐偭偨偺偐側乕丅偳偆傝偱乽恖岺抦擻妛乿偭偰暘栰偑僷僘儖偺夝朄偲偐偱傕偨傕偨偟偰傞傢偗偩側偲偐巚偭偰偨丅柺敀偦偆偩偐傜攦偭偰撉傓偙偲偵丅丂偦偺彂昡偵丄巹傕僷乕儉僷僀儘僢僩乮偺傛偆側傕偺乯傪嶌偭偨偑丄憗偡偓偰幐攕偩偭偨偭偰彂偄偰偨偗偳丄僜僯乕丄偦傫側偺弌偟偨偭偗丠

偁偲丄乽傾儞僪儘僀僪偺擼乿偭偰偺偑柺敀偦偆偩偭偰偄偆傫偱攦偍偆偐偲巚偭偨偗偳丄撪梕徯夘傪撉傓偲側乕傫偲側偔偄傗側梊姶丅俀俀侽侽墌乮惻暿乯傕偡傞偟丄偪傚偭偲寈夲偟偰拞恎傪尒偰偐傜撉傓偐偳偆偐寛傔傛偆偲巚偭偨丅崱擔丄夛幮偺婣傝偵杮壆偱儁儔儁儔尒偰傒偨偗偳梊憐偳偍傝偺姶偠丅儘儃僢僩嶌傝偨偄偭偰儎僣乮帺暘偺傛偆側乯偵偼柺敀偦偆側丄僸儞僩偵側傝偦偆側偙偲枮嵹側傫偩偗偳丄側傫偱偁偭偪偺恖偺暥復偭偰偙偆丄丄丄撉傒偵偔偄傫偩傠偆丅偄傜傫偙偲彂偐側偄偲偡偖彂偔偙偲柍偔側傞偐傜偐側丠丂偱傕丄恖岺惗柦傪嶌偭偰偄偔條巕偼崅峑1擭惗偺帪偵撉傫偩乽儅僀僐儞丒儘儃僢僩偺嶌傝曽乿傪巚偄弌偝偣偰偔傟偨丅傕偺偡偛偔僥儞僔儑儞忋偑偭偰杮偺傑偹傪偟偰儘儃僢僩乮儚儞儃乕僪儅僀僐儞偱儌乕僞乕傪惂屼偟偰僜僫乕偲偐僞僢僠僙儞僒乕傪搵嵹偟偰傞乯傪嶌偭偨偺偑杔偺儘儃摴偺巒傑傝偩偭偨側丅丂偁偺帪偲摨偠崅梘乮丠乯傪摼傜傟傞偲偼巚傢側偄偗偳丄撉傫偱傒傛偭偲丅

偁偲丄乽傾儞僪儘僀僪偺擼乿偭偰偺偑柺敀偦偆偩偭偰偄偆傫偱攦偍偆偐偲巚偭偨偗偳丄撪梕徯夘傪撉傓偲側乕傫偲側偔偄傗側梊姶丅俀俀侽侽墌乮惻暿乯傕偡傞偟丄偪傚偭偲寈夲偟偰拞恎傪尒偰偐傜撉傓偐偳偆偐寛傔傛偆偲巚偭偨丅崱擔丄夛幮偺婣傝偵杮壆偱儁儔儁儔尒偰傒偨偗偳梊憐偳偍傝偺姶偠丅儘儃僢僩嶌傝偨偄偭偰儎僣乮帺暘偺傛偆側乯偵偼柺敀偦偆側丄僸儞僩偵側傝偦偆側偙偲枮嵹側傫偩偗偳丄側傫偱偁偭偪偺恖偺暥復偭偰偙偆丄丄丄撉傒偵偔偄傫偩傠偆丅偄傜傫偙偲彂偐側偄偲偡偖彂偔偙偲柍偔側傞偐傜偐側丠丂偱傕丄恖岺惗柦傪嶌偭偰偄偔條巕偼崅峑1擭惗偺帪偵撉傫偩乽儅僀僐儞丒儘儃僢僩偺嶌傝曽乿傪巚偄弌偝偣偰偔傟偨丅傕偺偡偛偔僥儞僔儑儞忋偑偭偰杮偺傑偹傪偟偰儘儃僢僩乮儚儞儃乕僪儅僀僐儞偱儌乕僞乕傪惂屼偟偰僜僫乕偲偐僞僢僠僙儞僒乕傪搵嵹偟偰傞乯傪嶌偭偨偺偑杔偺儘儃摴偺巒傑傝偩偭偨側丅丂偁偺帪偲摨偠崅梘乮丠乯傪摼傜傟傞偲偼巚傢側偄偗偳丄撉傫偱傒傛偭偲丅

仭俆寧侾俈擔仭

媡塣摦寁嶼幃傪梡堄偟偰丄2忬懺傪墲暅偝偣傞偩偗偱孅怢塣摦偑姰惉偟偪傖偆丅廫暘偵懌棤偑峀偄偐傜偭偰榖側傫偩偗偳丄懌棤偺彴斀椡傪僼傿乕僪僶僢僋偟偰僶儔儞僗庢傝側偑傜偺孅怢偲偐偝偣偨偄丅

恖偑摨偠摦嶌傪傗傞偲偒偼忢偵僒儞僾儕儞僌亅僼傿乕僪僶僢僋偟偰傞傢偗偠傖側偔丄廫暘偵嵟揔壔偝傟偨屻偼乽娔帇乿偟偮偮丄嵟揔壔偝傟偨摦嶌傪幚峴偡傞偭偰姶偠偵巚偊傞丅廫暘偵妛廗偝傟偨忬懺偩偲丄媡塣摦寁嶼偵嬤偄摦偒傪偡傞偙偲偑偱偒傞偗偳丄僀僐乕儖乽惂屼偝傟偨摦偒乿偱偼側偄丅昁偢僼傿乕僪僶僢僋偑昁梫側偼偢丅崌栚揑揑側惉岟偺僀儊乕僕偲偺偢傟傪曗惓偟側偑傜摦嶌偡傞偼偢丅

嵟揔壔偺偨傔偺妛廗偺僔僗僥儉偑昁梫丅偱偒傟偽妛廗寢壥偐傜憡娭娭學傪傒偰嵟揔僷儔儊乕僞梊應偱偒側偄偐側丅暘栰揑偵偼僯儏乕儔儖僱僢僩偲偐椙偝偦偆側傫偩偗偳丄側傫偲側偔巊偄偨偔側偄丅偪傚偭偲曌嫮偟傛偆丅

媡塣摦寁嶼偵摲懱偺嬄妏傪擖傟偰傒偨丅娙扨偦偆偩偗偳寢峔擄偟偄丅孅怢偼娙扨偵偱偒偨偗偳丄偍帿媀偼僶儔儞僗庢傟側偐偭偨丅娙扨偠傖側偄傗丅偲傝偁偊偢丄暊嬝塣摦偵曄峏丅(^^乁丂偁偲偼偮傑愭棫偪傪慻傒崬傫偩傜媡塣摦寁嶼乮懌曃乯偼廔椆丅幚偼懌傪忋偘偡偓傞偲寁嶼寢壥偑偍偐偟偔側傞丅晞崋偑曄傢傞偲偙偩側丄偒偭偲丅

媡塣摦寁嶼偵摲懱偺嬄妏傪擖傟偰傒偨丅娙扨偦偆偩偗偳寢峔擄偟偄丅孅怢偼娙扨偵偱偒偨偗偳丄偍帿媀偼僶儔儞僗庢傟側偐偭偨丅娙扨偠傖側偄傗丅偲傝偁偊偢丄暊嬝塣摦偵曄峏丅(^^乁丂偁偲偼偮傑愭棫偪傪慻傒崬傫偩傜媡塣摦寁嶼乮懌曃乯偼廔椆丅幚偼懌傪忋偘偡偓傞偲寁嶼寢壥偑偍偐偟偔側傞丅晞崋偑曄傢傞偲偙偩側丄偒偭偲丅

乮MP4丗445KB乯

摲懱偺嬄妏傪媡塣摦寁嶼偵擖傟偨偺偼偪傚偭偲慜屻僶儔儞僗偭偰偺傪傗偭偰傒偨偄偐側乕偭偰巚偭偨偐傜丅

偙偆側傞偲庤偑幾杺偩側乕丅崱偼庤偵偼僩儖僋傪擖傟偰側偄丅僽儔僽儔忬懺丅

仭俆寧俀俀擔仭

摲懱偺嬄妏傪壛偊偨媡塣摦寁嶼偼偄傠偄傠娫堘偭偰偨丅壗搙偐偺挧愴偺枛偵傗偭偲惓夝偵帄偭偨傛偆偩丅傎偋乣丅丅

儔儉僟偺娭愡峔憿偺応崌丄嵍塃偺孹偒側傜娙扨側偺偩偑丄慜屻偺孹偒偼寁嶼偑柺搢丅丂偱傕丄偙傟偱偮傑愭棫偪偺媡塣摦妛寁嶼傕弌棃偨傕摨慠丅

偭偰偄偭偰傕娭愡妏搙寁嶼偱偒傞傛偆偵側偭偨偩偗偩偐傜偝偟偨傞恑曕偱偼側偄偺偩丅

乽傾儞僪儘僀僪偺擼乿傑偩撉傒廔傢偭偰側偄偗偳丄Web儁乕僕傪尒偨丅儖乕僔乕偑摦偄偰偄傞摦夋偑傾僢僾偝傟偰傞傫偩偗偳丄偁偺摦偒偼杮偵彂偄偰偁傞傾僾儘乕僠偱儖乕僔乕偑帺敪揑偵摦偐偟偰傞偺偩傠偆偐丠偦偆偱偁傟偽偡偛偄偗偳丄僾儘儌偭傐偄側丅

儖乕僔乕奐敪偺傾僾儘乕僠偼偡偛偔嫽枴怺偄丅怗敪偝傟偰摨偠帠傪傗傝偨偔側傞乮偭偰偄偆偐丄儘儃僢僩岺妛傪曌嫮偟側偄偱儘儃僢僩傪嶌傠偆偲偟偨傜偁偁偄偆傾僾儘乕僠偵側傞傫偠傖側偄偐偲巚偆丅乯傕偭偲傕丄偦偺傾僾儘乕僠傪幚嵺偵峴偆偨傔偵偼儘儃僢僩岺妛傪曌嫮偡傞傛傝傕梱偐偵懡婒偵媦傫偩抦幆偲峫嶡偑昁梫偱偁傞偺偼娫堘偄側偄偺偩偑丅丂杔傕媡塣摦妛幃傪弨旛偟側偄偱丄儔儉僟偺娭愡傪帺桼偵摦偔傛偆偵偟偰媡塣摦妛偵憡摉偡傞娭愡偺摦嶌朄懃乮丠乯傪夛摼偡傞傛偆側妛廗僔僗僥儉傪嶌偭偰傒偨偄偑丄堄枴偺偁傞摦嶌傪峴偊傞傛偆偵側傞傑偱壗廫擭偐偐傞偐傢偐傜傫丅丂儖乕僔乕偺傾僾儘乕僠偼僴乕僪僂僃傾偼恑壔偵傛傝夛摼偟偨僔僗僥儉傪弨旛偟偰丄僜僼僩偼妛廗偵偰宍惉偟傛偆偲偟偰偄傞偑丄僴乕僪偲僜僼僩偺娫偵偁傞僼傽乕儉僂僃傾揑側晹暘偵偼偁傑傝栚傪岦偗偰偄側偄傛偆偵尒偊傞丅僜僼僩偲偟偰埵抲偯偗偰偄傞傕偺偑惗傑傟偰偐傜妛廗偡傞屻揤揑晹暘偲偟偰傕丄僴乕僪偲僼傽乕儉偼摨帪偵恑壔偟偰偒偨偼偢偩偐傜僴乕僪偩偗弨旛偟偰傕僜僼僩偼宍惉偱偒側偄偼偢丅偦偺偁偨傝偼偳偆峫偊偰偄傞偺偐側乕丅丂傑偩撉傒廔傢偭偰側偄偺偱屻敿偵岅傜傟傞偺偐傕丄婜懸偟傛偆丅丂偙傟偐傜帇妎偺晹暘偵擖傞偗偳丄堦斣椡擖偭偰傞偲偙傠傜偟偔丄柺敀偦偆丅偄傠偄傠偲妛傇偲偙傠偑偁傝偦偆丅

偝偰丄丄丄師偼壛懍搙傪惂屼偟側偒傖側傜側偄偼偢側傫偩偗偳丄僐儅儞僪宆僒乕儃偱偦傟偼擄偟偄丅丂側傫偲偐夞旔偡傞庤棫偰偼側偄傕偺偐丅丅

崱擔偼媡塣摦寁嶼偺傑偲傔乮専嶼偲婰榐傪寭偹偰乯偲丄僙儞僒乕儃乕僪傪偪傚偙偭偲偄偠偭偰傒偨丅僕儍僀儘傪俁幉偵偟偰偐傜僙儞僒乕忣曬偭偰庢摼偟偰傒偰側偐偭偨丅偆傫丅偪傖傫偲僨乕僞庢傟偰傞偹乕丅偙偆偟偰弌棃崌偄偺儃乕僪傪攦偭偰偮側偖偲妝僠儞偱巇曽側偄丅庢傝晅偗曽傪曄偊偰偄傞偺偱僨乕僞偺妱傝摉偰偑曄傢偭偰傞偺偵拲堄偟偰丄壛懍搙僨乕僞傕妏懍搙僨乕僞傕OK偱偡丅

偝偰丄偙傟傪巊偭偰娙扨側巔惃惂屼偺僾儘僌儔儉傪彂偄偰傒傛乕偭丅丂柧擔偐傜丅丅

仭俆寧俀俁擔仭

乽傾儞僪儘僀僪偺擼乿傪撉傓偲姶奡怺偄偲偙傠偑偁傞丅

恖岺抦擻偵偮偄偰堦惗寽柦峫偊偰偄偨崰偑偁傞丅偦偺崰丄恖娫偺擼偺杮傗擣抦岺妛偺杮側偳傪寢峔撉傫偩丅傑偨恖岺抦擻岺妛偺杮傕撉傫偩偺偩偑丄恖岺抦擻岺妛偵偮偄偰偼庱傪偐偟偘傞帠偽偐傝偩偭偨丅尋媶偵廬帠偟偰偄傞恖偨偪偼杮摉偵丄備偔備偔偼恖岺抦擻傪嶌傝偨偄偲巚偭偰偄傞偺偩傠偆偐丠側偤堎忢側傑偱偵忦審傪峣傝崬傫偩忬懺偱偺栤戣乮僒儔儕乕儅儞弰夞栤戣偲偐乯偺悢妛揑夝朄側傫偐傪峫偊偰偄傞偺偩傠偆偐丅晄巚媍偱巇曽側偐偭偨丅寢嬊丄帺暘偑恖岺抦擻偵彮偟偱傕嬤偯偔偵偼恖岺抦擻岺妛偼晄梫偩偲敾抐偟偰偦偺椶偺曌嫮偼傗傔偰偟傑偭偨丅乮僯僼僥傿乕僒乕僽偺俙俬僼僅乕儔儉偱丄恖岺抦擻忋偱帪娫偺奣擮偭偰偳偆昞尰偡傞傫偱偡偐丠偭偰幙栤偟偰傒偨傜丄乽僞僀儅乕偱偄偄傫偠傖傫丠乿偭偰摎偊偑桳偭偰偐傜晄怣姶偑曞偭偰偨偭偰偺傕偁傞偗偳丅乯

偦偺屻丄抦擻偵偼奜奅偵摥偒偐偗傞擻椡偑昁梫偱丄帇妎丒堏摦擻椡丒暔懱傪怗傟偨傝偮偐傫偩傝偡傞擻椡偑嵟掅尷昁梫偲巚偆傛偆偵側偭偨丅堏摦擻椡偼幵椫偲憖懬偱傕偄偄傫偩偗偳丄乽堏摦庤抜偺妉摼乿偲偄偆僥乕儅傕柺敀偦偆側偺偱懌偑柺敀偄偐偲巚偭偨丅傾僀儃偼偦偆偄偆堄枴偱尋媶偵偼偆偭偰偮偗偺戣嵽偩偭偨偺偩偗偳丄恎懱惂屼偲偄偆娤揰偱偼帺桼搙偑懌傝側偄偲偐俀懌傪傗傝偨偄偲偐偄偆婥帩偪偐傜俀懌偵庤傪愼傔傛偆偲偟偰傞丅

峫偊傞偲帺暘偺巚偆偲偙傠偑偁傝側偑傜怓乆側棟桼傪弬偵側傫偲側偔棳峴偵棳偝傟偨傝峫偊傪廋惓偟偨傝偟偰偄傞帺暘偑偄偰丄抪偢偐偟偄婥帩偪偵側偭偨丅恎懱惂屼偺妛廗丒嵟揔壔側偳偺尋媶傪偡傞偵偼僐儅儞僪宆僒乕儃偼偆傑偔側偔丄傑偨丄僩儖僋傗僐儞僾儔僀傾儞僗傪儕僯傾偵惂屼偱偒側偄捠忢偺儔僕僐儞僒乕儃偱偼婡擻偑懌傝側偔丄傑偨儕傾儖偵僒乕儃傪惂屼偡傞偨傔偺儅僀僐儞偲擼乮戝擼偲偐彫擼乯偲側傞僐儞僺儏乕僞傪儕傾儖偵偮側偖僔僗僥儉乮偣傔偰嫟桳儊儌儕僔僗僥儉乯偲偐丄帺暘偱峔抸偟側偒傖側傜側偄傫偩傠偆側偲巚偆丅

傑偀丄偦傟偼偝偰偍偒丄堄尒偲偟偰偼丄儘儃僢僩乮傾儞僪儘僀僪偱傕乯傪峔抸偡傞偺偵恖娫傗椶恖墡傪偄偔傜恀帡偰傕捛偄偮偐側偄偲巚偆丅忋壓偐傜偺峌傔偑愨懳偵昁梫偱丄惂屼岺妛偵屌傔傜傟偨晹暘偲僐僱僋僔儑僯僘儉乮傒偨偄側偺丄偳傫側偺偑惓夝偐傢偐傜傫乯偵摫偐傟偨晹暘偑偆傑偔梈崌偡傞僔僗僥儉傪嶌傝弌偝側偒傖側傜側偄偲巚偆丅嬼慠偵棅傞傢偗偵偼峴偐側偄偩傠偆丅儖乕僔乕偱偺傾僾儘乕僠偩偲崺拵偼挻偊傜傟側偄傛偆側婥偑偡傞側偀丅偁偲俀乣俁抜偺僕儍儞僾偑偄傞丅偙偺挷巕偩偲師偺儖乕僔乕乮庤懌偑懙偆梊掕乯傕彴偱傕偧傕偧偡傞偩偗側偺偱偼側偐傠偆偐丅曕偒弌偟偨傝偟偨傜懡暘廆巪懼偊丅

偦偆偄偆傢偗偱丄懌儗儀儖丄榬儗儀儖偱偺媡塣摦妛寁嶼偭偰偺偼愜崬嵪傒偱傛偄偲巚偭偰傞丅偦偙偐傜愭偺僟僀僫儈僢僋晹暘傪偳偆偡傞偐偭偰偺偑儊僀儞偵側傝偦偆側梊姶丅偦偙偱俠俹俧偵婜懸戝丅堷偒崬傒尰徾偭偰偺傪偠偭偔傝偲嬦枴偟偨偄偲峫偊偰傞丅

偲偙傠偑俠俹俧偵娭偡傞帒椏偭偰偁傫傑傝尒側偄丅CPG偱専嶕偟偰傕愱栧彂傜偟偒傕偺偵摉偨傜側偄偟丅偙傑偭偨側丅

俆寧俀係擔仭

恎懱摦嶌偲偺摨婜

娭愡偱愙懕偝傟偨恎懱傪丄偄偔傜戝傑偐偵寁嶼偟偰傕侾揰廳怱偲偟偰懆偊偰塣摦傪峫偊傞傢偗偵偼偄偐側偄偩傠偆丅娭愡偱偺偑偨偮偒傗幚嵺偺娭愡偺摦偒側偳偐傜峔憿偺乽傗傢傜偐偝乿偑弌偰偟傑偆丅偦偺摦嶌偵偮偄偰偼巟揰晹偲嶌梡晹偱憡摉側抶傟偑惗偠偰偟偐傞傋偒偱丄侾揰廳怱偺峫偊曽偩偲丄忢偵崉懱偲偟偰懆偊偰偄傞帠偵側傞丅

恖偺応崌偱傕丄椡傪敳偄偨曕峴傪偟偰偄傞帪偼崉懱偲偼掱墦偄丄傗傢傜偐偄忬懺側偺偱摨婜偡傞偵偼旕忢偵掅偄怳摦悢偲側傞偼偢偱偁傞丅椡傪敳偄偨曕峴偱偼偦偺掅偄怳摦悢偵崌傢偣偨曕挷偲側傞偨傔丄備偭偔傝偲偟偨曕傒偵側傞丅丂斀偟偰媫偄偱曕偔応崌丄偙傟偼奺娭愡偵椡傪崬傔偰摨挷偡傞怳摦悢傪忋偘偰丄栚揑偲偡傞曕挷傪妋曐偡傞偙偲偵側傞丅峏偵慺憗偄摦嶌偑昁梫側帪偼丄弌棃傞偩偗崉懱偲偟偰峫偊傜傟傞傛偆偵椡傪崬傔偰懱傪娵傔丄栚揑偲偡傞懍搙乮怳摦悢乯偱偺摦嶌偑壜擻側傛偆偵挷惍偡傞偲峫偊傜傟傞丅

CPG偼廃婜傪弌椡偱偒偰丄奜棎偵懳偟偰摨婜偡傞偙偲偑偱偒傞偗偳丄廃婜撪偺僇乕僽傪婰壇丒嵞尰偡傞偙偲偼偱偒傞偺偩傠偆偐丠

偨偲偊偽丄僽儔儞僐丅梫偼怳傝巕側偺偩偑丄巕嫙偼僽儔儞僐偵摨婜偟偰梙傟傪憹暆偝偣傞丅偁偺帪丄姶偠偰偄傞偺偼梙傟偺廃婜偩偗偱偼側偔偰妋偐偵梙傟偺僇乕僽傪姶偠偰偄傞丅怳傟偑嵟戝偺晹暘偱偼懍搙偑抶偔側傝傗偑偰栠偭偰偄偔偙偲傪丄傕偭偲傕抧柺晅嬤偱偼傕偭偲傕懍搙偑弌偰偄傞偙偲傪懱尡偐傜抦偭偰偄傞丅偦偟偰丄梙傟偵摨婜偝偣傞帪偵偼偦偺姶妎傪棙梡偟偰偄傞偲巚傢傟傞丅

側傫偲偐偙傟傪儌僨儖壔偡傞傾僀僨傿傾偼側偄偩傠偆偐丅

恖娫偼偳偺傛偆偵側偭偰偄傞偺偐撪娤偟偰傒傞丅

姶妎偑姶偠傜傟傞帪娫偺挿偝偼桳尷偱丄寢峔抁偄丅戝懱丄僞儞僞儞偔傜偄丅偁偲偼偦傟傪堄幆揑偵寁悢偟偰挿偔偡傞丅

僞乕乕儞偲偄偆偺偼僐僐儘偺側偐偱僞傾傾傾儞偲曄姺偟偰偄傞丅姶偠傜傟傞斖埻偱偺帪娫偺暘夝擻偼憡摉嵶偐偄丅偨偩丄堄幆偱偒傞偐偳偆偐偼彫擼偺敪払嬶崌偱曄傢傞傛偆側婥偑偡傞丅乮偙偙偱偼彫擼偺姶妎傪戝擼偑庴偗庢傞偲偄偭偨堄枴偱偺敪払乯

側偐側偐偄偄傾僀僨傿傾傕晜偐偽側偄偺偱偲傝偁偊偢偼嵍塃偵懱傪梙偡傞柍尷儌乕僔儑儞傪嶌偭偰傒偨丅曅摴侽丏俁昩偵愝掕偟偨傜丄戝懱摨婜偟偨姶偠丅傂傚偙傂傚偙偲曕偒弌偟偨丅偄傑偼僒乕儃偺僐儞僾儔僀傾儞僗愝掕傪憡摉娚傔偵偟偰傞偐傜備偭偝備偭偝偟偰傞丅偙傫側傫偱傕摦偒弌偡偲偆偒偆偒偡傞偹丅傑偀丄惂屼偟偰側偄偐傜捈偖僐働儖偗偳丅偙偺摨婜廃攇悢傪帺暘偱尒偮偗傞傛偆偵偟偨偄傫偩傛偹丅偦偟偰丄摨婜偟偰悂偭旘偽側偄傛偆偵惂屼偱偒傞傛偆偵偟偨偄丅

俆寧俀俆擔仭

儔儉僟偺奜憰傪嶌傝偨偄側乕丅偭偰偄偆偐丄愝寁偟偰傞帪偐傜偪傖傫偲奜憰偮偗傛偆偭偰巚偭偰偨傫偩偗偳丄奜憰側傫偰丄奜憰偁傝偒偱愝寁偟側偒傖偆傑偔偱偒傞傕傫偠傖側偄偹丅俁俢CAD偺慜偱壗搙彂偄偰偼徚偟偰傪孞傝曉偟偨偐丅幚嵺偵嶌傟傞宍丒峔憿偱丄僨僓僀儞揑偵桪傟偰偄傞丄偦偟偰撪憻暔偑偡偱偵寛傑偭偰傞偭偰忦審偩傕傫丅側偐側偐弌棃側偄丅庤懌偺僀儊乕僕偐傜丄嶲峫偵偡傞偺偼僈儞僟儉偵弌偰偔傞僓僋偐側乕偭偰峫偊偰偨偗偳丄僓僋偼偁傫傑傝岲偒偠傖側偄偟丄僈儞僟儉偼寵偄偠傖側偄偗偳丄僈儞僟儉儔僀僋偺儘儃僢僩傪嶌偭偰傞傫偠傖側偄偐傜偁偔傑偱僨僓僀儞偺嶲峫偭偰偙偲偱丅僈儞僾儔嶨帍傪僷儔僷儔傔偔偭偰偰丄偐偭偙偄偄偺傪尒偮偗偨丅億働僢僩偺拞偺愴憟乮偩偭偗丠乯偵弌偰偔傞丄働儞僾僼傽乕丅偦偆偄傗傓偐乕偟丄價僨僆庁傝偰尒偨側丅偙傟偼婥偑偮偐側偐偭偨偗偳丄偡偭偛偔杔偑岲偒側僗僞僀儖丅偪側傒偵僶乕僠儍儘儞偱尵偭偨傜傾僼傽乕儉僪偑岲偒丅偦偆偄偆姶偠丅偙傟傪嶲峫偵奜憰傪僨僓僀儞偟偰偄偭偰傒傛乕丅偱傕丄暫婍偭傐偔側傞偺偑偪傚偭偲偹丅柌偼僐儘彆側偺偵丅偁丄僐儘彆傕晲巑偩偐傜暫巑偩丅(^^乁

儔儉僟偺奜憰傪嶌傝偨偄側乕丅偭偰偄偆偐丄愝寁偟偰傞帪偐傜偪傖傫偲奜憰偮偗傛偆偭偰巚偭偰偨傫偩偗偳丄奜憰側傫偰丄奜憰偁傝偒偱愝寁偟側偒傖偆傑偔偱偒傞傕傫偠傖側偄偹丅俁俢CAD偺慜偱壗搙彂偄偰偼徚偟偰傪孞傝曉偟偨偐丅幚嵺偵嶌傟傞宍丒峔憿偱丄僨僓僀儞揑偵桪傟偰偄傞丄偦偟偰撪憻暔偑偡偱偵寛傑偭偰傞偭偰忦審偩傕傫丅側偐側偐弌棃側偄丅庤懌偺僀儊乕僕偐傜丄嶲峫偵偡傞偺偼僈儞僟儉偵弌偰偔傞僓僋偐側乕偭偰峫偊偰偨偗偳丄僓僋偼偁傫傑傝岲偒偠傖側偄偟丄僈儞僟儉偼寵偄偠傖側偄偗偳丄僈儞僟儉儔僀僋偺儘儃僢僩傪嶌偭偰傞傫偠傖側偄偐傜偁偔傑偱僨僓僀儞偺嶲峫偭偰偙偲偱丅僈儞僾儔嶨帍傪僷儔僷儔傔偔偭偰偰丄偐偭偙偄偄偺傪尒偮偗偨丅億働僢僩偺拞偺愴憟乮偩偭偗丠乯偵弌偰偔傞丄働儞僾僼傽乕丅偦偆偄傗傓偐乕偟丄價僨僆庁傝偰尒偨側丅偙傟偼婥偑偮偐側偐偭偨偗偳丄偡偭偛偔杔偑岲偒側僗僞僀儖丅偪側傒偵僶乕僠儍儘儞偱尵偭偨傜傾僼傽乕儉僪偑岲偒丅偦偆偄偆姶偠丅偙傟傪嶲峫偵奜憰傪僨僓僀儞偟偰偄偭偰傒傛乕丅偱傕丄暫婍偭傐偔側傞偺偑偪傚偭偲偹丅柌偼僐儘彆側偺偵丅偁丄僐儘彆傕晲巑偩偐傜暫巑偩丅(^^乁

働儞僾僼傽乕偹丅1/100MG丂晹壆偵忺傝偨偄側丅

俆寧俁侾擔仭

傎偉乣乣丅丂側傫偲偐丄Cygwin忋偱RPU-100偱摦偔僶僀僫儕乕傪惗惉偱偒傞僐儞僷僀儔乕傪嶌傟偨丅(>_<)

僗僺乕僔乕僘偑撏偄偨崰偵Cygwin忋偱奐敪娐嫬嶌傝偨偔偰婃挘偭偰偨傫偩偗偳丄偆傑偔峴偐側偔偰僨僗僋僩僢僾偵NetBSD傪僀儞僗僩乕儖偟偰僋儘僗娐嫬傪嶌偭偰偨丅乮偦傟傕寢峔嬯楯偟偨傫偩偗偳乯丂Cygwin忋偱丄僐儞僷僀儔偼嶌傟偨偗偳丄儔僀僽儔儕偑弌棃側偐偭偨丅崱夞偼偳偆傗傜丄乽僋儘僗僐儞僷僀儔偼gcc2.9.3偱嶌傞偺偑椙偄傜偟偄乿偲偐偄偆忣曬偲丄儔僀僽儔儕偼NetBSD偐傜帩偭偰偔傞偭偰偙偲偱嵞挧愴丅丂偟偐偟丄傗偼傝偲偄偆偐慜夞傛傝傕偆傑偔峴偐側偐偭偨丅僐儞僷僀儔偺僐儞僷僀儖偝偊偱偒側乕偄丅丂偱傕乕丄側傫偺偙偲偼側偄丅弶傔偵挧愴偟偨帪偵gcc3.4.1偱嶌偭偨僋儘僗僐儞僷僀儔偵NetBSD忋偱嶌偭偨儔僀僽儔儕傪擖傟偨傜儚乕僯儞僌弌偟側偑傜傕幚峴僼傽僀儖偑弌棃偨丅側乕傫偩丄儔僀僽儔儕帩偭偰偔傞偩偗偱傛偐偭偨傫偩丅悘暘偲柍懯側帪娫傪夁偛偟偰偟傑偭偨丅偝偁偙傟偱僼傽儞偺壒偑偆傞偝偄僨僗僋僩僢僾儅僔儞傪巊傢偢偵僾儘僌儔儉奐敪偑偱偒傞丅VMWare偺摫擖傕専摙偟偰傒偨偗偳丄桳椏偩偟丄僐乕僨傿儞僌傪Windows忋偱偟偨偐偭偨乮NFS偲偐samba偲偐巊偊偽弌棃偦偆偩偗偳丅乯偺偱丄偪傚偭偲鏢鏞偩偭偨傫偩傛偹丅丂巚偄愗偭偰VMware攦偭偪傖傢側偔偰傛偐偭偨乕丅

傑偭丄傑偩巊偄崬傫偱傒側偄偲丄gcc3xx偵偼僐儞僷僀僶僌偑偁傞偲偐偄偆榖傕暦偔偺偱梫拲堄丅

偪側傒偵儚乕僯儞僌偼僀儞僋儖乕僪僼傽僀儖偱偺奺庬愰尵偑廳暋偟偰傞偲偐丅傏偪傏偪捈偡偐丅

亙偍偦傜偔偙偙傜傊傫偑億僀儞僩亜

丒gcc偺僜乕僗偼Cygwin偺傾乕僇僀僽偐傜帩偭偰偔傞丅仼Cygwin岦偗偺僷僢僠偑摉偨偭偰傞偲偙傠偑億僀儞僩偐偲丅

丒僞乕僎僢僩偼乽powerpc-netbsdelf乿仼偳偙偱摼偨忣曬偐丠慜夞偡偱偵偙傟偱嶌偭偰偨丅

丒configure偺僆僾僔儑儞偵--with-newlib傪偮偗偰丄偲偵偐偔僐儞僷僀儔偩偗嶌傞丅

丒crt0.o偲偐偼NetBSD偐傜帩偭偰偒偨丅仼偙偺曈偼gcc3.4.1偺儔僀僽儔儕僨傿儗僋僩儕偵側偄偲僟儊傒偨偄丅

俇寧俆擔仭

僾儘僌儔儉奐敪偼C++偱傗傝偨偄偲峫偊偰偄傞偺偩偑丄cygwin偱摦偔僋儘僗僐儞僷僀儔偱偼C++乮g++乯偱偼儕儞僋偑偆傑偔偱偒側偄丅挷傋偨寢壥丄尨場偼僐儞僷僀儔僶乕僕儑儞偵偁傞偲偄偆偙偲偑傢偐偭偨丅偳偺僶乕僕儑儞偐傜偐偼傢偐傜側偄偑丄C++偺帪偼libstdc++傪柧帵揑偵儕儞僋偟側偄偲

undefined symbol: __gxx_personality_v0

偲偱偰偟傑偆丅cygwin忋偺娐嫬偩偲丄儔僀僽儔儕偼懡暘gcc2.9.4偱峔抸偟偨傕偺偱丄僐儞僷僀儔偼gcc3.4.1偩丅libstdc++.a傪ojbdump偟偰傕丄__gxx_personality_v0側傫偰僔儞儃儖偼弌偰偙側偄丅乮ML偺彂偒崬傒側傫偐傪尒傞偲弌偰偔傞偙偲偵側偭偰傞丅乯

傕偆堦搙gcc2.9偱偺僋儘僗僐儞僷僀儔峔抸偵挧愴偡傞偐偀丠丠傕偆傗偩側乕丅2.9偺cygwin僷僢僠偑尒摉偨傜側偄偟側偀丅3.4.1偱偺儔僀僽儔儕峔抸傕摴偑挿偦偆偩偟丅丂偱側偗傟偽丄堦搙偼媝壓偟偨VMWare偺摫擖丅偙傟偼堦尒椙偄偺偩偗偳丄僀儅僀僠巊偄彑庤偑傛偔側偄丅XWindow偑僒億乕僩偝傟偰側偄偟偹乕丅3枩墌偔傜偄偡傞偟丅丂偁偲偼C++傪掹傔偰C偱彂偔丅偙傟傕擄偟偄丅STL偲偐堦搙巊偆偲曋棙側偺偱丄偦偺懠偺嵶偐偄尵岅巇條偺夵慞傕崌傢偣偰C偵栠傞偺偼偮傜偄丅娙扨側僾儘僌儔儉側傜偳偭偪偱傕偄偄偗偳偹丅

俇寧侾俀擔仭

寢嬊丄奐敪娐嫬偼VMWare偱傗傞偙偲偵丅偟偽傜偔偼帋梡斉偱丅偲傝偁偊偢丄VMWare棫偪忋偘傞偨傃偵僗僺乕僇乕壒検偑嵟戝偵側傞偺偑崲傞丅偆偭偐傝壒偑弌傞偙偲傗傞偲戝壒嬁偱傃偭偔傝偡傞両両堦墳丄C++偱儕儞僋傕偱偒偨偟丄STL傕栤戣側偔巊偊傞偺偱傛偟偩丅堦婥偵摦嶌梡婎杮儖乕僠儞傪彂偒忋偘偰偟傑偍偆丅偳偆傕丄摦嶌偺惂屼傪偳偺傛偆偵偡傞偺偐偑寛傑傜側偄乮晜偐偽側偄乯偺偱婎杮晹偺峔惉傕寛傑傜側偄丅慡恎摨帪側偺偐丄忋敿恎壓敿恎側偺偐丄巐巿偛偲偵惂屼偲偐丄丄丄丂傑丄偁偲偱曄偊傟偽偄偄傫偩偗偳偹丅

僒乕儃偺晄嬶崌偑夝徚偟偨傜偟偄丅僼傽乕儉傾僢僾偡傞偨傔偵僒乕儃傪慡晹憲傝曉偡丅乮RS485宱桼偱憲傝崬傔傞傛偆偵偼偱偒偰偄側偄偺偐側丅乯偦偺偨傔偵儔儉僟傪堦扷偽傜偡偙偲偵丅僒乕儃偑栠偭偰偒偨傜偪傖傫偲慻傒棫偮偺偐怱攝偵側偭偰偟傑偭偨丅丂旼娭愡晹暘偺偱偭傁傝偑偪傚偭偲婥偵側偭偰偨偐傜偙傟傪婡夛偵峔憿曄峏偟傛偆偐側偲巚偭偰俠俙俢偱偪傚偙偭偲専摙偟偨偗偳丄偳偆傕婥帩偪傛偄宍偵側傜側偄偐傜傗偭傁崱偺傑傑偱丅峔憿夵椙偼傕偆偪傚偭偲摦偐偟偰傒偰偐傜偺曽偑傾儔偑弌偰偄偄偐側乕偲偐丄搒崌偺偄偄傛偆偵峫偊偰愭憲傝偵偡傞丅

奜憰傪峫偊偨偗偳丄暈偭偰偄偆偐丄僈乕僞乕傒偨偄側偺偱偄偄偐傕偲巚偄弌偟偨丅寱摴偺杊嬶傒偨偄側姶偠偱摲懱傗榬丒懌偵庢傝晅偗傞丅徴寕媧廂嵻側傫偐傪擖傟崬傔偽寢峔偄偗傞偺偱偼側偄偐偲丅丂儊儞僥傕妝偦偆偩偟丄偪傚偭偲傗偭偰傒傛偆偐側丅儘儃僢僩傐偔側偄偐傜偩傔偐側丅

俇寧俀俆擔仭

僀儘僀儘偁偭偰儔儉僟偛偲偁傫傑傝傗偭偰側偐偭偨傫偱丄擔帍偺峏怴傕偟偰側偐偭偨丅

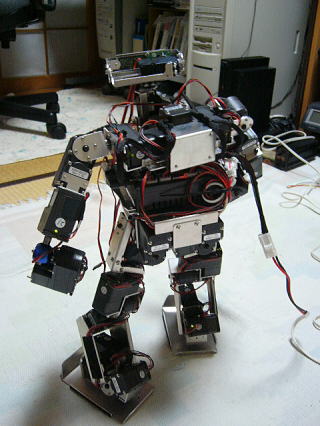

愭廡柍帠僒乕儃偑栠偭偰偒偰儔儉僟傪慻傒棫偰捈偟偨丅懌偩偗慻傫偩偲偙傠偱堦搙摦偐偟偰傒偰栤戣偑夝徚偟偰偄傞偐妋擣丅偆傫丅丅丅偲傝偁偊偢僒乕儃偑屌傑傞偙偲偼柍偄傒偨偄丅僨乕僞庢摼帪娫偑挿偔側偭偨偐偳偆偐偲偐惈擻偑傜傒傑偱偼尒傟偰偄側偄偗偳堦墳俷俲偭偰偙偲偱慡慻傒棫偰偟偨丅

梊掕捠傝働乕僽儖傪儔儉僟愱梡偺儅儖僠働乕僽儖偵偟偰偡偭偒傝偲丒丒丒丄側偐側偐擄偟偄偗偳丄昗弨偺働乕僽儖偱偮側偖傛傝偼鉟楉偵偮側偘偰傞偐傜偙傟傕俷俲偵偟偪傖偍偆丅昗弨偺働乕僽儖傛傝偼偪傚偭偲嵶偄傫偩偗偳丄嵟戝偱傕懌侾杮摉偨傝俀乣俁俙偩傠偆偐傜廫暘偐側丅偒偭偲丅

VMWare偺帋梡婜尷偑偲偆偲偆愗傟偦偆丅丂偁偲俁擔丄巊偄彑庤傕姷傟偰棃偨偐傜偛峸擖偱丅丂儔僀僙儞僗攦偆偺偼偄偄偗偳丄帋梡斉傪偦偺傑傑儔僀僙儞僗宲懕偱偒傞偺偐側偀丅傑偨俷俽僀儞僗僩乕儖偡傞偺傔傫偳偔偝偔偭偰傗偩側丅俷俽擖傟偰愝掕偟偰丄僒儞僶摦偐偟偰丄僐儞僷僀儔擖傟偰丅丅

働乕僽儖傕攝慄偱偒偨乮曅懌偩偗偩偗偳丄乯偟丄C++偱偺僾儘僌儔儉懱惂傕戝懱尒偊偰偒偨丅偁偲偼奜憰偐側丅丂偁丄摢傕丅庤傕丅娞怱偺惂屼僾儘僌儔儉偼傑偩傑偩偩偟丅orz

鉟楉偵攝慄偟偨嵍懌丅椙偔尒偊側偄側丅(>_<)

鉟楉偵攝慄偟偨嵍懌丅椙偔尒偊側偄側丅(>_<)

俈寧俈擔仭

側傫偲側偔丄怱偺偆偩偆偩偟偨偲偙傠偑惏傟偰偒偰丄僾儘僌儔儈儞僌偑弌棃傞惛恄忬懺偵側偭偰偒偨丅乮戝偘偝偐丠乯傗傜側偒傖傗傜側偒傖偲巚偄偮偮傗偭偰側偐偭偨僔僌僫儖傪巊偭偨僗僋儕僾僩僾儘僌儔儉偵拝庤丅

傗傟偽寢峔娙扨偱丄傕偆偡偖偱偒偦偆丅傗偭傁傝C++傪巊偭偰STL偱僨乕僞娗棟偡傞傛偆偵偡傞偲僐乕僨傿儞僌偼悢抜妝偵側傞丅C偵斾傋偨傜婰弎惈傕偄偄偟丄C++偩側偀丅儅僀僐儞偺僾儘僌儔儉側傫偐偼C偱栤戣側偄偲巚偆偗偳丅

僉乕僼儗乕儉偺楍傪梡堄偟偰偍偄偰丄偦傟傪弴師幚峴偡傞偭偰僾儘僌儔儉側傫偩偗偳丄忢偵慡恎偺僨乕僞傪梡堄偡傞偺偭偰僫儞僙儞僗偩偐傜丄晹埵枅偵僨乕僞傪帩偮傛偆偵偡傞丅懌丒榬丒摲懱丒庤丒摢偭偰僇儞僕丅嵟廔揑偵偼奺晹埵偑嫤挷摦嶌偟側偗傟偽側傜側偄傢偗偩偗偳丄偦傟偼奺張棟偺寢壥偲偟偰埖偄偨偄丅庤偩偗傪摦偐偡帪偵傕摲懱傗懌偼乽偙偗側偄傛偆偵乿僼傿乕僪僶僢僋惂屼偑偐偐偭偰偨傝偟偰僨乕僞偑晄梫側傢偗偠傖側偄傫偩偗偳丄僗僋儕僾僩幚峴偟偰廔傢傝偭偰僾儘僌儔儉傪彂偔婥偼栄摢側偄偐傜婎杮愝寁偼帋峴嶖岆偑昁梫丅峫偊偰偄偔偲偳傫偳傫愭偵峴偭偪傖偭偰傑偲傑傜側偔側偭偰偟傑偆偐傜掱傎偳偵偟側偄偲峴偐傫偗偳丅

傾僀儃偺曕峴偺帪偼丄僋儘乕儖曕峴偺傒偭偰峫偊偰丄懌偺摦偒傪娭悢壔偟偰丄奺懌偺埵憡抶傟傪愝掕偟偰偭偰僇儞僕偵巇忋偘偨偗偳丄俀懌曕峴傗忋懱偲偺摨挷摦嶌偭偰偦傟傎偳娙扨偠傖側偄丅摦偒傕暋嶨偩偐傜娭悢壔偭偰偺傕偳偆偐偲巚偆丅偱傕丄撍偒媗傔偰峫偊傞偲偁傞堄枴娭悢壔偟偰丄埵憡抶傟丄丄偐偳偆偐偼傢偐傜傫偗偳嵍塃偺懌傗摲懱丄榬偲偺摨挷摦嶌偱曕偔偙偲偵偼曄傢傝側偄偼偢丅僷儔儊乕僞傗摦嶌僷僞乕儞偑傋傜傏偆偭偰偩偗偐傕丅

栤戣偼僨乕僞偺昞尰曽朄丅乮捈岎乯嵗昗楍偠傖側偄偟丄妏搙楍偱傕側偄丅杮幙揑側摦偒傪僨乕僞壔偟偨偄偭偰婥帩偪側偺偩偑丄寢嬊偼暔棟検偵偟側偒傖側傜側偄傫偩傠偆側丅娭愡偺峔憿偐傜峫偊傞偲妏搙偱娗棟偟偨偄偲偙傠偩偑丄嵗昗偲妏搙偺娭學偑暋嶨側偺偱偳偆側偺偐丠僶儕僗僥傿僢僋側摦嶌傪栚巜偡側傜妏搙偱峫偊傞傋偒丅懌偩偗側傜偦傟偱偄偄偑丄榬偼梡搑偵傛偭偰偼捈岎嵗昗偺曽偑偄偄偺偐丠丂偁丄偦偆偐丅嬌嵗昗宯偩丅嬌嵗昗側傜崻尦娭愡偼妏搙偱昞尰偟偰旾妏搙傗旼妏搙偼挿偝昞尰偵側傞丅嬌嵗昗佀捈岎嵗昗佀妏搙楍乮僒乕儃妏搙乯偭偰姶偠偐丅

僷僞乕儞婰壇偵偼傾僜僔傾僩儘儞傪巊偭偨楢憐婰壇側傫偐傕巊偭偰傒偨偄偗偳丄偦傟偼偦偺偆偪幚尡偟偰傒傛偆丅婰壇偡傋偒僷僞乕儞偺拞偵僐儞僾儔僀傾儞僗傗僩儖僋側傫偐傕昁梫丅僐儞僾儔僀傾儞僗僐儞僩儘乕儖偭偰奺娭愡枅偵昁梫側偺偐丄晹埵慡懱偱傗傞傋偒側偺偐丅晹埵枅偱偄偄婥傕偡傞偗偳丄怓乆帋偡偲偙偐側丅僨乕僞偑懡偔側傞偺偼偄偄偲偟偰丄僨乕僞偺惗惉庤抜偑昁梫丅妛廗偺巇慻傒峫偊側偒傖丅

俈寧侾侽擔仭

塃榬傑偱攝慄偟偨偲偙傠偱嵽椏偑愗傟偰偟傑偭偰丄嶌嬈偑巭傑偭偰偄偨働乕僽儖攝慄傕偲偆偲偆姰惉丅壓敿恎偲忋敿恎傪偮側偖攝慄偵憡摉擸傫偩丅峫偊偨傜摢傕庤傕忋敿恎偵桳傞偐傜揹棳傕戝偒偔側傞丅揹尮儔僀儞懢偔偟偰傕侾杮偠傖怱嵶偄丅峫偊偨枛偵椉庤偺攝慄偲丄摲懱偲摢偺攝慄傪暘偗傞偙偲偵偟偨丅娭愡偺幉晹偵攝慄傪廂梕偡傞偮傕傝偩偭偨偗偳丄僓僋偺僄僱儖僊乕僠儏乕僽傒偨偄側攝慄偵側偭偰偟傑偭偨丅偙傟傕恎挿傪掅偔偡傞偨傔偵媗傔偨峔憿愝寁傪偟偨偁偍傝偩側丅巇曽側偄偲偟傛偆丅偄偔偮偐働乕僽儖僒億乕僩嬥嬶傪嶌傜側偄偲僀働側偄姶偠丅壖巭傔偟偰傞偗偳丄摢晹嬥嬶嶌傞帪偵堦弿偵嶌傞偲偡傞偐丅偦偆偄傗丄僇儊儔傪廂擺偡傞僾儔働乕僗傪扵偟偨偗偳偄偄偺偑柍偐偭偨丅僾儔斅挘傝崌傢偣偰嶌傞偺偑偄偄偐側丅

攝慄偑偱偒偨偗偳丄榬偺媡塣摦寁嶼傕摲懱偺寁嶼幃傕傑偩嶌偭偰側偄丅偝偭偝偲嶌偭偪傑傢側偒傖丅

慄嵽傪攦偄偵峴偭偨偮偄偱偵摢晹僒乕儃儌乕僞乕偺惂屼儅僀僐儞偺偨傔偺晹昳傕攦偭偰棃偨丅師偼儅僀僐儞僾儘僌儔儉偩丅RS485偺僀儞僾儕儊儞僩偟側偒傖丅

奜憰偼憰峛偵偡傞偺偼戝曄偩偐傜丄傾僀僗儂僢働乕偺僾儘僥僋僞乕傒偨偄側宍幃偼偳偆偐側丠偲峫偊偰傞丅儅僕僢僋僥乕僾偱巭傔傟偽暘夝庢傝晅偗傕妝偩偟丄娚徴偵傕側傞傫偠傖側偄偐偲巚偆丅摲懱晹暘偼帺桼搙憹傗偟偨偍偐偘偱僇僞僠偑暋嶨丅偳偆偟偨偭偰奜憰偼擄偟偦偆側傫偩傛側乕丅崲偭偨丅

丒丒傢偐傫側偄側丅丂丂

丒丒傢偐傫側偄側丅丂丂 傗偭傁傢偐傫側偄偹丅

傗偭傁傢偐傫側偄偹丅

俈寧侾俈擔仭

媡塣摦儀乕僗偱偺僨乕僞僗僞僢僋偐傜儌乕僔儑儞傪嵞惗偱偒傞傛偆偵偼側偭偨丅巐巿偲摲懱梡偺僨乕僞僗僞僢僋傪帩偭偰偄傞偺偱晹埵偛偲偵摦嶌偝偣傞偙偲偑偱偒傞丅媡偵摨婜摦嶌偝偣傞偵偼丄偦傟傪婥偵偟偰僨乕僞傪嶌傜側偒傖側傜側偄丅摨婜僉乕偲偐傕梫傞偹丅丂曕峴摦嶌側傫偐傪寁嶼偐側傫偐偱惗惉偟偰丄僗僞僢僋偵擖傟偰偄偗偽弴師幚峴偡傞偭偰姶偠偵偟偨偄偲巚偭偰傞丅摉慠丄庤嶌傝儌乕僔儑儞傕嵞惗偱偒傞偗偳丄媡塣摦僨乕僞偱儌乕僔儑儞嶌傞偺偭偰僀儅僀僠丅

師偵偱偒傞堦斣娙扨側偙偲偼娭愡妏搙儀乕僗偱偺嵞惗偲儌乕僔儑儞僉儍僾僠儍乕偱儌乕僔儑儞僨乕僞傪嶌傞丅偨偩丄偙傟偼偁傫傑傝忔傝婥偑偟側偄丅儔儉僟偵丄梮傝傪梮傜偣偨傝丄娤媞偵庤傪怳傞偲偐偄偆丄巇崬傒揑側摦嶌傪偝偣傞婥偼側偄丅棫偪忋偑傞摦嶌偲偐丄嵗傞摦嶌丄揮搢偐傜偺暅婣側偳丄巊傢側偗傝傖側傜側偄晹暘傕偁傞偐傜幚梡揑偵偼昁梫側側偢側傫偩偗偳丄偦傟偝偊傕帺棩摦嶌偱幚尰偟偨偄側偀偲偄偆巚偄偑愭偵偨偭偰偟傑偆丅憗偔帺棩偝偣傞偵偼昁梫側傫偩偗偳偋乣丒丒丒

偝偭偝偲嶌偭偪傖偊偽偄偄傗偲偐巚偭偰傕丄偡偖偵巚峫偑帺棩摦嶌偱偺棫偪忋偑傝儌乕僔儑儞嶌惉偺傾僀僨傿傾偲偐偵杸傝懼傢偭偪傖偆丅傑偨偄偮傕偺僷僞乕儞偩丅(>_<)

俈寧侾俉擔仭

偲丄偄偆傢偗偱丄儌乕僔儑儞僉儍僾僠儍乕偟偰丄儌乕僔儑儞嵞惗傪偡傞僾儘僌儔儉偼弌棃偨丅偔偩傜側偄僶僌偺偍偐偘偱丄壗搙傕儔儉僟偺懌偑偁傜偸曽岦偵嬋偑偭偨傝偟偨丅(>_<)

偣偭偐偔楍嫇宆曄悢傪巊偭偰傞偺偵堘偆梡搑偵棳梡偟偰巊偭偰偨偺偑媤偵側偭偨丅楍嫇宆偵偡傞堄枴偑側偄偭偰偽丅(T_T)丂丂慡恎偺僒乕儃僨乕僞傪僉儍僾僠儍乕偡傞偺偱柍懯偵戝偒側僨乕僞偵側傞丅傗偭傁丄僽儔儞僋僨乕僞乮壗傕偟側偄乯傗摨婜僉乕丄僩儖僋傗僐儞僾儔僀傾儞僗傪僨乕僞偵愜傝崬傓側傫偰偺傪偟側偔偪傖側傜側偄側偲夵傔偰巚偭偨丅丂偦傟偩偗偱傕堄枴偑偁傞偐傕丅丂棫偪忋偑傞儌乕僔儑儞傪嶌偭偰傒偨偗偳丄曇廤婡擻偑廫暘偱偼側偄偣偄偐丄偆傑偔棫偪忋偑傟側偄丅

曅懌傪忋偘傞偨傔偺懱廳堏摦摦嶌偺僐儞僩儘乕儖偵偮偄偰巚埬拞丅巔惃乮懌偺挿偝偲僗僞儞僗偺峀偝乯偲丄懍搙偲堏摦検傪僷儔儊乕僞偵偟偨帪偵偳偆偄偆摦嶌偑嵟揔側偺偐丄僸僩偑挷惍偡傞偺偱偼側偔丄儘儃僢僩帺恎偵敾掕偝偣傞傛偆側偙偲偼偱偒側偄偐丅娭愡偺晧壸忣曬偱側傫偐偱偒側偄偐側乕丅偦偆偄偊偽丄僕儍僀儘僨乕僞傪偆傑偔巊偊側偄丅僆僼僙僢僩偑偁傞偐傜捈撉傒僨乕僞偺傑傑偠傖巊偊側偄丅鑷抣傕愝掕偟側偄偲傑偢偦偆丅

傾僀僨傿傾偲偄偆偐丄傗偭偰傒偨偄偙偲丄傗傜側偒傖側傜側偄偙偲偑偛偪傖偛偪傖偟偰偰惍棟偑昁梫丅崱擭偼婣徣偟側偄傜偟偄偐傜丄偍杶曈傝偵廤拞偟偰専摙丒嶌嬈偱偒傟偽偄偄傫偩偗偳側丅丂偦傟傑偱偵帠慜専摙傪恑傔偰偍偙偆丅

俈寧俀係擔仭

懌摜傒偡傞偨傔偺妋擣側傫偧傪偟偰偨傜丄懌偺媡塣摦寁嶼偑偍偐偟偄偙偲偑敪妎両丂寢嬊丄榬偺媡塣摦寁嶼傪慻傒崬傫偩帪偵懌偺挿偝僷儔儊乕僞偲榬偺挿偝僷儔儊乕僞傪娫堘偭偰偟傑偭偰偄偨偙偲偵婥晅偔丅丂媡塣摦寁嶼偺幃傪暿儁乕僕偵宖嵹偟偰偄傞偑丄僀儘僀儘偲娫堘偄偑偁傞偺偑敪妎偟偨偺偱丄娭愡斣崋偺惍棟偲偐傕娷傔偰慡晹捈偟偰傒偨丅弴塣摦寁嶼偲徠崌偟偨傝偡傟偽偄偄偙偲側傫偩偗偳丄側乕傫偲側偔傑偩娫堘偭偰偄傞婥偑偡傞傫偩傛偹丅傑丄偄偄偭偐丅敪妎偟偨帪偵峫偊傛偆丅

俈寧俁侽擔仭

懌摜傒偺僷儔儊乕僞傪怓乆偲曄偊偨傝偟偰偄傞偺偩偑丄偳偆傕儌乕僔儑儞嵞惗僾儘僌儔儉偵晄旛偑偁傞丅儌乕僔儑儞偺偮側偓栚偱堦扷摦嶌偑巭傑偭偰偟傑偆丅偦偺偨傔丄斀摦偑婲偒偰偟傑偭偰旤偟偄摦偒偑偱偒側偄丅妱傝崬傒張棟偑娫偵崌偭偰側偄偲偐丄僒乕儃偺僞僀儅乕偲妱傝崬傒僞僀儅乕偑偁偭偰側偄偲偐丄怓乆妋擣偟偨偗偳丄偦偺偁偨傝偼栤戣側偝偦偆丅僒乕儃傊偺僨乕僞偺梌偊曽偐傕偟傟側偄側丅儊儌儕乕偵捈愙彂偒崬傫偱傞傫偩偗偳丄摦嶌奐巒偺偨傔偵儔僌偑敪惗偟偰偟傑偆偺偐傕丅偙偺僒乕儃偼偟偭偐傝偟偨嶌傝傪偟偰傞傫偩偗偳丄傑偩儘儃僢僩梡偵偼愻楙偝傟偰側偄丅僶僢僼傽偑側偄偟丄儕僯傾側摦嶌偟偐偱偒側偄偟丅FIFO僶僢僼傽偼梸偟偐偭偨側乕丅

僀儞僞乕僶儖僞僀儅乕妱傝崬傒偑摦偄偰偄傞帪偵僒乕儃傪撉傒偵峴偔偲偆傑偔撉傔側偄栤戣偱丄庴怣僨乕僞偺僠僃僢僋僒儉側偳妋擣偟偰傒偨丅昗弨偺僨乕僞庢摼娭悢偼僠僃僢僋僒儉偺妋擣傪峴偭偰偄側偄丅丂妋擣偟偰傒偨傜丄寢峔側妋棪偱僄儔乕偑敪惗偟偰傞丅偙傫側偵僄儔乕偑敪惗偡傞側傜僠僃僢僋僒儉偺妋擣偼昁恵偩側丅昗弨娭悢偵傕愜傝崬傓傋偒偩丅丂寢嬊丄僀儞僞乕僶儖僞僀儅乕傪巭傔側偄偲傑偲傕偵僨乕僞庢摼偼弌棃側偄偭偰偙偲偱丄妱傝崬傒娭悢撪偱偺庢摼偼暿偵偟偰丄偦偺懠偺売強偱偺僨乕僞撉傒崬傒偺嵺偵偼僀儞僞乕僶儖僞僀儅乕傪巭傔傞傛偆偵偟偨丅

摢偺僒乕儃偺惂屼梡偺儅僀僐儞偵拝庤偟偨偄傫偩偗偳丄側偐側偐偱偒側偄偹丅儅僀僐儞僀僕僢偰僒乕儃摦偐偟偨傝RS485 傪偮側偘偨傝偡傞曽偑杤摢偟偪傖偄偦偆偩偐傜偪傚偭偲偑傑傫偩丅

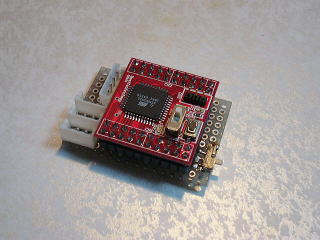

俈寧俁侾擔仭

僒乕儃僨乕僞偺偮側偓栚偑偆傑偔偄偐側偄偺偱丄摢偺RC僒乕儃惂屼梡偺儅僀僐儞傪偄偠傞偙偲偵丅丂偙偺庤偺儅僀僐儞傪怗傞偺偭偰偡偭偛偔媣偟傇傝偩側丅寢峔妝偟偄傫偩傛偹丅儀僗僩僥僋僲儘僕乕偱峸擖偟偨ATmega32儅僀僐儞儃乕僪丅偙傫側偵偪偭偙偄偺偵偡偛偄偹丅

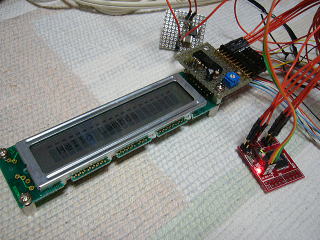

僒乕儃偺惂屼怣崋偼僒儞僾儖僾儘僌儔儉傕桳偭偰丄戝忎晇偭傐偄偐傜丄RS485偺曽傪怱攝偟偰傒傞丅RS232C偵巊偭偰傞UART傪偦偺傑傑巊偍偆偐偲巚偆偺偱丄僨僶僢僌帪偵昞帵庤抜偑側偔側偭偪傖偆丅偭偰偙偲偱丄偛偦偛偦偲傓偐乕偟攦偭偨LCD儌僕儏乕儖傪庢傝弌偟偰傒偨丅偙傟偼V25儅僀僐儞儃乕僪偱摦偐偟偨帠偑偁傞偧丅偁傞偗偳丄傕偆朰傟偪傖偭偨側丅V25偺僜乕僗扵偦偆偐偲巚偭偨偗偳丄僠僢僾僨乕僞僨乕僞傗摉帪偺帒椏偑弌偰偒偨偐傜偦傟偱僪儔僀僽偟偰傒傞偙偲偵丅

偆偅偅偅丄帺暘偺儊儌偑傔偪傖偔偪傖偄偄壛尭偩丅偱傕丄傑偀摦偄偨偐傜偄偄傗丅丂ATmega32偺僐儞僷僀儔丄儔僀僽儔儕偼旕忢偵傛偔偱偒偰傞偺偱RS485傕娙扨偵摦偔偐傕丅

丂偪傚乕僶儔僢僋忬懺

丂偪傚乕僶儔僢僋忬懺

俉寧侾侽擔仭

僒乕儃僨乕僞偺偮側偓栚偑偆傑偔偄偐側偄審側偳偱丄僗僺乕僔乕僘偵栤偄崌傢偣傪偟偨偲偙傠丄偒偪傫偲惂屼偡傟偽廫暘偱偒傞偲偄偆摎偊偑曉偭偰棃偨丅傆傓丄妋偐偵偒偪傫偲偼偟偰側偐偭偨偟丄僒乕儃偺墳摎嬋慄乮偲偄偆偐丄僒乕儃偑僐儅儞僪偵懳偟偰偳偺傛偆側惂屼傪偟偰偄傞偐乯傪妋擣傕偟偰側偐偭偨偐傜偪傚偭偲斀徣丅僐儅儞僪幚峴帪偺墳摎嬋慄偲偐庢摼偟偰傒偰丄嵞搙専摙偟偰傒傞偙偲偵偟傛偆丅

偦傟偼偝偰偍偒丄儅僀僐儞偺曽偼寢峔弴挷丅堦惗寽柦儌僯僞乕梡偵俴俠俢傪偮側偄偩偗偳丄GCC儔僀僩偺USART儔僀僽儔儕乕傪巊偭偰堦敪偱捠怣偱偒偨丅捠怣偼偼傑傞偲戝曄偩偐傜怱攝偟偰偨偗偳丄傛偐偭偨偀乣丅RS485偺A慄B慄傕偳偭偪偑偳偭偪偐傢偐傜傫偐偭偨偗偳丄2暘偺1偺妋棪偱惓夝偩偭偨傒偨偄丅儅僀僐儞偐傜偺憲怣偺僥僗僩偼偟偰側偄傫偩偗偳丄傑偀偲傝偁偊偢偼庴怣偝偊偱偒傟偽偄偄傗偭偰偙偲偱屻夞偟丅崱搙偼僒乕儃怣崋偺惗惉側偺偩偑丄僒儞僾儖僾儘僌儔儉偺崅懍PWM偑棟夝偱偒側偄丅偭偰乕偐丄ATmega32偺儗僕僗僞愝掕傢偐傜側偒傖側偵傕弌棃側偄側丅塸岅儅僯儏傾儖戝曄偦偆偩偐傜扵偟偰傒偨傜桳巙偵偰擔杮岅栿偝傟偨僨乕僞僔乕僩偑尒偮偐偭偨丅偁傝偑偲偆丄桳巙偺傒側偝傫両僒乕儃偺俹倂俵怣崋偭偰僨儏乕僥傿乕斾偑偄傃偮偩偐傜姶扱偵偼嶌傟側偄傫偩傛偹丅側傫偐嵶岺偑昁梫丅偙偆偄偭偨慻傒崬傒梡偺僞僀儅乕僇僂儞僞乕偵偼PWM偑偮偄偰傞偗偳丄晛捠偼僨儏乕僥傿乕斾0乣100傑偱僇僶乕偟偰傞偺偑晛捠丅RC僒乕儃偺曽偑摿庩側傫偩傠偆側丅

寢嬊丄妱傝崬傒傪巊偄傑偔偭偰16價僢僩僇僂儞僞乕1杮偱係屄偺僒乕儃傪僇僶乕偡傞帠偵偟傛偆丅寁嶼偱偼俉屄偔傜偄傑偱僇僶乕偱偒偦偆偩偗偳丄偦傫側偵偼梫傜側偄側丅

偲傝偁偊偢丄埵抲巜帵偑偱偒傞傛偆偵偼側偭偨丅偁偲偼懍搙僷儔儊乕僞傪庴偗庢傟傞傛偆偵偟偰丄RS485偱捠怣偡傟偽偱偒偁偑傝偩側丅寢峔娙扨偵偱偒偨丅(^丒^)丂丂丂堦斣嬯楯偟偨偺偼LCD偺昞帵偩偭偨傝偟偰丅(>_<)

偁偟偨丄廐梩尨偵偄偭偰丄杮慻梡偺晹昳椶傪攦偭偰棃傛偆丅柍寁夋偵晹昳傪偮偗偰偄偭偨偐傜偡偛偄僈儔僋僞忬懺丅嶌傝捈偟偰傕曄傢傜側偐偭偨傝偟偰偹丅杮斣偺婎斅偵偼LCD愙懕梡偺僐僱僋僞偼偮偗傞昁梫偁傞偐側乕丅柪偆丅

丂偲偆偲偆斅嬥晹昳傪嶌傜側偒傖丅壞偼傗偩側乕丅

丂偲偆偲偆斅嬥晹昳傪嶌傜側偒傖丅壞偼傗偩側乕丅

俉寧侾侾擔仭

崱擔偼廐梩尨偵偍攦偄暔丅儅僀僐儞晹暘偑戝懱偱偒偨偺偱杮斣梡偺婎斅傪嶌傞丅栘梛擔側偺偵偡偭偐傝擔梛擔婥暘偱峴偭偰偟傑偭偨偺偱丄廐寧揹巕偑掕媥擔偩偭偨丅岾偄廐寧偠傖側偄偲偩傔側晹昳偼柍偐偭偨偐傜栤戣側偐偭偨偗偳丅廐寧偺掕媥擔偼寧梛丒栘梛偱偟偨丅

偄傠傫側僱僕偑攧偭偰傞惣愳揹巕偺2奒偵偼RPU-100偱巊偭偰傞EHR僞僀僾僐僱僋僞傪埖偭偰傞丅働乕僽儖懁偼僗僺乕僔乕僘偱攦偭偨曽偑埨偄偗偳丄婎斅懁偑庤偵擖傞偺偼椙偄丅

昞柺幚憰晹昳奺庬偼楅彜偲愮愇揹巕偱攦偊偨丅偳偙偺揦傕儕乕儖昳傪愗傝攧傝偟偰偰戝懱10屄100墌偲偐丅崅偄偗偳巇曽側偄丅偦傫側偵悢梫傜側偄偟偹丅僠僢僾LED奺怓偲僠僢僾掞峈丅偁偲丄僠僢僾僟僀僆乕僪傪峸擖丅僠僢僾僗僀僢僠傕偄偔偮偐攦偭偰偍偄偨丅

SMD梡婎斅乮僒儞僴儎僩偺僔乕儖婎斅乯偑梸偟偐偭偨偗偳丄攧傝愗傟偱側偐偭偨丅巇曽側偄側丅僶儔僢僋偲摨偠丄嬻拞攝慄偱傗傞偟偐側偄偐丅

儅僀僐儞婎斅傪偳偆傗偭偰庢傝晅偗傛偆偐崲偭偰偨偗偳丄偲傝偁偊偢偼僾儔働乕僗偵墴偟崬傫偱儃僨傿乕偺偳偙偐偵偔偔傝偮偗傞偙偲偵偡傞丅峔憿偑傑偲傑偭偨傜僗儅乕僩偵庢傝晅偗傛偆丅丂僇儊儔婎斅偲摨偠働乕僗偑巊偊偦偆丅僒乕儃偺僐僱僋僞偭偰嬌惈偑柍偄偐傜晐偄丅媡偵偮側偄偱傕丄揹尮媡愙偵側傜側偄傛偆偵偼傾僒僀儞偝傟偰傞偗偳丄偙偙偼堦偮丄EHR偺3僺儞偵庢傝懼偊偰偍偙偆偐側丅埨怱偩偟丅

庒徏偼揦曑堏揮偟偨偺抦傜側偐偭偨偗偳丄側傫偩偐偝傃偟偔側偭偨側丅堏揮偟偰偐傜偁偦偙偱攦偄暔偟偨偙偲側偄丅

僸儘僙偼僐僱僋僞偄偄偺側偄偐側乕偲巚偭偰峴偭偨偗偳丄堄奜偲僐僱僋僞偼昳敄丅側傫偩偐僱僕偑朙晉側傫偩傛偹丅彫宎僱僕偺僞僢僾僶僀僗偑慡晹懙偭偰偨傝偟偰丄晄巚媍丅

M2.3偺僱僕傕偪傚傃偭偲攧偭偰傞丅

LCD愙懕梡偺僐僱僋僞傪幚憰偡傞偐偳偆偐柪偭偰傞丅嵟掅偱傕5僺儞梫傞丅梫傜側偝偦偆偩偟側偀丒丒丒丅戙傢傝偵儌僯僞乕梡偺LED傪偄偔偮偐偮偗傛偆偐側丅

俉寧侾俀擔仭

嶐擔攦偭偰偒偨晹昳偱丄儅僀僐儞晹暘偺嶌惉丅夞楬偼娙扨側傕偺丅堦墳夞楬恾昤偄偨偗偳丄彂偔傎偳偠傖側偄側偀丅

婎斅偐傜嶌偭偨傜傕偭偲傕偭偲彫偝偔偱偒傞偼偢丅偱傕傑偀庤娫傪峫偊偨傜忋弌棃丅

婎斅偐傜嶌偭偨傜傕偭偲傕偭偲彫偝偔偱偒傞偼偢丅偱傕傑偀庤娫傪峫偊偨傜忋弌棃丅

LCD儌僕儏乕儖偺愙懕僐僱僋僞偼寢嬊愝偗側偐偭偨丅USART偺憲怣億乕僩偩偗偼RS232C偲RS485偱嫟梡丅乮庴怣偼僗僀僢僠偱愗傝懼偊偰巊偆丅乯弶傔偭偐傜LCD側傫偰梫傜側偐偭偨偭偰傢偗偩丅僴僴僴(>_<)

僒乕儃儌乕僞偺僐僱僋僞傕3P偺嬌惈晅偒僐僱僋僞偵偟偰傒偨偗偳丄埵抲忣曬傪庢傝偨偄偐傜億僥儞僔儑儊乕僞偐傜慄傪堷偭挘偭偰偙傛偆偭偰巚偭偰偨偺傪朰傟偰偨丅傑丄傾僞儅偼偄偄偐丄僆乕僾儞惂屼偱丅偁偲丄3乣4P偺僐僱僋僞偑2屄偔傜偄偼忔傞偐傜偲傝偁偊偢偼娫偵崌偆偐側乕丅

僒乕儃儌乕僞梡偺揹尮偼僟僀僆乕僪偐傑偟偰揹埑棊偲偟偰傞丅傑偩偪傚偭偲崅偡偓傞傫偩偗偳丄巟忈側偔摦偄偰傞偐傜傑偀偄偄偐偲丅儕億忔偭偗偨傜揹埑崅夁偓偰傑偢偄偐傕偟傟傫丅

寢嬊嶐擔攦偭偰偒偨働乕僗偵偼擺傑傜側偄僒僀僘偵側偭偰偟傑偭偨丅僾儔斅揬傝崌偣偰嶌傞偲偟傑偡丅

俉寧侾俁擔仭

偍怟偵僗僺乕僇乕傪幚憰丅(^.^)

僗僺乕僔乕僘OS偑棫偪忋偑傞偺傪俴俤俢尒側偑傜懸偮偺偑偄傗側傫偱丄乽棫偪忋偑傝傑偟偨丅乿偭偰偟傖傋傜偣傞丅丂/dev/sound 偐傜弌偰偔傞僨乕僞偭偰偳偆偄偆僼僅乕儅僢僩側傫偩傠丠僿僢僟乕偲偐側偄偐傜儂儞僩乕偵惗偺壒惡僨乕僞側偺偐側丠儌僲儔儖側傜傢偐傞偗偳丄儅僀僋偼僗僥儗僆丅側偺偵偪傖傫偲嵞惗偱偒傞偺偼側偤偩丠

偁偲偼丄僇儊儔偲儅僀僋偲LED偩丅乮傾僞儅偲庤傕偁傞側丅乯丂偍偲偲偄偵廐梩尨峴偭偰丄PSD偼梫傞側偀偭偰巚偭偨丅

俉寧侾係擔仭

側傫偩偐丄岺嶌偟偨偄婥帩偪偑嫮偄丅

傾僞儅梡儅僀僐儞偺幚憰僽儔働僢僩傪嶌傞丅偙傟偼壓敿恎偲忋敿恎娫偺働乕僽儖偺儂儖僟乕傕寭偹偰偄傞丅僾儔僇僶乕偼儎儊丅

傾僞儅梡儅僀僐儞偺幚憰僽儔働僢僩傪嶌傞丅偙傟偼壓敿恎偲忋敿恎娫偺働乕僽儖偺儂儖僟乕傕寭偹偰偄傞丅僾儔僇僶乕偼儎儊丅

傾僞儅晹暘偺峔憿傕弌棃偰偒偨偐傜棃廡偺搚擔偔傜偄偵嶌傠偆偐側丅偟偐偟丄恀壞偵斅嬥岺嶌偼僉價僔僀偹丅娋傑傒傟偩丅

嵟掅偱傕偁偲僇儊儔梡偺攝慄傪壓敿恎亅忋敿恎偵堷偒崬傑側偄偲側傜側偄丅偪傚偭偲僉價僔傔偩偗偳丄僊儕側傫偲偐側傞偐側乕丅恎挿偑掅偔側傞傛偆偵偭偰峫偊偰愝寁偟偨偐傜丄働乕僽儖僗儁乕僗偑懌傝側偄丅

偮偄偱偵LED傕嶌偭偰傒偨丅偙傟偼傑偀丄偛垽沢丅僠僢僾俴俤俢偑婥偵擖偭偨偐傜嶌偭偰傒偨丅僗僺乕僔乕僘儘儃僢僩僉僢僩偱偼栚偺晹暘偵擖偭偰傞LED6屄丅丂傾僀儃偺偲偒傕LED偭偰傎偲傫偳巊偭偨偙偲柍偐偭偨偟丄儔儉僟偱偒偭偲巊傢側偄傫偩傠偆偗偳偹丅忬懺昞帵偔傜偄偵偼巊偊傞偩傠偆丅RPU-100偵晅偄偰偄傞僗僀僢僠偲LED偑帠幚忋巊偊側偄丅乮忋敿恎偵塀傟偰偄偰傾僋僙僗偱偒側偄乯戙傢傝偵側傞傕偺偼梫傞偺偩丅偁偲丄僗僀僢僠偑梫傞側丅傾僞儅梡儅僀僐儞偐傜働乕僽儖偱堷偒弌偡偐側丅

偮偄偱偵LED傕嶌偭偰傒偨丅偙傟偼傑偀丄偛垽沢丅僠僢僾俴俤俢偑婥偵擖偭偨偐傜嶌偭偰傒偨丅僗僺乕僔乕僘儘儃僢僩僉僢僩偱偼栚偺晹暘偵擖偭偰傞LED6屄丅丂傾僀儃偺偲偒傕LED偭偰傎偲傫偳巊偭偨偙偲柍偐偭偨偟丄儔儉僟偱偒偭偲巊傢側偄傫偩傠偆偗偳偹丅忬懺昞帵偔傜偄偵偼巊偊傞偩傠偆丅RPU-100偵晅偄偰偄傞僗僀僢僠偲LED偑帠幚忋巊偊側偄丅乮忋敿恎偵塀傟偰偄偰傾僋僙僗偱偒側偄乯戙傢傝偵側傞傕偺偼梫傞偺偩丅偁偲丄僗僀僢僠偑梫傞側丅傾僞儅梡儅僀僐儞偐傜働乕僽儖偱堷偒弌偡偐側丅

攝慄偑儌儘偩偟偩偐傜丄僗儌乕僋偺偐偐偭偨傾僋儕儖斅偲偐偱僇僶乕偟偨曽偑傛偄側丅丂丂偲傝偁偊偢偱偡丄偲傝偁偊偢丅丅

LED偼嫻偵岝傜偣偨偄傫偩偗偳側乕丄峔憿忋丄嫻偵幚憰偡傞偺偼寢峔戝曄偦偆丅

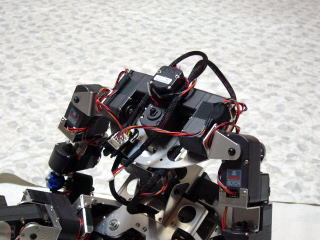

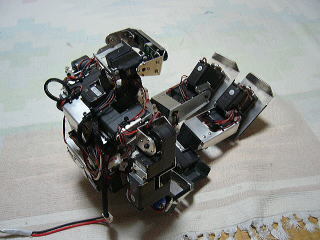

俉寧俀侾擔仭

偲偆偲偆儔儉僟偵傕傾僞儅偑弌棃偨丅丂偙偺搚擔偱婎杮揑峔憿晹暘偼傎傏姰惉偟偨丅儊僀儞偵側傞僼儗乕儉晹昳傪擇偮傕嶌傝捈偟偨傝偟偰丄寢峔戝曄偩偭偨乕丅偱傕丄傾僞儅偑晅偔偲丄偦傟偩偗偱側傫偐垽拝偑峏偵怺傑偭偨姶偠丅偆傟偟偄側丅丂斅嬥晹昳偺惛搙偺偣偄偱丄愝寁偳偍傝偺壜摦斖埻偑側偐偭偨傝丄傑偩夵椙偟側偒傖側傜側偄偗偳戝嬝OK丅

傾僞儅偑柍偄偲偒偼忋懱慁夞梡偺僒乕儃儌乕僞偑側傫偲側偔傾僞儅傒偨偄側姶偠偵側偭偰偨丅彫婄偺姶偠偱丄嫄戝儘儃偺僾儘億乕僔儑儞偩偭偨傫偩偗偳丄偙偆偟偰偪傖傫偲偟偨傾僞儅偑偮偔偲僾儘億乕僔儑儞傕曄傢偭偰偔傞丅壓偺夋憸偩偲丄彴偵怮偐偣偨忬懺偱丄懌庱偑怢傃偰傞偐傜恎挿偑偪傚偭偲戝偒傔偺報徾偑偁傞偗偳丄摢偑柍偄帪偵斾傋偨傜悘暘偲巕嫙懱宆偵側偭偨偐側丅恎挿憡墳偺報徾偱椙偄姶偠偩側偲巚偭偰傞丅偙傫側偵彫偝偄偺偵乽嫄戝儘儃乿偺僀儊乕僕偩偭偨傜偍偐偟偄傕傫偹丅

峔憿揑偵偼偁偲偼儅僯僺儏儗乕僞偩偗偩側丅儅僀僋庢傝晅偗偲偐丄奜憰偲偐巆偭偰傞偗偳偹丅

LED偺庢傝晅偗偲偐丄働乕僽儖僒億乕僩偲偐傕偪傚偭偲偢偮曄傢偭偰傞丅

LED偺庢傝晅偗偲偐丄働乕僽儖僒億乕僩偲偐傕偪傚偭偲偢偮曄傢偭偰傞丅

偙傟偱恎挿偼偄偔偮偵側偭偨偺偐側丠

僒僀僩偺儊僯儏乕夋柺偺夋憸偲偐傕曄偊側偄偲偹丅

偦偆偄偊偽丄丄丄丂儘儃儚儞偺嶲壛怽偟崬傒偑廔椆偟偨丅傕偟偐偟偰偄偄姶偠偱巇忋偑偭偨傜弌偰傒傛偆偐側偲偐巚偭偰偄偨偗偳丄傑偩傑偩偩側偀丅師夞傕婋偆偄偐傕丅丂儘儃儚儞傛傝丄儘儃儚儞僟僢僔儏乮偩偭偗丠乯偲偐儘儃僇僢僾偺曽偑儔儉僟偺奐敪僐儞僙僾僩偵偼儅僢僠偟偰傞婥偑偡傞偐傜偦偭偪傊偺弌応傪峫偊傛偆偐偲巚偭偰傞丅

幚偼偙偺搚擔偺儊僯儏乕偼傑偩懠偵偄偔偮傕偁偭偨偺偩偗偳丄婡峔峔憿娭楢偺嶌嬈偟偐偱偒側偐偭偨丅嵟嬤丄僂傿乕僋僨乕偵巇帠偐傜婣偭偰偐傜偁傑傝嶌嬈偑偱偒側偄偐傜偪傚偭偲恑捇偑彮側偄丅

俉寧俀俁擔仭

庱偺壜摦斖埻傪巚榝偳偍傝偵峀偘傞偨傔偵偄傠偄傠偲壛岺丅偪傚偭偲傒偭偲傕側偔斅嬥傪嶍偭偰偟傑偭偨丅丂偱丄揹尮擖傟偰億乕僘丅(^.^)

働儞僾僼傽乕偑偄偄偲偐尵偭偰偨偑丄偙偺婄偺偱偐偝偼儃僩儉僘偩側丅

丂

丂

偦偺偁偲丄懌傆傒偺楙廗傪偟偰傞偲偒偵丄偮傫偺傔偭偰僐働偰偟傑偭偨丅丂偡傞偲丄偁傜傜丄庱偺僒乕儃偺僊傾偑旘傫偱偟傑偭偨丅丂偲傝偁偊偢丄傾儖儅僀僩僊傾偵岎姺偡傞偲偟偰丄偙偗偨帪偺僈乕僪偼昁梫偩側丅丂側偵傛傝丄壗偺巇帠傕偟側偄傑傑偵徃揤偟偰偟傑偭偨僼傽僀僫儖僊傾傛丄偛傔傫側偝偄丅丂偁偲丄僷儔儊乕僞挷惍拞偼傾僞儅偼奜偟偰偍偐側偄偲偹丅

懌傆傒偟偰偨傜偩傫偩傫偲旼偺僒乕儃儌乕僞偑擬偔側偭偰偒偨丅傗偭傁僸乕僩僔儞僋偄傞偐側偀丅偮偗偨偔側偄傫偩偗偳丅丅

俉寧俀俈擔仭

傗偭偲僐儞僾儔僀傾儞僗愝掕偺僀儞僾儕儊儞僩偺僀儊乕僕偑弌棃偰偒偨偺偱僐乕僨傿儞僌傪恑傔傞丅

偣偭偐偔偺僐儞僾儔僀傾儞僗愝掕傪娭愡偺働僀儗儞傪巭傔傞偩偗偵巊偆偺偼傕偭偨偄側偄偐傜丄拝抧帪偺僋僢僔儑儞側偳偵巊偊傞傛偆偵峫偊偰偄傞丅巊偊偦偆側愝掕偼僐儞僾儔僀傾儞僗儅乕僕儞丒僐儞僾儔僀傾儞僗僗儘乕僾丒僩儖僋棪丒僷儞僠側偳丅寢嬊丄僗儘乕僾偲僩儖僋棪傪儊僀儞偱巊偭偰丄儅乕僕儞傕堦墳巊偊傞傛偆偵嶌傝偙傓偙偲偵偡傞丅丂僷儞僠偼弶婜愝掕偩偗偱傛偝偦偆乮幚嵺偼僨僼僅儖僩偺傑傑偱傛偝偦偆乯丂偦偺懠丄壛尭懍帪娫偲偄偆偺傕偁傞偑丄偙傟傕憖嶌偡傞昁梫偼側偄偐偲巚偭偰傞丅

寢嬊丄

侾丏弶婜愝掕丗僷儞僠丒壛尭懍帪娫丒僐儞僾儔僀傾儞僗儅乕僕儞丒僐儞僾儔僀傾儞僗僗儘乕僾丒僩儖僋棪

俀丏忬懺偵偰愗傝懼偊丗壛尭懍帪娫

俁丏摦嶌偵墳偠偰拃師愗傝懼偊丗僐儞僾儔僀傾儞僗儅乕僕儞丒僐儞僾儔僀傾儞僗僗儘乕僾丒僩儖僋棪

偲偄偆姶偠偐丅

傾僀儃偱偼8ms偲偄偆嵟彫僼儗乕儉偛偲偺妏搙僨乕僞傪巜掕偟偰偄偨偑丄儔儉僟偱偼婎杮揑偵儕僯傾側摦嶌偵尷掕偟偰丄僒乕儃傊偺摦嶌巜帵偼嵟彫尷偵彮側偔偡傞曽岦偱峫偊偰偄傞丅峔憐抜奒偱偼僼儗乕儉扨埵偺摦嶌巜帵傪偡傞偙偲傪峫偊偰偄偨偑丄僶儕僗僥傿僢僋側摦嶌傪偡傞偵偼偦偆偱偼側偔丄備傞偄娭愡偵偰掅偄僩儖僋偱摦嶌偡傋偒側傫偩傠偆偲峫偊弌偟偰偄傞丅幚嵺丄嵶偐側巜帵傪偟偰傕丄娭愡偺偑偨偮偒側偳偐傜偦傟傎偳尩枾側嵞尰惈偼摼傜傟側偄偺偱偁傞偐傜丄CPU偺晧扴傪彫偝偔偡傋偒側偺偩傠偆偲巚偆丅乮偦偺暘偦偺懠偺惂屼丒暘愅偵僷儚乕傪夞偡乯

偦偆偄偭偨峫偊傪傑偲傔偮偮傕丄婥偵側傞偺偼岺嶌偺恑傒嬶崌丅傾僞儅晹暘偺働乕僽儕儞僌傗丄僇儊儔怣崋偺RPU-100傊偺堷偒崬傒傪偳偆偡傞偐偲偄偆偙偲偽偐傝婥偵側傞丅婥偵側偭偰婥偵側偭偰巇曽側偄偺偱愭偵偦偪傜傪曅晅偗傞偙偲偵偟偨丅(^^乁

RS485偺働乕僽儖偼丄揔媂傾僙僥乕僩僥乕僾偱屌掕偟偰丄奜憰偱塀偦偆偲巚偭偰偄偨偑丄偁偪偙偪巇忋偘偰偄偔偆偪偵偪傖傫偲僫僀儘儞僶儞僪偱屌掕偟偨偔側偭偰偒偨丅丂壓敿恎偼1売強傪彍偄偰働乕僽儕儞僌偼姰椆丅巆偭偨1売強偼擄偟偄側丅僥乕僾偺傑傑偺曽偑偄偄偐傕丅丂偁偲丄榬偺働乕僽儖偼斅嬥晹暘偑彮側偄偐傜僥乕僾屌掕偺傑傑偺曽偑傛偝偦偆丅

拲暥偟偰偍偄偨傾儖儅僀僩僊傾偑撏偄偨丅憗懍僊傾偑旘傫偱偟傑偭偨僒乕儃偵庢傝晅偗傞丅峝偄偲暦偄偰偄偨偑峝偄偭偰偄偆偐庤偠傖擖傜側偄丅枩椡偱偖傝偖傝偭偲墴偟崬傫偩丅僙儞僞乕崌傢偣偵嬯楯偟偨丅

傾儖儅僀僩僊傾偲丄僾儔僊傾丅傾儖儅僀僩僊傾偼1500墌傕偡傞傫偩傛偹乣丅崅偄傛丅崅偄丅

傾儖儅僀僩僊傾偲丄僾儔僊傾丅傾儖儅僀僩僊傾偼1500墌傕偡傞傫偩傛偹乣丅崅偄傛丅崅偄丅

懌庱晹暘偺傾僢僾丅僫僀儘儞僶儞僪梡偺寠傪奐偗偰丄偒傟偄偵惍慄丅娭愡偺摦偒偱働乕僽儖偑悹傟偨傝嫴傑偭偨傝堷偭挘傜傟偨傝偟側偄傛偆偵拲堄丅

懌庱晹暘偺傾僢僾丅僫僀儘儞僶儞僪梡偺寠傪奐偗偰丄偒傟偄偵惍慄丅娭愡偺摦偒偱働乕僽儖偑悹傟偨傝嫴傑偭偨傝堷偭挘傜傟偨傝偟側偄傛偆偵拲堄丅

攝慄廃傝傕偩偄傇傫傑偲傑偭偰偒偨側偀偲巚偭偰偄偨偺偵偁傑傝鉟楉偠傖側偄丅偙傟偐傜RC僒乕儃傪巊偭偨摢晹暘偺攝慄傪偟側偒傖側傜側偄丅僇儊儔傕丄PSD傕3杮偢偮弌偰偔傞丅傕偭偲偖偪傖偖偪傖偵側傞偺偐丅丅丅傗偩側偀丅(>_<)

偝偰丄岺嶌偼偙傟偔傜偄偵偟偰丄僒乕儃惂屼傪恑傔側偒傖丅摢儐僯僢僩偺儅僀僐儞僜僼僩偲偐PSD偲偐丄僇儊儔夋憸偲偐丄僒僂儞僪愝掕偲偐傗傝偨偄偙偲偑偄偭傁偄偁傞偺偩丅

俉寧俀俉擔仭

嶐擔偵堷偒懕偒丄僐儞僾儔僀傾儞僗愝掕偺僀儞僾儕儊儞僩丅壛尭懍帪娫愝掕偲偄偆偺偑偁偭偰丄僗儉乕僘偵摦偔偨傔偵摦嶌奐巒丄摦嶌廔椆晅嬤偱壛懍尭懍摦嶌傪偡傞傕偺丅弶婜偺僒乕儃偺愝掕偱偼10ms偲偄偆悢抣偑愝掕偝傟偰偄傞丅偙偺偨傔偵儌乕僞乕傪斀揮偝偣傞傛偆側摦嶌傪偝偣偰傕柍棟偺柍偄摦偒傪偡傞偺偱偁傞偑丄摨偠曽岦傊偺摦偒傪楢懕偝偣傞偲偄偪偄偪尭懍偡傞偨傔偵僇僋僇僋偡傞丅

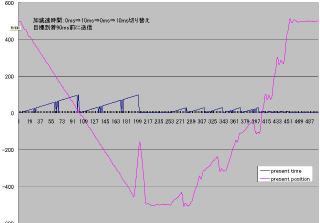

偙偺愝掕傪摦嶌偵崌傢偣偰擖傟偨傝徚偟偨傝偟傛偆偲巚偭偨偺偩偑丄偙偙偱栤戣敪妎丅僒乕儃偑摦嶌偟偰偄傞嵟拞偵壛懍愝掕傪擖傟傞偲丄偍偐偟側摦偒傪偡傞丅僌儔僼偱柇側怳摦偑偱偰偄傞偲偙傠偑偡傋偰偦傟偱偁傞丅丂傑偨傕僒乕儃偺栤戣側偺偐側偀丅丅丅

偲傝偁偊偢丄僩儖僋偲僐儞僾儔僀傾儞僗僗儘乕僾丒僐儞僾儔僀傾儞僗儅乕僕儞愝掕傪儌乕僔儑儞僨乕僞偵杽傔崬傔傞傛偆偵偟偨丅

摦偐偟偰傒傞偲丄丄丄丂廮傜偐偄娭愡愝掕傪峝偄娭愡愝掕偵愗傝懼偊傞偲丄偦偺弖娫偵價僉僢偲壒傪弌偟偰峝偔側傞丅巊偄曽擄偟偦偆偩側丅丂丂摲懱傗榬偼曕偔帪偼僗儘乕僾娚傔愝掕丅懌偼峝傔愝掕丅偙偗偦偆側帪側偳偼偺娭愡偩偗備傞傔偵偡傞偲偐偹丅

偝偰丄師偼僙儞僒乕儃乕僪偐傜僕儍僀儘僨乕僞傪庢傝崬傫偱丄巔惃埨掕偵僼傿乕僪僶僢僋傪偟偰傒傞丅偙傟偑傗傝偨偔偰傗傝偨偔偰丅丅丂(>_<)丂傆傜傆傜偟側偑傜棫偭偰傞曽偑儘儃僢僩偭傐偄偟丄摦偄偰傞姶偠偡傞傕傫偹丅丂壗搙偐僕儍僀儘僨乕僞傪庢傝崬傫偱傒偨傫偩偗偳丄愊暘偺偟偐偨偲偐丄僆僼僙僢僩偺張棟偲偐挷惍偑昁梫偦偆丅

偁偲丄傾僞儅儐僯僢僩傪巇忋偘偰偟傑偍偆丅働乕僽儕儞僌偲偐丄儅僀僐儞偺僜僼僩偲偐丅

僕儍僀儘偺僨乕僞張棟偵拝庤偡傞丅僕儍僀儘偐傜偺僨乕僞傪愊暘偟偰巔惃妏搙傪弌偟偰傒傞丅丂曻抲偟偰偄偨傜曄側抣偵側傞偐傜傛偔尒傞偲丄悢廫昩偍偒乮晄掕婜乯偵乽25087乿偲偄偆僨乕僞偑憲傜傟偰偔傞丅儘儃僢僩偼惷巭偟偰偄傞偺偵丠丠丠丂

曻抲拞丅偪傚偭偲斶偟偘丅丅丅

曻抲拞丅偪傚偭偲斶偟偘丅丅丅

傛偔尒偊側偄偗偳僄儔乕偭偰彂偄偰傞丅側傫偩傠側乕丅僒乕儃偲僙儞僒乕儃乕僪偼拞恎偵庤傪弌偣側偄偐傜偪傚偭偲崲傞丅偲傝偁偊偢丄25087偲偄偆僨乕僞偼僄儔乕埖偄偵偟偰傒偨丅

傛偔尒偊側偄偗偳僄儔乕偭偰彂偄偰傞丅側傫偩傠側乕丅僒乕儃偲僙儞僒乕儃乕僪偼拞恎偵庤傪弌偣側偄偐傜偪傚偭偲崲傞丅偲傝偁偊偢丄25087偲偄偆僨乕僞偼僄儔乕埖偄偵偟偰傒偨丅