�@�@

�@�@

�ߋ��̊J������1��

�ߋ��̊J������2��

�ߋ��̊J������3��

���X���Q����

�C��������Q�������X�V���Ă��Ȃ������B

���[�V�����Đ��������Ċߓ�����L�[�Ɏ��S�̂̓�����s�킹�邱�Ƃ��l�������A�߃f�[�^�̎擾�������������čČ������ۂĂȂ��B��������Ƃ��̈Ă͎̂Ă邱�Ƃɂ���B�A�i���O����ɋ߂����䂪�ł����Ȃ�ΐ��̂ɋ߂����䂪�ł��邩������Ȃ����A�����_�̃V�X�e�����ƑS�R�͕s���ł����B

�Ƃ͂����A���[�V�����Đ��ɂ͖߂�Ȃ��̂ŁA�V�����ߐ���̍l�������K�v�B�܁A�ߐ���̓T�[�{�̂o�h�c����̂��Ƃƌ����邩�瓮�쐧��Ƃł������ׂ����B���ǂ͋L�q����Č������l���Ăh�j���x�[�X�ɂ������[�V���������Ƃ��邵���Ȃ��ƌ��_���Ă���B���쐧��̗v�̓��[�V���������邱�Ƃœ��I�t�B�[�h�o�b�N�������邱�ƂƁA�œK����ւƃ��[�V�������w�K�E�C�����邱�Ƃł���B

����ɂ̓��[�V�������̂�v�f�ɕ������ĊǗ����邱�Ƃ��K�v�ƂȂ��Ă���B7���܂Ō������Ă����߃x�[�X�̐�����A�l�����͈ꏏ�ŁA�����̒P�ʂ��u�߁v�Ƃ����Ă��������ł���B�����A���{�b�g�̎��̓���͊ߒP�ʂɕ�������ƕ��G�ɂȂ�A���ړI�I�ȍœK���֓����̂�����ȋC������B

�h�j�x�[�X�Ő��䂷��Ƃ������Ƃ͎��̓�������W�Ǝp���̂U�v�f�ɕ�������Ƃ������ƁB

�����Ƃ��̑��̓����̂悤�ɕ��G�ȓ������r�I�ȒP�Ȋ��ŋL�q�ł���B

�܂��A�ߒP�ʂŐ��䂷�邱�Ƃ��l���Ă������͋L�������ׂ��P�������[�V�����i�߂̓��삻�̂��́j���A�\�V�A�g�����̂悤�Ȍ`�ŋL���E�Đ����邱�Ƃ��\�z���Ă������A���[�V�����̂悤�ȑ�ʂ̃f�[�^���L���E�Đ������i���킩�炸�Ɏ��Ԃ��߂����Ă��܂����B�@��������̓I�łƂĂ����͂�����̂����A�ЂƂ܂������Ă����A�����ƃv���O�����I�ȃf�[�^�L�q���@�Ŏ������邱�ƂƂ���B

���܁A��������ׂ����͓��I�ȃ��[�V������ւ��i��Ƃ͋�ʂ������j�ŁA���s���p�����邱�Ɓi��������s���艻�Ƌ�ʂ������j�B��̓I�ɂ͕~���ɂ��܂����Ă��]�Ȃ����s���{�b�g�������������ƌ��������B

���X���X����

�V��������\�����@�ł̕��s���삪����Ƃł����B�R�[�h�������Ă��邤���ɍ��E�̑���A����Ƃ̋�������̂��߂̋L�q���K�v�ł���Ƃ��A�ʑ�����̕\���Ƃ����������Ƃŕ\����ς������Ǝv���o�����肵�āA����ɏ��������Ȃ���Ȃ�Ȃ����ۂ��B

���݂̕\���́A�u���v��P�ʂƂ��āA���������������Ă���Ƃ����\�������A����ł͓��̊�̓���Ƒ����̓����_���I�ɕ\���ł��Ȃ��B�ȒP�Ɍ����ƁA���̊����Ƃ͑��悪�O�E�ɐڐG���Ă��Ȃ���Ԃ̓����A��������Ƃ͑��悪�O�E�ɐڐG���Ă����Ԃł̓����ł���B���{�b�g�͊O�E�ɑ��Ă̓���������O�E�Ƃ̊W�����邱�Ƃ��O��ł���̂ŁA���̊�̓��삾���ł͘_���I�ȕ\�����s�\���낤�B���̊����Ƒ�������ł͓��̂��锽�͂̃x�N�g���͋t�ɂȂ�͂��Ȃ̂Ńt�B�[�h�o�b�N���l���Ă������čl����K�v������B

����͈��̎��ԊԊu�ŃT�[�{�ɑ��č��W�f�[�^�𑗂葱���邱�ƂŔC�ӂ̊p�x�J�[�u������������肾�����B�T�[�{�͖ڕW�p�x�ɑ��ă��j�A�ɓ��삷��̂ŁA�\���������J�[�u�����j�A�ɋ߂����ɂ͑��M�R�}���h���ȗ�������ł��Ȃ����ƍl���Ă����B���ۂɓ������Ă݂�ƁA�T�[�{�ɖڕW�p�x�ƖڕW���Ԃ�^����Ɠ���Ƀ������o�Ă��܂��A��������ƃ��{�b�g���̂��U�����Ă��܂��B���ǁA���M�f�[�^�ʂ̈��k�͒��߂āA�ڕW���ԃ[���ł̃X�e�b�v�����ł̓���������������X���[�Y�ȓ��삪�s����Ƃ������ʂɂȂ����B

�R�}���h�^�T�[�{���Ăǂ��Ȃ�ł���ˁB���{�b�g�p�Ƃ��Ă͈Ӌ`�������C������B

����ł��p�x�╉�ׂ��擾�ł���Ƃ����̂͂�����Ă��Ăq�b�T�[�{�ł͗p������Ȃ��̂������B

���X���P�O����

�q�o�t�|�P�O�O�͖����k�`�m�Őڑ��ł���悤�ɂȂ��Ă��邪�A�L���k�`�m�A�_�v�^���g����B�A�Ȃ������Ⓑ���o���̎��ȂǂɃf�o�b�O�Ȃǂ��ł���悤�ɗL���k�`�m�A�_�v�^�������Ă������Ǝv�����̂����A�A�A�B

���삷��A�_�v�^���a�t�e�e�`�k�n��LPC-CF-CLT�Ƃo�k�`�m�d�w��CF-100TX�B�c�O�Ȃ���ǂ�������Y�I���̐��i�B�O�O���Ă݂�ƁA�ǂ���烂�o�C���[���ȂŎ��v������݂����ŃV�O�}���I���̓���Ȃɖ��O���o�Ă���B���Õi�ł���������~�����ȁB�u�����܂��v�Ƃ��ōL�������Ƃ������ȁB

�@�@

�@�@

�o�b�t�@���[�̂ق����������������ǁA10BASE-T�B�v���l�b�N�X�̂�100BASE-T������v���l�b�N�X�̂������ȁB�ǂ����ł��������ǁB

�E�E�Ǝv���ă��t�I�N���������Ă݂���o�b�t�@���[�̂��o�i���Ă��B�K���ɂ��Œᗎ�D���i�ݒ�B�����œ��D���ė��D���܂����B�R�T�T�O�~�B10BASE-T�̃J�[�h�ƍl����ƍ������ǂˁB��ɓ����ꂻ���ł悩�����[�B�@�������A�Ηj�����璆���o���Ȃ��ǁA����ł��邩�ȁ[�H�H

���X���P�Q����

���������T�Ԏd���Œ����֏o���B���A��s�@�̒��ł���������Ă܂��B�����z�e������A�b�v�ł��邩�ȁ[�Ǝv���Ă���ǂł���̂��ȁH

���߂ăr�W�l�X�N���X�ɏ�������ǁA���̂��������K�ł��B�G�R�m�~�[�Ƃ̍����傫���Ȃ��B����Ƀt�@�[�X�g�N���X���Ă͍̂�������킯������ǂ�Ȃ낤�B�i��������ƂȂ����A�������邱�ƂȂ����낤���ǁj�r�W�l�X�N���X�́u���K�v�����ǁA�t�@�[�X�g�N���X�́u���ʁv���ċC������ȁB�t�@�[�X�g�N���X��������O�̐l�ɂƂ��Ă͂��̖��ʂ����R�Ȃ낤���ǂˁB

�����������{�������J�Â���邯�ǁA���N�̂���́u���������сv�炵���B���{�b�g�p�T�[�{�̃g���N��40�s�E�����ɓ˓����ĂƂ��Ƃ��W�����v���\�ɂȂ����炵���B�����_�Ɏg���Ă�T�[�{�͌���20�s�E�p�Ȃ��ǁA�����̂ɂ͎x�Ⴊ�Ȃ����炢�̃g���N�ɂ͂Ȃ��Ă���B���̔{�̃g���N���Ăǂ�Ȃ낤�ȁB�X�ɃW�����v����ɂ͕G��{���œ������K�v������̂Ń_�u���T�[�{�ɂ�����Ă̂������B�����_�ɂƂ��ăW�����v�Ȃ�Ă̂͐�̂܂��悾���ǁA�G�߂��_�u���ɂ�����Ă̂͌��ʂ����邩������Ȃ��B

�ߓ��Ȋw��40�s�E�p�T�[�{���y���Ė��͂�����̂����A���ǂ͂q�b�T�[�{�B�q�b���{�b�g��ΏۂɊJ������Ă���B�g���N�ƌy���͖��͂Ȃ��ǂȁB

����A�t�^�o��_�C�i�~�N�Z���̃C���e���T�[�{�i�R�}���h�T�[�{�j�̓C���e��������r���[�B���{�b�g�p�Ƃ͌����Ă��邪�A���{�b�g�ɂ͓K���Ȃ���Ȃ����Ǝv���B

�C���[�W�Ƃ��Ă̓A�i���O�ȃT�[�{���K�v�Ȃ̂��Ǝv���B�C���v�b�g�A�E�g�v�b�g�������ʂŏ펞���o�͂���Ă���悤�Ȋ����B�܁A���ۂɂ̓f�W�^���f�[�^��PWM�M���ɂ���̂��낤���B�R�}���h�T�[�{�ɍ̗p����Ă���RS485�͔���d�Ȃ̂��C�ɓ���Ȃ��B���A�ŃT�[�{�̏擾�͉�b�^�ɂȂ��Ă���̂ŃI�[�o�[�w�b�h���傫���B�ʐM���x���x���Ƃ��Ȃ�Ƃ��������͐F�X���邪�A�C���e���W�F���X�̐蕪����������Ă�̂ł͂Ȃ����ȁ[�Ǝv�����肷��B�e�߂̎��C���e���W�F���X���x�����Ⴗ����Ƃ��������B�v���O�����̈悪�J������Ă���C���e���W�F���X�T�[�{���K�v�Ȃ̂��ȂƎv���B�ʐM������RS485�̂悤�ȃ}�X�^�[�X���[�u�ł͂Ȃ��A���ݒʐM���\�Ȋ����BATMEGA128���x��MICOM�ł������̃T�[�{��S�����Ă��Ă̂͂ł��Ȃ����ȁB1CPU������̎������T�[�{3���炢�Ȃ�Ȃ�Ƃ��Ȃ邩���B

�n�C�g���N�T�[�{�̕K�v���ɂ��Ă̓o�����X����������ɓ|�������ɑ����o����������Ȃ���Ȃ�Ȃ����ǁA���x���d�v�ɂȂ��Ă���B�ꉞ�\�����������Ă݂悤���ȁB

�����_�̍\�z�ɂ̓��A���^�C���ł̃T�[�{�̊p�x�ƕ��ׂ̃��j�^�����O�A�g���N�̐��䂪�s���Ǝv���Ă���̂�����ǁA������������Ă���̂̓t�^�o�̃T�[�{�ƃ_�C�i�~�N�Z���B�@�g���N�ƃT�C�Y�i�d�����j���l���Ă��_�C�i�~�N�Z�����x�X�g�̂悤�ɂ��v���邪�A�E�E�E���l���Ă��t�^�o�T�[�{�����I�����͂Ȃ������ȁB���ǂ̓t�^�o�Ɍ��C�������̂���肾�B

���X���P�T����

�v���Ԃ���x�X�g�e�N�m���W�[�̃z�[���y�[�W���`�F�b�N����DYNAMIXEL���T�[�{�̐V���i����������邱�Ƃ�m��B

�Ȃ�ƃg���N���ő�U�S�s�E�p�ȏ������炵���B�������A���i��38,850�~�߂�����B������@��DX-117�����i������25,200�~�ɂȂ�݂����B

�����_����������������悤�ɂȂ�����A�g���N������Ȃ��Ȃ�悤�ȋC�����Ă���B���̎��ɂ͂����Ƃ����T�[�{���o�Ă��邩������Ȃ����A�������ł�DX-117�Ȃǂɂ���K�v�����邩������Ȃ��Ǝv���悤�ɂȂ��Ă����B

�ڎw���Ă���̂̓o���X�e�B�b�N���s�ł��邾���ɁA�g���N�����`�ł͂Ȃ��̂�����ǁA�p������������ɉ���ɂ͈ꎞ�I�ɂ��ߑ�ȃg���N���K�v�ɂȂ�̂ł͂Ȃ����Ǝv���B

���肵�ĕ�����S�����s�̃��{�b�g����肽���Ȃ��Ă����ȁ[�B�B�@�V�O�}���B�B�B

���X���P�V����

�����͓��j���i�̂͂��j�A�d���ɓs�������Ĉ���I�t�ɂ��܂����B�s���Ńz�e����ς������ǁA���̃z�e���̓C���^�[�l�b�g�ɂȂ��̂��L��(-_-;)�@���̏���1000�~�����炵���B������ƃo�J�炵���̂ō�������̓C���^�[�l�b�g�Ȃ��ŕ�炷���ƂɁB

�����_�̑��T�[�{��DX-117���g���āA�]����RC601CR���S�����s���{�b�g�i�N���^���{�b�g�j�ɗ��p���āE�E�E�ƁA����ʕ����ւ̍\�z���i�݂���B����ȏド���_�̕��s�����x�点��̂͂܂����ȁB��蓹�͂悵�����������ȁB

���X���P�X����

����ƒ����ł̎d�����I���A�A���̔�s�@�̒��B����̒����o���͐����Ȃ��C�O�o���̒��ł���r�I���������������ǁA�t���[�^�C���͂قƂ�ǂȂ������̂Ŋό��Ƃ��������ɂ͂��܂�s���Ȃ������B�����Ȃ�DYNAMIXEL�A��p�Ȃ�PC�p�[�c�Ƃ����邯�ǁA�������Ⴛ�������ʂ̌������Ȃ����炠��܂肷�邱�Ƃ��Ȃ����������B

�����o�����ɓ���̕\�����@�Ƃ��āA���̊�Ƒ������܂Ƃ߂��A�u����v���x���ł̃f�[�^�\�����l���悤�Ǝv���Ă������ǂ���ɂ��Ă͉����i�W�����������B

�u���v�Ƃ��u�r�v�Ƃ������̂�ėp�����������ĕ\�����Ȃ����Ⴂ���Ȃ��悤�ȋC�ɂȂ��Ă��邯�ǁA���R�Ɏ葫����������悤�ȃ��{�b�g�Ȃ�܂������g�̍\���͌Œ�Ȃ̂�����u���v�E�u�r�v�Ȃǂ͌Œ�ł����̂��ȁB�X�ɂ͍��E�́u���v�u�r�v�̊W���Œ�Ȃ킯�����A�����_�ɓ��������f�[�^�\���A�N���X�\���ł����Ɗ����Ε\���͐����ƊȒP�ɂȂ�͂����B

���X���Q�O����

�����o���O�Ƀ��t�I�N�Ŕ�����CF�̗L��LAN�A�_�v�^�A��������Ɠ���m�F���ł��܂����B

OS��̃f�o�C�X���Ƃ����킩��Ȃ������̂ŃR���\�[���łȂ��Ł@ifconfig -a�@�����Ă݂���A�@ne0 �Ƃ����f�o�C�X���łȂ����Ă��BIP�A�h���X�͖���LAN�̎��Ɠ����ݒ�B�ӂނӂނ܂�X���b�g�ɍ������ނ����Ŗ���LAN�̎��Ɠ����悤�ɍl��������킯���B���ƂŁ@/etc�@���݂���A ifconfig.ne0 �� ifconfig.wi0 ���������B���Ȃ݂ɖ���LAN�A�_�v�^�̃f�o�C�X���́@wi0�@�ł��B

�������A���̗L��LAN�A�_�v�^������Ɩ���LAN�̎����RPU-100�����яo�����@���傫�����߁A�T�[�{��ON�ɂ��Ęr�������肷��ƃA�_�v�^�ɃK�c���K�c���Ɠ������Ă��܂��B�L��LAN�łȂ��Ȃ���T�[�{�������Ă͍̂l���ɂ�������܂��������B�J�����Ƃ��}�C�N�E�X�s�[�J�[�Ƃ��̃\�t�g�f�o�b�O�p���ȁB���������LAN���������ꍇ�́B

���X���Q�Q����

�������Ă����̓Z���T�[�A�k���d�C�H�Ƃ�HFD-500�����ׂ����ƘA�����������̂Ŏ��ɏH�t���֍s�����B�Ђ��݃Q�[�W���`�b�v�������悤�Ȃ��̂ŁA�}�C�R���œǂݍ��߂�悤�ɂ���ɂ͍쓮�A���v���Ȃ�����Ӊ�H���K�v�ł͂���̂����A����₷�����������ɂ悳�����Ȃ̂��݂���Ȃ������̂łƂ肠��������ő����Z���T�[������Ă݂悤�Ǝv�����������B10���������̂����A10���ƃT���v���������Ă��Ƃ�1��1100�~�������B�܂���100��������1��100�~�ɂȂ����肵�Ȃ����낤�ȁ[�B

�@�@

�@�@

�����͒������H�t�����u���u�����āA���傱���傱�Ɣ������������B

�@�@

�@�@

�f�W�^���e�X�^�[�ƃ��W�b�N�e�X�^�[�ƃf�W�^���p���T�[

�e�X�^�[�Ƃ����ƁA���Z1�N���̎��Ɏ��K�őg�ݗ��Ă��A�i���O�e�X�^�[�����܂܂ł��[���Ǝg���Ă����̂����A�Ƃ��Ƃ��f�W�^���e�X�^�[�����A2000�~�B�����Ȃ��B�I�V���X�R�[�v���~�����Ȃ��B�@���W�b�N�e�X�^�[�͌������̐搶���l�Ă����n�C�C���s�[�_���X��Ԃ�����������e�X�^�[��H���������̂����A�������Ă��܂��Ď����ōl���Ă݂��̂������܂������Ȃ��āE�E�E�Ƃ����ꂢ�v���o������܂����B���W�b�N�e�X�^�[�ƃf�W�^���p���T�[���킹��1200�~�B�@�g��Ȃ���������Ȃ����ǂˁB

�E���̂͗L���ȏ�C�≮�̌���MP3�v���C���[�B�@990�~�ł����B�@SD�������[�J�[�h���]���Ă����炿�傤�ǂ�������Ă��ƂŔ����ė����B�ꉞ�͎g����ˁB�Đ��ȏ���ύX����ɂ̓t�@�C����3���̐�����t�^���Ă����������Ă̂ɂ͂܂���܂����B�@���x�PGB�̃~�jSD�����ė��悤�B2300�~���炢�ł����B

�h�b�c���Ă������蕨�B�}���I�Ƃ��g���Ƃ��̂����������ǁA�s���Č�����h���A�[�K�Ƃ��}�b�s�[�Ƃ����������B��D���ȃh���A�[�K�̂��ė����B�����Ƃ����������Ǝv�����猋�\�傫���́B

�U�R���قɃX�s�[�V�[�Y�������Ă���̂ŁA�H�t���֍s�������͗������̂����A���ς�炸RS601CR�����u���ĂȂ��BRS401CR��301���������̂����t�^�o�̃R�[�i�[����Ȃ����疳���Ȃ̂��ȁB

DX-117�ő����\��������25,500�~�~14��=357,000�~�@���ꂾ���̓����̉��l�͂���̂��ȁ[�B

���X���Q�R����

��͂�A�Ȃ�̊m���Ȃ��܂܂Ƀ��{�b�g�̃g���N�A�b�v�������s���͖̂��Ȃ̂ŁA���݂̃n�[�h�Ō����𑱂��邱�Ƃɂ���B�����A����̃����_�ł͑��Ӄg���N�s�����[��������͖̂����Ȃ̂Ŏ��̃n�[�h�ւ̌��������ʉ��Ői�߂Ă��������Ǝv���B

CPU�����ŁARPU-100�̃��\�[�X�s�������ӂ���Ă��邾�낤�BOS���I�[�v���ł͂Ȃ����A�X�g���[�W�����Ȃ��͍̂��㑫�����ɂȂ肻���ȗ\��������BCPU�Ƃ��Ă̓r�W�I���V���[�Y�����ڂ��Ă����s�m�[��CPU�{�[�h��������Ȃ����Ǝv���Ă�BOS�̓��i�b�N�X�ɂȂ�̂��ȁHNetBSD�͑���̂��낤���H�J�����Ɩ���LAN��USB�ڑ��ɂȂ肻�������t���[UNIX�͑Ή����Ă�̂��ȁB�l���肾���������ɂȂ��Ă��܂����������AI/O�{�[�h�Ƃ��Ă����������͓I�B�L��LAN���Ȃ�����USB���疳��LAN���g����Ζ��Ȃ��͂��B

���̂Ƃ��ɂ̓T�[�{�͑���RX-68�A�r��DX-117���č\�����ȁ[�B100���~�z���������ȁB(-_-;)

���܂�2�����s�����܂��s���Ȃ��̂ŁA�����͎������{�b�g������Ă������A�S���ł�������Ȃ��H����12�̃T�[�{��4�����{�b�g���邩��B�B�@�Ǝv���Ă݂����A�N���^�̃��{�b�g�ɏ㔼�g�����Ă�̂��Ƃ����낤�낵�ĂĂ������Ȃ��Ȃ����Ďv�����B(>_<)�@����ς�2���̕����������ȁB

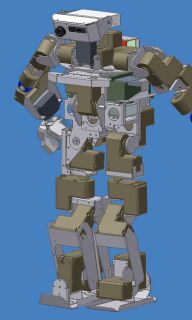

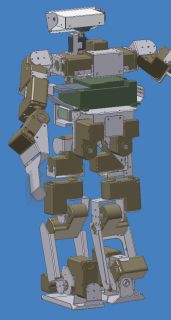

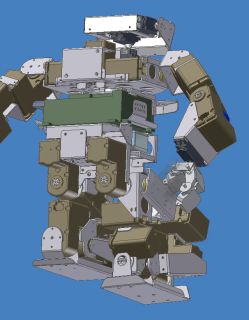

����̃��f�����͐F�X�ƃA�C�f�B�A�ƐS�z���Ƃ��o�Ă��Ď������c�_���܂Ƃ܂�Ȃ��B�|�C���g�͓���̎��ȕ���ł��邱�ƁA�p�������ꂽ���Ƀt�H���[���삪�ł��邱�Ƃ��Ă��ƂȂ̂ŁA��f�[�^�����ȍ\�z�ł��邱�ƁA�n�ʂ���Ƃ����̎p�����ςƂ������쐶�����ł��邱�Ƃ��K�v�B

��f�[�^�Ƃ��Ă͗\������ɂ���A�J�E���^�[�ɂ���Ȃǂ����肻���B�@��̕����͂��̑O��̓���ɋ����W���邪�A���[�����g���l���Ȃ���Ȃ�Ȃ��B���ۂɂ͕��ʏ�̃x�N�g���Ƃ��čl���āA���̃x�N�g����ł������`�ŕ�����^����Ƃ������ƂɂȂ肻���B

2�����{�b�g�͂��������Ă��邾���ł��_�C�i�~�b�N�Ȑ��䂪�K�v�B���R�x������1�̃T�[�{�ł͂Ȃ��A�����̂悤�ɐL�Ək�̃o�����X�Ő��䂵�������o�b�N���b�V�����X�ɂȂ�̂ŗ��z�Ȃ̂��낤�ȂƎv���B

�d�S�ړ��̃f�[�^�������悤�Ǝv���ē]�|�h�~�̃X�^���h��������B�ڕ��ʂōޗ����ė����炿����ƍ������Ⴉ�����B(>_<)�@�����j�b�g�������瓪����������B

���X���Q�S����

�l����Ƃ��낢��ƕs�����o�Ă��āA�\�����������Ă݂邱�ƂɁB

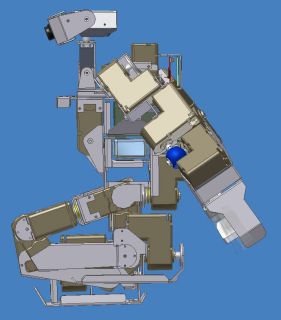

�����_�̑��͔w��Ⴍ�}���邱�Ƃ𒆐S�ɍl�������ʁA��ڂ����̒������Ⴄ�B�܂������ɂ��Ⴊ�ނƌ��ɂЂ�����Ԃ��Ă��܂��B�����ł����A���̂̏d�S�������Ȃ̂Ń����_�ɂƂ��Ă͂��Ⴊ�ނ͓̂���p���ƂȂ��Ă���̂��B�@�܂��A�G���Ȃ��ė������Ƃ��A���̃N�����N���������傤�ǐ܂肽���܂��`�ɂȂ��Ă��܂�i�D���ǂ��Ȃ��B

�ŁA�Ҋ߂�Y����]�T�[�{��Ў����ɂ��āA��ڑ���X����]�T�[�{���ڂ��A��ڂ������Z��������A���̃N�����N�������������肵�đ�ڂ����̒������ɂ��Ă݂��B�����̂̒����͂قƂ�Ǖς��Ȃ��B�����A�Ҋ߂�X����]�͈́A���Ƀ}�C�i�X���̓���͈͂��m�ۂ��邽�߂ɌҊ߂̒������ʒu��������O�Ɉړ������B���̂̏d�S�͍X�Ɍ��ɂ��ꂽ�i�D�ƂȂ��Ă��܂����B

�@�@

�@�@

�@�@

�@�@

�Q�����s���{�b�g�̑��\���͓��̂ɌҊ߂�Z����]�T�[�{�������A�Ҋ߂Ƒ���͒����u���b�N�A�����ĕG�̓_�u���T�[�{�Ƃ����\������{�ƂȂ�̂ł͂Ȃ����B���ɐv����Ƃ��͂������悤�B����ɂ��Ă�RS601CR�͎������Â炢�T�[�{�ł��B�@(>_<)

���X���Q�T����

�V���\�������������B����̒����u���b�N�܂Ō����������ƂŁA���Ⴊ�ݎp���̑��̉��͈͂������Ɗg�債���B����Ȃ��Ԋ|���ĉ��ǂ��鉿�l�����邾�낤�B�G�̘A�����i���`���`�Ȃ̂ł�����H�v�v�邪�A�T�˕ύX�͖������낤�B�B�ꌻ�݂̍\���̕������͈͂��L���̂���딽��Ԃ�̎p���B�ł����̎p���͋��炭�K�v�Ȃ����炢�����낤�B�@�ڒn�����قڑO��ŋϓ��Ȑ��@�ɂ����B�@���X�������グ�邱�ƂŃX���[�Y�ȕ��s�p���i�G���Ȃ��Ȃ����s�j���Ă̂��o����悤�ɂ��Ă��Ƃő���߂���둤�ɔz�u�����̂����ǁA����ȂƂ��܂ōs���Ȃ��̂ň��萫�D��ł��B

�@�@

�@�@

�������ڂ͂���܂�ς��Ȃ��B

�@�@

�@�@ �@�@

�@�@

���������V�\���B�@���̒��S�ɑ�����悤�ɂȂ����B

�@�@

�@�@

���X���Q�V����

�T�[�{�ɐ��\�~���b�P�ʂŃf�[�^�𑗂��ē������Ă݂Ă��邪�A�ǂ��������ɔ[���������Ȃ��B�������Ђǂ��̂��B20ms���̃X�e�b�v�����Ői�߂Ă������A�Ȃ�ƂȂ����삪�s����B�J��Ԃ�����Ȃ̂Ƀ^�C�~���O������Ă����Ȋ����B����̐ߖڂ܂ł̈ړ��f�[�^�𑗂����ꍇ�Ɣ�ׂ�Ɠ����̈Ⴂ����R�Ƃ��Ă���B���ꂶ��A�i�߂��Ȃ��B

�����݃f�[�^�œ������ƃg���N���o�Ȃ��B����̓R���v���C�A���X�X���[�v�ɑ傫�Ȓl�������Ă�������ŁA�����݂Ȃ̂ŖڕW�p�x�܂ł��߂��̂ŁA�g���N���o�Ȃ��̂��B�@�������������̉������p�����[�^�̐ݒ肪�ԈႦ�Ă���̂ł́H�Ƃ��v�������A�����������B�������p�����[�^��ݒ肵���疬�����Ƃ��Ă��Ђǂ��Ȃ����B

���P�O���P����

������烉���_�̑��\�����Ǘp���i���쐬�B�y�j�������łł��邩�ȁH�Ƃ��v���Ă������A�����������I���Ȃ������B�@���T�̋x�ݒ��ɂ͊������邾�낤�B

�@

�@

����@���ǂ��ꂾ���̕��i����邱�ƂɁB�B

����@���ǂ��ꂾ���̕��i����邱�ƂɁB�B

�E��@���~�c�P�����B�@�����v������莞�Ԃ�������B

���@�z�[���\�[���g���A���������ł��Ȃ������B�@���Ƃ͗��T�B

�v���Ԃ�̔��H��Ȃ̂ŁA�ׂ��ȃm�E�n�E��Y��Ă��܂��Ă���B�v���o���āA�e�N�j�J���m�[�g�ɋL�^���Ȃ��������肵�Ă��B�I�v�e�B�J���Z���^�[�|���`�̔̔��X��T���Ă���A�ȑO�ɒT���Ă����x���_�[���������B����͂��������B$500���邯�ǔ������Ⴂ�����ȁB���̃����_����鎞�ɂ͂�����Ĕ����Ȃ��悤�I

���P�O���W����

��T�̑����ŁA�����H�B�@�y�j������g���Ă��܂��I���Ȃ��B�[���U���ɂ���ƃ��X�������������B���̌�e���r�����Ȃ���J�G�����B�c��͌��j���A�܂��͗��T�̓y���B�@���\������ȁ[�B�@�O��͂����ƍ����߂čH�삵���������������Ƒ��������̂��ȁB�@�T�[�{�̐����F�X�������Ă���Œ��Ȃ̂Ń����_���炵�Ă��܂��̂͂�����Ɣ��������C���Ȃ̂Ńu���[�L���������Ă�̂����B

���j���͏o���������łɓ��}�n���Y�ɂ���Ĕ������B�@���Ȃ��������������_�p�X�^���h������������Ȃ������̂ł����������������p�C�v���ė����B

�n���Y�̒������Ă܂���Ă�����ʔ������Ȃ��̂��������B

���C�I���{�[�h���Č����炵���B�@����ŊȈՓI�Ƀ����_�̊O�������邩���B���Ȃ��Ƃ��f�U�C�����l���邽�߂̃c�[���ɂȂ肻���B

�C���x���^�[���Ď��R�ȖʂƂ��͕`���Ȃ��݂����Ȃ�ˁB�`����̂��ȁH

����͍�Ɨp���[�y�B�X�^���h���̏�Ƀ��C�g�܂ł��Ă�̂ɂP�W�X�O�~�ƈ����BSMD�̔��c�t���͂�������ł͂炢�B���ꂭ�炢�̃��[�y������ł���Ǝv���̂����B

���P�O���P�R����

�����H���r���Ȃ̂����A���܂ł����^���^���Ă���T�[�{����ɂ��Ă����_���o���Ȃ���ΐ�i�߂Ȃ��Ǝv���A�p���`�ݒ�E�R���v���C�A���X�ݒ�E�������ݒ�ȂǂƖ����̊W�����悤�Ǝv�����̂����A�ǂ����T�[�{�̏����������܂��s���Ă��Ȃ��悤�Ȃ̂ɋC�t�����B

�ǂ����}���`�T�[�{�R�}���h�����܂��������A�T�[�{�̏��������ł��Ă��Ȃ��B�������ݒ���v���ʂ�ɐ�ւ��Ȃ����Ƃɍ��X�C�t�����B(>_<)

115200bps�ŃR�}���h�𑗂�Ɛ���ɓ����̂����A460800bps���Ɠ����悤�ɂ͍s���Ȃ��̂��B���C�u�����[���̃o�O���ۂ��̂����A�X�s�[�V�[�Y�̑Ή��͓��ĂɂȂ�Ȃ��̂Ńv���O�����œ����邱�Ƃɂ���B���ǁA�T�[�{������8byte�̐ݒ�f�[�^���ƁA��x�ɑ����T�[�{����6�����E�B�i6byte�ɂ����8�T�[�{�܂�OK�j���ꂪ115200bps����22�T�[�{�ɑ���8byte�f�[�^�i���v�F176byte�j�ł����Ȃ����삷��̂��B������l�������������v���O�����ɂ��Ē������ĊJ�����B

���ꂼ��̐�����@�����̂悤�ɌĂԂ��Ƃɂ���B

�@�R�}���h����F�߂̊p���x�����ɋߎ����ăT�[�{�ɑ��Ă͖ڕW�p�x�Ɠ��B���Ԃ��w������B

�A�p���X����F�ߊp�x�������w�����A�T�[�{�ɂ̓X�e�b�v������A���I�ɍs�킹��B

�B�Z�R�}���h����F�T�[�{�ɑ���R�}���h��100ms���Ƃ��A�Ȑ��ߎ�����B

�E�Z�R�}���h����ł͖����͎��Ȃ��B�p���`�E�R���v���C�A���X�E�������ݒ肷�ׂČ��͂Ȃ��B

�E�Z�R�}���h����ł̃R�}���h��ւ�莞�ɂ̓g���N���ێ�����Ȃ��B

�E�p���X����ł̐U���͂قږ����ł���B20ms�������z�B30ms���܂ł͋��e�ł��邪�A40ms���ƂȂ�ƐU�����ڗ��B

�E�p���X����ł��g���N�͗�����B

�E�R�}���h����ł̓f�[�^���M�����Ȃ��čςނ��A�f�[�^�G���[�����������Ƃ��̉e���͑�B

�E�p���X����ł̓f�[�^���M�����ɑ����B�������A�f�[�^�G���[���������Ă����̃f�[�^�������ɂ���̂ʼne���͏��Ȃ��B

�E�R�}���h����ł́A����Ӗ�����\������̂����A�L�����Z����r����~���o���Ȃ��B

�����̓_���l����Ǝ�������肽���I�����o���X�e�B�b�N������s���ɂ̓p���X���䂵���Ȃ������ł���B�t�B�[�h�o�b�N�v�f�����Ȃ��A�g���N���K�v�ȏꍇ�̓R�}���h������̗p����Ƃ������p���l�������A����ł������̖��͎c��̂ŁA�܂��̓p���X���䒆�S�Ői�߂邱�Ƃɂ����B

���ǂ�PWM�T�[�{�̂悤�Ȑ��䂪��ԗ��z�I�Ȃ悤�Ɍ�����B�T�[�{���̎擾�Ɨ����ł���悢�̂����A���̂Ƃ���͂���ȓs���̂����T�[�{�͖����ł��ˁB

���P�O���P�W����

��T���ŐV�\���̍H��͊��������悤�Ǝv���Ă����̂ɁA���H�쐸�x�������đg�ݗ����Ȃ��B�@�Ȃ�������݂��Ȃ��������߂ɋȂ��ʒu������Ă��܂����悤���B�O��͂Ȃ�Ƃ��g�߂��̂ɂȁB�@���T���܂Ŕ����H�͂ł��Ȃ����A������Ƃ�������B�@�v�͋Ȃ��������������`�Őv�ύX�����Ă������B

�����ɂ��ẮA�T�[�{�̃t�@�[�����ŐV�ɂ���Ή��P����Ă��邩���I�@�Ƃ������ƂŃX�s�[�V�[�Y�ɖ₢���킹�����Ă������̂�������ɕԎ��������B�@�Ԏ��̍Ñ���������ǂ����₢���킹��̃��[���A�h���X���ς���Ă����炵���B�@���ϓ��e�ɂ��Ă͑o�t�d�q�H�Ƃɕ����Ă���Ƃ̂��ƁB�@�����Ă���Ă������̂ɁB�B(-_-;)

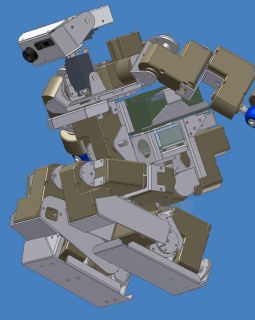

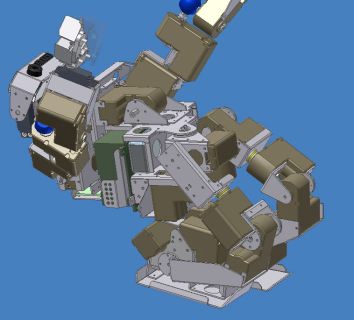

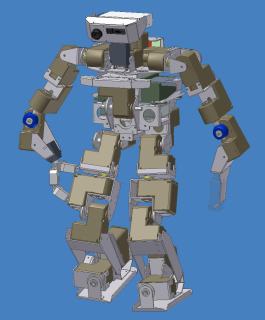

�V���\���̃����_�S�i�B�@�l�W�������ƃ��f�����O���Ȃ��Ɛv�`�����{�̌����˂��`�B�@�߂�ǂ������B

�V���\���̃����_�S�i�B�@�l�W�������ƃ��f�����O���Ȃ��Ɛv�`�����{�̌����˂��`�B�@�߂�ǂ������B

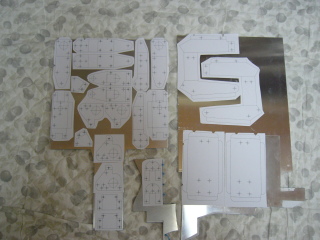

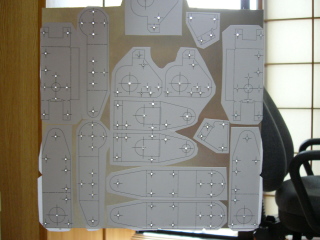

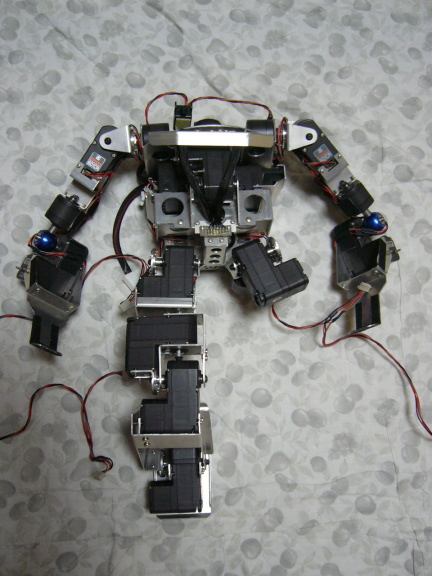

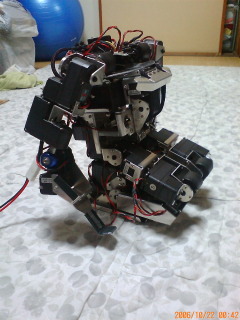

���g�ݏ�Ԃ̃����_���B�@�����͕��i�s�ǂőg�݂�����Ȃ������B�@�@������B�B�B

�����Ƃ��ς�����Ҋߕ����̃A�b�v�B���ɕς�����\������Ȃ����ǂˁB�O�̍\���̕����ς���Ă��ȁB�B(^^�U

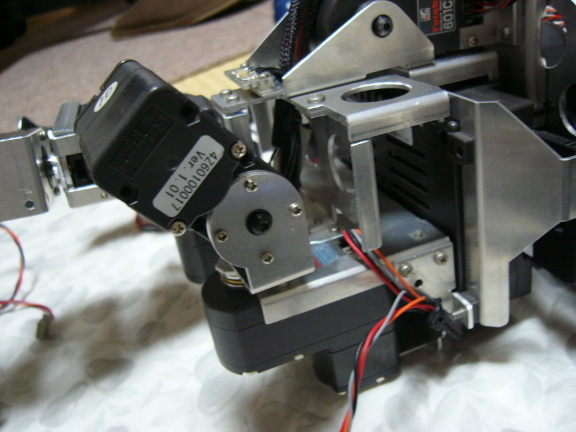

�Ҋ߂ɕЎ�����������͕̂s�������ǁA�X���X�g�x�A�����O������Ă邵�A���̏d�ʂȂ���v���ȁ`�B�@���̃T�[�{�̂������̒����\�����ĕЎ����Ȃ�ˁB

�g�b�v�y�[�W�Ɂu���{�b�g�ɂ��Ă̍l�@�v�y�[�W��lj������B�@���{�b�g���Č����Ă������̃��{�b�g�◝�z�̃��{�b�g�ł͂Ȃ��A�����_��A�C�{�Ƃ������A�����̃��{�b�g�̎�����i�ɂ��Ă̍l�@�ɂ��悤�Ǝv���Ă�B�v���Ƃ���͂���������ǁA�Ȃ��Ȃ��i�܂Ȃ����Ĕ]���ŕ����Ă��܂�����������Ƃ肠�����Ⓚ�ۑ��������B�@�����_��A�C�{�ł̎����ƍ��킹�ĕ��͉�����̂��{�ł͂��邪�B�@�I�߂ɂ��Ă͌��e���Ă͍�������ǁA�~�܂��Ă�B���˂B

���P�O���Q�P����

�������̕��i����蒼���Ă���Ƃ������ǔŃ����_���g�݂��������B

�@�@

�@�@

�ς��ƌ��͕ς��Ȃ����ǁA���Ⴊ�ގp�����������Ȃ����B�@�ł��A�P�[�u���̒����͑S�R�ς���Ă��܂����̂ō�蒼�����Ȃ��B�@������Ɛؒf�������ȉӏ������邵�B�@���ƁA���E�ɂP�������T�[�{�̃R�l�N�^���Ɍ����J����̂�Y��Ă���ӏ�������B�@�������܂��H�삾�Ȃ��B

�T�[�{�̃t�@�[���̃o�[�W�����A�b�v��CPU���j�b�g�������ɍs��Ȃ���Ȃ�Ȃ��炵���B�@�Q�T�Ԃ�����炵���B�@�������������������̂��낤�H�@�o�t�ɖ₢���킹�Ă��Ԏ��Ȃ��B�@����ƁA�Â��T�[�{�������Ă�l���V�����b�o�t���W���[�����g���Đڑ�����ƕs����o��̂��B�@�܁A�q�r�U�O�P�b�j�Ƃq�o�t�|�P�O�O�͈�ʔ��肵�Ȃ��݂�����������v�Ȃ̂��낤���H�@�T�[�{���݂̎��ɍ���̂��B

���႟�A�A�A�T�[�{��a���Ă�Ԃ͂ǂ����悤���B�����F���\�t�g�̈ڐA�����Ƃ��A�����Z���T�[�̐v�����Ƃ��A�܂����邱�Ƃ͂����ς�����̂����B

�A�C�{���g�����J���̊����L�^���܂Ƃ߂���Ă̂���肽�����ǁA���ԂȂ��Ȃ��B

���P�O���Q�Q����

���\���̉��ǂ��I����āA�T�[�{�̐�����@�����܂��āA����Ɩ{�_�̓��쐧��ɖ߂��B�@���̍\���������͍��̂Ƃ��됬���̂悤���B�܂������ɑ����k�߂邾���ł��Ⴊ�߂�B���̂܂܃T�[�{�Q�C�����I�t�ɂ��Ă������Ȃ����A�悩�����悩�����B�������A�T�[�{�Q�C����90%�ɂ��Ă������ǁA�����オ��̂ɕG������100%�ɂ��˂Ȃ�Ȃ������B�g���N����Ė����Ȃ��Ǝ������Ă��܂����B

�T���ɍŐV���̃��{�b�g�w����͂����B����̓��W�́u�����E�̐����𗘗p�����m�o�Ɛ���v�B�@�����o���X�e�B�b�N���s���l���Ă��鍡�A�^�C�~���O�������悤�Ɏv���ēǂ�ł݂��B�_�C�i�~�N�X�x�[�X�h����ɂ��Ắu�V�Ł@���{�b�g�̗͊w�Ɛ���v�i�L�{�쒘�j�ɏڂ����炵���A�Q�l�ɂȂ肻���B���͐����ƑO�ɖʔ����������甃���ĉƂɂ���̂����A�J���Ƃނ����������đS�R�킩��Ȃ������̂��B�@�ǂނƈ�u�Ŗ��̐��E�ɘA��čs���ꂻ���ɂȂ�̂łȂ�ׂ������͓ǂ܂��ɑS�̂�ǂނ悤�ɁB�@���ƁA���ԐS���w�Ƃ����̂��Љ��Ă��āA�A�t�H�[�_���X���_�Ƃ������̂Ńt���[����肪�����ł��邩������Ȃ��炵���B�@������ʔ������B�Љ��Ă�����发��ǂ�ł݂悤���Ǝv���B

���A�����̃e�[�}�ɂ��Ă���u�I����v�͓���̂����A���ʏ�Ԃł̈ړ������̌n������̂͌`�������Ă����B���ꂪ�ł���ƐF��ȓ�����ȒP�ɋL�q�ł���̂Ŋ��҂��傫���B

���P�O���Q�S����

�e�߂̊p�x�╉�ׂ��Ď����邱�ƂŃt�B�[�h�o�b�N�������āA������C�����Ă����Ƃ������Ƃ��l���Ă���̂ŁA��͂�e�T�[�{�̃f�[�^���擾���Ȃ���Ȃ�Ȃ��Ǝv������B���܂܂ł͈��̃C���^�[�o�����[�`���Ŋp�x���擾�ł���T�[�{�����Q���x�Ɍ��肵�Ă����̂����A���̑S�߂��Ď����Ȃ���Ȃ�Ȃ��Ƃ����̂����_�ƂȂ����B�����Ȃ��Řr�ō�Ƃ����鎞�͘r�̕����Ď�����A�Ƃ�����ɐ�ւ������Ȃ���Ȃ�Ȃ����낤�B�C���^�[�o�����[�`�����ŁA�Б��̑S�T�[�{�f�[�^�擾�A�W���C���f�[�^�擾�A�㔼�g�̃T�[�{�f�[�^�P�����擾�A���̑��w�b�h���W���[���Ƃ��f�[�^�擾��R�}���h�f�[�^���M�����邵�A����A�����Z���T�[��}�j�s�����[�^�ɂ��}�C�R����u�����Ǝv���Ă���̂ł��̒ʐM������B

����ƁA30ms�����ł���ƊԂɍ������x�ɂȂ��Ă��܂����B�p�x���o������30ms���M���M���Ȃ̂ł���ȏ������傫�����邱�Ƃ͂ł��Ȃ��B�@����ŁA���̊p�x�f�[�^��60ms�����Ńf�[�^�擾���邱�Ƃ��ł����̂����B�B�B������Ɨ]�T���Ȃ������B�@���̃T�[�{�f�[�^�擾�Ɓ@�W���C���A�㔼�g�T�[�{�A���̑��̃}�C�R���̃O���[�v���ăf�[�^�擾����������������������Ȃ��B��������ƁA�@�C���^�[�o��������30ms��25ms�A�p�x�f�[�^���o������30ms��25ms�A���̃f�[�^�擾������60ms��100ms�A�@�W���C���f�[�^��30ms��50ms�ƂȂ�B�㔼�g�T�[�{�̃f�[�^�擾������500ms�ȏ�ɂȂ�B���ꂪ���E���Ȃ��`�B�@RS485�ʐM�̃E�F�C�g�^�C���̐ݒ肪115200bps�ł̐ݒ�l�̂܂܂������̂ŁA460800bps�ɍ��킹�ďC�����Ă݂����A���ʂ͏����������݂����B

�����ɂ̓����_���炵�āA�T�[�{�̃t�@�[���o�[�W�����A�b�v�̂��߂ɔ������Ă��܂��\�肾����A����ł��炭�͓X���܂��ƂȂ�B�@���炭�͘_�������Ɖ����������W���[���̉��ǂȂǂ����悤���Ǝv���Ă���B

���P�P���S����

����10��30���Ƀ����_���炵�ăX�s�[�V�[�Y�ɑ���Ԃ����B�@�t�@�[���o�[�W�����A�b�v�����炢�����Ƃ�����̂��ǂ������炸���������A�܂��A�o�[�W�����グ�đ��͂���܂��B�@2�T�Ԃقǂ�����Ƃ����b���������A�Ȃ�����ł�݂����Ŏ��Ԃ����邩���m��Ȃ��ƌ����Ă���y��������30���ɑ������B�@�����_�����邤���ɏo���邱�Ƃ���Ă������Ǝv�����̂����ǁA���������v���O�����������_�̃v���O�����ɂȂ��������Ďd���Ȃ��Ȃ��āA�����_���Ȃ��Ă��J���ł��鉹�������ɒ��肵�Ă��܂����B�A�z�ł��B�@�܂��A�܂�����̕\�����ł܂��ĂȂ�����R�[�f�B���O���ł��Ȃ��킯�ŁA�����ɂ��Ă������Ă��d���Ȃ��B

�@������O�@�����と�@�@

�Ƃ��낪�A�C���^�O�̎����ɂ��̂����[���n�}���Ă��܂��āA�Ȃ�Ƃ��Ȃ����̂��A�����̌ߑO���B(>_<)�@��ꂽ�`�B�����̃A�^�}�̈��������������ˁA���������Ƃ��B�B�B�@����ɂ��Ă��\����͂��ē���ȁB�F��ȏ�Ԃ�z�肵�Ȃ��ƂȂ�Ȃ��B�@�܁A�����_�ɑg�ݍ���A���܂��������������Ȃ��͂������炻��ȂɌ����ɃG���[���o����K�v�͂Ȃ��̂����B

���ƁA���{�b�g�Ɖ�b���������B�@���R�ȉ�b����Ȃ��Ă悭���āA���{�b�g�̓A�z�ł������ǁA���t�Ƃ��A���̖��O��������ꂽ�肷��悤�Ȓm�\�v���O����������Ă݂����B

�����_�����璆�ɂ�肽�����ƁA�A���\�����ς��o�Ă����B

�ŁA�����A�A�C�{���v�X�ɏ[�d���ē������Ă݂��B�@����2�N���O�ɍ�����v���O�����ŁA�摜���畨�̂𒊏o���Ēǔ�����v���O�����B�@�s���N�{�[���݂����Ƀf�W�^������Ȃ����炷���������Ă��܂����ǁA�v�X�ɓ����Ă錩�Ă�����Ɗ��������B

�A�C�{�͂S����������s�����肵�Ă�B�����邱�Ƃ��l���Ȃ��Ă���������s���v��Ƃ��̑�]�I�v���O�����̌����Ɏg����B�J�����̉�p�������Ƃ����������グ��͙̂����邵���Ȃ��Ƃ��A����Ȃ�ɐ������傫�����B

�Ƃ肠�����͊��ɍ�����ėp�̕��s�E���[�V�����v���O�����̃}�j���A�����܂Ƃ߂悤���ˁB��������Y��ĂĂǂ����悤���Ȃ��B(^^�U

���P�P���P�Q����

�A�C�{�̕��s�I�u�W�F�N�g�̃}�j���A���������Ă���ƁA����ƃI�u�W�F�N�g���g���čs������v���O��������肽���Ȃ��Ă����B�s������v���O�����͈ړ��E�F���Ȃǂ̎��ӋZ�p���Ȃ���ΐ��藧���Ȃ������肽����肽���Ǝv���A�܂��T�b�J�[�{�[�����S�[���֏R�肱�ނƂ������Z�̂��߂̃v���O����������������Ƃ��Ȃ��B�@�l����l����قǓ���v���O�������B�@��������s�I�u�W�F�N�g�������Ă����̔F�����ԔF�����ł��Ȃ��፩�����x���̍s���v���O���������g�߂Ȃ����炷���ɂǂ��������Ă킯����Ȃ����ǁA�����_�ŕ��s����v���O�������l���Ă鎞���͍s���ɂ��čl���邱�Ƃ��o���銴���B�@�A�C�{�͊ȒP�ɂ͂����Ȃ�����ˁB

�s������v���O�������l����̂��āA�����_�̕��s�v���O�������l���邭�炢�̎v�l���������炿����ƂȂ�Ȃ̂ŁA�A�C�{��Gtalk�������_��Gtalk�Ɠ����x���ɂ��Ă������Ƃɂ��܂��B���Ȃ�F�X�킩���Ă邩���Ƃ��X���[�Y���낤�B�@���Ďv���ĂƂ肩���������ǁA�A�C�{�I�u�W�F�N�g���L�̕����ƁA�ł��邾���\�[�X�������_�̂Ƌ��ʂɂ��������Ă����C�������炿����Ƌ�J���Ă��܂����B�@�Ō�̓������[���蓖�Ă̖�肪�o�āA��������̂ɔ������������B�@�Ȃ��킩��Acalloc( )�@������ɓ����ĂȂ��A�@malloc( )�ɐ�ւ����琳��ɓ����悤�ɂȂ����B

���������͂قڊ����Ȃ̂ŁA���x�͉����F���B�@julius�̈ڐA�ł��B�@julius��Cygwin��Linux�AFreeBSD�ł͓������ǁANetBSD�ł͓����Ȃ��B�@NetBSD�̃I�[�f�B�I�h���C�o�[��solaris2�̂���Ƃقړ����悤�Ȃ̂ŁAsolaris2�p�̃\�[�X����������NetBSD�p�ɂ��܂����B�@�r�����C�u���������������Ă͂܂������ǁA�Ȃ�Ƃ������o����NetBSD�ւ̈ڐA�������B�@�v�������X���[�Y�ɍs���Ă悩�����B�����RPU-100�ւ͈ڐA�ł���\�����o�Ă����B���Ȃ݂Ƀ}�C�N���ʂ�����Ȃ��āA�吺�Ń}�C�N�ɓ{��Ȃ���ΔF�����Ă���Ȃ�����F�����͒�߂ł����B�@���̐�A�摜�������l�����RPU-100�����ł̏����͌������Ȃ��Ă����BRPU-100�͏��]�ɂ��āA��]�̓������l���˂Ȃ�Ȃ���������Ȃ��B�@�r�W�I���݂����ɏ��]�̓}�C�R���ɂ��Ă��܂��Ă�������������Ȃ��ƍl���Ă���B���̃}�C�R���ŋ������삳�������������悤�ȋC�����Ă�ȁ[�B�@��]�Ə��]�����L�ڃ������[�łȂ�����ł���Ί����Ȃ��ǂˁB

���āAjulius�̃����_�iRPU-100)�ւ̈ڐA��A�C�{�ւ̈ڐA�����͂����ǁA�A�C�{�̕��̔F���v���O�����������������H�v���ē��̔F�����ł���悤�ɂ������ȂƁA��ԔF���̂��߂̉摜�������~�����ȂƂ��l���o�����B2�N�߂��O�̏������\�[�X�Ȃ��ǁA�`�����炳���ς�킩���B������Ǝ��Ԃ����ēǂ܂Ȃ��Ƃ��߂݂����B

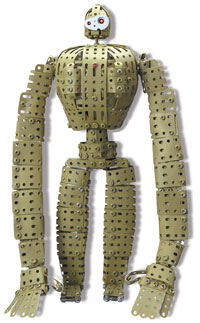

�@�@�f���^�b�N�X�̃��s���^�̃��{�b�g���B�@�����o�����[�B�~�����ȁB

�@�@�f���^�b�N�X�̃��s���^�̃��{�b�g���B�@�����o�����[�B�~�����ȁB

���P�P���P�W����

��Q�T�ԂŃT�[�{��CPU���j�b�g���߂��Ă����B�@�₢���킹��܂ŘA���������A�o�[�W�����A�b�v�̓��e���s���̂܂܁E�E�E�B�@��������炸�C�}�C�`�Ȋ����B

�A�C�{�̍s���v���O�����Ő���オ���Ă����Ƃ���Ȃ̂ł�����ƌ�딯������銴�������ǂƂ肠�����̓����_��g�ݗ��ĂĂ����Ȃ���n�܂�Ȃ��B

�ł̓T�[�{�̓���m�F�����đg�ݗ��Ă悤�Ǝv�������ǁACPU���j�b�g�͊��S�ɏ���������Ă��Đݒ�Ɏ�Ԏ���Ă��܂����B�@�T�[�{�̂h�c���m�F���āA�A����H�h�c�P�������B�����A�lj��w�������T�[�{�͂P�ɂ��Ă����̂��[�Ǝv���Ăh�c���Q�Q�ɏC�����悤�Ƃ������ǁA�o�[�W�����A�b�v�O�ƈ���ăT�[�{�Ƀ��Z�b�g��������Ȃ��B�Ă̒�d�������Ȃ����Ɛݒ肪���ɖ߂��Ă���B�@�{�[���[�g�ύX�������Ă݂���������ԁB�{�[���[�g�ύX�̓��u�[�g��ɓK�p�Ȃ̂ʼn��̕ω��������Ȃ��B�@�T�[�{�̎d�l��������ƁAROM�������݂̓R�}���h���M�̎��ɂe�k�f�̂���r�b�g�𗧂Ă邱�ƂɂȂ��Ă���B�h�c�ύX�����[�g�ύX���X�s�[�V�[�Y�������C�u�������g���Ă�����ǁA���Ă͂��̕ӂ��T�[�{�̃t�@�[���A�b�v�̑Ώۂ��A���܂ł̃t�@�[���͎d�l���ǂ���ɓ����ĂȂ��āA���C�u�����̊�������ɍ��킹�����̂�������Ȃ����ȁ[�B�t�@�[���A�b�v�����烉�C�u�����[�̃o�[�W�������グ�Ȃ���Ȃ�Ȃ��낤�ȁB�@�{���ɓK���ȘA���ō���B�@�������j�b�g����p��ATMEGA32�}�C�R���Ń��C�u�������̑���o���Ă���R�}���h���\�������Ă݂�ƈĂ̒�FLG�̓[���̂܂܁B�@�ŁA�d�l���ǂ���̃R�}���h�𑗂�悤�Ƀv���O������g��ł݂����A���ʂ͓����B���č��������B�d�l�����ύX�ɂȂ��Ă�̂��[�A�ƔY�ނ��Ƃ����B�@���������t�^�o��HP�ɂ�RS601CR�̎d�l�����_�E�����[�h�ł���悤�ɂȂ��Ă����o��������̂Ō��ɍs���Ă݂�B�@�E�E�E�@�\�z�ǂ���d�l�����ύX�ɂȂ��Ă���BROM�������݂ƃ��u�[�g��FLG�̃r�b�g�𗧂ĂāA�A�h���X��FF�ɂ��ăf�[�^�Ȃ��ő���炵���B�@������v���O�������Ă݂���A����Ƃh�c���������߂��B�@���ꂩ�����ƃ����_�̑g�ݗ��Ăɓ��������ǁA�b�o�t���j�b�g�̐ݒ��T�[�{�̃S�^�S�^�̂����������č�������������Ă��܂����B

�����_�̑g�ݗ��Ă�����̂����B�������v�ɂȂ��Ă邩��g�ݗ��Ă̎菇�������������܂��ĂāA�g��ł͂炵�A�P�ł͂炵���Ă���Ă��܂����B�����Ǝ菇��������Ƃ��Ȃ��Ƃ��߂��ȁB

���P�P���P�X����

�Ƃ��Ƃ��t�@�[���o�[�W�����A�b�v�ł̃T�[�{�Ń����_�������o�����B�������[�}�b�v�܂ŕύX�ɂȂ��Ă���̂ł����Ƃ�������Ȃ��Ɠ����Ȃ������B�@460800bps�Ń}���`�T�[�{���߂ɗe�ʌ��E������_�͕ς���ĂȂ��B�n�[�h�E�F�A�̖��ƌ���ꂽ���{�����ȁ[�H�@�}���c�o�ł��B

����ɂ��Ă��A�^�}���Ȃ���ȁB�@

���P�P���Q�V����

�����_�̑g�ݗ��Ă����������r�[�ɍ��M���o�āA�Q����ł��܂����B���܂܂łōŒ��̂T���Ԃ����M�������Ă���ƏT���ɕ����f�L�}�V�^�B���������̔�ѐΘA�x�������̂ɁB�B

NetBSD�ɃW�����A�����ڐA�������A�I�[�f�B�I�f�o�C�X�W�ȊO�͂��܂�ɂ�����Ȃ�ƍ�Ƃ��i�̂ŁARPU-100�ւ̈ڐA������Ă݂邱�Ƃɂ����B��T�̂����ɃI�[�f�B�I�����c���ăR���p�C���͊����BGtalk�̍ۂɂ͔���Ȃ�����varlist�W�̃R���p�C�����ł��܂����B�ŁAWAV�t�@�C���ł̉����F���������B�G���f�B�A���̈Ⴂ����肠��܂���B�i�u����܂���v����Ȃ��Ă����ƃ\�[�X�������Ȃ��Ă��邩��Ȃ̂����B�j�@

�a�C���������̂ŃI�[�f�B�I�f�o�C�X�����̈ڐA�����������ƏI��点�ăW�����A���̈ڐA�������������Ⴈ���B�@��������RPU-100�̃I�[�f�B�I�f�o�C�X�̓����ɘf�킳��ڐA�������B�@��قǁA�W�����A���L�b�g�Łu�u�h�E�����������v�Ƃ��u�݂�����O���������v�Ƃ��F���ł���悤�ɂȂ�܂����B

����ʼn��������Ɖ����F���̖ڏ��������B�����_�Ɖ�b�ł�������߂��I

����ɂ��Ă�RPU-100�̂������ȃI�[�f�B�I�f�o�C�X�̋����͂�����ƃh�L�������g�����Ă����Ȃ���A�G�邽�тɌ˘f���B

RPU-100�̃I�[�f�B�I�d�l�F

�@�f�t�H���g��16bit 16kHz 2ch �����t��short�i�r�b�O�G���f�B�A���j�̃f�[�^���o���B

�A�f�o�C�X�ւ̃f�[�^����ł͂��̐ݒ�͕ύX�ł��Ȃ��B�@��p�R�}���h�@chgausr

�ŃT���v�����[�g�̂ݕύX�ł���B

�B�f�o�C�X�ւ̃f�[�^����iAUDIO_SET_INFO)�ő���ł��Ȃ��f�[�^��ݒ肷��ƃG���[��Ԃ��B�܁A����͕��ʂ��B

�C2ch�f�[�^�����A�ǂ���������������B�@�P�Ԗڂ̃f�[�^�̕����Q�C�����傫���̂ł�������g���������������낤�B

�d�l�Ƃ͂���Ȃ��ȁB�o�O���炯���Ċ����B(-_-;)

����ɂ���Gtalk�����̃\�[�X�ł����Ɠ����Ă�̂̓G���[�����������Ƃ���Ă��Ȃ�����̂悤�ł���B�����Ȃ���B�B�Bvarlist���B�B�B

���P�P���Q�X����

�����_�����@���ɃA�C�{��G���Ă����Ƃ�AJulian�̈ڐA���v���̂ق����܂��s�������ƂŁA��肽�����Ƃ�����I�ɑ����Ă��܂��č������B�����Ƃ����Ă݂�ƁA

���R�̂��Ƃ��A�P�̃����_�̉����g����̃��f�����@���d�v�x���ʂȂ��ǁA�Ȃ�����Č������Ȃ��Ȃ��i�܂Ȃ��B�@���̕����ȒP�ɂł����Ⴂ�����Ŗڈڂ肵�Ă��܂��B�@�����Ȃ����{�b�g�݂͂��߂����Ȃ��B���������_�����R�ɕ����������B

���P�Q���Q����

�����g����̃��f�������������i��ł����B�A�C�{�̂悤�ȂS�����s�̏ꍇ�͂��ꂼ��̑��̓����͊�{�I�ɓ����ňʑ������炵���`�ƂȂ������A�Q�����s�̏ꍇ�͂���قNJȒP�ł͂Ȃ��B�@�F�X�ƍl�������ʁA�̏d�ړ��˗��������낦��ˊp�x�ړ��ˑ����L����ˑ̏d�ړ��i�߂��j�@�Ƃ�������̘A���ł���A���ꂼ��̓��삪�I�����邱�ƂŎ��̓���̃g���K�[�ƂȂ�ʑ�����ł͂Ȃ��āA����q�^�Ƃ������A�}�g�����[�V�J�\���Ƃ������A�l�X�e�B���O�Ƃ������������������ł���Ƃ������_�ƂȂ����B�@���������C���[�W���o���オ��Ǝ����X���[�Y�ɐi�ށB�@�t�ɃC���[�W���ł��Ȃ��ƂȂɂ�����n���{�e������Ă���悤�Ȓ��g�̂Ȃ��������ă��`�x�[�V�������オ��Ȃ��̂��B

�����g�p�����f���𑫂�IK���f���ɕϊ�����Ƃ���܂ł͂ł����B���݂̎p���������g�p�����f���ɕϊ�����Ƃ����̂�����A���S�ϊ��͂ł��Ȃ��B����̎p��������悤�Ȍ`�ł�邵���Ȃ����ƍl���Ă���B�@���݂̑���IK���f���͑������n�ʂɊ��S�ɐڒn���Ă��邱�Ƃ�O��Ƃ������f���ƂȂ��Ă���̂ŁA�ܐ旧���̏�Ԃ�\���ł��Ȃ��̂��B���ۂɂ͑��̗��ł͂Ȃ��A���̕ӂ������ڒn���Ă���悤�Ȏp���ł������Ƃ͏o����̂ŁA���̂悤�ȏꍇ�ɂ������Ȃ��ƂɂȂ��Ă��܂��̂��B

���ƁA�A�C�{�̕��s���W���[���̉��ǂ����s���čs���Ă���B�@���̉��ǂ��ł���Ɛ����Ɛ������ꂽ���s���W���[���ƂȂ�Ǝv���B

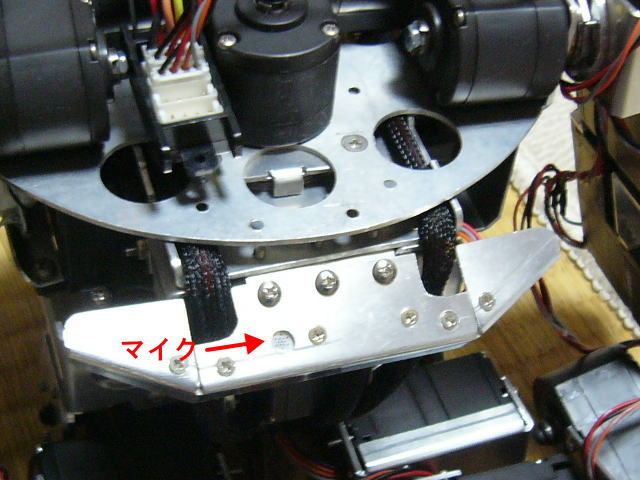

Julian�̈ڐA�����܂��������̂Ń}�C�N�̎������}���Ȃ���Ȃ�Ȃ��B��͂�}�C�N�͓����ɐ݂������Ƃ��낾���A�P�[�u���͒����Ȃ邵�A�ʓ|�������Ă��ƂŁA���̃o���p�[�����Ɏd���ނ��Ƃɂ����B�@

�}�C�N�̎������ł�����A�����v��̃Z���T�[�̎���������Ɗ�������B

���P�Q���R����

�}�C�N�̎����������B�@�Ȃ��Ȃ����܂����܂����B����ŁA�T�[�{���������ɂǂꂭ�炢�m�C�Y���E��������肾�ȁB

���܂ꂽ�r�f�I�̕ҏW��������A�������ɍs������ł��܂胍�{�b�g�Ɏ��Ԃ��g���Ȃ������̂����A������ă����_�̉����g����͂������i�߂��B�@�R�[�h�������Ƃ�����Ƃ��C���[�W���킢�Ă���B�@�����Ă͏����A�C�����A�̌J��Ԃ��Ői�߂Ă����̂��B�@�A�C�{�̕��s���ǂ͂����ς��������Ȃ������B

���������A�����̃}���V�����ɂ��a�t���b�c��������炵���B�x�X�g�G�t�H�[�g������ǂꂭ�炢�̑��x�ɂȂ�̂��킩��ǁA�`�c�r�k�W�l���͗ǂ��Ȃ邾�낤�B�䂪�Ƃ͓d�b�ǂ̋߂��Ȃ̂ł`�c�r�k�����肵�Ă��Ă���قǕs�ւ͂Ȃ��̂����A���̋@��ɓd�b�����ɐ�ւ��Ă݂悤���Ǝv���Ă�B�e���r�Ȃ͖����Ȃ낤�Ȃ��B�X�J�p�[�������C������B

���P�Q���P�O����

���̏T���͓y�j���̓A�C�{�̎p���ڍs���s�̎����E���j���̓����_�̉����g����̃R�[�f�B���O�ƌv�悵�Ă����B�@���ʂ̓A�C�{�̎p���ڍs���s�̎����ł܂�܂�Q���ԏI����Ă��܂����B�i���A10��24��30���j�@�o���֍s�����}�̒��╽���̖�Ɏ��O�������\��������ɂ��ւ�炸�A�������̍l���R��Ƃ�����Ȃ��o�O�Ŏ��Ԃ�H���Ă��܂����B�@�Ƃ肠�����͒�����Ԃ��炢���Ȃ�N���[�����s���s����悤�ɂȂ����̂ŁA�����B����ŁA���̒ǔ��̑������܂�₩�ɂȂ�͂����B

����ɂ��Ă��A�C�{�i�Ƃ�����OPEN-R�Ƃ������A�j�͂��炵���B�@�v���O�����̃��[�h�ɂl�r���������Ȃ���Ȃ�Ȃ��̂��߂�ǂ��������A���������u�[�g���Ȃ���Ȃ�Ȃ��̂��C�}�C�`�����A���{�b�g�Ƃ��Ă͐����Ƃ܂Ƃ܂�̂����V�X�e�����Ǝv���B���ꂪ�Ȃ��Ȃ�Ȃ�Ă��������Ȃ��Ȃ��B�@�A�C�{�͂����Ƃ��Ă��L�����I�܂ł�������Ȃ�Ė{���ɂ�����Ȃ����_�����������B�\�j�[�́B

���T����͖Y�N��V���[�Y�ɓ˓��B���̌�͋A�ȂƁA���Ԃ����R�Ɏ��Ȃ��̂����A�����_�̉����g����̃R�[�f�B���O�����I��点�����ȁB

���P�Q���P�U����

�����_�̉����g����̖ڏ������O�ɃA�C�{�̕��s�̉��ǂ�������̂́A���̓A�C�{���G�肽���Ďd���Ȃ��������炾�B�A�C�{���D���Ƃ�����Ȃ��āA���{�b�g�̍s���v���O��������肽���Ȃ��Ă���B�@��������Julian�̃A�C�{�ւ̈ڐA��A���̔F���v���O�����̍\�z���]���Ŏn�܂��Ă���̂��B�̐S�̍s���v���O�����̍��q�������ς�Ȃ̂Œ������̂�Ȃ̂����A�^���Ɍ����ɓ��肽���Ȃ��ƁB�B�B

�ŁA������s���v���O������z�z���Ă݂����Ȃ��`�ƍl�����肵�Ă�B�@���܂��ɃA�C�{�����L���Ă��郆�[�U�[���Ă̂́u�A�C�{���C�t�v�����̃��[�U�[���A�����Ńv���O�������J���ł��郆�[�U�[����̂��߂ɃA�C�{�����ނƂ��Ďg���Ă���l�������낤������v������Ƃ��v���Ȃ��̂����A�u�l���y���܂���v���{�b�g�ł͂Ȃ��A�u���{�b�g�̂��߂́v���{�b�g���Ă̂��A�u���{�b�g�v���̂��̂���肽���Ƃ����ړI�̌��_�Ɉ�ԋ߂���ނ��A�C�{�����ˁB���܂�^���҂����Ȃ����̃��{�b�g�ς����L�ł���l�������邩������Ȃ����B

�A�C�{��G�������Ƃ��ƃ����_�̃n�[�h�E�F�A�Ƃ��Ă̊����x�̒Ⴓ�������������B���`�����������i�Ȃ̂͏��m�̏�Ȃ̂����A����͂Ȃ�Ƃ����Ȃ��ƂȂ��B

���āA�����͌����Ă������_���厖�B�@�����g����v���O�����𑁂��d�グ�悤�B�@���R�p�����牺���g�p�����f���ւ̋t�ϊ����v������������ƂɋC�t���B�@�܂��w�Ɗi�����˂B

�n�[�h�E�F�A�̊����x�Ƃ����ARS485�ł̒ʐM�G���[�̑��������B���낻��I�V�����ĒʐM�����Ɏ�����悤���ȁB

�@�t�r�a�ڑ��Q�O�O�l�g���f�W�^���X�g���[�W�I�V���X�R�[�v�@�r�c�r�Q�O�O�`�@82,500�~�B�@�{�[�i�X�Ŕ��������ȁB�@�����O��������Ă�B

�@�t�r�a�ڑ��Q�O�O�l�g���f�W�^���X�g���[�W�I�V���X�R�[�v�@�r�c�r�Q�O�O�`�@82,500�~�B�@�{�[�i�X�Ŕ��������ȁB�@�����O��������Ă�B

���P�Q���P�V����

���͂Q��ڃA�C�{ERS-210�͂R�䎝���Ă�BERS-7�͂P��Ȃ̂����A�����P�䂭�炢�~�����Ď��X���t�I�N���`�F�b�N���Ă�B�@ERS-210�̓��W���[��������Ă邵�A�n�[�h�E�F�A�̊����x���������A�C�W���b�オ����̂�210���Ǝv���̂����A�V�̊����x�ɂ͂��Ȃ�Ȃ��B�V�̓p���[�����J���ŋ��A�C�{�ł��B�ł��A�V�͍�����ˁB�v���~�A���i�Ƃ܂ł͂����Ȃ����ǒ艿���炢�ŏo����Ă�B�@������210�͌��\���l�Ŏ������Ă�B����������Ă�̂�2���~�ȉ��B�����邽�тɁA����͔������ȁ[�A���₢������R�䂠�邤���ɐQ�Ă邩��B�B���Ă��������������Ă��܂��B�@�Q�P�O�̂Q��ڂ����������ړI�Ŕ������̂Ɏ�t����������ȁB�@210�͊���������铮�삪�ł���߂�������ǁA���ꂪ���_�Ȃ�ˁB������_�u���`���g�ɉ����ł���Ύg�����ɂȂ邾�낤�ɂȂ��ƍl���Ă�̂����A�����ł��Ȃ����ȁB

�����̓����_�̉����g���삪�����Ƃ���܂ł��������B�@�^�C�~���O�⓮��J�[�u�Ȃ͎�t���������A�J�[�u���ł���d�g�݂͎������Ă��Ȃ��̂ł܂������������Ȃ��ƂȂ�Ȃ����A�傫�ȈӖ��ł̓����͊��������B

�������Ă݂�ƁA����̗���͂����̂����A���ۂ̕��s����Ƃ͒������B�^�C�~���O�����ȂǂœK�Ȑݒ��������̂ɋ�J�������B�@������A���̐ݒ�����������������ƍl���Ă���̂����A�~�����������������B�@�f�t�h�̃G�f�B�^�[���~�����Ȃ肻���Ȃ̂����AGUI�A�v���ɍs���ׂ����A�b�t�h�Ŋ撣�邩�B�����Ƃ���B

���P�Q���P�W����

ROBOT WATCH�Ɂu��1�� KYOSHO �A�X���`�N�X�E�q���[�}�m�C�hCUP�J�Áv�̋L�����ڂ��Ă����B�����́u�}�m�C�v���g�������{�b�g�̑��炵���̂����A��������Ƃ��p�t�H�[�}���X����Ƃ�������B����������Ă̂̓����R���ł͂Ȃ��A�t���I�[�g�œk����������炵���B�@�`�A�C�{�̃J���t�@�����X�̓k���������������`�@�ŁA���̎�������Ŋ����҂��o�����ċ����́i���ꂪ�����Ȃ̂����j���ʂ��o���炵���B����Ȃ�ł����̂��˂��B�@�p�t�H�[�}���X����ȂA�����ƂЂǂ��B�@�}�m�C�Ƀr�f�I�J���������Ƃ��A�����@�\�����Ƃ��B�B����łP�ʂ����B�@�}�m�C�����{�b�g���W�Ȃ����B(-_-;)�@����Ȃ�ł����̂��˂��`�B�@�p�t�H�[�}���X����̂P�ʁi�J����������̂�ˁj�͑��̐l�ƂP�����N������[���̎�܂��āB�Borz

�A�C�{�ɕ��̔F���������āA���ݏW�߂�������Ă����p�t�H�[�}���X����낤�Ƃ��āA���̔F�������ł��Ȃ��������̂��Ƃ��v���o�����B�@���̂Ƃ��̃A�C�{�̃J���t�@�����X�ł̃p�t�H�D���҂͋t�������[�V�������������Ȃ��B�@�t�������[�V������5���~���̏��i���l���i�\�j�[���i�I�����[�����ǂˁj�@�B

���ǂ͍��̃��{�b�g�̃��x�����Ă���Ȃ���BASIMO���L�����I������قǂ��Δ����Ă������킯����Ȃ���ˁB���Ȃ����A�V�����K�i��o�鎞�ɂ������f�����������ǁA��g���Ȃɂ��Ƃ�Ȃ��B�@�L�����I�̊J���҂̃u���O�̘b�Ƃ���ǂނƊ����邯�ǁA������Ăǂ��������{�b�g���Ă��A���s�@�B�Ȃ�ȁ[�B�@�����ɂ����{�b�g�͂��Ȃ������B�@�����݂������B

���X�v���B���z�����A������Ƃ����Ԃ����Ă����A���ł��邱�Ƃ��m���ɂ���Ď��т�ς�ł������Ƃ��厖���ƁB�@����������p���͐����������킹�Ă��Ȃ��炵���A�������Ɋ�����킹���r�[�Ƀ��`�x�[�V�������������Ă��܂��͍̂��܂ʼn��x���o���ς݂����炢�܂��炻��ȕ����ւ͐i�߂Ȃ��̂����B

���P�Q���Q�O����

�i��������ǁE�E�j���Ȃ����剉�́u�l�̕������v���I������B�@�u�l�́E�E�E�v�V���[�Y�R����̂R���ڂ��Ă��Ƃ����ǁA�O�̓���ʔ����Č��ǂR����S�����ς��B�@�Â��Șb�̐i�ݕ��ƁA�o�Ă���l�������݂�ȗD�����̂����ɐS�n�悢�앗�ŁA�u�������v���咣���鎩���ɂƂ��Ă͖���ςĂ���Ɨ܂��o�Ă����ʂ������č���������������ǁA�D���ȍ�i�ł����B�@�u�l�̕������v���n�܂鎞�ɑ��Ȃ��������ǂ̐N�̖��������Ă��ƂŁA���a���Ă�������Q�Ɠ������Ă��������̍�i�Ȃ̂��Ǝv���ď����S�z�������ǁA�S�R����Ă��č��܂ł́u�l�́E�E�E�v�V���[�Y�ƒʂ�����̂������Ă��܂����B

�P�Ƀh���}���y���ނƋ��ɑ��Ȃ����������鎩�ǂ̐N�̍s�������Ă��Ă�����ƋC���������Ƃ�����܂��B�@�h���}���ǂ�قǎ��ǂƂ����a�C�𐳊m�ɕ\�����Ă��邩�͔���Ȃ����A�����͎��ǂɑ��Ēm��������Ƃ͂����Ȃ��̂Ō�����Ă��镔�������邩������܂��A�P�������ɏ����Ă��܂��܂��B

���lj����鑐�Ȃ������ςĂ��āA�������l���郍�{�b�g�̍s��������v�������܂����B�@���ǂ̓����Ƃ��āA�Z�ʂ������Ȃ�������A�������������J��Ԃ��Ƃ��������Ƃ�����܂��B�@�������A���l������ǂ̂悤�Ȑl�H�m�\�����F�m�͍͂����Ǝv���܂��̂Ń��{�b�g�Ɠ��ꎋ����킯�ł͂Ȃ��̂ł����A�Z�ʂ���������Ƃ������Ƃ����ɍ��x�ł��邱�Ƃ�A�@�����̓������}�ɏ��������p���݂āA�A�z���ďo�Ă�������o�b�t�@����邱�ƂȂ��������Ă��܂����ƂȂǁA���̗l�q�Ől�Ԃ̎v�l�̗l�q�������Ă��܂��܂��B

������ƕs�ސT�ȋC�����Ȃ��ł͂Ȃ��̂ł����A�l�H�m�\�̃C���[�W�̍\�z���ł������ȋC�����āA���ǂ̏Ǘ�ȂǂׂĂ݂悤���Ƃ��v���Ă��܂��B�Ȃɂ��q���g���B����Ă��邩������܂���B

���P�Q���Q�R����

�����g����̃p�����[�^�͂��܂�ɂ������̂ŁA��͂�GUI�N���C�A���g���������������낤�B�@���܂܂ł�Windows�A�v�����ȒP�ɍ���̂�VB6�ō���Ă����̂����AVB���čׂ��ȕϐ��̈�����ꕔ���@��C����ƈقȂ邽�߁A�R�[�f�B���O���~�X���Ă��܂��Ă�����Ȃ��o�O����荞��ł��܂��Ƃ����~�X�ɂ��т��ё������Ă�B�@��y�����炢�����ǂȁ[�B

�ŁA�����VC++�ō�邱�Ƃɂ����BMFC�ō��Ό��\�ȒP�ɍ�ꂻ�����Ȃ��Ă̂��킩�����̂ŁB�B�@�ł��A�v���Ԃ��VC++�𗧂��グ����A���S�ɖY��Ă�B�B�@��������Ă����̂��S�R�킩��Ȃ��B�ŁA�ȑO�Ɍ��������������y�[�W���Q�l�ɂ��Ȃ���N���C�A���g�\�t�g�ɒ���B�܂��t�H�[�������ł��ĂȂ����ǂˁB

�����Ƃ��AGUI�N���C�A���g�ƒʐM����v���O�����Ȃ������Ȃ��Ƃ����Ȃ����炿����Ƃ߂�ǂ��������ǂˁB�}���Ή�ꂩ�ȁB

�����̌ߑO���ɂڂ���ƃl�b�g�����Ă��̂����A�Ђ����Ԃ���͂��ߌ�������K�ꂽ�B�@���ꂩ�̃u���O�Łu�ŋ߂ς��Ƃ��Ȃ��͂��߃��{�b�g�v�Ƃ����������݂��������̂ŁA���������Ǝv���Ă�����Ɨ�������������������̂����ǁA�͂��߃��{�b�g�͂������E�ɍs���Ă��ł��ˁB�͂��߃��{�b�g�P�W�͂P�̂Q�O�O���~�Ŕ̔����Ă�炵���B�����g��RX-64�ŏ㔼�g��DX-117�ƁA�����_�Q���ōl���Ă���A�N�`���G�[�^�\���B�@�J�����̓A�^�}�Ƌ��ɂ����āA���v�Q��B���̍\�����l�������ǁA�Ȃ�ƂȂ��{�c�ĂɂȂ��Ă�B�ǂ�Ȃӂ��Ɏg�������Ă���̂��낤�H�@�A�V�����������ɃJ���������Ă���В��ɓ{��ꂽ�Ƃ������b�������āA���{�b�g�͐l�Ԃ���Ȃ����炢�[�����Ǝv�������Ƃ��������ȁB�@�ǂ�ǂ��ɂ����͂��߃��{�b�g�B�@�ǂ�����̂��ȁ[�B�撣�邵���Ȃ��ȁB

���P�Q���Q�S����

���܂�Ȃ��@�B�@���ꓯ�����̂��Ǝv�����ǁA�Ђ�59,800�~�A�@�Ђ�39,800�~�@�A���i������F�X����낤���ǁA�l�i�Ⴂ�������ȁ[�B

�������ɖ₢���킹�Ă邯�ǕԎ��Ȃ��B

���P�Q���Q�U����

����̖Y�N��ō��N�̖Y�N��͏I���B�@�܂�Ɍ���Y�N��̑����ƁA�����̏o��̑����ł����m���̕n����ԁB(>_<)

�A�Ȃ܂ł̎c��������킸���Ȃ̂ō����͐�����ł��N�������˂Ȃ�܂���B�@�Ȃ̂ɍ���Y�N��������猩��Ȃ������u�̂��߁v�̍ŏI������Ȃ���Ȃ�Ȃ�������A�҂��ɑ҂����v���[�g�D�̂S���i�ʏ�Łj�̔�������������Ő��̒��Ȃ��Ȃ����܂��s���Ȃ����̂ł��B

���N�̔N���ɂ͗����オ��Ȃ������_��o�ꂳ�����̂����A����ȏ�A�O���̂Ȃ������_�����{�b�g�Ɖ��̂Ȃ��l�����ɂ��炷�̂͂炢�̂ō��N�͂���ɓo�ꂵ�Ă��炢�܂����B

����A���M���Ȃ��ǁA���M�����ƃ[���}�C��������ăW�[�W�[�������Ă��́B�@�����ď����Ă����ǁA�N���B�e�̂��߂ɔ�����n�߂ďo�����B�@�����ɕ������Ă݂���[���}�C�������Ȃ��Borz �@���Ă�̂��Ȃ��`�A�������̍b�{�w�O������������Ă��炢�ɍs���̖ʓ|���Ȃ��B�B

������ƃ��{�b�g����̘b���B�B�B

���������Ă���u�����g���쐧��v�͕��s�̊�{�����P���ȓ���̘A���Ƃ��ĕ\�����邱�ƂŁA�\���E�Ǘ������₷�����悤�Ƃ������݁B�@���{�b�g�̕��s���쎩�͓̂|���U�q�ŕ\���ł���炵�����AZMP�K�͂̓��쐶�����s������̂悤�ȋߎ��\���͕s�v�Ƃ��v����̂����A�ǂ����ߑR�Ƃ��Ȃ��̂��B�@�����������邾���ł͂Ȃ��A�w�K�ł���悤�ɂ���̂��ڕW�Ȃ̂ŁA�v�Z�����Ƃ����d�g�݂͂�낵���Ȃ��B�@�����A�p�����[�^�̑����ׂ͂�ڂ��ł���A���s����łȂ�Ƃ��Ȃ���̂ł͂Ȃ��͖̂����B�@�����ɂ��āA���쐶���̃p�����[�^�����ZMP�̌v�Z�ɂ��K�C�h���C���̐����Ȃǂ��K�v�ł͂Ȃ����Ǝv���o�����B�@���̔N���N�n�͂��̕ӂ�̐����̐��������Ă݂悤���Ƃ��v���Ă���B

������A�A�C�{�̍s���������B�B

���P�Q���Q�V����

�����͎d�����߁B�@�����āA�A�ȁA�Ƃ��炭�͂������ƃR�[�f�B���O���ł��鎞�Ԃ͎�ꂻ���ɂȂ��BZMP�v�Z�̌����ƁA�s�������ɂ��Ă̌����Ɏ��Ԃ��g�������Ǝv���Ă���B

���������͍s�������ɂ��čl���Ă����B�@����̃q���g�ɂ��Ȃ肻���Ȃ̂ŁA�������Ă����B

�s���Ƃ́A��㈂ɂ���Ă����炳���̂ł͂Ȃ��A�A�[�I�ɂ����炳�����̂ł͂Ȃ����낤���B

����ړI�������čs������̂ł͂Ȃ��A����V�[���ɂ��ǂ���ɂ͂��̍s�����K�v������A�s������������̂ł͂Ȃ����ƍl�����B

���{�b�g�������ԂŊ�������ɂ́u���E�ρv���K�v�ł���B���˂�P���ȃ��[�������ł͌���ꂽ���������ł��Ȃ��B�@���E�ςƂ͂��̐��̐��藧����L�����\���𗝉����邱�ƂŁA�l�݂͂ȁA���x���̈Ⴂ�������ꐢ�E�ς������Ă���B�@���藧����L�����\���Ƃ����Ă����H���R�Ƃ��Ă���킯�ł͂Ȃ����G�ɗ��ݍ����Ă���A�S�e�����S�ɔc�����Ă���킯�ł͂Ȃ��B�@�����炭�A�o�������V�[�����Ȃ����킹����A�A�z�����艞�p�����肵�Ă���Ȃ�̌`���`�����Ă���̂����ʂ��Ǝv����B�@���[���ł͂Ȃ��A�o�����瓾�����E�ςɂ��s��������Ƃ������Ƃ͂ǂ��������Ƃ��B

�܂��A���{�b�g�i�R���s���[�^�ƌ����Ă��悢���j�̎����E�ςƂ͉��Ȃ̂��B�@����̓l�b�g���[�N���Ǝv���B�@�V�[���̃l�b�g���[�N���낤�B�@�V�[�����̂��l�b�g���[�N�ł���A�������Ƃ����_�̂悤�ȁu�V�[���v����������A����炪�����N�ɂ��ڑ�����Ă���̂��낤�Ǝv���B�@���̂Ȃ���Ƃ͖��m�ȊW�ł͂Ȃ��A���܂��ܘA�z���邱�Ƃł�������A���܂��ܓ����Ɍo���������Ƃł�������A���R��W�͂��܂��܂��낤�B�@�V�[�����̂��l�b�g���[�N�ŕ\������̂͌���ł͕s�\�Ȃ̂ŁA�f�[�^�\���Ƃ��Ă͂���\���̂ɃV�[���������邱�Ƃ��l����B�\���̓��m�̓����N�������Ă���A����ɂăl�b�g���[�N���`������B

���{�b�g���A����V�[����F�������Ƃ���B�@�o���������Ƃ̂���V�[���ƍ����܂��͗ގ����邽�߁A����V�[�����z�N�����B�@�V�[���̑z�N�̓l�b�g���[�N��ʂ��ă����N���ꂽ���̃V�[�����ĂыN�����A�����̃V�[�����z�N���邱�ƂɂȂ�B�@�����őz�N�����V�[�����m�ɂ͂Ƃ肠�������ݑÓ����͖��Ȃ��B

���ɑz�N�����V�[�����m��_���I�ɐڑ����鎎�݂��s����B�@�V�[���`�ƃV�[���d���z�N���Ă���Ƃ��A�V�[���`����V�[���d�ֈڍs����ɂ͂ǂ̂悤�ȏ�������������Ȃ��Ƃ����Ȃ������������邱�ƂɂȂ�B�@�����ł͘_���Ƃ������Ƃ��\�����Ă��邪�A��������L�̑z�N�̘A���ō\�������̂�������Ȃ��B

�����̌��ʁA�V�[��A�˃V�[��B�˃V�[��C�˃V�[��D�˃V�[��E�Ƙ_���I�Ȉڍs���\�Ƃ킩�����Ƃ���B�V�[���ڍs�������I�ƂȂ����Ƃ��A�z�N���Ă����s���͌����̍s���̔����ƂȂ�B�@���̏ꍇ�A�V�[��B�ɑ�������s���Ƃ��Ĕ��������B�������A���̌������ʂ͕ۑ�����Ă��炸�A�V�[�����ς�����r�[�ɂ܂��z�N���n�܂�A�������n�܂�B�@�v�l�������ʂ��L�����A�����s���Ɉڂ��Ƃ����v��I�ȍs���͂����̂���ɏ�ʊT�O�ł���A�����ƕ��G�ȍ\���̒��ōs����̂��낤�B

�����͂܂���������Ă��炸�A�C���[�W�����ł͂��邪�A���f���̕����Ƃ��Ă͂Ȃ��Ȃ����������ł���B�s�����ړI�ɒ������Ă��Ȃ��̂��ǂ��B�s�����ړI�ɒ�������̂͑����ȏ�ʊT�O�ł��邩�牺�ʂ̍s�������ł͖ړI�Ƃ������̂������O�ɂ������l�����͂悭�Ȃ��̂ł͂Ȃ����Ǝv���Ă���B

���P�Q���Q�X����

����A�}�b�X���~���[�W�J���̔N�������R����̑���uHOP�`�a���`�v���ςė��܂����B�@���͂���ؓ��̖������C���[�W���Ă����̂ł����A��������V�O�l���̏o���҂��V���N�����Ȃ���D�萬�����Z�Ɋ��S���܂����B�@���肵�����Č��I��������Ɣ�J�����B�B�@�|����30���[�g�����삯������I�g�R���P�������ł��B

�}�b�X�����ς����ƁA�{���ɂ��@��������̂ŁA�l�H�m�\�W�̏��ЂF�B����������܂����B�@���发�Ƃ������T�_���Ƃ������A�Ƃ����₷���������͂����̂����ǁA�T�_�ŏI���߂���̂��Ȃ��A�A�Ǝv���A�m�����Ă��Ȃ����̕���ɂ��Ă͊T�_�̕����ǂ��̂�������Ȃ��Ƃ��B

�^�C�g���Ɋo�����������̂ŁA��������������Ɏ����Ă���\��������ȂƂ�������ISBN�ԍ������T���Ĕ��킸�ɋA���Ă����B

����ł����B�u������v�Ɓu�S�v�Ⴂ�B�@���͓̂N�w�����p���Ēm�\����銴���̃��m�ŁA�������낭�͂��邯�ǁA���܂芴���͂��Ȃ������B

��̂́A��r�I��̓I�Łu���{�b�g�Ɍ��t������ׂ点��v����ׂ点��Ƃ����͔̂�������̂ł͂Ȃ��A���t���̂��̂𗝉������邽�߂ɕK�v�Ȃ��̂͂ȂɂȂ̂��H�Ƃ������ƂŒm�\�i�z���́j���l����Ƃ������́B�@�O�������͊�b�m���҂ł��łɒm���Ă��邱�Ƃ̕��K����Ȃ̂����A�r��ł��������ȁB�@��������ċA�Ȑ�ʼnr�߂悩�����B�@���ꂩ��A�}�]���Œ������Ă���Ɏ���͔̂N���������B�@���[��B�B�B�����������a�J�܂ōs���H�@�����Ƃ��悩�������Ƃ�����ƌ���B�@���ꂼ��̃����N�͏o�ŎЂ̏��ЏЉ�B

�߂�ǂ������ʐM�����̃R�[�f�B���O�����Ȃ����Ƃɂ͐�ɐi�݂����ɂȂ��̂Ŋ撣���ĒʐM�����̍�荞�݁B

�������A���N�قǑO�ɂ�����i�Ǝv�����獡�N�̂Q�����낾�����炵���j�l�b�g���[�N�v���O���~���O�B�@���S�ɖY��Ă�B�@�ǂ�ȃe�X�g�v���O�������������������o���ĂȂ������B(>_<)�@�@�c���Ă������T���v���v���O�����𐳂����������̂ł���������ƔY��ł��܂����B���������Ƃ̓L�`���ƃm�[�g�ɂ܂Ƃ߂Ă����Ȃ�����Ӗ����Ȃ��Ȃ��B�@

�ǂ����N���ɒʐM�����̃R�[�f�B���O���������錩���݂͂قږ����Ȃ����B�@

���P�Q���R�O�����@�@���v�����v���������Q�b�g��

�{���ɍs�����ǂ��������Ă������ǁA�����͓y�j�������A�J�X���Ԃ����肾������v��������ɓ��邩���I�Ǝv���āA�a�J�܂ō���̖{�u���{�b�g�̂�����v���ɍs���Ă��܂����B

�a�J�̂ǂ̗ʔ̓X�ɂ��v�����͂Ȃ��������ǁA�A��Ɋ�����߂��̃}���C�ɓ����Ă��邨�����ቮ����ɂ���܂����B(^^)v

�a�J�̃T�N������r�b�N�J�����ɂ͂Ȃ������̂ŁA�{���������ċA��̂�����������A�y��������ɂv�����̒��I������Ă���m�W�}�d�@�Ɋ�낤�ƋA��̓d�Ԃ�r�����Ԃ��܂����B

�m�W�}�ɍs���Ɓu�v���������v�Ă̂��\�莆���ĂāA�u����̓��ׂ͂P���Q���ɂV�Q��B�@�P�O���`�P�O�����ɒ��I����z�z���܂��B���I�͂P�P���v�������ŁA�A�Ȓ�������A�E�g�B

����A���߂ăl�b�g���[�N�v���O�����̃f�o�b�O�ł���邩���`�Ǝv���ĉw�Ɍ������ĕ����Ă�����A���������q�����ł����}���C�̎��܂������Ă�B����Ⴄ��u�Ɏq���̏Ί�Ƒ܂̒��g�Ɂu�v�����v�̃��S���������C�����ăn�b�Ƃ����B�@���A�}���C�̂������ቮ���������ȁ[�B�@�O�̂��߃`�F�b�N���ɂ����ƁA�A�A�A�u�v��������܂����H�v�@�u�͂��B�������܂��B�v�@�y���Ȃ��`�B�B�@�a�J�̃T�N�����ŁA�u�����ׂȂ́I�H�����Ȃ́I�H�z���g�ɂȂ��́I�H�v���ēX�����U�߂Ă���������ɂ��m�点�Ă��������B(^.^)

�}���I�҂�������}���I�����܂ł̓E�B�[�����A�N�V�����Q�[�����Ȃ�����Ă悤���ˁB�@����Ƃ��[���_���ȁB�@���₢����_���Ȃ���ȁ[�B(^^�U

�Ƃ肠�����A�u�q���[�}�m�C�h���{�b�g�v�i�{�j�@�Ɓu���{�b�g�̂�����v�Ɓ@�v�����������ċA�Ȃ��Ă��܂��B